Linux-Magazin Neu formieren! (Vorschau)

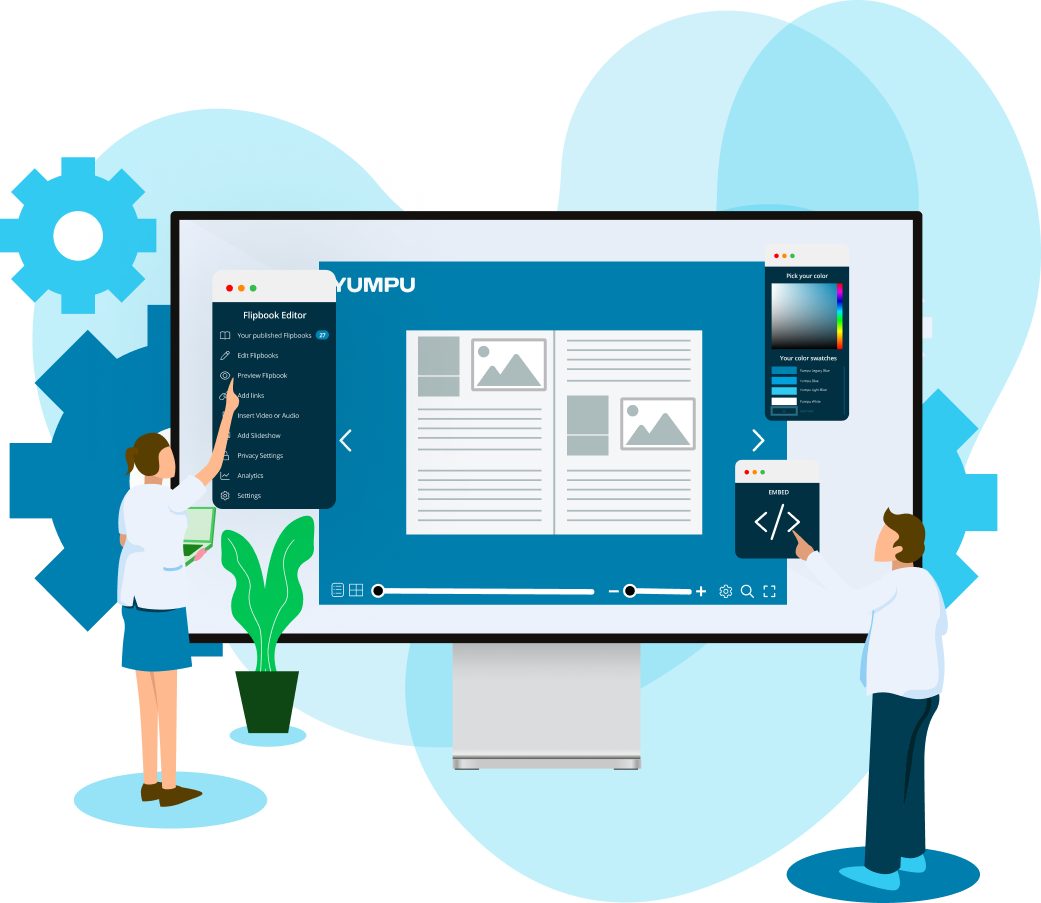

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

12/13<br />

Anzeige:<br />

NeU<br />

siehe<br />

STRATO iST eRSTeR Hoster Deutschlands von<br />

Servern mit neuester Intel® Xeon® E5-v2-CPU.<br />

nächste Seite<br />

strato-pro.de<br />

STR1113_DE_TKS_Dedi-Server_120x17_v2.indd 1<br />

22.10.2013 15:28:32 Uhr<br />

Vier Tools, um 25<br />

Minuten zu arbeiten<br />

Die Pomodoro-Technik animiert ihre<br />

Benutzer, sich zu konzentrieren S. 48<br />

Schöner Schein<br />

Warum Googles Businesspro<br />

duk te so toll sind, und<br />

warum das egal ist S. 56<br />

Xeon Phi<br />

Zum Mitrechnen: Alles<br />

über Intels Antwort auf<br />

Nvidias Tesla-Karten S. 82<br />

<strong>Neu</strong> <strong>formieren</strong>!<br />

Wie Admins durch Umorganisieren und agile Methoden<br />

heldenhaft den Alltag meistern<br />

■ Devops, Scrum und Kanban krempeln um S. 24<br />

■ Report: Admins im Wandel der Zeit S. 30<br />

■ Wie das Selbstmach-Portal Etsy auch<br />

den eigenen IT-Betrieb gebacken kriegt S. 34<br />

■ Organisation und Skalierung<br />

im Rechenzentrum S. 36<br />

■ ITIL hilft zu professionalisieren – wirklich S. 38<br />

■ Bibel bald in <strong>Neu</strong>auflage: „The Practice of<br />

System and Network Administration S. 44<br />

■ Android- und I-OS-Tools für Sysadmins S. 68<br />

■ Stein der Weisen: Lego Mindstorms EV3 S. 86<br />

Dank U-Boot-Einsatz und Spezialkernel: Raspberry Pi bootet übers Netz S. 90<br />

www.linux-magazin.de<br />

Deutschland Österreich Schweiz Benelux Spanien Italien<br />

4 6,40 4 7,05 sfr 12,80 4 7,50 4 8,30 4 8,30<br />

4 192587 306401 12

Vernunft im Volke<br />

Login 12/2013<br />

Editorial<br />

Die weltweit angelegte Bespitzelung von Prism und Tempora machen klar,<br />

die Bezeichnung „staatliche Überwachung“ greift zu kurz. Jeder Mensch ist<br />

nunmal in jedem Land außer dem eigenen per se ein Ausländer – und damit,<br />

wie Snowden bekannt gemacht hat, abhörtechnisch Freiwild. Offensichtlich<br />

existieren weder für den überwachten Bürger als Individuum noch für dessen<br />

Land juristische Wege der Gegenwehr (siehe auch den Rechtsartikel in diesem<br />

<strong>Magazin</strong>). Hinzu kommt der machtpolitische Aspekt, dass Regierungen,<br />

die mit den USA den stärksten Freund aller Zeit haben, sich schlicht nicht<br />

trauen, gegen dessen Tun zu opponieren.<br />

www.linux-magazin.de<br />

3<br />

Es spricht wenig dafür, dass sich die Probleme mit der Zeit von allein oder<br />

national lösen werden. Um das Übel an der Wurzel zu packen, bedürfte es<br />

eines international ausgehandelten Regelwerks, das Mindeststandards für<br />

bürgerliche Freiheiten beim Datenschutz festschreibt und sanktioniert.<br />

Jan Kleinert, Chefredakteur<br />

Den Anstoß für eine Diskussion, die Verhandlungen und die Ausgestaltung müssten, praktisch gesehen, von<br />

den Regierungen der wichtigen Industriestaaten ausgehen. Dass bei diesem Thema so wenig Bewegung<br />

wahrnehmbar ist, liegt zuförderst daran, dass Regierungen wie die deutsche dazu mit einem starken Mandat<br />

ihrer Bürger ausgestattet sein müssten – und das sind sie nicht.<br />

Bei aller medial gefühlten Prism-Empörung: Den Bürger in der Masse interessiert die EEG-Umlage im<br />

Strompreis oder die Bankenrettung ungleich mehr als die (vermeintlich) abstrakte Gefahr vom Ausland aus<br />

abgehört zu werden. Seit dem 1883 geborenen Philosophen und Psychiater Karl Jaspers ist bekannt: „Was<br />

nicht in die Masse dringt, ist unwirksam.“<br />

Mit der deutschen Bundestagswahl ist diese These schnell belegt – im Wahlkampf hat das Thema keine Rolle<br />

gespielt, und Parteien, die eines gelegentlichen Interesses an der Datenhoheit des Einzelnen verdächtig<br />

waren, sind parlamentarisch marginalisiert (Die Linke, B90/Grüne) oder gar nicht vertreten (Piraten, FDP).<br />

Dem Wähler sei dank darf niemand es der nächsten Bundesregierung vorwerfen, wenn sie das Thema Datenschutz<br />

international nicht oder nur am Katzentisch vorbringt.<br />

Obwohl nunmehr als demokratisches Minderheitenproblem ausgemacht, wäre jede Form der Wahlnachlese<br />

unvollständig ohne eine kräftige Ohrfeige für die Piraten: 2,2 Prozent lautet ihr Ergebnis. Bei mehreren<br />

Landtagswahlen ein Jahr zuvor erbeutete die auf digitale Bürgerrechte spezialisierte Partei sieben Prozent<br />

und mehr – und das ohne das ganze Snowden-Wissen von heute. Das Versagen einer Partei gegenüber ihren<br />

Anhängern kann größer kaum sein.<br />

Vom Desinteresse ihrer Landsleute Irritierte, deren Wählerstimmen auf die eine oder andere Weise verhallt<br />

sind, finden bei Karl Jaspers wenn nicht Trost, so doch aber eine Erklärung: „Die Demokratie setzt die Vernunft<br />

im Volke voraus, die sie erst hervorbringen soll.“

Inhalt<br />

www.linux-magazin.de 12/2013 12/2013<br />

4<br />

Viele IT-Abteilungen arbeiten in historisch gewachsenen Strukturen. Mit der Menge der verwalteten<br />

Systeme und der Komplexität der Dienste kommen solche Abteilungen in die Krise.<br />

Der Schwerpunkt „<strong>Neu</strong> <strong>formieren</strong>!“ recherchiert in Theorie und Praxis neue Organisationsformen,<br />

in denen Admins ihre Aufgaben heldenhaft und intelligent umsortieren.<br />

Aktuell<br />

Titelthema: <strong>Neu</strong> <strong>formieren</strong>!<br />

6 N ew s<br />

n Open Elec 3.2.0 verbessert Mediacenter<br />

n Open-Source-Mining auf Asteroiden<br />

n Ubuntu anonymisiert Dash-Suche<br />

24 Scrum und Kanban<br />

Titel<br />

Wie organisiert eine moderne Firma<br />

ihren IT-Betrieb? Zwei deutsche <strong>Linux</strong>-<br />

Unternehmen unter der Lupe.<br />

36 Tausende gleiche Server<br />

Skaleneffekt: Hosting-Firmen profitieren<br />

von moderner Organisation besonders.<br />

38 ITIL in der Praxis<br />

Professionell Umbauen mit den Erfahrungen<br />

aus der IT Infrastructure Library.<br />

Gnome 3.10 ist da und bringt eine überarbeitete<br />

Aktivitätenansicht mit.<br />

12 Zahlen & Trends<br />

n Red Hat wächst zweistellig<br />

n Open-ZFS-Projekt gestartet<br />

Frischer Wind dank agiler Administration.<br />

30 Moderne Admins<br />

Das Berufsbild des Systemadministrators<br />

hat sich verändert.<br />

34 Devops bei Etsy<br />

Ein Administrator erläutert, wie die IT<br />

bei einem New Yorker Online versandhändler<br />

funktioniert.<br />

ITIL hilft IT-Strukturen zu organisieren.<br />

44 Bibel-Autoren im Gespräch<br />

Eine <strong>Neu</strong>auflage der 1000-seitigen<br />

Sysadmin-Bibel soll 2014 erscheinen.<br />

Angeblich gut bedienbar: Der Steam Controller.<br />

18 Zacks Kernel-News<br />

n H8/300-Architektur am Ende<br />

n Diskussionen um Rename-Funktionen<br />

20 OX Summit 2013<br />

Die Open-Xchange-Community auf St. Pauli.<br />

Stargast beim OXS13: Phil Zimmermann (rechts).<br />

Handgemachtes verkauft die Webseite von Etsy.<br />

DELUG-DVD<br />

Ubuntu 13.10<br />

TOOL<br />

Bootet von DVD: Die Server<br />

Edition von Canonicals gerade<br />

erschienenem <strong>Neu</strong>ling<br />

Virtual Appliance<br />

TOOL<br />

TOOL<br />

TOOL<br />

Zum sofortigen Loslegen:<br />

Owncloud 5.0.12 korrekt installiert<br />

auf Open Suse 12.3<br />

TOOL<br />

„Die Admins nicht im Regen stehen lassen!“<br />

Details zu DVD-<br />

TOOL<br />

Inhalten auf S. 47<br />

E-Book komplett<br />

Auf 480 Seiten: „Die Kunst des<br />

Projekt manage ments“<br />

Debconf 2013<br />

Videos: Prominente Debian-Freunde<br />

beim Entwicklertreffen, Teil II<br />

Software-Suite<br />

Passend zu den Artikeln im Heft

12/2013 12/2013<br />

Inhalt<br />

48 Catch up!<br />

Die einfache Zeitmanagementtechnik<br />

Pomodoro kommt langsam in der agilen<br />

Programmierung an. Doch bedarf es<br />

dafür der richtigen Tomaten-Tools.<br />

68 Der Admin-Touch<br />

Ob SSH, Remote Desktops, Sniffer,<br />

Pentests oder VPN: Immer mehr Apps<br />

gestatten den Zugriff auf <strong>Linux</strong>-Server<br />

auch von Android-Tablets aus.<br />

86 <strong>Linux</strong>-Lego<br />

In der neuesten Generation der Mindstorms-Serie<br />

EV 3 von Lego schlägt<br />

ein waschechtes <strong>Linux</strong>-Herz auf ARM-<br />

Basis.<br />

www.linux-magazin.de<br />

5<br />

Software<br />

Sysadmin<br />

Hardware<br />

47<br />

Einführung<br />

Auf der DELUG-DVD: Ubuntu 13.10 Server,<br />

Owncloud auf Suse 12.3, ein E-Book übers<br />

Projektmanagement und Debconf-Videos.<br />

48 Bitparade<br />

Titel<br />

Wider die Prokrastination: Vier Tools<br />

wollen mit der Pomodoro-Technik das<br />

Zeitmanagement optimieren.<br />

54 Tooltipps<br />

Dialog 1.2, Virtenv 0.8.6, Collectd 5.4.0,<br />

Convmv 1.15, und Ngircd 20.3.<br />

61 Einführung<br />

Aus dem Alltag eines Sysadmin: Charly<br />

pfeift auf alte Grundsätze und wechselt<br />

seinen Logfile-Auswerter.<br />

62 Kolab 3.1<br />

I-Rony bringt Caldav und Carddav auf<br />

Mac, <strong>Linux</strong> und Windows.<br />

82 Xeon Phi<br />

Titel<br />

Intels Tesla-Alternative packt auf eine<br />

Beschleunigerkarte zahlreiche CPU-Cores.<br />

86 Lego EV 3<br />

Titel<br />

Lego Mindstorms setzt auf <strong>Linux</strong>, aber<br />

leider bisher nur intern.<br />

Know-how<br />

90 Kern-Technik – Folge 71<br />

Titel<br />

Kernel- und Treiberprogrammierung mit<br />

dem <strong>Linux</strong>-Kernel.<br />

LXC-Verwaltung leicht machen will Virtenv.<br />

Die iPhone-App Erinnerungen gleicht alle Aufgaben<br />

mit dem Kolab Server ab.<br />

68 Admin‘s Little Helper<br />

Titel<br />

Apps zur <strong>Linux</strong>-Remote-Administration<br />

unter Android und I-OS.<br />

96 Web-RTC-Hack<br />

Sicherheitsrisiken in HTML-5-Websockets.<br />

56 Google Business Apps<br />

Titel<br />

Fünf Enterprise-Angebote von Google.<br />

Googles Search-Appliance für Unternehmen.<br />

Service<br />

Forum<br />

74 Bücher<br />

Bücher über Legoprogrammierung<br />

und gutes Webdesign<br />

76 Recht<br />

Prism, Tempora und Co.: Wer wann wen<br />

und wie abhören darf. US-, EU- und deutsches<br />

Recht im Schnelldurchlauf.<br />

Nur Safari prüft die Herkunft der Skripte.<br />

Programmieren<br />

100 C++11 – Folge 13<br />

Modernes C++ in der Praxis - Folge 13:<br />

<strong>Neu</strong>e Hashtabellen machen C++ Beine.<br />

104 Perl-Snapshot<br />

Die Webcam protokolliert auf Microblog.<br />

3 Editorial<br />

108 IT-Profimarkt<br />

109 Seminare<br />

112 Veranstaltungen<br />

112 Inserenten<br />

113 Impressum<br />

114 <strong>Vorschau</strong><br />

78 Abhörsicherheit<br />

Gastkommentar: Abhörsicherheit, VPNs,<br />

VoIP und Open Source.<br />

80 Leserbriefe<br />

Auf den Punkt gebracht.<br />

Mit Oauth meldet sich das Skript bei Tumblr an.

Aktuell<br />

www.linux-magazin.de News 12/2013<br />

6<br />

News<br />

Open Elec 3.2.0: Optimiertes Mediacenter<br />

Ein Wizard führt den Anwender durch die Konfiguration der Mediacenter-<br />

Distribution Open Elec.<br />

Open Elec, eine <strong>Linux</strong>-Distribution<br />

für Mediacenter auf<br />

XBMC-Basis, ist in der neuen<br />

stabilen Version 3.2.0 erhältlich.<br />

Deren Macher haben die<br />

verwendete Mediacenter-Anwendung<br />

XMBC in Version 12<br />

(Frodo) genommen und um<br />

Features aus dem Entwicklerzweig<br />

Gotham bereichert.<br />

Zudem verbesserten sie die<br />

Performance für den Einsatz<br />

auf dem Raspberry Pi.<br />

Als Kernel kommt <strong>Linux</strong> 3.10<br />

zum Einsatz, den Grafikstack<br />

aktualisieren Mesa 9.2 sowie<br />

neue Treiber für AMD-, Intel-<br />

und Nvidia-Karten. Ebenso<br />

hat das Audiosystem ein<br />

Update auf die Alsa-Version<br />

1.0.27 erhalten. Außerdem<br />

haben die Entwickler von<br />

Open Elec an den Netzwerk-<br />

und Bluetooth-Fähigkeiten gearbeitet,<br />

wodurch Open Elec<br />

neuerdings Bluetooth-Tastaturen<br />

und ‐Datei-Übertragungen<br />

unterstützt.<br />

Weitere Details zur neuen Version<br />

finden sich in der Release-Mitteilung<br />

des Projekts.<br />

Open Elec 3.2.0 steht unter<br />

der URL [http://openelec.tv/<br />

get‐openelec] für die Plattformen<br />

i386 und x86_64 bereit,<br />

daneben gibt es Builds für die<br />

Nvidia-Ion- und AMD-Fusion-<br />

Plattform, für Apple-TV- und<br />

Arctic-MC001-Hardware sowie<br />

für den Raspberry Pi. n<br />

Mehr Cloud: Red Hat Storage Server 2.1<br />

Raspyfi 1.0 für audiophile Pi-Nutzer<br />

Der Red Hat Storage Server<br />

erhält verbesserte Cloudfeatures<br />

und erhöht die Kompatibilität<br />

zu Windows. Zu<br />

den neuen Funktionen der<br />

Version 2.1 gehört die umfassende<br />

Unterstützung für das<br />

Cloud-Computing-Framework<br />

Open Stack: Der Storageserver<br />

lässt sich mit einem privaten<br />

Cloudstack integrieren,<br />

inklusive des Object-Storage-<br />

(Swift)-API-Layers aus der<br />

Grizzly-Release. Er dient als<br />

Speicher-Backend für den<br />

Blockspeicher Cinder und den<br />

Imageservice Glance.<br />

Daneben verbessert sich<br />

mit der Nutzung des Server-<br />

Message-Block-Protokolls in<br />

Version 2.0 (SMB 2) die Zusammenarbeit<br />

mit Windows-<br />

Maschinen. Dank seiner Active-Directory-Unterstützung<br />

übernimmt der Storageserver<br />

so auch Dienste für das Redmonder<br />

Betriebssystem. Zudem<br />

bringt die neue Version<br />

eine verbesserte Geo-Replikation<br />

mit, und beim Servermanagement<br />

verspricht die<br />

Integration mit Red Hat Satellite<br />

Vorteile bei Installation,<br />

Administration und Provisionierung.<br />

Der Hersteller bietet Webcasts<br />

passend zum Thema an, die<br />

jedoch eine Registrierung<br />

erfordern. Weitere Informationen<br />

liefert die Produktseite,<br />

Interessierte können den<br />

Server darüber hinaus in der<br />

Amazon-Cloud unter [https://<br />

testdrive.redhat.com] testen. n<br />

Eine audiophile Distribution<br />

für Raspberry-Pi-Nutzer versprechen<br />

die Macher von Raspyfi<br />

[http://www.raspyfi.com], die<br />

kürzlich Version 1.0 veröffentlicht<br />

haben. Die Ankündigung<br />

beginnt mit dem Hinweis auf<br />

wichtige Reparaturen: So<br />

wurden einige Parameter optimiert,<br />

um Zugriffe auf das<br />

NAS zu vereinfachen.<br />

<strong>Neu</strong> in Version 1.0 ist die<br />

Weboberfläche, die man über<br />

die Eingabe von »http://raspyfi/«<br />

in die URL-Leiste eines<br />

Browsers erreicht. Über<br />

sie lässt sich der Audioplayer<br />

plattformübergreifend konfigurieren.<br />

Radiostationen kann<br />

man über die Weboberfläche<br />

integrieren. Dazu genügt es,<br />

Links zu Radio-Playlists im<br />

PLS- oder M3U-Format anzugeben<br />

und zu speichern.<br />

Out of the Box unterstützt Raspyfi<br />

Airplay und lässt sich so<br />

als entfernte Soundausgabe<br />

für Mobilgeräte nutzen, wenn<br />

man vor dem Einsatz das lokale<br />

Abspielen beendet. Schon<br />

länger unterstützt Raspyfi die<br />

Onlinedienste Soundcloud,<br />

Last.fm und Spotify. <strong>Neu</strong> ist<br />

der Support für RAM-Play: Dabei<br />

kopieren Anwender bis zu<br />

256 MByte an Dateien in den<br />

RAM-Play Samba Share, die<br />

Raspyfi dann abspielt.<br />

Raspyfi basiert auf der ARM-<br />

Version von Debian, verwendet<br />

den Music Player Daemon<br />

und unterstützt zudem fast<br />

alle USB-basierten Digital-<br />

Analog-Konverter. n

Crowdfunding verbessert OOXML-Support für freie Bürosuiten<br />

Wie die Arbeitsgruppe Office<br />

Interoperability der OSBA in<br />

einer Pressemitteilung [http://<br />

osb‐alliance.de/index.php?id=120]<br />

Mitte September bekannt gab,<br />

haben der <strong>Linux</strong>-Distributor<br />

Suse, der Hamburger Libre-<br />

Office-Spezialist Lanedo und<br />

einige Behörden unter Leitung<br />

des <strong>Linux</strong>-Verbands die<br />

Unterstützung für Microsofts<br />

XML-Format OOXML in Libre<br />

Office und Apache Open Office<br />

deutlich verbessert.<br />

Gemeinsam investierten sie<br />

160 000 Euro, um die gewünschten<br />

Änderungen zu<br />

erhalten. Die Funktionen<br />

werden schon bald über die<br />

Versionen 3.6 und 4.1 von<br />

Libre Office respektive Apache<br />

Open Office an die Öffentlichkeit<br />

weitergegeben. Das<br />

ist kein Zufall: Die Quellcode-<br />

Lizenzierung unter Apache-<br />

2.0-Lizenz und die Upstream-<br />

Weitergabe waren in der Spezifikation<br />

vorgegeben. n<br />

News 12/2013<br />

Aktuell<br />

www.linux-magazin.de<br />

7<br />

Suse bringt Qemu-AArch64-Port<br />

Ubuntu 13.10 anonymisiert Dash-Suche<br />

Software-Entwickler, die für<br />

die 64-Bit-ARM-Plattform entwickeln,<br />

wird diese Nachricht<br />

freuen: Suse hat den eigenen<br />

AArch64-Port für Qemu freigegeben.<br />

In der Emulation<br />

lasse sich AArch64-Code deutlich<br />

schneller bauen, schreiben<br />

die Entwickler in ihrer<br />

Ankündigung. Konkret ginge<br />

es zehn bis zwanzig Mal flotter<br />

als nach dem Foundation-<br />

Modell von ARM.<br />

Der Code sei Bestandteil des<br />

ARM-64-Projekts von Open<br />

Suse und dank einer Vereinbarung<br />

mit ARM bereits auf<br />

dem Weg in die Quellen des<br />

Qemu-Projekts. In den letzten<br />

Monaten hat Open Suse<br />

immer wieder mit Meldungen<br />

rund um den ARM-Support<br />

für Aufsehen gesorgt, erst<br />

ab Version 12.3 veröffentlichte<br />

man jedoch die ersten<br />

AArch64-Images. <br />

n<br />

Für seine Suchfunktion im<br />

Dash hat Ubuntu reichlich<br />

Prügel einstecken müssen,<br />

unter anderem von Richard<br />

Stallman. Der hatte die darin<br />

integrierte Amazon-Suche als<br />

Spyware bezeichnet. Etwas<br />

neutraler hatte die EFF (Electronic<br />

Frontier Foundation)<br />

ihre Kritik an der Dash-Suchfunktion<br />

formuliert.<br />

Bislang gab die standardmäßig<br />

aktivierte Suche Anfragen an<br />

Amazon weiter, das Dash präsentierte<br />

die Suchergebnisse.<br />

Zwar wanderten die Begriffe<br />

selbst verschlüsselt über Canonicals<br />

Produktserver, doch<br />

die Bilder holte der Browser<br />

per HTTP ab, Angreifer hätten<br />

die Benutzer also zuordnen<br />

können. Das soll sich ab<br />

Ubuntu 13.10 ändern: Laut<br />

Entwickler David Callé anonymisieren<br />

Canonicals Server<br />

nun auch die Bildanfragen. n<br />

Viele Änderungen in Apache Open Office 4.0<br />

Eine Sidebar gehöre zu den<br />

wesentlichen <strong>Neu</strong>erungen<br />

von Apache Open Office 4.0,<br />

schreiben die Macher der freien<br />

Bürosuite in den Release<br />

Notes. Sie mache im Vergleich<br />

zu traditionellen Toolbars einen<br />

besseren Gebrauch der<br />

populären Widescreens.<br />

Die auf der Sidebar abgebildeten<br />

Menüs richten sich<br />

dabei kontextabhängig nach<br />

der vom User ausgewählten<br />

Aufgabe. Es handelt sich um<br />

mehrere, übereinander gestapelte<br />

Bereiche, die sich<br />

einklappen lassen. Die Breite<br />

lässt sich ändern, die Sidebar<br />

auch freischwebend verwenden.<br />

Das ermöglicht es, sie im<br />

Dualbetrieb auf einen zweiten<br />

Bildschirm zu verschieben.<br />

Daneben wurde die Interoperabilität<br />

mit Microsoft Word<br />

verbessert: AOO 4.0 unterstützt<br />

die grafischen Bullets<br />

von MS Word 2003 und stellt<br />

auch sonst fortlaufende Nummerierungen,<br />

Bullets und Referenzen<br />

konsistenter dar. Das<br />

Präsentationsmodul bildet die<br />

Hintergründe in Tabellen und<br />

auf der Masterseite, grafische<br />

Apache Open Office 4.0 glänzt mit einer ganzen Reihe von <strong>Neu</strong>erungen, unter<br />

anderem einer Sidebar.<br />

Nummerierungen sowie Konnektoren<br />

besser ab.<br />

Beim Import von DOCX-Dokumenten<br />

stimmen nun die Outline-Level,<br />

die Hintergrundund<br />

Schriftfarben in Tabellen<br />

und die Nummerierungs- und<br />

Bullet-Typen. Es gibt neue<br />

Farbverläufe und eine erweiterte<br />

Farbpalette. Die Galerie<br />

kann nun SVG-Grafiken verwalten,<br />

einige Grafiken da rin<br />

wurden bereits umgestellt<br />

oder ergänzt. Beim Erstellen<br />

von Bitmap-Füllungen stellt<br />

AOO 4.0 nun Transparenzen<br />

dar und nutzt Anti-Aliasing –<br />

Letzteres klappt auch für die<br />

Druckvorschau. Einen Überblick<br />

der vielen <strong>Neu</strong>erungen<br />

geben die Release Notes. n

Aktuell<br />

www.linux-magazin.de News 12/2013<br />

8<br />

Rubygems 2.1.1 mit besserem Resolver<br />

Rubygems, das Paketsystem<br />

für die Programmiersprache<br />

Ruby, ist in Version 2.1.1 mit<br />

neuen Features verfügbar.<br />

Tatsächlich brachte bereits<br />

Version 2.1.0 die <strong>Neu</strong>erungen<br />

mit, doch wurde die 2.1.1<br />

noch rasch als Bugfix hinterhergeschoben.<br />

Der behebt die<br />

Sicherheitslücke CVE-2013-<br />

4287, die Angreifern eine<br />

Denial-of-Service-Attacke mit<br />

speziell präparierten Gems<br />

ermöglichte.<br />

Daneben erhielt Rubygems einen<br />

neuen Resolver, der dem<br />

im Bundler ähnelt. Er kann<br />

Abhängigkeiten auflösen, bei<br />

denen sein Vorgänger versagte,<br />

und gibt zudem aussagekräftigere<br />

Meldungen aus.<br />

Hinzu kommen Verbesserungen<br />

beim Bau von Gems für<br />

die ARM-Plattformen.<br />

Weitere Details finden sich in<br />

der Release-Mitteilung [http://<br />

blog.rubygems.org]. Zur Aktualisierung<br />

von Rubygems reicht<br />

meist der Befehl »gem update<br />

‐‐system« aus. Der MIT-lizenzierte<br />

Quellcode des Projekts<br />

steht auf Github bereit. n<br />

Gnome-Desktop in Version 3.10 veröffentlicht<br />

Nachdem bereits mehrere<br />

Komponenten erschienen<br />

waren, kündigte Entwickler<br />

Matthias Clasen am 25. September<br />

die fertige Version 3.10<br />

des Gnome-Desktops an. Zu<br />

den neuen Features gehören<br />

ein Application Picker in der<br />

Aktivitätenansicht, ein neu<br />

designter Systemstatus-Bereich,<br />

Unterstützung für Monitore<br />

mit höherer DPI-Zahl,<br />

die Flickr-Integration in der<br />

Fotoanwendung sowie neue<br />

Anwendungen für Musik,<br />

Kartenmaterial und Notizen.<br />

Auch erwähnenswert ist der<br />

Support für den neuen Displaymanager<br />

Wayland.<br />

Die Ankündigungswebseite<br />

[http://www.gnome.org/gnome‐3/]<br />

zählt neben der Aktivitätenansicht,<br />

die Suchfunktion,<br />

ein ausgefeiltes, bei Bedarf<br />

abschaltbares Benachrichtigungssystem<br />

sowie die gute<br />

Integration mit Onlinediensten<br />

zu den Vorteilen von<br />

Gnome 3.10. Laut Angaben<br />

auf der Downloadseite lässt<br />

sich Gnome in den nächsten<br />

Ausgaben von Fedora, Open<br />

Gnome 3.10 ist da und bringt unter anderem eine überarbeitete Aktivitätenansicht mit.<br />

Suse und Ubuntu installieren,<br />

doch auch andere Distributionen<br />

wie Arch <strong>Linux</strong> und<br />

Debian haben den Desktop im<br />

Gepäck. <br />

n<br />

Quelle: http://www.gnome.org/gnome-3/<br />

Coverity: Python-Code ist exzellent<br />

Party-Tier: GNU feiert 30. Geburtstag<br />

Eine Analyse des Quelltext-<br />

Spezialisten Coverity stellt<br />

der Standardimplementierung<br />

von Python ein hervorragendes<br />

Qualitätszeugnis aus.<br />

Nur 0,005 Fehler in 1000 Zeilen<br />

Code weise die Software<br />

des Python-Projekts auf, so<br />

schreibt das Unternehmen.<br />

Zum Vergleich: In der Software-Industrie<br />

insgesamt liegt<br />

der Durchschnitt ungefähr bei<br />

1,0, in der Open-Source-Welt<br />

bei 0,69 Prozent.<br />

Python hält die hohe Qualität<br />

seit dem Jahr 2006. Coveritys<br />

Scan hat bisher insgesamt<br />

rund 400 000 Zeilen Python-<br />

Code analysiert und dabei 996<br />

Defekte gefunden, von denen<br />

die Python-Community bereits<br />

860 behoben hat. n<br />

Am 27. September 1983 hatte<br />

Richard M. Stallman aus Ärger<br />

über proprietäre Software<br />

(konkret ging es wohl um einen<br />

Druckertreiber) seine Pläne,<br />

eine Free Software Foundation<br />

zu gründen, öffentlich<br />

gemacht. Daraus entstanden<br />

GNU, GPL und weite Teile der<br />

Freie-Software-Bewegung, die<br />

auch <strong>Linux</strong> (oder wie Stallman<br />

insistiert „GNU/<strong>Linux</strong>“)<br />

prägten.<br />

Im Rahmen der „30 Days of<br />

GNU“ im September hatte das<br />

Projekt seinen Fans jeden Tag<br />

eine andere sinnvolle Aktion<br />

rund um Freie Software vorgeschlagen.<br />

Abgeschlossen wurde<br />

die Party am Wochenende<br />

mit der offiziellen Feier am<br />

MIT und einem Hackathon.n

Rust in Version 0.8 erschienen<br />

Rust, Mozillas keinesfalls<br />

eingerostete hauseigene Programmiersprache<br />

[http://rustlang.org],<br />

hat Ende September<br />

Version 0.8 erreicht. Die Entwickler<br />

feilen aktuell an der<br />

Standardbibliothek.<br />

Für Version 0.8 wurde die<br />

Loop-Syntax für das »For«-<br />

Keyword geändert, sodass es<br />

nun mit der »Iterator«-Eigenschaft<br />

funktioniert. Die Standardbibliothek<br />

verwendet eine<br />

neue Rust-Runtime und ein<br />

dazu passendes und noch experimentelles<br />

I/O-Subsystem<br />

namens »rt::io«. Eine Familie<br />

von »Format«-Makros für<br />

Strings soll künftig eventuell<br />

»fmt« ersetzen. Außerdem ist<br />

»Copy« kein Keyword mehr,<br />

sondern wird in der neuen<br />

Version durch die Eigenschaft<br />

»Clone« ersetzt.<br />

Alle Tools verfügen nun<br />

über Manpages, die Variable<br />

»RUST_TEST_TASKS« steuert<br />

die Zahl der parallel laufenden<br />

Test-Tasks. Es gibt noch<br />

Dutzende weiterer Änderungen,<br />

die das Mailinglisten-<br />

Anouncement in aller Ausführlichkeit<br />

auflistet.<br />

Rust befindet sich noch in<br />

lebhafter Entwicklung, daher<br />

können sich Komponenten,<br />

Module oder Eigenschaften<br />

noch permanent ändern. Mit<br />

Hilfe der Programmiersprache<br />

sollen Entwickler nach<br />

Vorstellung von Mozilla in<br />

Zukunft größere Client- und<br />

Serveranwendungen entwickeln,<br />

die über das Internet<br />

benutzbar sind. Daher liege<br />

der Fokus laut Projekt auf<br />

Sicherheit, Performance und<br />

Nebenläufigkeit. n<br />

Open Suse sucht Gastgeber für OSC 15<br />

„Wenn man Spaß hat, dann<br />

verfliegt die Zeit“, damit begann<br />

Open-Suse-Board-Member<br />

Robert Schweikert seine<br />

Mail mit dem Betreff „oSC15<br />

Location“.<br />

Obwohl die Susecon [http://<br />

www.susecon.com/] in Florida<br />

Ende November erst noch ansteht<br />

und die Entwickler die<br />

OSC 13 in Thessaloniki gerade<br />

erst hinter sich gebracht<br />

haben, sei es laut Schweikert<br />

an der Zeit, einen Gastgeber<br />

für die Open Suse Conference<br />

2015 zu suchen und auszuwählen.<br />

Im April 2014 werde die Community-Veranstaltung<br />

der<br />

Suse-Welt im kroatischen Dubrovnik<br />

stattfinden, und dort<br />

solle mindestens ein Mitglied<br />

der 2015er Veranstaltung anwesend<br />

sein, um die nächste<br />

Location zu (re)präsentieren.<br />

Wer glaubt, seine Stadt sei<br />

dafür perfekt geeignet, der<br />

könne eine Mail an [opensuse<br />

-project@opensuse.org] oder<br />

[board@opensuse.org] schicken.<br />

Das solle aber idealerweise<br />

erst dann passieren, nachdem<br />

sich der Bewerber durch die<br />

To-do-Listen im Wiki gearbeitet<br />

und die Voraussetzungen<br />

geprüft hat.<br />

Die Veranstaltung soll im<br />

März, April oder Mai 2015<br />

stattfinden, etwa ein Jahr<br />

nach der OSC 14. Erforderlich<br />

seien etwa öffentlicher Nahverkehr,<br />

genügend Unterkünfte<br />

und ein wenig Erfahrung<br />

seitens der Organisatoren im<br />

Umgang mit Konferenzen,<br />

schreibt Schweikert. n

Aktuell<br />

www.linux-magazin.de News 12/2013<br />

10<br />

Kurznachrichten<br />

VLC 2.1.0: Der freie Videolan Client (VLC) ist ein multifunktionaler Mediaplayer.<br />

<strong>Neu</strong>: Die Entwickler haben das Audiosystem des Players komplett<br />

überarbeitet, das nun korrekt die Multi-Channel-Layouts 5.1, 6.1 und 7.1<br />

wiedergibt. Die Open-GL-Ausgabe wurde für Embedded- und Mobilsysteme<br />

nach Open GL ES portiert. VLC 2.1.0 beherrscht Hardwaredecoding für<br />

<strong>Linux</strong> mit VDPAU, für Android via Media-Codec. Lizenz: GPLv2, LGPLv2.1+<br />

[https://videolan.org]<br />

Juju GUI 0.10.0: Grafische Oberfläche für Juju, Canonicals Tool zur Service-Orchestrierung.<br />

<strong>Neu</strong>: Der neue Service Inspector erlaubt es, die<br />

Detailinformationen zu den Diensten sowie die erstellten Units im Auge<br />

zu behalten, ohne den Blick auf die Gesamtstruktur an Diensten zu verlieren.<br />

Änderungen an Diensten und Units zeigt der Inspector sofort an und<br />

weist auf potenzielle Konflikte hin, wenn der Admin einen Wert ändert,<br />

der mit einer Hardwarekonfiguration kollidiert. Lizenz: GPLv3 [https://<br />

jujucharms.com]<br />

Nuxis 2.0: Freie Lösung für das Virtualisierungsmanagement. <strong>Neu</strong>: Der<br />

Kernel von Nuxis 2.0 trägt nun die Versionsnummer 3.4.61, Xen die 4.2.3<br />

und Libvirt die 0.10.2.6. Nuxis kann die Größe physischer Volumes ändern,<br />

schlägt Alarm, wenn einem Snapshot kein freier Platz mehr zur Verfügung<br />

steht, und kann nun I-SCSI Storage konfigurieren. Die Website listet zudem<br />

eine Reihe von Bugfixes auf. Lizenz: GPLv2 [http://www.nuxis.com]<br />

Pycharm 3.0: Plattformübergreifende Python-IDE der Firma Jetbrains.<br />

<strong>Neu</strong>: Die freie Community Edition bringt nun ein vollständiges, eingebettetes<br />

Terminal mit. <strong>Neu</strong>e Refactoring-Tools sollen dabei helfen, den<br />

Code zu verwalten und zu optimieren, zugleich hat man die Code-Analyse<br />

verbessert, sodass Pycharm Fehler und merkwürdigen Code einfacher<br />

findet. Die Vervollständigung arbeitet nun intelligenter, ein Variablen-<br />

Inspektor lässt den Entwickler die Inhalte von Variablen besser tracken.<br />

Lizenz: Apache-2.0-Lizenz (Community Edition) [http://www.jetbrains.<br />

com/pycharm/]<br />

Rethinkdb 1.10: Rethinkdb ist eine noch junge No-SQL-Datenbank mit einer<br />

einfachen Query Language (ReQL) und Support für Joins, die Map Reduce<br />

für Abfragen verwendet. <strong>Neu</strong>: Die neue Multi-Indexierungsfunktion ermöglicht<br />

es, mehrere Indexwerte für ein Dokument anzulegen, was ganze<br />

Klassen von Querys beschleunigen soll. Für kleine Integerwerte verwendet<br />

Rethinkdb nun ein Integer-Encoding in Variablenlänge und nicht mehr<br />

Double Precision, was die Performance von Dateisystem- und Netzwerkbezogenen<br />

Arbeitsgängen beschleunigt. Dank dieser und anderer kleiner<br />

Änderungen sollen die erzeugten Json-Dokumente 30 Prozent weniger<br />

Plattenplatz belegen. Nicht zuletzt wurde die Skalierbarkeit von Rethinkdb<br />

auf Servern mit vielen Kernen optimiert. Lizenz: AGPLv3.0 (Server),<br />

Apache-2.0-Lizenz (Clients) [http://rethinkdb.com]<br />

Open-Source-Mining im Asteroidengürtel<br />

Die amerikanische Firma<br />

Pla netary Resources [http://<br />

planetaryresources.com] möchte<br />

mit Hilfe von Low-Cost-<br />

Raumschiffen, <strong>Linux</strong> und viel<br />

Open-Source-Software Himmelskörper<br />

im Sonnensystem<br />

nach Rohstoffen durchforsten<br />

und diese abbauen.<br />

Was stark nach Science-Fiction<br />

klingt, soll schon bald<br />

Realität werden: Marc Allen<br />

und Ray Ramadorai, beide arbeiten<br />

als Ingenieure in der<br />

Firma, stellten auf der <strong>Linux</strong>con<br />

ihr Konzept vor.<br />

Unter dem Namen „Building<br />

the Deep Space Data Center –<br />

How <strong>Linux</strong> and Open Source<br />

Technologies are Enabling Asteroid<br />

Mining“ berichteten die<br />

beiden Wissenschaftler über<br />

die fortlaufenden Entwicklungen.<br />

Hinter der Firma stecken<br />

prominente Investoren und<br />

Supporter wie Peter Diamandis<br />

(Xprize), Chris Lewicki<br />

(Nasa), Richard Branson (Virgin<br />

Galactic), Eric Schmidt<br />

und Larry Page (beide Google)<br />

sowie James Cameron (Regisseur<br />

und Abenteurer).<br />

Die Hardware der Sonden setzt<br />

auf kostengünstige Atom-<br />

CPUs und soll dank <strong>Linux</strong><br />

deutlich weniger kosten als die<br />

20 000-Dollar-Rechner heutiger<br />

Standard-Raumfahrzeuge.<br />

Preisgünstige Virtualisierung<br />

erhöhe dabei Sicherheit und<br />

Fehlertoleranz, erklärten die<br />

beiden Techniker. Bereits Anfang<br />

2013 hatte Planetary Resources<br />

für Aufsehen gesorgt,<br />

als das Unternehmen innerhalb<br />

weniger Monate mit einer<br />

Crowdfunding-Kampagne<br />

1,5 Millionen Dollar für das<br />

erste Open-Source-Weltraumteleskop<br />

Arkyd einsammelte,<br />

das sich gegenwärtig in der<br />

Entwicklung befindet. n<br />

Gstreamer 1.2 verbessert Live-Streaming-Support<br />

Mit Version 1.2 erscheint<br />

wieder eine stabile Ausgabe<br />

des Multimedia-Frameworks<br />

Gstreamer [http://gstreamer.<br />

freedesktop.org/]. Sie bringt einige<br />

neue Plugins, die unter<br />

anderem das Strea ming verbessern:<br />

»mssdemux« kümmert<br />

sich um die Smooth-<br />

Streaming-Technologie von<br />

Microsoft, »dashdemux« um<br />

DASH (Dynamic Adaptive<br />

Streaming over HTTP), den<br />

als ISO/IEC 23009-1:2012 veröffentlichten<br />

Mpeg-Standard<br />

für dynamisches, adaptives<br />

Streaming.<br />

Das Plugin »bluez« hilft bei<br />

der Interaktion mit Bluetooth-<br />

Geräten, »openjpeg« dekodiert<br />

und enkodiert Jpeg 2000.<br />

Auch Plugins für eine eher<br />

experimentelle Unterstützung<br />

von Daala (»daala«), VP9<br />

(»vpx«) und Webp (»webp«)<br />

sind an Bord.<br />

Die Änderungen am API betreffen<br />

das Teilen von Kontexten<br />

(»GstContext«), den Texturen-Upload,<br />

das Stream-Start-<br />

Event und das »GstMemory«-<br />

Flag für angrenzenden und<br />

nicht mapbaren Speicher. Zu<br />

den Basis-Plugins gesellt sich<br />

»gst‐play‐1.0«, das es erlaubt,<br />

Inhalte testweise auf der Kommandozeile<br />

abzuspielen.<br />

Weitere Details zu den einzelnen<br />

Komponenten und<br />

Download möglichkeiten liefern<br />

die Links in dem Blogeintrag,<br />

der die neue Version<br />

vorstellt. (kki/mfe/mhu/Tim<br />

Schürmann)<br />

n

Aktuell<br />

www.linux-magazin.de Zahlen & Trends 12/2013<br />

12<br />

Zahlen & Trends<br />

Unter Dampf: Steam bekommt OS, Hardware und Controller<br />

Drei wichtige Ankündigungen<br />

in Folge versprach Valve,<br />

Hersteller der Spieleplattform<br />

Steam, für die letzte Septemberwoche<br />

– und lieferte. Das<br />

Unternehmen kündigte ein<br />

eigenes <strong>Linux</strong>-OS an, das auf<br />

so genannten Steam Machines<br />

läuft und dessen Spiele sich<br />

über den Steam Controller<br />

steuern lassen.<br />

Mit den Steam Machines will<br />

Valve 2014 nicht nur eine,<br />

sondern gleich mehrere Rechner<br />

auf den Markt bringen,<br />

auf denen dann die hauseigene<br />

<strong>Linux</strong>-Variante Steam<br />

OS arbeiten soll. Zunächst<br />

will man aber einen Prototyp<br />

entwickeln, der sich an den<br />

großen TV-Screen im Wohnzimmer<br />

hängen lässt.<br />

Testen will der Hersteller die<br />

Prototypen im eigenen Haus,<br />

aber auch in Kooperation<br />

mit den Usern: Erfüllen sie<br />

bestimmte Bedingungen, erhalten<br />

300 Nutzer vorab kostenlose<br />

Exemplare der Steam<br />

Machine. Das Testsystem will<br />

Beeindruckend und angeblich recht gut bedienbar: Der Steam Controller.<br />

Quelle: store.steampowered.com<br />

man für Steam OS optimieren.<br />

Die User sollen die Kontrolle<br />

über die Hardware erhalten<br />

und sie erweitern dürfen – ein<br />

Seitenhieb gegen die geschlossenen<br />

Modelle der Konkurrenz<br />

von Sony, Nintendo und<br />

Microsoft. Der Besitzer darf<br />

die Hardware auch austauschen,<br />

eigene Software installieren<br />

und das System hacken.<br />

Nach den Vorstellungen von<br />

Valve sollen die verschiedenen<br />

Steam-Machine-Varianten<br />

durch die Hersteller auf<br />

Größe, Preis, Geräuscharmut<br />

und andere Faktoren hin optimiert<br />

werden.<br />

Zu den Eingabegeräten äußerte<br />

sich Valve gegen Ende<br />

der „Verkündungswoche“<br />

ebenfalls: Zwar kann der<br />

Spieler Maus und Tastatur<br />

anschließen, doch im Fokus<br />

der Entwickler steht der neue<br />

Steam Controller. Recht markant<br />

sind der mittig eingebaute<br />

Bildschirm sowie die<br />

mit den Daumen bedienbaren<br />

Touchpads rechts und links.<br />

Von der Steuerung profitieren<br />

würden laut Valve unter anderem<br />

First Person Shooter,<br />

weil der Benutzer damit sehr<br />

genau zielen könne.<br />

Um das so wichtige Spielesortiment<br />

macht sich Valve<br />

keine Sorgen: Die Firma habe<br />

bereits Hunderte der 3000<br />

verfügbaren Spiele auf <strong>Linux</strong><br />

portiert, reine Windows- und<br />

Mac-Spiele wolle sie per Netzwerk-Streaming<br />

zur Verfügung<br />

stellen. Bis 2014 sollen zudem<br />

laut Valve weitere AAA-Titel,<br />

also besonders große und beliebte<br />

Spiele, auf Steam OS<br />

lauffähig sein.<br />

n<br />

Schweizer Open-Data-Portal startet Pilotbetrieb<br />

Das Open-Data-Portal der<br />

Schweizer Bundesverwaltung<br />

hat Mitte September seinen<br />

sechsmonatigen Pilotbetrieb<br />

aufgenommen. Unter [http://<br />

opendata.admin.ch] stehen Daten<br />

von Bundesarchiv, Nationalbibliothek<br />

und zahlreichen<br />

Schweizer Bundesbehörden<br />

zum Abruf sowie zur Nutzung<br />

bereit. Das Besondere daran:<br />

Bei der Lizenzierung des Materials<br />

kommen freie Lizenzen<br />

zum Einsatz, beispielsweise<br />

steht sehr viel unter der Creative<br />

Commons 0 (CC0). Die<br />

Formate sind allerdings noch<br />

nicht alle offen, den Löwenanteil<br />

der Dateien machen<br />

derzeit ironischerweise Excel-<br />

Sheets aus.<br />

Dennoch: Die parlamentarische<br />

Gruppe „Digitale Nachhaltigkeit“<br />

begrüßte den Start.<br />

Sie setzt sich seit Jahren für<br />

die Open-Data-Bewegung in<br />

der Eidgenossenschaft ein.<br />

Zur gleichen Zeit, vom 16.<br />

bis zum 18. September, tagte<br />

in Genf die Open Knowledge<br />

Conference (OKCon), die<br />

das Thema Open Data zum<br />

Leitmotiv machte. Die dort<br />

aufgenommenen Livestreams<br />

lassen sich nun unter [http://<br />

okcon.org] betrachten. n

Qt-Projekt verabschiedet sich von Webkit<br />

Das Toolkit Qt wird als Browserengine<br />

künftig Blink verwenden,<br />

den Webkit-Fork aus<br />

dem Chromium-Projekt. Das<br />

teilte der Qt-Entwickler Lars<br />

Knoll in dem Blog [http://blog.<br />

qt.digia.com] mit. In dem Beitrag<br />

geht er ausführlich auf<br />

die Gründe ein, aus denen<br />

sich das Projekt für Blink und<br />

gegen Apples Webkit als künftige<br />

Qt-Webengine entschieden<br />

hat.<br />

Chromium sei als Cross-Plattform-Software<br />

auf allen Desktop-Betriebssystemen<br />

sowie<br />

auf Android verfügbar, ähnlich<br />

wie Qt. Auf Apples Webkit<br />

treffe das hingegen nicht<br />

mehr zu. Zudem enthalte<br />

Blink bereits Features wie<br />

Web-RTC, die Qt ohne Mehraufwand<br />

übernehmen könne.<br />

Diese beiden Punkte ersparten<br />

dem Qt-Projekt Arbeitszeit,<br />

die es einem benutzerfreundlichen<br />

API und einer<br />

nahtlosen Qt-Integration widmen<br />

könne. Hinzu käme die<br />

gute Qualitätssicherung für<br />

den Browser Chromium, der<br />

insgesamt die progressivste<br />

Entwicklung aufweise.<br />

Knoll räumte jedoch ein, dass<br />

Chromiums Sicherheitskonzept<br />

mit getrennten Prozessen<br />

für einzelne Browsertabs eine<br />

Änderung des Qt-Webkit-API<br />

und des QObject-Embedding<br />

erforderlich mache. Zugleich<br />

beruhigte er aber bisherige<br />

Qt-Webkit-Benutzer: Das Projekt<br />

werde sich bemühen, den<br />

Umstieg auf die neue Webengine<br />

möglichst problemlos<br />

zu gestalten.<br />

Im ersten Schritt soll Qt Webkit<br />

keine neuen Features mehr<br />

erhalten. Die Entwickler werden<br />

sich nach der Release von<br />

Qt 5.2 im Herbst 2013 stattdessen<br />

auf die neue Blink-<br />

Webengine konzentrieren. Sie<br />

soll als Technology Preview<br />

bereits zusammen mit der 5.2<br />

verfügbar sein, eine stabile<br />

Release werde mit Qt 5.3 im<br />

Frühjahr 2014 folgen. n<br />

Q2 2014: Red Hat wächst zweistellig<br />

Einmal mehr gab es die neuen<br />

Quartalszahlen der <strong>Linux</strong>-<br />

Firma aus Raleigh, und die<br />

sehen nach wie vor gut aus.<br />

Das Quartal endete für die<br />

US-amerikanische Firma am<br />

31. August 2013. Der Umsatz<br />

betrug in diesem Zeitraum<br />

374 Millionen US-Dollar, 16<br />

Prozent mehr als im Vorjahresquartal.<br />

Davon entfielen<br />

327 Millionen auf Software-<br />

Subskriptionen, 17 Prozent<br />

mehr als im Vorjahreszeitraum.<br />

Der Nettogewinn betrug<br />

41 Millionen US-Dollar,<br />

verglichen mit 35 Millionen<br />

im Vorjahresquartal.<br />

Charlie Peters, Executive Vice<br />

President und Chief Financial<br />

Officer, zeigte sich wenig<br />

überraschend mächtig stolz<br />

auf die zweistelligen Wachstumsraten<br />

und das starke<br />

Subskriptionsgeschäft. Der<br />

Red-Hat-CEO Jim Whitehurst<br />

erklärte die guten Zahlen damit,<br />

dass sein Unternehmen<br />

den Kunden überzeugende<br />

Produkte für den Einstieg ins<br />

Cloud Computing biete. Wer<br />

sich für weitere Detailinformationen<br />

zu den Finanzen<br />

des <strong>Linux</strong>-Distributors interessiert,<br />

wird unter [http://<br />

investors.redhat.com] fündig. n

Aktuell<br />

www.linux-magazin.de Zahlen & Trends 12/2013<br />

14<br />

Red Hat will Docker integrieren<br />

Der <strong>Linux</strong>-Spezialist Red<br />

Hat möchte mit Dot Cloud,<br />

dem Anbieter der Container-<br />

Lösung Docker [https://www.<br />

docker.io], kooperieren, um<br />

seine PaaS-Lösung Open Shift<br />

zu erweitern. Bereits ab Version<br />

0.7 wollen die Docker-<br />

Fabrikanten Pakete für Fedora<br />

bereitstellen.<br />

Das wichtigste Ziel bestünde<br />

darin, dass Docker reibungslos<br />

mit Fedora und Red Hat<br />

Enterprise <strong>Linux</strong> zusammenarbeite,<br />

schreibt Ben Golub,<br />

Dot Clouds CEO. Vor diesem<br />

Schritt sei eine Reihe technischer<br />

Herausforderungen zu<br />

meistern. Dazu gehöre die Ablösung<br />

des Dateisystems Aufs,<br />

die Dot Cloud erreichen will,<br />

indem Docker zum Thin-Provisioning-Ansatz<br />

von Fedora<br />

wechselt, den der Device Mapper<br />

seit Kernel 3.2 unterstützt.<br />

Das sei zugleich kompatibler<br />

zu den Upstream-Kernelversionen.<br />

Zudem wolle man Libvirt<br />

für das Bereitstellen der<br />

Container einsetzen, deren<br />

Netzwerkfähigkeiten Docker<br />

nutzen könne.<br />

Daneben soll Docker weitere<br />

PaaS-Lösungen unterstützen,<br />

um eine größere Verbreitung<br />

zu finden, Projekte wie Deis,<br />

Flynn und Voxoz verwenden<br />

es bereits. Dank der Integration<br />

in Red Hats Open Shift<br />

könnten beide Technologien<br />

künftig reibungslos zusammenarbeiten,<br />

zudem soll<br />

Docker Teil von Open Shifts<br />

Cartridge-Modell werden. n<br />

Crowdfunding für Synfig Studio<br />

Jüngstes Beispiel für ein<br />

Open-Source-Projekt, das sich<br />

erfolgreich Mittel per Crowdfunding<br />

beschafft, ist Synfig<br />

Studio [http://www.synfig.org].<br />

Die freie 2-D-Animationssoftware<br />

will bei den Unterstützern<br />

Geld einsammeln, diese<br />

dürfen im Gegenzug bei der<br />

Entwicklung mitreden.<br />

Nachdem Synfig Studio im<br />

Mai 2013 bereits eine bedingungslose<br />

Spende über 5000<br />

US-Dollar von der Shuttleworth<br />

Foundation erhalten<br />

hatte, arbeitet Entwickler<br />

Ivan Mahonin seit August in<br />

Vollzeit an der Software. Mit<br />

dem 1. November muss sich<br />

das Projekt allerdings nach<br />

neuen Finanzierungsquellen<br />

umschauen.<br />

Deswegen startete Mitte September<br />

auf Indiegogo eine<br />

bescheidene Finanzierungskampagne<br />

für den Oktober,<br />

über welche die User von<br />

Synfig Studio das Implementieren<br />

bestimmter Features<br />

sponsern. Auf Unterstützer<br />

warten verschiedene Prämien:<br />

Wer etwa 300 US-Dollar zahlt,<br />

kann bestimmen, welches<br />

Projekt im nächsten Monat<br />

Priorität erhält.<br />

Für den Oktober war ein Betrag<br />

von 500 US-Dollar angestrebt,<br />

am Ende kam mehr<br />

zusammen (857 US-Dollar).<br />

Finanziert wird die Arbeit an<br />

einer Single-Window-Oberfläche.<br />

Langfristig will man so<br />

einen Entwickler auf Monatsbasis<br />

finanzieren. n<br />

NSA und GCHQ: „Tor stinkt!“<br />

Gute Nachrichten für das Tor-<br />

Projekt: Von der NSA und<br />

vom britischen Geheimdienst<br />

GCHQ tauchten nun Unterlagen<br />

mit dem Titel „Tor<br />

stinks“ auf, die im Rahmen<br />

eines gemeinsamen Anti-Tor-<br />

Workshop entstanden sind.<br />

Die Folien stammen aus den<br />

Veröffentlichungen des ehemaligen<br />

Geheimdienst-Mitarbeiters<br />

Edward Snowden, der<br />

„Guardian“ hatte sie herausgegeben.<br />

Darin schreiben NSA und<br />

GCHQ: „Wir werden niemals<br />

in der Lage sein, alle Tor-Nutzer<br />

zu jeder Zeit zu enttarnen.“<br />

Und: „Mit Hilfe manueller<br />

Analysen können wir eine<br />

sehr kleine Minderheit von<br />

Tor-Nutzern deanonymisieren,<br />

aber wir werden keinen Erfolg<br />

damit haben, Nutzer auf Anfrage<br />

hin zu enttarnen.“<br />

Das hört auch das Tor-Projekt<br />

gern, das in letzter Zeit oft<br />

der Kooperation verdächtigt<br />

wurde, weil seine Arbeit unter<br />

anderem von Regierungsbehörden<br />

finanziert wird.<br />

Aktuell könne man nur sehr<br />

wenige Nodes überwachen,<br />

heißt es in dem Geheimdienstpapier.<br />

Die Erfolgsrate sei vernachlässigbar,<br />

weil es fast unmöglich<br />

sei, die drei Nodes zu<br />

erwischen, die einen Circuit<br />

ausmachen.<br />

Das mysteriöse Quick-Ant besteht<br />

offenbar darin, mit Hilfe<br />

der kontrollierten Tor-Nodes<br />

nach Benutzern zu suchen,<br />

die zur Tatzeit aus einem<br />

bestimmten Land Anfragen<br />

stellen – eine Suche nach der<br />

Nadel im Heuhaufen.<br />

In völliger Anonymität können<br />

sich Tor-Nutzer dennoch<br />

nicht wähnen, denn die NSA<br />

führt in dem Dokument verschiedene<br />

alternative Angriffswege<br />

auf. Neben der<br />

Dummheit der User betrachten<br />

die Geheimdienste auch<br />

Cookie- und DNS-Attacken<br />

als wirkungsvoll. Hauptangriffsfläche<br />

bieten daher<br />

weiterhin die Browser und<br />

Betriebssysteme der Nutzer.<br />

Davor aber warnen auch die<br />

Tor-Entwickler immer wieder.<br />

Das Tor-Browser-Bundle soll<br />

diese Angriffsfläche möglichst<br />

klein halten.<br />

Trotz Government-Shutdown<br />

äußerte sich später James R.<br />

Clapper, Chef der amerikanischen<br />

Geheimdienste, zu den<br />

Dokumenten. Auch wenn er<br />

nur von „Online Communication<br />

Tools and Technologies“<br />

sprach, zielte sein Statement<br />

wohl auch auf das Ausspionieren<br />

von Tor-Nutzern.<br />

Darin verteidigte Clapper naturgemäß<br />

das Vorgehen der<br />

NSA und sieht keine Fehler<br />

auf Seiten des Geheimdienstes:<br />

„Die Realität ist, dass<br />

die Männer und Frauen der<br />

NSA und in der gesamten<br />

Intelligence-Community die<br />

Gesetze beachten, die Bürgerrechte<br />

respektieren und alles<br />

tun, um dabei zu helfen, die<br />

Sicherheit unserer Nation zu<br />

bewahren.“<br />

Clapper hatte zuletzt einige<br />

Bekanntheit erlangt, als er vor<br />

einem Kongressausschuss verneinte,<br />

dass die NSA Telefondaten<br />

amerikanischer Bürger<br />

sammle. Als er seine Aussage<br />

später aufgrund der Aktenlage<br />

widerrufen musste, begründete<br />

er seine Falschaussage<br />

damit, die „am wenigsten unwahre“<br />

Antwort gewählt zu<br />

haben.<br />

n

Kernel-Statistik 2013<br />

Zum Auftakt der amerikanischen<br />

<strong>Linux</strong>con in New Orleans<br />

hat die <strong>Linux</strong> Foundation<br />

ihre regelmäßige Statistik<br />

dazu veröffentlicht, welche<br />

Entwickler und Firmen Code<br />

zu <strong>Linux</strong> beitragen. Der Report<br />

umfasst die Zeitspanne<br />

von April 2012 bis Juli 2013<br />

mit den Kernelversionen 3.3<br />

bis 3.10. Letztere habe die<br />

größte Zahl an Entwicklern in<br />

der Geschichte des Berichts<br />

zu verzeichnen, meldet das<br />

Industriekonsortium.<br />

Daneben zeige der steigende<br />

<strong>Linux</strong>-Einsatz auf Mobil- und<br />

Embedded-Plattformen Auswirkungen:<br />

Der gemeinsame<br />

Anteil der Embedded-Firmen<br />

Linaro, Samsung und Texas<br />

Instruments ist von 4,4 auf<br />

11 Prozent gestiegen, auch<br />

Google hat mehr Code beigesteuert.<br />

Die zehn Top-Code-<br />

Kontributoren unter den<br />

Unternehmen sind laut dem<br />

jüngsten Bericht Red Hat, Intel,<br />

Texas Instruments, Linaro,<br />

Suse, IBM, Samsung, Google,<br />

Vision Engraving Systems<br />

Consultants und Wolfson Microelectronics.<br />

Das kurze Gastspiel von<br />

Microsoft im Vorjahr gehört<br />

damit klar der Vergangenheit<br />

an. Der komplette Bericht<br />

steht gegen eine Registrierung<br />

bei der <strong>Linux</strong> Foundation zum<br />

Download bereit. <br />

n<br />

Review für Kryptostandard erneuert<br />

Das National Institute of<br />

Standards and Technology<br />

(NIST) reagierte kürzlich auf<br />

die Vorwürfe, die National<br />

Security Agency (NSA) habe<br />

den Random Number Generator<br />

(RNG) von Dual EC DRBG<br />

manipuliert. Wie die „New<br />

York Times“ im September<br />

berichtete, öffnet die Behörde<br />

als Konsequenz erneut die<br />

Entwürfe für die Standards<br />

800-90A, 800-90B sowie 800-<br />

90C für externe Kommentare.<br />

Sie alle nutzen den kompromittierten<br />

RNG. Mit diesem<br />

Schritt möchte das NIST<br />

verlorenes Vertrauen in die<br />

Sicherheitsstandards zurückgewinnen.<br />

Man würde nicht<br />

mutwillig einen kryptographischen<br />

Standard abschwächen,<br />

heißt es in einem offiziellen<br />

Statement der Behörde<br />

Das NIST arbeitet traditionell<br />

mit Kryptoexperten der NSA<br />

zusammen, um sichere Verschlüsselungsstandards<br />

zu<br />

definieren, auf welche auch<br />

Regierungsbehörden der Vereinigten<br />

Staaten offiziell vertrauen.<br />

Edward Snowdens<br />

Dokumente legen nahe, dass<br />

es der NSA gelungen ist, die<br />

kanadische Delegation aus<br />

dem Standardisierungsprozess<br />

herauszuhalten, den Entwurf<br />

neu zu schreiben und<br />

dadurch zu dessen einzigem<br />

Verfasser zu werden. n<br />

Zahlen & Trends 12/2013<br />

Aktuell<br />

www.linux-magazin.de<br />

15<br />

Anzeige

Aktuell<br />

www.linux-magazin.de Zahlen & Trends 12/2013<br />

16<br />

Secusmart stellt sicheres Smartphone vor<br />

Der Name Edward Snowden<br />

fiel gleich mehrmals in der<br />

Pressekonferenz des Bundesverbandes<br />

IT-Sicherheit e.V.<br />

(Teletrust) und von Secusmart,<br />

die Anfang Oktober in Berlin<br />

stattfand. Kein Wunder, stand<br />

doch in deren Mittelpunkt das<br />

als abhörsicher angepriesene<br />

Handy von Secusmart [http://<br />

www.secusmart.com], das Hans-<br />

Christoph Quelle, CEO der<br />

Firma, vorstellte.<br />

Es handelt sich um ein für die<br />

sichere Sprach- und Datenübertragung<br />

gehärtetes Blackberry<br />

auf Basis des Modells<br />

Z10 mit Touchscreen. Dieses<br />

erhielt kürzlich eine vorläufige<br />

Zulassung des deutschen<br />

BSI (Bundesamt für Sicherheit<br />

in der Informationstechnik)<br />

für die Geheimhaltungsstufe<br />

„Nur für den Dienstgebrauch“<br />

(VS-NfD). Laut Quelle haben<br />

bereits 23 Behörden etwa 1200<br />

der Geräte geordert, deren<br />

Stückpreis Anfang des Jahres<br />

auf 2500 Euro geschätzt<br />

wurde.<br />

Die Tatsache, dass Blackberry,<br />

die gleichnamige Firma hinter<br />

dem Smartphone, in Schwierigkeiten<br />

steckt, scheint den<br />

Bestellungen keinen Abbruch<br />

getan zu haben. Auf den<br />

Smartphones läuft die Secu-<br />

Suite, die zwischen einer sicheren<br />

(geschäftlichen) und<br />

unsicheren (persönlichen)<br />

Zone unterscheidet. Erstere<br />

lässt die Anwender mobile<br />

Daten und Sprache verschlüsselt<br />

nutzen.<br />

Die persönliche Zone gebe<br />

es, um die Nutzer nicht in<br />

ihrem Komfort einzuschränken.<br />

Diese Erkenntnis habe<br />

man aus der Erfahrung mit<br />

früheren Modellen sicherer<br />

Smartphones gewonnen.<br />

2009 sollten die Mitarbeiter<br />

zwei sichere Handys mit sich<br />

herumtragen, eins zum Telefonieren,<br />

eines zum Surfen.<br />

Tatsächlich wurde in der Praxis<br />

häufig aus Bequemlichkeit<br />

ein drittes Handy verwendet,<br />

ein iPhone, weil es den beiden<br />

anderen Modellen schlicht an<br />

Bedienkomfort und Funktionen<br />

mangelte. n<br />

Auf einer Pressekonferenz in Berlin stellte der Secusmart-CEO ein abhörsicheres<br />

Handy auf Blackberry-Basis vor.<br />

APC-Boards<br />

Gema-Alternative C3S nimmt juristische Hürde<br />

Für ihre preiswerten ARM-<br />

Computer arbeitet die Firma<br />

APC an einer angepassten<br />

Version von Mozillas Mobilbetriebssystem<br />

Firefox OS.<br />

Die Entwicklung findet in<br />

einem öffentlichen Github-<br />

Repository statt, interessierte<br />

Entwickler müssen das System<br />

momentan noch aus dem<br />

Quelltext bauen.<br />

Weil die <strong>Vorschau</strong>version<br />

noch Mängel hat, winkt APC<br />

mit Preisen: Wer einen der<br />

vorhandenen Bugs behebt,<br />

die im Issue Tracker mit dem<br />

Label „Free APC“ versehen<br />

sind, erhält einen kostenlosen<br />

APC-Computer. Bei einem<br />

Preis von rund 50 US-Dollar<br />

ist das allerdings ein eher bescheidenes<br />

Honorar. n<br />

Auf ihrer Gründungsversammlung<br />

haben die Aktivisten der<br />

als Gema-Konkurrenz angetretenen<br />

Cultural Commons<br />

Collecting Society (C3S,<br />

[http://www.c3s.cc]) eine Satzung<br />

beschlossen und einen<br />

Verwaltungsrat gewählt.<br />

Das ist jedoch nur die erste<br />

Hürde auf dem Weg zur eigenen<br />

Verwertungsgesellschaft<br />

auf Creative-Commons-Basis:<br />

Als Nächstes muss ein Verband<br />

die Satzung prüfen.<br />

Stimmt dieser zu, kann sich<br />

die C3S als Europäische Genossenschaft<br />

eintragen lassen.<br />

Im Jahr 2015 will sie<br />

schließlich beim Deutschen<br />

Patent- und Markenamt die<br />

Zulassung als Verwertungsgesellschaft<br />

beantragen.<br />

Im Gegensatz zur deutschen<br />

Gema möchte die C3S auch<br />

einzelne Werke von Künstlern<br />

vertreten und ein anderes, faires<br />

und flexibleres Ausschüttungsmodell<br />

anbieten. Dafür<br />

sammelte die Gesellschaft<br />

Spenden über die Crowdfunding-Plattform<br />

Startnext.<br />

Anvisiert waren ursprünglich<br />

200 000 Euro, um Entwickler<br />

zu finanzieren und das Projekt<br />

voranzubringen.<br />

Dank einer Förderungsempfehlung<br />

hätte Nordrhein-<br />

Westfalen noch 200 000 Euro<br />

draufgelegt und das Projekt so<br />

cofinanziert. Bis zum Stichtag,<br />

dem 30. September 2013, kamen<br />

nur 119 000 Euro zusammen.<br />

Die summierten sich mit<br />

den 31 000 Euro Startkapital<br />

und abzüglich der Crowdfunding-Kosten<br />

immerhin noch<br />

auf 130 000 Euro.<br />

Weil aber Nordrhein-Westfalen<br />

sein Angebot kurz vor<br />

dem Funding-Ende bis zum<br />

31. Dezember 2013 verlängert<br />

hat, bleibt nun doch noch etwas<br />

Zeit, die restlichen 70 000<br />

Euro zusammenzukriegen.<br />

Geschäftsführer Wolfgang<br />

Senges ist optimistisch, dass<br />

es klappen kann.<br />

Unter anderem können ab<br />

Oktober Interessenten direkt<br />

über die Webseite Mitglied<br />

der C3S werden und so dabei<br />

helfen, die Finanzierungslücke<br />

zu schließen. Eine erste<br />

Generalversammlung aller<br />

Unterstützer soll dann im<br />

März 2014 stattfinden. n

Open-ZFS-Projekt gestartet<br />

Das Mitte September gegründete<br />

Open-ZFS-Projekt [http://<br />

www.open‐zfs.org] möchte die<br />

Entwickler von ZFS für Illumos,<br />

Free BSD, <strong>Linux</strong> und<br />

OS X unter ein Dach bringen,<br />

um einen freien Nachfolger<br />

für Suns zukunftsweisendes<br />

Dateisystem zu liefern.<br />

Qualität, Dokumentation, Aufmerksamkeit<br />

und Kommunikation:<br />

All dies zu verbessern<br />

hat sich Open ZFS als Ziel gesetzt.<br />

Das Open-Source-Projekt<br />

will nicht nur eine freie<br />

Implementierung des vielseitigen<br />

Dateisystems schaffen,<br />

sondern in der Community<br />

sichtbarer werden, alles besser<br />

dokumentieren, die Einsteigerfreundlichkeit<br />

erhöhen<br />

und das Teilen von Code<br />

vereinfachen. Zudem wollen<br />

die Entwickler und Unterstützerfirmen<br />

die Zuverlässigkeit,<br />

den Funktionsumfang und die<br />

Performance von Open ZFS<br />

verbessern.<br />

ZFS hat auch deshalb viele<br />

Fans, weil es Funktionen vereint,<br />

die weit über normale<br />

Dateisysteme hinausgehen.<br />

Als transaktionales Filesystem<br />

beherrscht es Volume Management,<br />

Verschlüsselung,<br />

transparente Komprimierung<br />

und vieles mehr. Ursprünglich<br />

von Sun für Open Solaris entwickelt,<br />

hatte sich die <strong>Linux</strong>-<br />

Gemeinde schnell um eine<br />

funktionierende <strong>Linux</strong>-Implementierung<br />

von ZFS bemüht.<br />

Das seit 2006 entwickelte Fuse<br />

erzielte mit dem in Open Solaris<br />

frei verfügbaren Code eher<br />

beschauliche Ergebnisse. 2007<br />

portierte Apple ZFS auf OS X,<br />

Free BSD zog 2008 nach.<br />

Im selben Jahr begann die<br />

<strong>Linux</strong>-Gemeinde einen nativen<br />

Port zu entwickeln, doch<br />

2010 schien die Mühe mit<br />

dem Ende von Open Solaris<br />

vergebens. Erst der Open-<br />

Solaris-Nachfolger Illumos<br />

[http://wiki.illumos.org] zeitigte<br />

2013 Erfolge, die in der ersten<br />

stabilen Version von ZFS<br />

on <strong>Linux</strong> [http://zfsonlinux.org]<br />

mündeten.<br />

n<br />

Zahlen & Trends 12/2013<br />

Aktuell<br />

www.linux-magazin.de<br />

17<br />

OSV: <strong>Neu</strong>es Cloud-OS der KVM-Macher<br />

Auf der Cloud-Open-Konferenz<br />

Mitte September in New<br />

Orleans angekündigt, fällt mit<br />

Version 0.01 der Startschuss<br />

für ein neues Cloud-Betriebssystem:<br />

OSV. Dessen Macher<br />

sind prominent, unter ihnen<br />

die KVM-Entwickler Avi Kivity<br />

und Dor Laor von Qumranet.<br />

Ihr Betriebssystem besitzt einen<br />

monolithischen Kernel,<br />

der nicht aus einem abgespeckten<br />

<strong>Linux</strong> oder BSD besteht,<br />

sondern eine Eigenentwicklung<br />

ist. OSV steht unter<br />

der 3-Clause-BSD-Lizenz und<br />

erfordert Programmiersprachen,<br />

die in der Java Virtual<br />

Machine (JVM) laufen, etwa<br />

Clojure, Jruby, Javascript,<br />

Scala oder Rhino. Auch einige<br />

bereits portierte C-Applikationen<br />

sollen laufen.<br />

Pro OSV-Instanz soll dabei<br />

nur ein Application-Server<br />

oder Framework laufen, das<br />

können etwa Cassandra,<br />

Jboss oder Hadoop sein. Den<br />

einzigen Address Space teilen<br />

sich Applikation und Kernel.<br />

Generell will OSV die Duplikation<br />

von Schutzmaßnahmen<br />

auf den verschiedenen Layern<br />

reduzieren. Läuft eine Java<br />

Virtual Machine, erkennt OSV<br />

dies und übergibt die Verwaltung<br />

von Pagetables, Speicher,<br />

Scheduler und I/O an diese,<br />

was die Performance des Systems<br />

deutlich erhöhen soll.<br />

Die JVM ist in den Kernel integriert,<br />

Spezialapplikationen<br />

können den I/O-Stack komplett<br />

umgehen.<br />

OSV läuft bisher auf KVM, Xen<br />

und in Amazons EC2, VMware-<br />

Support ist geplant. Es soll in<br />

der Cloud effizienter arbeiten<br />

als <strong>Linux</strong> und verwendet das<br />

ZFS-Dateisystem. Zudem nutzt<br />

es Huge Pages, den TCP-Stack<br />

von Free BSD und bootet angeblich<br />

in weniger als einer Sekunde.<br />

Optimierungen lassen<br />

sich über eine zentrale Konfigurationsdatei<br />

erledigen. Mehr<br />

Informationen zur Technologie<br />

liefert [http://www.osv.io]. (kki/<br />

mfe/mhu/Tim Schürmann) n

Aktuell<br />

www.linux-magazin.de Kernel-News 12/2013<br />

18<br />

Zacks Kernel-News<br />

H8/300-Architektur am Ende<br />

Günter Roeck schrieb an die<br />

Kernel-Mailingliste: „Die Architektur<br />

H8/300 ist schon<br />

seit Jahren tot. Der zugehörige<br />

Kernel kompiliert schon<br />

ewig nicht mehr, und auch die<br />

neueren GCC-Versionen dafür<br />

sind kaputt. Es ist an der Zeit,<br />

die Unterstützung einzustellen.“<br />

Die ursprünglich von Hitachi<br />

entwickelten 8-Bit- und<br />

16-Bit-Mikrocontroller sind<br />

nun bei Renesas beheimatet<br />

und finden sich in Embedded-<br />

Geräten, zum Beispiel auch in<br />

den ersten programmierbaren<br />

Legosteinen.<br />

Obwohl er ein Patch zum Löschen<br />

aller betroffenen Dateien<br />

eingeschickt hat, räumt<br />

Günter ein, es sei nicht einfach,<br />

eine Architektur aufzugeben:<br />

„Man sollte das zwar<br />

diskutieren, aber jemand<br />

muss den ersten Schritt tun.<br />

Eine praktisch tote Architektur<br />

am Leben zu halten kostet<br />

Ressourcen, die anderswo<br />

besser genutzt wären.“<br />

Greg Kroah-Hartman gibt<br />

dem Patch seinen Segen und<br />

meint: „Wenn sich das nicht<br />

bauen lässt und es keiner<br />

mehr verwendet, sollten wir<br />

es entfernen. Sollte es jemand<br />

wiederbeleben wollen, gibt es<br />

ja »git revert«.“ Joe Perches<br />

Abschied von einer Architektur: In der ersten Generation von Legos Mindstorms-<br />

RCX-Klotz steckte Hitachis H8/300-Prozessor.<br />

Wikipedia/Mairi (CC-BY-SA 3.0)<br />

hat den H8/300-Maintainer<br />

Yoshinori Sato auf Kopie gesetzt,<br />

für den Fall, dass dieser<br />

die Architektur neu beleben<br />

möchte.<br />

Was die Terminplanung angeht,<br />

möchte Günter einen<br />

Zweig in seinem persönlichen<br />

Git-Repository anlegen,<br />

ihn für <strong>Linux</strong>-next einreichen<br />

und dann Linus Torvalds bitten,<br />

diesen im nächsten Merge-Window<br />

einzupflegen, das<br />

heißt für Kernel 3.13. „Damit<br />

haben alle genug Zeit, davon<br />

zu erfahren und sich zu beschweren<br />

oder Ecken zu finden,<br />

an denen etwas fehlt“,<br />

kommentiert Günter.<br />

Geert Uytterhoeven schlägt<br />

allerdings vor, erst auf eine<br />

Reaktion von Yoshinori zu<br />

warten. Dieser plant offenbar<br />

zum Kernel Summit zu kommen,<br />

der im Oktober in Edinburgh<br />

stattfindet. Dort könnten<br />

die Entwickler persönlich<br />

diskutieren, wie es mit der<br />

Architektur weitergeht. n<br />

Was bedeutet »EXPORT_SYMBOLS_GPL«?<br />

Der Gentoo-Entwickler Richard<br />

Yao fragte auf der Mailingliste<br />

nach, warum für LZ4-<br />

Symbole die »EXPORT_SYM-<br />

BOL_GPL« gelte. Der Code<br />

für den Komprimierungsalgorithmus<br />

stehe doch unter<br />

BSD-Lizenz. Ihm antwortete<br />

Matthew Garrett: „»EXPORT_<br />

SYMBOL_GPL« signalisiert,<br />

dass beim Verwenden des<br />

Symbols wahrscheinlich ein<br />

vom <strong>Linux</strong>-Kernel abgeleitetes<br />

Werk entsteht – und der<br />

steht eben unter GPL. Das hat<br />

nichts mit zusätzlichen Lizenzen<br />

zu tun, die für einzelne<br />

Bestandteile gelten.“<br />

Joe Perches verwies auf eine<br />

juristische Erörterung zum<br />

Thema unter [http://www.ifross.<br />

org/en/artikel/ongoing‐dispute‐over<br />

‐value‐exportsymbolgpl‐function].<br />

Der verdiente Entwickler Rob<br />

Landley warnte dagegen vor<br />

juristischen Spekulationen<br />

außerhalb des Gerichtssaals:<br />

Allzu leicht könne man damit<br />

Anti-GPL-Anwälten in die<br />

Hände spielen.<br />

Außerdem merkt Joe an,<br />

Matthews Erläuterung zu<br />

»EXPORT_SYMBOL_GPL« sei<br />

unvollständig, denn sie gebe<br />

nur eine von zwei konkurrierenden<br />

historischen Erklärungen<br />

wieder. Matthew dagegen<br />

findet die Historie eindeutig<br />

und beendet damit die Diskussion.<br />

n

Umbenennen – doppelt und dreifach<br />

Der ungarische Entwickler<br />

Miklos Szeredi hat einen neuen<br />

Systemaufruf vorgeschlagen.<br />

Er heißt »rename2()«<br />

und soll das bestehende »rename()«<br />

ergänzen. Während<br />

»rename()« eine einzelne<br />

Datei umbenennt, nimmt der<br />

neue Aufruf zwei Dateien<br />

und vertauscht deren Namen.<br />

„Das ermöglicht interessante<br />

Dinge, die vorher nicht gingen.<br />

Beispielsweise kann man<br />

nun ein Verzeichnis atomar<br />

durch einen symbolischen<br />

Link ersetzen“, preist er seinen<br />

Code an.<br />

Daneben schreibt Miklos,<br />

»rename2()« könne den so<br />

genannten Whiteout bei stapelbaren<br />

Dateisystemen elegant<br />

lösen, ohne Systemcalls<br />

wie »rmdir« und »mkdir« um<br />

komplizierten Code zu erweitern.<br />

Ein Whiteout kommt<br />

zum Einsatz, wenn jemand in<br />

einem Dateisystemstapel eine<br />

Datei löschen möchte, die eigentlich<br />

auf einem Read-only-<br />

Dateisystem liegt. Er gaukelt<br />

dem Anwender vor, die Datei<br />

sei verschwunden.<br />

Der Brite H. Peter Anvin<br />

spinnt den Gedanken noch<br />

weiter und schlägt Miklos vor,<br />

beim Umbenennen nicht nur<br />

den Namen A mit dem Namen<br />

B zu vertauschen, sondern ein<br />

»rename3()« zu programmieren.<br />

Dies solle A in B umbenennen<br />

und, wenn Datei B<br />

schon existiert, auch B in C.<br />

Damit, so Peter, könne Miklos<br />

gleichzeitig seinen ursprünglichen<br />

Plan umsetzen, denn<br />

»rename(A,B,A)« vertausche<br />

einfach die Namen.<br />

Hier meldete sich Linus<br />

Torvalds und erzählte, Miklos<br />

hätte das dreifache Rename<br />

bereits umgesetzt. Es sei allerdings<br />

äußerst kompliziert<br />

gewesen und hätte nicht zum<br />

Rest des API gepasst. Er bevorzuge<br />

daher die einfachere<br />

Lösung »rename2()«. Linus:<br />

„Ich war erleichtert, als ich<br />

die einfachere, saubere Version<br />

sah. Die Alternative war<br />

wirklich schrecklich.“ n<br />

AMD-Tuning<br />

Der amerikanische Entwickler<br />

Austin Hemmelgarn hat Optimierungen<br />

für einige AMD-<br />

Prozessoren eingeschickt. „Sie<br />

bieten spürbare Verbesserungen<br />

gegenüber der Standardkonfiguration<br />

für K8“, schrieb<br />

er zu seinem Patch. Borislav<br />

Petkov reagierte reserviert:<br />

„Bitte belege die Verbesserungen,<br />

denn der letzte Kandidat<br />

konnte das nicht.“ Aber auch<br />

Austins Zahlen überzeugten<br />

Borislav nicht.<br />

Austins Patch hätte ohnehin<br />

nur sehr wenige Anwender<br />

erreicht, denn <strong>Linux</strong>-Distributionen<br />

liefern ihre Kernel stets<br />

in generischer Konfiguration<br />

aus. (Zack Brown/mhu) n<br />

Kernel-News 12/2013<br />

Aktuell<br />

www.linux-magazin.de<br />

19

Aktuell<br />

www.linux-magazin.de OX Summit 12/2013<br />

20<br />

OX-Summit 2013 in St. Pauli<br />

Volle Kraft voraus<br />

Auf einem Frachtschiff im Hamburger Hafen versammelte die Open Xchange Partner, Entwickler und Kunden<br />

zum OX Summit 2013. Zur Keynote kam PGP-Legende Phil Zimmermann, nachmittags gab es Visionen und Technik,<br />

abends Rockmusik, einen DJ oder eine Party auf der Reeperbahn. Text und Fotos: Markus Feilner<br />

alle E-Mails löschen ließ –<br />

weil er keine Daten in seinem<br />

Unternehmen haben will, die<br />

er nach geltender Rechtslage<br />

herausrücken müsste, die ihm<br />

aber nicht gehören.<br />

Zimmermann hielt sich auch<br />

nicht mit einer typischen Keynote<br />

auf, sondern eröffnete<br />

gleich nach wenigen Sätzen<br />

eine lockere Q&A-Session,<br />

was das Publikum mit vielen<br />

Fragen honorierte.<br />