Un algoritmo per la regressione multipla con dati categoriali

Un algoritmo per la regressione multipla con dati categoriali

Un algoritmo per la regressione multipla con dati categoriali

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

2 P.G. LOVAGLIO<br />

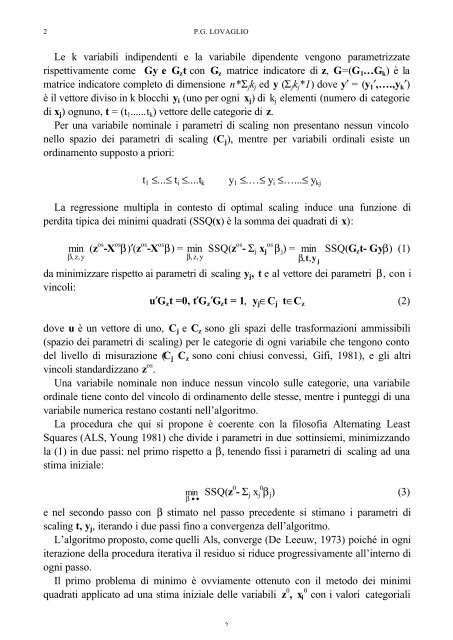

Le k variabili indipendenti e <strong>la</strong> variabile dipendente vengono parametrizzate<br />

rispettivamente come Gy e G z t <strong>con</strong> G z matrice indicatore di z, G=(G 1 …G k ) è <strong>la</strong><br />

matrice indicatore completo di dimensione n*Σ j k j ed y (Σ j k j *1) dove y′ = (y 1 ′,….,y k ′)<br />

è il vettore diviso in k blocchi y i (uno <strong>per</strong> ogni x j ) di k j elementi (numero di categorie<br />

di x j ) ognuno, t = (t 1 ......t k ) vettore delle categorie di z.<br />

Per una variabile nominale i parametri di scaling non presentano nessun vincolo<br />

nello spazio dei parametri di scaling (C j ), mentre <strong>per</strong> variabili ordinali esiste un<br />

ordinamento supposto a priori:<br />

t 1 ≤...≤ t i ≤....t k<br />

y 1 ≤.…≤ y i ≤…...≤ y kj<br />

La <strong>regressione</strong> multip<strong>la</strong> in <strong>con</strong>testo di optimal scaling induce una funzione di<br />

<strong>per</strong>dita tipica dei minimi quadrati (SSQ(x) è <strong>la</strong> somma dei quadrati di x):<br />

min<br />

β,<br />

z, y<br />

(z os -X os b)′(z os -X os b) =<br />

min<br />

β,<br />

z, y<br />

SSQ(z os - Σ j x j<br />

os<br />

b j ) =<br />

min<br />

β,t,y j<br />

SSQ(G z t- Gyb) (1)<br />

da minimizzare rispetto ai parametri di scaling y j , t e al vettore dei parametri b, <strong>con</strong> i<br />

vincoli:<br />

u′G z t =0, t′G z ′G z t = 1, y j ∈C j t∈C z (2)<br />

dove u è un vettore di uno, C j e C z sono gli spazi delle trasformazioni ammissibili<br />

(spazio dei parametri di scaling) <strong>per</strong> le categorie di ogni variabile che tengono <strong>con</strong>to<br />

del livello di misurazione (C j C z sono <strong>con</strong>i chiusi <strong>con</strong>vessi, Gifi, 1981), e gli altri<br />

vincoli standardizzano z os .<br />

<strong>Un</strong>a variabile nominale non induce nessun vincolo sulle categorie, una variabile<br />

ordinale tiene <strong>con</strong>to del vincolo di ordinamento delle stesse, mentre i punteggi di una<br />

variabile numerica restano costanti nell’<strong>algoritmo</strong>.<br />

La procedura che qui si propone è coerente <strong>con</strong> <strong>la</strong> filosofia Alternating Least<br />

Squares (ALS, Young 1981) che divide i parametri in due sottinsiemi, minimizzando<br />

<strong>la</strong> (1) in due passi: nel primo rispetto a b, tenendo fissi i parametri di scaling ad una<br />

stima iniziale:<br />

min SSQ(z 0 - Σ j x j 0 b j ) (3)<br />

β • •<br />

e nel se<strong>con</strong>do passo <strong>con</strong> b stimato nel passo precedente si stimano i parametri di<br />

scaling t, y j , iterando i due passi fino a <strong>con</strong>vergenza dell’<strong>algoritmo</strong>.<br />

L’<strong>algoritmo</strong> proposto, come quelli Als, <strong>con</strong>verge (De Leeuw, 1973) poiché in ogni<br />

iterazione del<strong>la</strong> procedura iterativa il residuo si riduce progressivamente all’interno di<br />

ogni passo.<br />

Il primo problema di minimo è ovviamente ottenuto <strong>con</strong> il metodo dei minimi<br />

quadrati applicato ad una stima iniziale delle variabili z 0 , x i 0 <strong>con</strong> i valori <strong>categoriali</strong><br />

2