2x2 - IGT

2x2 - IGT

2x2 - IGT

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

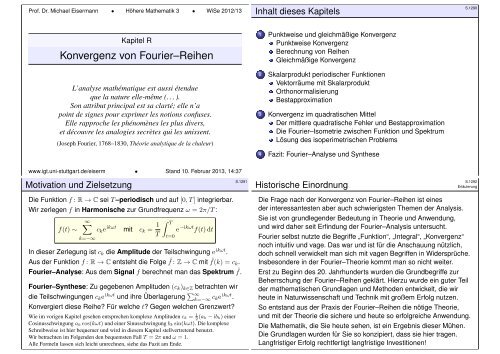

Prof. Dr. Michael Eisermann • Höhere Mathematik 3 • WiSe 2012/13<br />

Inhalt dieses Kapitels<br />

S.1290<br />

Kapitel R<br />

Konvergenz von Fourier–Reihen<br />

L’analyse mathématique est aussi étendue<br />

que la nature elle-même (. . . ).<br />

Son attribut principal est sa clarté; elle n’a<br />

point de signes pour exprimer les notions confuses.<br />

Elle rapproche les phénomènes les plus divers,<br />

et découvre les analogies secrètes qui les unissent.<br />

(Joseph Fourier, 1768–1830, Théorie analytique de la chaleur)<br />

1 Punktweise und gleichmäßige Konvergenz<br />

Punktweise Konvergenz<br />

Berechnung von Reihen<br />

Gleichmäßige Konvergenz<br />

2 Skalarprodukt periodischer Funktionen<br />

Vektorräume mit Skalarprodukt<br />

Orthonormalisierung<br />

Bestapproximation<br />

3 Konvergenz im quadratischen Mittel<br />

Der mittlere quadratische Fehler und Bestapproximation<br />

Die Fourier–Isometrie zwischen Funktion und Spektrum<br />

Lösung des isoperimetrischen Problems<br />

4 Fazit: Fourier–Analyse und Synthese<br />

www.igt.uni-stuttgart.de/eiserm • Stand 10. Februar 2013, 14:37<br />

Motivation und Zielsetzung<br />

S.1291<br />

Historische Einordnung<br />

S.1292<br />

Erläuterung<br />

Die Funktion f : R → C sei T –periodisch und auf [0, T ] integrierbar.<br />

Wir zerlegen f in Harmonische zur Grundfrequenz ω = 2π/T :<br />

f(t) ∼<br />

∞∑<br />

k=−∞<br />

c k e ikωt mit c k = 1 T<br />

ˆ T<br />

t=0<br />

e −ikωt f(t) dt<br />

In dieser Zerlegung ist c k die Amplitude der Teilschwingung e ikωt .<br />

Aus der Funktion f : R → C entsteht die Folge ˆf : Z → C mit ˆf(k) = c k .<br />

Fourier–Analyse: Aus dem Signal f berechnet man das Spektrum ˆf.<br />

Fourier–Synthese: Zu gegebenen Amplituden (c k ) k∈Z betrachten wir<br />

die Teilschwingungen c k e ikωt und ihre Überlagerung ∑ ∞<br />

k=−∞ c ke ikωt .<br />

Konvergiert diese Reihe? Für welche t? Gegen welchen Grenzwert?<br />

Wie im vorigen Kapitel gesehen entsprechen komplexe Amplituden c k = 1 2 (a k − ib k ) einer<br />

Cosinusschwingung a k cos(kωt) und einer Sinusschwingung b k sin(kωt). Die komplexe<br />

Schreibweise ist hier bequemer und wird in diesem Kapitel stellvertretend benutzt.<br />

Wir betrachten im Folgenden den bequemsten Fall T = 2π und ω = 1.<br />

Alle Formeln lassen sich leicht umrechnen, siehe das Fazit am Ende.<br />

Die Frage nach der Konvergenz von Fourier–Reihen ist eines<br />

der interessantesten aber auch schwierigsten Themen der Analysis.<br />

Sie ist von grundlegender Bedeutung in Theorie und Anwendung,<br />

und wird daher seit Erfindung der Fourier–Analysis untersucht.<br />

Fourier selbst nutzte die Begriffe „Funktion“, „Integral“, „Konvergenz“<br />

noch intuitiv und vage. Das war und ist für die Anschauung nützlich,<br />

doch schnell verwickelt man sich mit vagen Begriffen in Widersprüche.<br />

Insbesondere in der Fourier–Theorie kommt man so nicht weiter.<br />

Erst zu Beginn des 20. Jahrhunderts wurden die Grundbegriffe zur<br />

Beherrschung der Fourier–Reihen geklärt. Hierzu wurde ein guter Teil<br />

der mathematischen Grundlagen und Methoden entwickelt, die wir<br />

heute in Naturwissenschaft und Technik mit großem Erfolg nutzen.<br />

So entstand aus der Praxis der Fourier–Reihen die nötige Theorie,<br />

und mit der Theorie die sichere und heute so erfolgreiche Anwendung.<br />

Die Mathematik, die Sie heute sehen, ist ein Ergebnis dieser Mühen.<br />

Die Grundlagen wurden für Sie so konzipiert, dass sie hier tragen.<br />

Langfristiger Erfolg rechtfertigt langfristige Investitionen!

Punktweise Konvergenz<br />

§R1.1, S.1293<br />

Punktweise Konvergenz<br />

§R1.1, S.1294<br />

4<br />

2<br />

0<br />

−2<br />

−4<br />

−2 0 2 4 6 8 10 12 14<br />

Beispiel: Sei f : R → R die 2π–periodische Sägezahnfunktion<br />

mit f(x) = x − π für 0 ≤ x < 2π. Man beachte die Sprungstellen!<br />

Die Funktion f haben wir bereits in ihre Fourier–Reihe entwickelt:<br />

∞∑<br />

[<br />

−2<br />

f(x) ∼<br />

k sin(kx) = −2 sin x + 1 2 sin 2x + 1 ]<br />

3 sin 3x + . . .<br />

k=1<br />

Das n–te Fourier–Polynom ist die endliche Summe<br />

n∑<br />

[<br />

−2<br />

f n (x) =<br />

k sin(kx) = −2 sin x + 1 2 sin 2x + · · · + 1 ]<br />

n sin nx .<br />

k=1<br />

In die Funktion f n können wir nun Werte x ∈ R einsetzen.<br />

Im Punkt x = π gilt f n (π) = 0 → 0 und f(π) = 0.<br />

Im Punkt x = 0 gilt f n (0) = 0 → 0 aber f(0) = −π.<br />

Im Punkt x = π/2 finden wir die Leibniz–Reihe [S.133]<br />

−2<br />

[1 − 1 3 + 1 5 − 1 ]<br />

7 + . . . = −2 π 4<br />

Die Fourier–Reihe muss im Punkt x keineswegs gegen den Funktionswert f(x) konvergieren!<br />

Dieses Problem kann man immer provozieren, indem man f im betrachteten Punkt x beliebig<br />

abändert. Die Integrale und Fourier–Koeffizienten bleiben hiervon unberührt.<br />

Punktweise Konvergenz<br />

§R1.1, S.1295<br />

Punktweise Konvergenz<br />

§R1.1, S.1296<br />

Beispiel: f(x) = ln ∣ ∣2 sin(x/2) ∣ ∣ ist 2π–periodisch und hat Pole in 2πZ.<br />

2<br />

0<br />

−2<br />

−4<br />

−6<br />

−2 0 2 4 6 8 10 12 14<br />

Trotz Polstellen ist f integrierbar, also existieren ihre Fourier–Koeffizienten.<br />

Man findet die Fourier–Reihe dank der Potenzreihe ln(1 − z) = − ∑ ∞<br />

k=1 zk /k,<br />

indem man z = e ix einsetzt und Konvergenz für alle Punkte x /∈ 2πZ nachweist.<br />

Zu f(x) = ln ∣ ∣2 sin(x/2) ∣ ∣ ist die Fourier–Reihe [S.1283]<br />

f(x) ∼<br />

∞∑<br />

k=1<br />

−1<br />

k cos(kx) = − cos x − 1 2 cos 2x − 1 cos 3x − . . .<br />

3<br />

Wenn wir x = π einsetzen, so finden wir die Leibniz–Reihe [S.133]<br />

1 − 1 2 + 1 3 − 1 4 + . . . → ln(2).<br />

Im Punkt x = 0 finden wir die harmonische Reihe [S.126]<br />

−1 − 1 2 − 1 3 − 1 4 − . . . → −∞.<br />

Hier divergiert also die Fourier–Reihe, auch das ist möglich.

Punktweise Konvergenz<br />

§R1.1, S.1297<br />

Erläuterung<br />

Punktweise Konvergenz<br />

§R1.1, S.1298<br />

Die Funktion f : R → C sei 2π–periodisch und auf [0, 2π] integrierbar.<br />

Wir können dann ihre Fourier–Koeffizienten c k = 〈 e k | f 〉 definieren,<br />

Die Fourier–Koeffizienten fassen wir zur Fourier–Reihe zusammen:<br />

∞∑<br />

f(x) ∼ c k e ikx<br />

k=−∞<br />

Das n–te Fourier–Polynom hierzu ist die (endliche!) Summe<br />

n∑<br />

f n (x) = c k e ikx .<br />

k=−n<br />

Definition R1A (punktweise Konvergenz)<br />

Wir sagen, die Fourier–Reihe von f konvergiert im Punkt x ∈ R,<br />

wenn die Zahlenfolge f n (x) ∈ C für n → ∞ konvergiert.<br />

Sie konvergiert im Punkt x gegen f(x), wenn f n (x) → f(x) gilt.<br />

In diesem Falle (und nur dann) schreiben wir<br />

f(x) = lim<br />

n∑<br />

n→∞<br />

k=−n<br />

c k e ikx kurz f(x) =<br />

∞∑<br />

k=−∞<br />

c k e ikx .<br />

Zu festem x ∈ R betrachten wir nun den Grenzübergang n → ∞.<br />

Dirichlet–Kriterium zur punktweisen Konvergenz<br />

§R1.1, S.1299<br />

Dirichlet–Kriterium zur punktweisen Konvergenz<br />

§R1.1, S.1300<br />

Bei einer vorgelegten Funktion stellt sich die konkrete Frage:<br />

In welchen Punkten konvergiert die Fourier–Reihe? und wogegen?<br />

f(x)<br />

Angenommen, im Punkt x ∈ R existieren die einseitigen Grenzwerte<br />

f(x+) := lim<br />

t↘0<br />

f(x + t),<br />

f(x−) := lim<br />

t↘0<br />

f(x − t).<br />

Stetigkeit in x ist dann äquivalent zu f(x+) = f(x−) = f(x).<br />

Das folgende Kriterium von Dirichlet möchte ich vorab in dieser<br />

Graphik illustrieren. Ist f im Punkt x differenzierbar, so konvergiert die<br />

Fourier–Reihe gegen f(x). Das gilt auch noch, wenn f in x stetig ist<br />

und beide einseitigen Ableitungen existieren. Auch für Sprungstellen<br />

können wir noch etwas aussagen: Die Fourier–Reihe konvergiert<br />

gegen den Mittelwert! Um all diese Fälle präzise formulieren zu<br />

können, schauen wir uns die nötigen einseitigen Grenzwerte an.<br />

x<br />

Im Falle f(x+) ≠ f(x−) hat f in x eine Sprungstelle.<br />

Der Wert f(x) an der Sprungstelle x ist dabei völlig beliebig.<br />

Wir nennen f sprungnormiert, wenn f(x) = 1 2[<br />

f(x+) + f(x−)<br />

]<br />

gilt.<br />

Die einseitigen Ableitungen sind, sofern existent, die Grenzwerte<br />

f ′ f(x + t) − f(x+)<br />

(x+) := lim<br />

, f ′ f(x − t) − f(x−)<br />

(x−) := lim<br />

.<br />

t↘0 t<br />

t↘0 t<br />

Stetigkeit f(x+) = f(x−) = f(x) und f ′ (x+) = f ′ (x−)<br />

sind dann äquivalent zur Differenzierbarkeit im Punkt x.

Dirichlet–Kriterium zur punktweisen Konvergenz<br />

§R1.1, S.1301<br />

Dirichlet–Kriterium zur punktweisen Konvergenz<br />

§R1.1, S.1302<br />

2<br />

0<br />

−4 −2 0 2 4 6 8 10<br />

Beispiel: Die Rechteckfunktion f : R → R sei 2π–periodisch<br />

mit f(x) = 1 für 0 ≤ x < π und f(x) = −1 mit π ≤ x < 2π.<br />

Die Dreieckfunktion ist dann F (x) = ´ x<br />

0<br />

f(t) dt.<br />

Die Funktion f ist auf ]0, π[ und ]π, 2π[ stetig differenzierbar mit f ′ = 0. In x ∈ πZ ist f<br />

unstetig, aber es existieren f(x±) und die einseitigen Ableitungen f ′ (x±). Die Funktion F ist<br />

auf ganz R stetig und auf ]0, π[ und ]π, 2π[ stetig differenzierbar mit F ′ = f. In den Punkten<br />

x ∈ πZ ist F nicht differenzierbar, aber es existieren die einseitigen Ableitungen F ′ (x±).<br />

Satz R1B (Dirichlet–Kriterium zur Konvergenz in einem Punkt)<br />

Angenommen, in x ∈ R existieren die einseitigen Grenzwerte f(x±).<br />

Wenn die Fourier–Reihe in x konvergiert, dann gegen den Mittelwert:<br />

f n (x) → 1 2<br />

[<br />

]<br />

f(x+) + f(x−)<br />

für n → ∞.<br />

Angenommen, es existieren die einseitigen Grenzwerte f(x±) und<br />

zudem die einseitigen Ableitungen f ′ (x±). Dann konvergiert die<br />

Fourier–Reihe von f im Punkt x, und zwar gegen obigen Mittelwert.<br />

Der Funktionswert von f im Punkt x spielt dabei keine Rolle!<br />

Korollar R1C<br />

Ist f in x differenzierbar (und somit stetig), dann folgt f n (x) → f(x).<br />

In diesem Fall gilt nämlich f(x+) = f(x−) = f(x) dank Stetigkeit und<br />

es existieren f ′ (x+) = f ′ (x−) = f ′ (x) dank Differenzierbarkeit in x.<br />

Anwendung auf die Sägezahnfunktion<br />

§R1.2, S.1303<br />

Anwendung auf die Sägezahnfunktion<br />

§R1.2, S.1304<br />

Nochmal die Sägezahnfunktion, aber diesmal sprungnormiert:<br />

4<br />

2<br />

0<br />

−2<br />

−4<br />

−2 0 2 4 6 8 10 12 14<br />

Wir setzen f(x) = x − π für 0 < x < 2π aber f(0) = f(2π) = 0.<br />

Die Fourier–Koeffizienten bleiben bei dieser Korrektur unverändert.<br />

Die einseitigen Ableitungen existieren, auch in den Sprungstellen.<br />

Dank Dirichlet–Kriterium gilt hier Konvergenz in allen Punkten x ∈ R:<br />

f(x) = −2<br />

∞∑<br />

k=1<br />

sin(kx)<br />

k<br />

Dank Konvergenz erhalten wir die bemerkenswerte Formel<br />

⎧<br />

∞∑ sin(kx)<br />

⎨0 für x ∈ 2πZ,<br />

= π − x<br />

k ⎩ für x /∈ 2πZ.<br />

k=1<br />

2<br />

Anwendungsbeispiele:<br />

x = π 2 : 1 − 1 3 + 1 5 − 1 7 + 1 9 − 1 11 + . . . = π 4<br />

x = π √<br />

3<br />

[1<br />

3 : + 1 2 2 − 1 4 − 1 5 + 1 7 + 1 ]<br />

8 − . . . = π 3<br />

(In der ersten Gleichung erkennen wir die Leibniz–Reihe [S.133].)

Anwendungsbeispiel<br />

§R1.2, S.1305<br />

Anwendungsbeispiel<br />

§R1.2, S.1306<br />

Aufgabe: (nach einer Klausuraufgabe vom September 2012)<br />

Die Funktion g : R → R sei 2π–periodisch mit g(x) = e x für 0 ≤ x < 2π.<br />

(A) Skizzieren Sie g auf dem Intervall [−4π, 4π].<br />

(B) Bestimmen Sie die Fourier–Koeffizienten von g.<br />

(C) Erklären Sie, dank welcher Kriterien die Fourier–Reihe im Punkt<br />

x = 0 konvergiert und bestimmen Sie so den Grenzwert der Reihe<br />

∞∑ 1<br />

k 2 + 1 = 1 1 + 1 2 + 1 5 + 1 10 + 1<br />

17 + 1 26 + . . . .<br />

k=0<br />

600<br />

500<br />

400<br />

300<br />

200<br />

100<br />

0<br />

−12 −8 −4 0 4 8 12<br />

Anwendungsbeispiel<br />

Alternativ und etwas einfacher geht es komplex:<br />

ˆ 2π<br />

x=0<br />

e −ikx e x dx =<br />

ˆ 2π<br />

x=0<br />

[ e<br />

e (1−ik)x (1−ik)x<br />

dx =<br />

1 − ik<br />

] 2π<br />

Damit erhalten wir die komplexen Fourier–Koeffizienten:<br />

c k = 1<br />

2π<br />

ˆ 2π<br />

0<br />

e −ikx e x dx = e 2π − 1<br />

2π(1 − ik)<br />

Zum Vergleich erhalten wir so auch die reellen Integrale:<br />

x=0 = e 2π − 1<br />

1 − ik<br />

c k = e 2π − 1<br />

2π(1 − ik) = (e 2π − 1)(1 + ik)<br />

2π(1 + k 2 = e 2π − 1<br />

) 2π(1 + k 2 ) − i k(1 − e 2π )<br />

2π(1 + k 2 ) .<br />

Damit erhalten wir erneut die reellen Fourier–Koeffizienten:<br />

a k = c k + c −k = e 2π − 1<br />

π(k 2 + 1) , b k = i(c k − c −k ) = k(1 − e 2π )<br />

π(k 2 + 1)<br />

§R1.2, S.1307<br />

Beide Rechenwege sind ähnlich lang, die Wahl ist Geschmackssache.<br />

(B) Wir rechnen zunächst reell. Partielle Integration liefert<br />

ˆ 2π<br />

cos(kx) e x dx =<br />

[cos(kx) e x] ˆ<br />

2π 2π<br />

+ k sin(kx) e x dx,<br />

0<br />

0 0<br />

ˆ 2π<br />

sin(kx) e x dx =<br />

[sin(kx) e x] ˆ<br />

2π 2π<br />

− k cos(kx) e x dx.<br />

0<br />

0<br />

Das sieht zirkulär aus, aber einsetzen ergibt<br />

ˆ 2π<br />

0<br />

ˆ 2π<br />

0<br />

ˆ 2π<br />

cos(kx) e x dx = (e 2π − 1) − k 2 cos(kx) e x dx,<br />

ˆ 2π<br />

sin(kx) e x dx = k(1 − e 2π ) − k 2 sin(kx) e x dx.<br />

Das können wir nun nach den gesuchten Integralen auflösen:<br />

ˆ 2π<br />

0<br />

ˆ 2π<br />

0<br />

cos(kx) e x dx = e 2π − 1<br />

1 + k 2 , also a k = e 2π − 1<br />

π(k 2 + 1) ,<br />

Anwendungsbeispiel<br />

sin(kx) e x dx = k(1 − e 2π )<br />

1 + k 2 , also b k = k(1 − e 2π )<br />

π(k 2 + 1) .<br />

(C) In x = 0 existieren die einseitigen Grenzwerte<br />

g(0+) = lim<br />

x↘0<br />

e x = 1,<br />

0<br />

0<br />

g(0−) = g(2π−) = lim<br />

x↗2π e x = e 2π .<br />

Ebenso existieren die einseitigen Ableitungen g ′ (0+) und g ′ (0−).<br />

Das Dirichlet–Kriterium garantiert Konvergenz in x = 0, also gilt<br />

k=0<br />

a 0<br />

∞<br />

2 + ∑<br />

a k cos(kx) + b k sin(kx) =<br />

k=1<br />

e 2π − 1<br />

2π<br />

+<br />

∞∑<br />

k=1<br />

∞∑<br />

k=0<br />

0<br />

g(x+) + g(x−)<br />

2<br />

e 2π − 1<br />

π(k 2 + 1) = 1 + e 2π<br />

2<br />

e 2π − 1<br />

π(k 2 + 1) = e 2π − 1<br />

+ e 2π + 1<br />

2π 2<br />

Auflösen und vereinfachen liefert schließlich:<br />

∞∑ 1<br />

k 2 + 1 = 1 2 + π e π + e −π 1 + π coth(π)<br />

2 e π = ≈ 2.07667<br />

− e −π 2<br />

§R1.2, S.1308

Gleichmäßige Konvergenz<br />

§R1.3, S.1309<br />

Ergänzung<br />

Gleichmäßige Konvergenz<br />

§R1.3, S.1310<br />

Ergänzung<br />

3<br />

2<br />

1<br />

0<br />

−4 −2 0 2 4 6 8 10<br />

Beispiel: Die Dreieckfunktion f : R → R ist 2π–periodisch mit<br />

f<br />

f 5<br />

Den maximalen Abstand zwischen f, g : Ω → R bezeichnen wir mit<br />

∣<br />

|f − g| Ω := sup∣f(x) − g(x) ∣ ∣.<br />

x∈Ω<br />

Eine Funktionenfolge f 0 , f 1 , f 2 , . . . : Ω → R konvergiert gleichmäßig<br />

gegen f : Ω → R, wenn |f − f n | Ω → 0 für n → ∞ gilt.<br />

ε<br />

ε<br />

g<br />

f<br />

f(x) = |x| für − π ≤ x ≤ π.<br />

Sie ist stetig und stückweise stetig differenzierbar, und wird<br />

gleichmäßig von ihren Fourier–Polynomen f n approximiert.<br />

Diese Beobachtung wollen wir präzisieren und allgemein formulieren.<br />

Anschaulich gesagt: Wenn wir um f einen Schlauch der Breite ε > 0<br />

legen, so liegen darin alle f n für ausreichend großes n.<br />

Gleichmäßige Konvergenz<br />

§R1.3, S.1311<br />

Ergänzung<br />

Gleichmäßige Konvergenz<br />

§R1.3, S.1312<br />

Ergänzung<br />

Satz R1D (Abklingen und gleichmäßige Konvergenz)<br />

Gilt |c k | ≤ c/|k| 1+α für alle k ≠ 0 und Konstanten c, α > 0, dann<br />

konvergiert die Reihe ∑ c k e k gleichmäßig gegen eine stetige Funktion.<br />

Satz R1E (Dirichlet–Kriterium zur gleichmäßigen Konvergenz)<br />

Sei a ′ < a < b < b ′ . Sei f auf ]a ′ , b ′ [ stetig und stückweise stetig<br />

differenzierbar. Dann konvergiert die Fourier–Reihe auf [a, b]<br />

gleichmäßig gegen f, das heißt |f − f n | [a,b] → 0 für n → ∞.<br />

Beispiel: Für die Dreieckfunktion gilt gleichmäßige Konvergenz<br />

auf jedem Intervall. Für die Sägezahnfunktion gilt gleichmäßige<br />

Konvergenz auf jedem kompakten Intervall [a, b] ohne Sprungstelle.<br />

! Gleichmäßige Konvergenz gilt nicht bei Sprungstellen! Wegen des<br />

Gibbs–Phänomens überschwingt die Fourier–Reihe um ca. 9% der<br />

Sprunghöhe, und der Abstand |f − f n | [0,2π] wird nicht beliebig klein.<br />

Hier gilt höchstens punktweise aber nicht gleichmäßige Konvergenz.<br />

Gleichmäßige Konvergenz impliziert punktweise Konvergenz, denn<br />

|f(x) − f n (x)| ≤ |f − f n | K → 0,<br />

also f n (x) → f(x).<br />

Die Umkehrung gilt nicht! Im obigen Beispiel der sprungnormierten<br />

Sägezahnfunktion gilt |f n (x) − f(x)| → 0 in jedem Punkt x ∈ R,<br />

aber nicht gleichmäßige Konvergenz |f n − f| [0,2π] → 0.<br />

2<br />

0<br />

−2<br />

−2 0 2 4 6 8 10 12 14

Vollständigkeit der trigonometrischen Basis<br />

§R1.3, S.1313<br />

Ergänzung<br />

Eindeutigkeit der Funktion<br />

§R1.3, S.1314<br />

Ergänzung<br />

Die trigonometrischen Basisfunktionen 1, e it , e −it , e 2it , e −2it , . . .<br />

sind vollständig: Sie lassen sich durch keine hierzu orthogonale<br />

Funktion f erweitern. Ausführlich bedeutet das folgendes:<br />

Satz R1F (Vollständigkeit der trigonometrischen Basis)<br />

Die Funktion f : R → C sei 2π–periodisch und auf [0, 2π] integrierbar.<br />

Gilt<br />

ˆ 2π<br />

t=0<br />

e −ikt f(t) dt = 0<br />

für alle k ∈ Z, so folgt f(x) = 0 für fast alle x ∈ R.<br />

Anders gesagt: Für f ≠ 0 können nicht alle Fourier–Koeffizienten<br />

verschwinden. (Wie in der Integrationstheorie üblich identifizieren wir<br />

Funktionen, die fast überall gleich sind.) Dieser Satz ist die Grundlage<br />

für die L 2 –Konvergenztheorie der Fourier–Reihen. Ein vereinfachter<br />

Beweis findet sich in Meyberg–Vachenauer, Kapitel 10 §3.<br />

Haben zwei Funktionen dieselben Fourier–Koeffizienten,<br />

so sind sie gleich (überall bis auf eine Menge vom Maß Null):<br />

Korollar R1G (Eindeutigkeit der Funktion)<br />

Die Funktionen g, h: R → C seien periodisch und integrierbar.<br />

Gilt<br />

ˆ 2π<br />

t=0<br />

e −ikt g(t) dt =<br />

ˆ 2π<br />

t=0<br />

e −ikt h(t) dt<br />

für alle k ∈ Z, so folgt g(x) = h(x) für fast alle x ∈ R.<br />

Beweis: Der Satz angewendet auf f = g − h liefert f = 0.<br />

Nochmal anders gesagt: Die Fourier–Analyse f ↦→ ˆf ist injektiv.<br />

Haben zwei Funktionen dasselbe Spektrum, so sind sie gleich.<br />

Der folgende Satz sagt, dass auch die Fourier–Synthese injektiv ist.<br />

Eindeutigkeit der Koeffizienten<br />

§R1.3, S.1315<br />

Ergänzung<br />

Punktweise Konvergenz<br />

§R1.3, S.1316<br />

Ergänzung<br />

Wenn wir eine 2π–periodische, integrierbare Funktion f : R → C als<br />

eine überall konvergente trigonometrische Reihe darstellen können,<br />

dann nur auf eine Weise, nämlich durch ihre Fourier–Koeffizienten.<br />

Satz R1H (Eindeutigkeit der Koeffizienten)<br />

Die Funktion f : R → C sei 2π–periodisch und auf [0, 2π] integrierbar.<br />

Sei (c k ) k∈Z eine Folge von Koeffizienten c k ∈ C mit c k → 0 für k → ±∞.<br />

Gilt<br />

f(x) = lim<br />

n∑<br />

n→∞<br />

k=−n<br />

c k e ikx , d.h. kurz f(x) =<br />

∞∑<br />

k=−∞<br />

c k e ikx ,<br />

für alle x ∈ R (mit höchstens abzählbar vielen Ausnahmen), so folgt<br />

c k = 1 ˆ 2π<br />

e −ikt f(t) dt.<br />

2π t=0<br />

! Punktweise Konvergenz ist keineswegs selbstverständlich:<br />

Satz R1I (Kolmogorov 1924)<br />

Es gibt integrierbare Funktionen, also ´ 2π<br />

0<br />

|f(x)| dx < ∞,<br />

deren Fourier–Reihe in keinem Punkt x ∈ R konvergiert.<br />

Ein klein wenig mehr als Integrierbarkeit reicht fast überall:<br />

Satz R1J (Carleson 1966, Hunt 1968)<br />

Gilt ´ 2π<br />

0 |f(x)|p dx < ∞ für ein p > 1, so konvergiert die Fourier–Reihe<br />

fast überall gegen f, d.h. in allen x ∈ R N außer einer Nullmenge N.<br />

! Konvergenz in allen Punkten hingegen wäre zu viel verlangt:<br />

Satz R1K (Kahane & Katznelson 1966)<br />

Zu jeder Nullmenge N ⊂ R existiert eine stetige Funktion,<br />

deren Fourier–Reihe in den Punkten x ∈ N nicht konvergiert.<br />

Diese Sätze sind extrem schwierig und dienen hier nur zur Illustration.

Skalarprodukt, Norm, Abstand im R n §R2.1, S.1317<br />

Erinnerung<br />

Zur Wiederholung siehe Kimmerle–Stroppel, Lineare Algebra, §2.5<br />

Für u, v ∈ R n ist das euklidische Skalarprodukt definiert durch<br />

〈 u | v 〉 = u 1 v 1 + · · · + u n v n .<br />

Für jeden Vektor u ∈ R n gilt somit 〈 u | u 〉 = u 2 1 + · · · + u2 n ≥ 0<br />

Die euklidische Norm ist definiert durch |u| = √ 〈 u | u 〉, also<br />

|u| =<br />

√<br />

u 2 1 + · · · + u2 n.<br />

Übliche Schreibweisen: |u| = |u| 2 = ‖u‖ = ‖u‖ 2 = . . .<br />

Der euklidische Abstand zwischen u und v ist definiert durch<br />

√<br />

|u − v| = (u 1 − v 1 ) 2 + · · · + (u n − v n ) 2 .<br />

Skalarprodukt, Norm, Abstand im C n §R2.1, S.1319<br />

Erinnerung<br />

Norm einer komplexen Zahl<br />

Zur Wiederholung siehe Kimmerle–Stroppel, Lineare Algebra, §1.7<br />

Jede komplexe Zahl z ∈ C schreibt sich eindeutig als<br />

z = x + iy mit x, y ∈ R.<br />

Die Konjugation : C → C ist definiert durch<br />

z = x + iy ↦→ z = x − iy.<br />

Für das Produkt von z und z gilt<br />

z z = (x + iy)(x − iy) = x 2 + y 2 ≥ 0.<br />

Hieraus gewinnt man die Norm von z ∈ C mittels<br />

|z| = √ z z = √ x 2 + y 2<br />

Dies entspricht der euklidischen Norm auf R 2 .<br />

Eigenschaften des Skalarprodukts<br />

§R2.1, S.1318<br />

Erinnerung<br />

§R2.1, S.1320<br />

Erinnerung<br />

Für u, v ∈ C n ist das hermitesche Skalarprodukt definiert durch<br />

〈 u | v 〉 = u 1 v 1 + · · · + u n v n .<br />

Für jeden Vektor u ∈ C n gilt somit 〈 u | u 〉 = |u 1 | 2 + · · · + |u n | 2 ≥ 0<br />

Die hermitesche Norm ist definiert durch |u| = √ 〈 u | u 〉, also<br />

√<br />

|u| = |u 1 | 2 + · · · + |u n | 2 .<br />

Übliche Schreibweisen: |u| = |u| 2 = ‖u‖ = ‖u‖ 2 = . . .<br />

Der hermitesche Abstand zwischen u und v ist definiert durch<br />

√<br />

|u − v| = |u 1 − v 1 | 2 + · · · + |u n − v n | 2 .<br />

Im komplexen Skalarprodukt muss einer der beiden Faktoren konjugiert werden; ob der erste<br />

oder der zweite ist dabei eine Frage der Konvention. In der Literatur bervorzugen manche<br />

Autoren die Konjugation im ersten Faktor, andere wiederum die Konjugation im zweiten<br />

Faktor. Beide Schreibweisen gehen durch Vertauschen ineinander über.<br />

Zur Wiederholung siehe Kimmerle–Stroppel, Lineare Algebra, §2.6<br />

Soweit möglich behandeln wir den reellen und komplexen Fall parallel:<br />

Im Folgenden steht K entweder für den Körper R oder den Körper C.<br />

Das Skalarprodukt auf K n erfreut sich folgender Eigenschaften:<br />

Symmetrie: Für alle u, v ∈ K n gilt 〈 v | u 〉 = 〈 u | v 〉.<br />

Linearität im zweiten Faktor: Für alle α ∈ K gilt<br />

〈 u | v 1 + v 2 〉 = 〈 u | v 1 〉 + 〈 u | v 2 〉, 〈 u | α v 〉 = α 〈 u | v 〉,<br />

Dank Symmetrie folgt konjugierte Linearität im ersten Faktor:<br />

〈 u 1 + u 2 | v 〉 = 〈 u 1 | v 〉 + 〈 u 2 | v 〉, 〈 α u | v 〉 = α 〈 u | v 〉.<br />

Aus Linearität folgt insbesondere 〈 u | 0 〉 = 〈 0 | v 〉 = 0 für alle u, v.<br />

Positivität: Für alle v ≠ 0 gilt 〈 v | v 〉 > 0.<br />

Diese drei einfachen Eigenschaften sind alles, was wir brauchen!

Vektorräume mit Skalarprodukt<br />

§R2.1, S.1321<br />

Erinnerung<br />

Vektorräume mit Skalarprodukt<br />

§R2.1, S.1322<br />

Erinnerung<br />

Definition R2A (Skalarprodukt)<br />

Ein Skalarprodukt auf einem K–Vektorraum V ist eine Abbildung<br />

〈 − | − 〉: V × V → K, (u, v) ↦→ 〈 u | v 〉,<br />

die (konjugiert) symmetrisch, bilinear und positiv ist.<br />

Ein Skalarprodukt ermöglicht, Winkel und Längen zu messen.<br />

Damit gewinnen wir auf V die üblichen geometrischen Begriffe:<br />

Orthogonalität: u, v ∈ V stehen senkrecht, wenn 〈 u | v 〉 = 0.<br />

Norm: Die Länge eines Vektors v ∈ V ist ‖v‖ = √ 〈 v | v 〉.<br />

Cauchy–Schwarz–Ungleichung: |〈 u | v 〉| ≤ ‖u‖ · ‖v‖.<br />

Dreiecks-Ungleichung: ‖u + v‖ ≤ ‖u‖ + ‖v‖.<br />

Metrik: Der Abstand zweier Vektoren u, v ist ‖u − v‖.<br />

Konvergenz v n → v ist definiert durch ‖v n − v‖ → 0.<br />

Diese Begriffe kennen Sie bereits gut aus dem R n . Erstaunlicherweise<br />

nützen Sie ebenso als Grundlage der Fourier–Theorie für Funktionen!<br />

Zur Wiederholung siehe Kimmerle–Stroppel, Lineare Algebra, §2.6<br />

Satz R2B (Cauchy–Schwarz– und Dreiecks-Ungleichung)<br />

Sei V ein K–Vektorraum mit Skalarprodukt 〈 − | − 〉.<br />

Für alle u, v ∈ V gilt die Cauchy–Schwarz–Ungleichung:<br />

|〈 u | v 〉| 2 ≤ 〈 u | u 〉 〈 v | v 〉.<br />

Gleichheit gilt genau dann, wenn u, v linear abhängig sind.<br />

Für die Norm ‖u‖ = √ 〈 u | u 〉 besagt diese Ungleichung:<br />

|〈 u | v 〉| ≤ ‖u‖ · ‖v‖<br />

Für alle u, v ∈ V folgt hieraus die Dreiecksungleichung<br />

‖u + v‖ ≤ ‖u‖ + ‖v‖.<br />

Vektorräume mit Skalarprodukt<br />

§R2.1, S.1323<br />

Erinnerung<br />

Vektorräume mit Skalarprodukt<br />

§R2.1, S.1324<br />

Erinnerung<br />

Beweis: Für v = 0 sind die Ungleichungen offenbar richtig.<br />

Wir dürfen also v ≠ 0 und dank Positivität 〈 v | v 〉 > 0 annehmen.<br />

Wir setzen z = au − bv mit a, b ∈ C und berechnen das Normquadrat:<br />

0 ≤ 〈 z | z 〉 = 〈 au − bv ∣ ∣ au − bv 〉<br />

= |a| 2 〈 u | u 〉 − ab〈 u | v 〉 − ab〈 v | u 〉 + |b| 2 〈 v | v 〉<br />

Wir wählen nun geschickt a = 〈 v | v 〉 und b = 〈 v | u 〉:<br />

0 ≤ 〈 v | v 〉<br />

[〈 u | u 〉〈 v | v 〉 − 2|〈 u | v 〉| 2 + |〈 u | v 〉| 2]<br />

= 〈 v | v 〉<br />

[〈 u | u 〉〈 v | v 〉 − |〈 u | v 〉| 2]<br />

Wegen 〈 v | v 〉 > 0 erhalten wir die gewünschte Ungleichung:<br />

〈 u | u 〉〈 v | v 〉 − |〈 u | v 〉| 2 ≥ 0.<br />

Bei Gleichheit gilt 〈 z | z 〉 = 0, also z = au + bv = 0, somit u = (b/a)v.<br />

Umgekehrt folgt aus linearer Abhängigkeit u = λv die Gleichheit, denn<br />

|〈 u | v 〉| 2 = |〈 λv | v 〉| 2 = |λ| 2 〈 v | v 〉 2 ,<br />

〈 u | u 〉 〈 v | v 〉 = 〈 λv | λv 〉 〈 v | v 〉 = |λ| 2 〈 v | v 〉 2 .<br />

Als nächstes zeigen wir die Dreiecksungleichung, die dem Abstand<br />

zugrundeliegt. Sie besagt geometrisch: Die Länge von 0 nach u + v<br />

ist kleiner gleich der Länge des Umweges von 0 über u nach u + v.<br />

Die Rechnung beruht auf der Cauchy–Schwarz–Ungleichung:<br />

‖u + v‖ 2 = 〈 u + v | u + v 〉 = 〈 u | u 〉 + 〈 u | v 〉 + 〈 v | u 〉 + 〈 v | v 〉<br />

= ‖u‖ 2 + 2Re(〈 u | v 〉) + ‖v‖ 2<br />

≤ ‖u‖ 2 + 2|〈 u | v 〉| + ‖v‖ 2<br />

≤ ‖u‖ 2 + 2 ‖u‖ ‖v‖ + ‖v‖ 2<br />

= (‖u‖ + ‖v‖) 2 .<br />

Die Behauptung folgt dank Monotonie der Wurzelfunktion x ↦→ √ x.<br />

Man beachte, dass wir über das Skalarprodukt nur voraussetzen,<br />

dass es (konjugiert) symmetrisch, bilinear und positiv ist. Genau diese<br />

und keine weiteren Eigenschaften haben wir in der Rechnung benötigt.

Cauchy–Schwarz–Ungleichung für Reihen<br />

§R2.1, S.1325<br />

Erläuterung<br />

Quadratisch summierbare Folgen<br />

§R2.1, S.1326<br />

Erläuterung<br />

Als weiteres wichtiges Beispiel nennen wir:<br />

Satz R2C<br />

Für je zwei Folgen f, g : Z → C gilt<br />

( ∑ ∣<br />

∣f(k)g(k) ∣ 2 ( ∑ ∣<br />

∣)<br />

≤ ∣f(k) ∣ )( ∑ 2 ∣<br />

∣g(k) ∣ ).<br />

2<br />

k∈Z<br />

k∈Z<br />

k∈Z<br />

Ist dieser Wert endlich, so ist fg über Z absolut summierbar.<br />

Dank Monotonie der Wurzelfunktion x ↦→ √ x erhalten wir dann<br />

∑<br />

∣ f(k)g(k)<br />

∣ ≤ ∑ ∣<br />

∣f(k)g(k) ∣ √ ∑ ∣<br />

≤ ∣f(k) ∣ √ ∑ 2 ∣<br />

· ∣g(k) ∣ 2 .<br />

k∈Z<br />

k∈Z<br />

k∈Z<br />

k∈Z<br />

Beweisidee: Für endliche Summen beweist man dies wie im C n .<br />

Für unendliche Reihen folgt die Ungleichung durch Grenzübergang.<br />

Korollar R2D<br />

Für jede Folge f : Z → C definieren wir die Quadrat-Norm<br />

√ ∑ ∣<br />

‖f‖ := ∣f(k) ∣ 2 .<br />

k∈Z<br />

Ist diese Summe endlich, so heißt f quadrat-summierbar.<br />

Die Menge l 2 (Z) aller quadrat-summierbaren Folgen<br />

ist demnach ein Vektorraum mit Skalarprodukt<br />

〈 f | g 〉 := ∑ k∈Z<br />

f(k)g(k).<br />

Beweis: Aus Cauchy–Schwarz folgt die Dreiecks-Ungleichung, und l 2 (Z) ist ein Vektorraum:<br />

Sind f, g quadrat–summierbar, dann auch f + g, denn ‖f + g‖ ≤ ‖f‖ + ‖g‖ < ∞, und auch<br />

αf, denn ‖αf‖ = |α| · ‖f‖ < ∞. Konjugierte Symmetrie und Linearität des Skalarprodukts<br />

sind klar. Ist f ≠ 0, so gilt f(a) ≠ 0 für ein a ∈ Z, also 〈 f | f 〉 = |f(k)| 2 ≥ |f(a)| 2 > 0.<br />

Cauchy–Schwarz–Ungleichung für Integrale<br />

§R2.1, S.1327<br />

Erläuterung<br />

Quadratisch integrierbare Funktionen<br />

§R2.1, S.1328<br />

Erläuterung<br />

Diese Konstruktion überträgt sich ebenso auf Integrale:<br />

Satz R2E<br />

Sei Ω ⊂ R n . Für messbare Funktionen f, g : Ω → C gilt<br />

(ˆ<br />

∣<br />

∣fg ∣ 2 (ˆ )(ˆ<br />

∣)<br />

≤ |f| 2 |g|<br />

).<br />

2<br />

Ω<br />

Ω<br />

Ω<br />

Ist dieser Wert endlich, so ist fg über Ω absolut integrierbar.<br />

Dank Monotonie der Wurzelfunktion x ↦→ √ x erhalten wir<br />

ˆ<br />

∣<br />

Ω<br />

(ˆ<br />

fg<br />

∣ ≤<br />

Ω<br />

) (ˆ ) 1 (ˆΩ<br />

) 1<br />

|fg| ≤ |f| 2 2<br />

|g| 2 2<br />

.<br />

Ω<br />

Beweisidee: Für Treppenfunktionen beweist man dies wie im C n .<br />

Für messbare Funktionen folgt die Ungleichung durch Grenzübergang.<br />

Korollar R2F<br />

Für messbare Funktionen f : Ω → C definieren wir die Quadrat-Norm<br />

‖f‖ :=<br />

√ˆ<br />

Ω<br />

∣<br />

∣f(x) ∣ ∣ 2 dx.<br />

Ist dieses Integral endlich, so heißt f quadrat-integrierbar.<br />

Die Menge L 2 (Ω) aller quadrat-integrierbaren Funktionen<br />

ist demnach ein Vektorraum mit Skalarprodukt<br />

ˆ<br />

〈 f | g 〉 := f(x)g(x) dx.<br />

Ω<br />

Der Beweis verläuft für Integrale wie zuvor für Reihen. Nur die Positivität des Skalarprodukts<br />

bedarf der Erläuterung: Es gilt 〈 f | f 〉 = ´Ω |f(x)|2 dx ≥ 0. Gilt hier = 0, so ist |f| 2 und<br />

somit f fast überall gleich 0. In der Integrationstheorie betrachten wir zwei Funktionen als<br />

gleich, wenn sie fast überall übereinstimmen, d.h. es gibt eine Nullmenge N ⊂ Ω sodass<br />

f(x) = g(x) für alle x ∈ [a, b] N gilt. Aus ´Ω |f(x)|2 dx = 0 folgt dann f = 0 fast überall.

Orthonormalität: Fundamentalbeispiel<br />

§R2.1, S.1329<br />

Erläuterung<br />

Orthonormalität: Satz des Pythagoras<br />

§R2.1, S.1330<br />

Erläuterung<br />

Wir definieren die Basisfunktion e k : R → C mit k ∈ Z durch<br />

e k (x) := e ikx = cos(kx) + i sin(kx).<br />

Die hierzu konjugierte Funktion ist e k (x) = cos(kx) − i sin(kx) = e −k (x).<br />

Satz R2G (Orthonormalität)<br />

Bezüglich des Skalarprodukts<br />

〈 f | g 〉 := 1 ˆ 2π<br />

f(x) g(x) dx<br />

2π 0<br />

gelten die Orthonormalitätsrelationen<br />

{<br />

1 für k = l (Normierung auf Länge 1),<br />

〈 e k | e l 〉 =<br />

0 für k ≠ l (paarweise Orthogonalität).<br />

Das haben wir im vorigen Kapitel nachgerechnet und dann ausgiebig<br />

für Fourier–Reihen genutzt. Man wiederhole den Beweis als Übung.<br />

Satz R2H (Pythagoras)<br />

Sei V ein K–Vektorraum mit Skalarprodukt 〈 − | − 〉.<br />

Sind u 1 , . . . , u n orthogonal, also 〈 u k | u l 〉 = 0 für k ≠ l, so gilt<br />

‖u 1 + · · · + u n ‖ 2 = ‖u 1 ‖ 2 + · · · + ‖u n ‖ 2 .<br />

Sind e 1 , . . . , e n orthonormal und c 1 , . . . , c n ∈ K, so gilt demnach<br />

‖c 1 e 1 + · · · + c n e n ‖ 2 = |c 1 | 2 + · · · + |c n | 2 .<br />

Für jede Linearkombination f = ∑ c k e k gilt c k = 〈 e k | f 〉.<br />

Nachrechnen: Die Norm erhalten wir aus dem Skalarprodukt:<br />

∥ ∑ ∥<br />

‖u k ‖ 2 ∥∥<br />

2 〈 ∑ ∣ ∣∣<br />

∑ 〉<br />

= u k u l = ∑ ∑<br />

〈 u k | u l 〉 = ∑ ‖u k ‖ 2<br />

k<br />

k l<br />

k l<br />

k<br />

Speziell für u k = c k e k gilt dann ‖u k ‖ 2 = |c k | 2 ‖e k ‖ 2 = |c k | 2 .<br />

Die Koeffizientenformel haben wir auf [S.1239] nachgerechnet.<br />

Orthonormalisierung<br />

§R2.2, S.1331<br />

Erinnerung<br />

Orthonormalisierung<br />

§R2.2, S.1332<br />

Erinnerung<br />

Satz R2I (Laplace 1816, Gram 1883, Schmidt 1907)<br />

Sei b 1 , b 2 , b 3 , . . . , b n eine Basis des Vektorraums U. Wir setzen<br />

b ∗ 1 := b 1 ,<br />

b ∗ 2 := b 2 − 〈 e 1 | b 2 〉e 1 ,<br />

b ∗ 3 := b 3 − 〈 e 1 | b 3 〉e 1 − 〈 e 2 | b 3 〉e 2 ,<br />

e 1 := b ∗ 1/‖b ∗ 1‖,<br />

e 2 := b ∗ 2/‖b ∗ 2‖,<br />

e 3 := b ∗ 3/‖b ∗ 3‖,<br />

.<br />

n−1<br />

∑<br />

b ∗ n := b n − 〈 e k | b n 〉e k , e n := b ∗ n/‖b ∗ n‖.<br />

k=1<br />

Auf diese Weise erhalten wir eine Orthogonalbasis b ∗ 1 , b∗ 2 , b∗ 3 , . . . , b∗ n<br />

und eine Orthonormalbasis e 1 , e 2 , e 3 , . . . , e n von U. Es gilt also<br />

{<br />

{<br />

〈 b ∗ k | b∗ l 〉 = 0 falls k ≠ l,<br />

0 falls k ≠ l,<br />

‖b ∗ und 〈 e k | e l 〉 =<br />

k ‖2 falls k = l,<br />

1 falls k = l.<br />

Zur Wiederholung siehe Kimmerle–Stroppel, Lineare Algebra, §4.5.10.<br />

Per Induktion über n zeigen wir: Ist b 1 , b 2 , b 3 , . . . , b n eine Basis des Vektorraumes U n ,<br />

dann ist e 1 , e 2 , e 3 , . . . , e n eine Orthonormalbasis desselben Vektorraumes U n .<br />

Für n = 1 ist die Aussage leicht nachzuprüfen: Der Vektor b ∗ 1 = b 1 ≠ 0 ist eine Basis des von<br />

ihm aufgespannten eindimensionalen Vektorraumes U 1 . Wegen b ∗ 1 ≠ 0 gilt ‖b ∗ 1‖ ̸= 0, und<br />

somit können wir e 1 = b ∗ 1/‖b ∗ 1‖ normieren. Damit ist e 1 eine Orthonormalbasis von U 1 .<br />

Wir nehmen an, die Aussage gilt für n − 1, das heißt e 1 , e 2 , e 3 , . . . , e n−1 ist eine<br />

Orthonormalbasis von U n−1 . Dann ist e 1 , e 2 , e 3 , . . . , e n−1 , b n eine Basis von U n .<br />

Darüber hinaus ist e 1 , e 2 , e 3 , . . . , e n−1 , b ∗ n eine Orthogonalbasis von U n , denn nach Definition<br />

b ∗ n = b n − ∑ n−1<br />

k=1 〈 e k | b n 〉e k erzeugt e 1 , e 2 , e 3 , . . . , e n−1 , b ∗ n ebenso U n und zudem gilt<br />

n−1<br />

∑<br />

〈 e l | b ∗ n 〉 = 〈 e l | b n 〉 − 〈 e k | b n 〉〈 e l | e k 〉 = 〈 e l | b n 〉 − 〈 e l | b n 〉 = 0.<br />

k=1<br />

Nach Voraussetzung ist dim U n = n, also muss b ∗ n ≠ 0 gelten, und wir können e n = b ∗ n/‖b ∗ n‖<br />

normieren. Daraus folgt, dass e 1 , e 2 , e 3 , . . . , e n−1 , e n eine Orthonormalbasis von U n ist.<br />

Dieses Verfahren funktioniert auch dann noch, wenn b 1 , . . . , b n nur ein Erzeugendensystem<br />

von U ist aber nicht notwendig linear unabhängig. Wenn bei der Orthonormalisierung b ∗ n = 0<br />

auftritt, dann ist b n eine Linearkombination von b 1 , . . . , b n−1 wird einfach weggelassen.

Hermitesche Matrizen<br />

§R2.2, S.1333<br />

Erinnerung<br />

Hermitesche Matrizen<br />

§R2.2, S.1334<br />

Erinnerung<br />

Zur Wiederholung siehe Kimmerle–Stroppel, Lineare Algebra, §5.4. Reelle Matrizen mit<br />

A = A ⊤ nennt man symmetrisch. Im Komplexen muss man transponieren und konjugieren.<br />

Zu jeder Matrix A ∈ C n×n ist die hermitesch-konjugierte Matrix<br />

A ∗ := A ⊤ .<br />

Damit können wir Matrizen in einem Skalarprodukt umwälzen:<br />

〈 u | Av 〉 = 〈 A ∗ u | v 〉<br />

Für Spaltenvektoren u, v ∈ C n gilt nämlich 〈 u | v 〉 = u ⊤ v, und daher<br />

〈 u | Av 〉 = u ⊤ Av = A ⊤ ⊤<br />

u v = 〈 A ∗ u | v 〉.<br />

Die Matrix A heißt hermitesch, wenn A ∗ = A gilt, also<br />

〈 u | Av 〉 = 〈 Au | v 〉 für alle u, v ∈ C n .<br />

Slogan: Hermitesche Matrizen verhalten sich wie reelle Zahlen.<br />

Orthogonalität von Eigenfunktionen<br />

Die Orthogonalität von e k = e ikx für k ∈ Z haben wir ausgerechnet.<br />

Es gibt darüberhinaus einen tieferen und allgemeineren Grund:<br />

d<br />

1 d<br />

i dx e ikx = k e ikx<br />

Für den Operator 1 i dx ist e k Eigenfunktion zum Eigenwert k. Zudem<br />

〈 1 d<br />

∣ 〉 〈<br />

∣∣<br />

i dx f g = f ∣ 1 d<br />

〉<br />

i dx g .<br />

Für stetig diff’bare 2π–periodische Funktionen f, g : R → C gilt:<br />

〈<br />

f ∣ 1 d<br />

〉<br />

i dx g = 1 ˆ 2π<br />

f g ′ = 1 [ ] 2π<br />

fg<br />

i<br />

i<br />

− 1 ˆ 2π 〈 1<br />

f<br />

0 i<br />

′ d<br />

∣ 〉 ∣∣<br />

g =<br />

i dx f g<br />

Also ist 1 i<br />

0<br />

d<br />

dx<br />

hermitesch und die Eigenfunktionen sind orthogonal!<br />

§R2.2, S.1335<br />

Ergänzung<br />

Die Entwicklung nach Eigenfunktionen ist ein wichtiges Prinzip und erscheint überall, wo<br />

Differentialgleichungen auftreten. Die ominösen „Orbitale“ des Atommodells zum Beispiel<br />

sind nichts anderes als Eigenfunktionen des Schrödinger–Operators, der die physikalische<br />

Situation beschreibt. In diesem Kapitel nun begegnet uns der Ableitungsoperator 1 i<br />

Entwicklung nach den Eigenfunktionen e ikx ist die Fourier–Reihe!<br />

0<br />

d<br />

dx<br />

, und die<br />

Hermitesche Matrizen haben reelle Eigenwerte und orthogonale Eigenvektoren:<br />

Lemma R2J<br />

Sei A ∈ C n×n eine hermitesche Matrix, also A ∗ = A. Sei v ∈ C n ein<br />

Eigenvektor, also Av = λv mit Eigenwert λ ∈ C. Dann gilt λ ∈ R.<br />

Beweis durch Umwälzen:<br />

λ〈 v | v 〉 = 〈 v | λv 〉 = 〈 v | Av 〉 = 〈 Av | v 〉 = 〈 λv | v 〉 = λ〈 v | v 〉<br />

Wegen v ≠ 0 und Positivität gilt 〈 v | v 〉 > 0. Also λ = λ.<br />

Lemma R2K<br />

Sei A ∈ C n×n eine hermitesche Matrix, also A ∗ = A. Seien u, v ∈ C n<br />

Eigenvektoren, also Au = λu und Av = µv mit Eigenwerten λ, µ ∈ R.<br />

Wenn λ ≠ µ gilt, dann sind u und v orthogonal, also 〈 u | v 〉 = 0.<br />

Beweis durch Umwälzen:<br />

λ〈 u | v 〉 = 〈 λu | v 〉 = 〈 Au | v 〉 = 〈 u | Av 〉 = 〈 u | µv 〉 = µ〈 u | v 〉<br />

Also (λ − µ)〈 u | v 〉 = 0. Aus λ − µ ≠ 0 folgt 〈 u | v 〉 = 0.<br />

Hermitesche Matrizen sind diagonalisierbar<br />

Satz R2L<br />

§R2.2, S.1336<br />

Erinnerung<br />

Jede hermitesche Matrix A ∈ C n×n ist orthognal diagonalisierbar.<br />

Das heißt, es gibt eine orthogonale Basis v 1 , . . . , v n aus Eigenvektoren.<br />

Beweis: Induktion über n: Für n = 1 ist alles klar. Sei n ≥ 2.<br />

Sei λ ∈ R ein Eigenwert und v ∈ C n ein zugehöriger Eigenvektor.<br />

Der hierzu orthogonale Unterraum ist W = { w ∈ C n ∣ ∣ 〈 v | w 〉 = 0 } .<br />

Es gilt A(W ) ⊂ W , das heißt, für alle w ∈ W gilt Aw ∈ W , denn<br />

〈 v | Aw 〉 = 〈 Av | w 〉 = 〈 λv | w 〉 = λ〈 v | w 〉 = 0.<br />

Es gilt dim W = n − 1. Nach Induktionsvoraussetzung existiert<br />

eine orthogonale Basis v 1 , . . . , v n−1 von W aus Eigenvektoren.<br />

Somit ist v 1 , . . . , v n−1 , v eine orthogonale Basis von V .<br />

Ein ähnliches Prinzip gilt für den Ableitungsoperator 1 d<br />

und die Entwicklung nach den<br />

i dx<br />

Eigenfunktionen e ikx in eine Fourier–Reihe. Der Vektorraum aller (quadrat–integrierbaren)<br />

periodischen Funktionen ist allerdings unendlich–dimensional. Aber in einem geeigneten<br />

Sinne bildet die Familie (e ikx ) k∈Z eine Hilbert–Basis.

Bestapproximation durch Orthogonalprojektion<br />

§R2.3, S.1337<br />

Bestapproximation durch Orthogonalprojektion<br />

§R2.3, S.1338<br />

V<br />

v<br />

v*<br />

U<br />

V<br />

v<br />

v*<br />

U<br />

Satz R2M (Gauß 1795, Bessel 1818)<br />

Zu jedem Vektor v ∈ V existiert genau eine Bestapproximation in U,<br />

also ein Vektor v ∗ ∈ U, der ‖v − v ∗ ‖ ≤ ‖v − u‖ für alle u ∈ U erfüllt.<br />

Sei e 1 , . . . , e n eine Orthonormalbasis des Unterraumes U.<br />

Dann ist v ∗ gegeben durch die Orthogonalprojektion von v auf U:<br />

Sei V ein K–Vektorraum mit Skalarprodukt 〈 − | − 〉<br />

und hierin U ⊂ V ein Untervektorraum mit dim U = n < ∞.<br />

Approximation: Zu v ∈ V finde v ∗ ∈ U, der v am nächsten liegt.<br />

Lösungsweg: Sei U gegeben durch ein Erzeugendensystem.<br />

Orthonormalbasis e 1 , . . . , e n von U. Orthogonalprojektion auf U.<br />

Schon der Fall V = R 2 und n = 1 (oder V = R 3 und n = 2) ist interessant und Ihnen<br />

vielleicht noch aus der Schule vertraut. Die obige Skizze und die folgenden Argumente gelten<br />

aber ganz allgemein: Der Raum V darf beliebig groß sein, zum Beispiel ein Funktionenraum;<br />

lediglich der Unterraum U sollte zur Vereinfachung endlich-dimensional bleiben, zum Beispiel<br />

der Unterraum der trigonometrischen Polynome vom Grad ≤ k. (Dann wäre dim U = 1 + 2k.)<br />

v ∗ =<br />

n∑<br />

v k e k mit Fourier–Koeffizienten v k = 〈 e k | v 〉.<br />

k=1<br />

Zudem ist v ∗ der einzige Vektor in U, für den v − v ∗ senkrecht steht<br />

auf allen u ∈ U. Dank Pythagoras gilt daher die Bessel–Gleichung:<br />

‖v ∗ ‖ 2 + ‖v − v ∗ ‖ 2<br />

} {{ } } {{ }<br />

Längenquadrat von v ∗<br />

Approximationsfehler<br />

= ‖v‖ 2<br />

}{{}<br />

Längenquadrat von v<br />

Es folgt die Bessel–Ungleichung |v 1 | 2 + · · · + |v n | 2 = ‖v ∗ ‖ 2 ≤ ‖v‖ 2 .<br />

Bestapproximation durch Orthogonalprojektion<br />

Beweis durch Nachrechnen: Wir betrachten den genannten Vektor<br />

v ∗ :=<br />

§R2.3, S.1339<br />

Bestapproximation durch Orthogonalprojektion<br />

Speziell für u = v ∗ gilt somit:<br />

‖v − v ∗ ‖ 2 = ‖v‖ 2 − ‖v ∗ ‖ 2 .<br />

Dieser Abstand ist minimal, denn im Vergleich gilt:<br />

n∑<br />

n∑<br />

n∑<br />

‖v − u‖ 2 − ‖v − v ∗ ‖ 2 = |u k | 2 − u k v k − u k v k +<br />

k=1 k=1 k=1<br />

n∑<br />

n∑<br />

〈 n∑ ∣ ∣∣<br />

n∑ 〉<br />

= (u k − v k )(u k − v k ) =<br />

u k e k u l e l k=1<br />

k=1<br />

k=1 l=1<br />

n∑ n∑<br />

u k u l 〈 e k | e l 〉 Schließlich gilt die behauptete Orthogonalität:<br />

k=1 l=1<br />

〈 n∑ ∣<br />

|u k | 2 = ‖v‖ 2 − 2Re〈 u | v ∗ 〉 + ‖u‖ 2 〈 v − v ∗ ∣∣<br />

n∑ 〉 n∑<br />

n∑<br />

| u 〉 = v − v k e k u k e k = u k v k −<br />

n∑<br />

v k e k mit Koeffizienten v k = 〈 e k | v 〉.<br />

k=1<br />

Für jeden Vektor u ∈ U gilt u = ∑ n<br />

k=1 u ke k mit Koeffizienten u k ∈ K.<br />

Den Abstand zwischen v und u berechnen wir dann wie folgt:<br />

‖v − u‖ 2 = 〈 v − u | v − u 〉 = 〈 v | v 〉 − 〈 v | u 〉 − 〈 u | v 〉 + 〈 u | u 〉<br />

〈<br />

n∑ 〉 〈 n∑ ∣ 〉 ∣∣<br />

= 〈 v | v 〉 − v ∣ u k e k − u k e k v +<br />

= 〈 v | v 〉 −<br />

= 〈 v | v 〉 −<br />

k=1<br />

n∑<br />

u k 〈 v | e k 〉 −<br />

k=1<br />

n∑<br />

u k v k −<br />

k=1<br />

k=1<br />

n∑<br />

u k 〈 e k | v 〉 +<br />

k=1<br />

n∑<br />

u k v k +<br />

k=1<br />

n∑<br />

k=1<br />

n∑<br />

|v k | 2<br />

k=1<br />

|u k − v k | 2 ≥ 0<br />

Gleichheit gilt hierbei nur für u = v ∗ , andernfalls ‖v − u‖ > ‖v − v ∗ ‖.<br />

k=1<br />

l=1<br />

k=1<br />

k=1<br />

§R2.3, S.1340<br />

u k v k = 0

Der mittlere quadratische Fehler<br />

Für quadrat-integrierbare f, g : [0, 2π] → C ist das Skalarprodukt<br />

〈 f | g 〉 := 1 ˆ 2π<br />

f(x)g(x) dx.<br />

2π 0<br />

Die zugehörige Norm ist definiert durch ‖f‖ = √ 〈 f | f 〉, also<br />

‖f‖ :=<br />

[ 1<br />

2π<br />

ˆ 2π<br />

0<br />

] 1<br />

|f(x)| 2 2<br />

dx .<br />

§R3.1, S.1341<br />

Der mittlere quadratische Abstand zwischen f, g ist definiert durch<br />

‖f − g‖ :=<br />

[ 1<br />

2π<br />

ˆ 2π<br />

0<br />

] 1<br />

|f(x) − g(x)| 2 2<br />

dx .<br />

Bestapproximation und Bessel–Ungleichung<br />

§R3.1, S.1342<br />

Sei f : [0, 2π] → C quadrat-integrierbar, das heißt ´ 2π<br />

0 |f(x)|2 dx < ∞.<br />

Sei f n = ∑ n<br />

k=−n c ke ikx eine Approximation mit Koeffizienten c k ∈ C.<br />

Wie minimieren wir den mittleren quadratischen Fehler ‖f − f n ‖?<br />

Korollar R3A (Bestapproximation durch Fourier–Polynome)<br />

Der mittlere quadratische Fehler ‖f − f n ‖ wird genau dann minimal,<br />

wenn f n das Fourier–Polynom zu f ist, also für die Koeffizienten<br />

c k = 1 ˆ 2π<br />

e −ikx f(x) dx.<br />

2π 0<br />

Der mittlere quadratische Fehler ist dann ‖f − f n ‖ 2 = ‖f‖ 2 − ‖f n ‖ 2 .<br />

Hieraus folgt die Bessel–Ungleichung ‖f n ‖ 2 ≤ ‖f‖ 2 , ausgeschrieben<br />

Der punktweise Abstand |f(x) − g(x)| 2 wird hier also über [0, 2π] integriert. Das Quadrat<br />

sorgt dafür, dass große Abweichungen stärker bestraft werden als kleine. Der Faktor 1/2π dient<br />

nur zur Normierung und macht die Fourier–Formeln einfacher. Die abschließende Wurzel sorgt<br />

dafür, dass die Norm tatsächlich homogen ist, also ‖α · f‖ = |α| · ‖f‖ für alle α ∈ C erfüllt.<br />

n∑<br />

|c k | 2 ≤<br />

k=−n<br />

1<br />

2π<br />

ˆ 2π<br />

0<br />

|f(x)| 2 dx.<br />

Konvergenz im quadratischen Mittel<br />

§R3.1, S.1343<br />

Bessel–Ungleichung und Parseval–Gleichung<br />

§R3.1, S.1344<br />

Es stellt sich die Frage, wann ‖f − f n ‖ → 0 gilt.<br />

Satz R3B (Konvergenz im quadratischen Mittel)<br />

Sei f : [0, 2π] → C integrierbar, mit n–tem Fourier–Polynom<br />

f n (x) =<br />

n∑<br />

k=−n<br />

c k e ikx , c k := 1 ˆ 2π<br />

e −ikx f(x) dx.<br />

2π 0<br />

Genau dann ist f quadrat-integrierbar, also ´ 2π<br />

0 |f(x)|2 dx < ∞,<br />

wenn die Koeffizienten quadrat–summierbar sind, also ∑ |c k | 2 < ∞.<br />

In diesem Fall konvergieren die Fourier–Polynome im quadratischen<br />

Mittel gegen die Funktion f, es gilt also ‖f − f n ‖ → 0 für n → ∞.<br />

Die Bessel–Ungleichung wird dann zur Parseval–Gleichung:<br />

∞∑<br />

k=−∞<br />

|c k | 2 =<br />

1<br />

2π<br />

ˆ 2π<br />

0<br />

|f(x)| 2 dx.<br />

Zum Vergleich betrachten wir auch die reelle Fourier–Reihe:<br />

f(x) ∼ a 0<br />

∞<br />

2 + ∑<br />

a k cos(kx) + b k sin(kx) =<br />

k=1<br />

∞∑<br />

c k e ikx<br />

k=−∞<br />

Hierbei sei a k , b k ∈ R. Wegen c ±k = 1 2 (a k ∓ ib k ) mit b 0 = 0 erhalten wir<br />

n∑<br />

|c k | 2 = a2 0<br />

4 + 1 2<br />

k=−n<br />

n∑<br />

a 2 k + b2 k .<br />

k=1<br />

Die Bessel–Ungleichung ‖f n ‖ 2 ≤ ‖f‖ 2 bedeutet demnach<br />

a 2 0<br />

n∑<br />

2 + a 2 k + b2 k ≤ 1 π<br />

k=1<br />

ˆ 2π<br />

0<br />

|f(x)| 2 dx.<br />

Die Parseval–Gleichung ‖f n ‖ 2 → ‖f‖ 2 bedeutet Gleichheit für n → ∞.

Anwendung auf die Sägezahnfunktion<br />

§R3.1, S.1345<br />

Anwendung auf die Sägezahnfunktion<br />

§R3.1, S.1346<br />

Sei f : R → R ungerade, 2π periodisch, f(x) = x − π für 0 < x < 2π.<br />

2<br />

0<br />

−2<br />

−2 0 2 4 6 8 10 12 14<br />

Die Sägezahnfunktion f ist beschränkt, also quadrat-integrierbar.<br />

Ihre Fourier–Reihe konvergiert im quadratischen Mittel, ‖f − f n ‖ → 0.<br />

Aufgabe: Man bestimme die Fourier–Reihe von f und gewinne aus<br />

der Parseval–Gleichung den Grenzwert der Reihe ∑ ∞<br />

k=1 1/k2 .<br />

Anwendung auf die Rechteckfunktion<br />

Sei f : R → R ungerade, 2π–periodisch, f(x) = 1 für 0 < x < π.<br />

1<br />

0<br />

−1<br />

−4 −2 0 2 4 6 8 10<br />

§R3.1, S.1347<br />

Die Rechteckfunktion f ist beschränkt, also quadrat-integrierbar.<br />

Ihre Fourier–Reihe konvergiert im quadratischen Mittel, ‖f − f n ‖ → 0.<br />

Aufgabe: Man bestimme die Fourier–Reihe von f und gewinne aus<br />

der Parseval–Gleichung den Grenzwert der Reihe ∑ ∞<br />

j=0 1/(2j + 1)2 .<br />

Lösung: Die Fourier–Reihe von f kennen wir bereits [S.1265]:<br />

f(x) ∼<br />

∞∑<br />

k=1<br />

−2<br />

k sin(kx)<br />

Konvergenz im quadratischen Mittel und Parseval–Gleichung besagen:<br />

∞∑<br />

k=1<br />

4<br />

k 2 = 1 π<br />

ˆ 2π<br />

0<br />

(x − π) 2 dx = 1 π<br />

Hieraus folgt die bemerkenswerte Gleichung<br />

∞∑<br />

k=1<br />

1<br />

k 2 = π2<br />

6 .<br />

[ (x − π)<br />

3<br />

3<br />

] 2π<br />

0<br />

= 2π2<br />

3 .<br />

Dass diese Reihe konvergiert, ist leicht zu beweisen. (Vielleicht wissen Sie noch, wie man es<br />

mit den Mitteln der HM1/2 zeigen kann). Nun können wir endlichen den Grenzwert berechnen!<br />

Mit den starken Werkzeugen der Fourier–Theorie fällt uns das Ergebnis geradezu in den Schoß.<br />

Anwendung auf die Rechteckfunktion<br />

Lösung: Die Fourier–Reihe von f kennen wir bereits [S.1257]:<br />

f(x) ∼<br />

∞∑<br />

j=0<br />

4<br />

π(2j + 1) sin( (2j + 1)x ) .<br />

§R3.1, S.1348<br />

Konvergenz im quadratischen Mittel und Parseval–Gleichung besagen:<br />

∞∑<br />

j=0<br />

Hieraus folgt die Gleichung<br />

16<br />

π 2 (2j + 1) 2 = 1 ˆ 2π<br />

f(x) 2 dx = 2<br />

π 0<br />

∞∑<br />

j=0<br />

1<br />

(2j + 1) 2 = π2<br />

8 .<br />

Diesen Wert kann man alternativ auch aus ∑ ∞<br />

k=1 1/k2 = π 2 /6 ableiten. Sehen Sie wie?<br />

Hinweis:<br />

∑<br />

Man kann die ungeraden und die geraden Terme getrennt summieren und erhält<br />

∞<br />

k=1 1/k2 = ∑ ∞<br />

j=0 1/(2j + 1)2 + ∑ ∞<br />

j=1 1/(2j)2 , die zweite Reihe ist 4 ∑ ∞<br />

k=1 1/k2 .

Wozu dient punktweise Konvergenz?<br />

§R3.1, S.1349<br />

Erläuterung<br />

Wozu dient Konvergenz im quadratischen Mittel?<br />

§R3.1, S.1350<br />

Erläuterung<br />

Will man eine Fourier–Reihe in einem einzelnen Punkt auswerten,<br />

so muss man sich die Frage der punktweisen Konvergenz stellen!<br />

Das Dirichlet–Kriterium liefert uns hierzu ein einfaches und doch recht<br />

starkes Werkzeug. Es erlaubt insbesondere die Berechnung von<br />

einigen Reihengrenzwerten, wie in obigen Beispielen illustriert, die<br />

sonst nur schwer zu bekommen sind.<br />

Fourier–Reihen basieren auf dem Skalarprodukt periodischer<br />

Funktionen. Es liegt daher nahe, die Güte der Approximation durch die<br />

zugehörige Norm des mittleren quadratischen Abstands zu messen!<br />

Es stellt sich schnell heraus, dass dieser Abstandsbegriff für die<br />

Konvergenz von Fourier–Reihen der natürlichste ist: Bezüglich des<br />

mittleren quadratischen Abstands sind die Formeln am einfachsten.<br />

Quadratisches Mittel ⇏ punktweise Konvergenz<br />

§R3.1, S.1351<br />

Erläuterung<br />

Punktweise Konvergenz ⇏ quadratisches Mittel<br />

§R3.1, S.1352<br />

Erläuterung<br />

! Aus Konvergenz im quadratischen Mittel, also ‖f − f n ‖ → 0,<br />

folgt nicht punktweise Konvergenz. Es kann sogar sein,<br />

dass die Folge f n (x) in keinem Punkt x konvergiert!<br />

! Aus punktweiser Konvergenz f n → f, also f n (x) → f(x) für alle x,<br />

folgt nicht die Konvergenz im quadratischen Mittel! Gegenbeispiel:<br />

Gegenbeispiel der „wandernden Blöcke“: Wir zerlegen das Intervall<br />

I 1 = [0, 2π] in zwei Hälften I 2 = [0, π] und I 3 = [π, 2π], und diese<br />

wiederum in I 4 = [0, π/2] und I 5 = [π/2, π] sowie I 6 = [π, 3π/2] und<br />

I 7 = [3π/2, 2π], usw. Hierzu betrachten wir die Indikatorfunktionen<br />

{<br />

1 für x ∈ I n ,<br />

f n (x) =<br />

0 für x /∈ I n .<br />

Die Quadrat-Norm ‖f n ‖ = Länge von I n konvergiert gegen 0.<br />

Jedoch konvergiert f n (x) für n → ∞ in keinem Punkt x: Die Folge<br />

f n (x) besteht nämlich aus vielen Nullen und immer mal wieder einer 1.<br />

k<br />

0<br />

1/k 2/k 1<br />

Für n ≥ 2 sei f n : [0, 1] → R definiert durch<br />

⎧<br />

⎪⎨ n 2 x für 0 ≤ x ≤ 1 n ,<br />

f n (x) = 2n − n<br />

⎪⎩<br />

2 x für 1 n ≤ x ≤ 2 n ,<br />

0 für 2 n ≤ x ≤ 1.<br />

Für jeden Punkt x ∈ [0, 1] gilt f n (x) → 0.<br />

Hingegen gilt ´ 1<br />

0 f n(x) dx = 1 sowie<br />

´ 1<br />

0 f n(x) 2 dx = 2 3n → ∞ für n → ∞.

Quadrat-integrierbare Funktionen<br />

§R3.2, S.1353<br />

Fourier–Analyse und Fourier–Synthese<br />

§R3.2, S.1354<br />

Die quadrat-integrierbaren Funktionen bilden den C–Vektorraum<br />

{<br />

ˆ<br />

L 2 = L 2 T<br />

}<br />

([0, T ], C) := f : [0, T ] → C<br />

∣ |f(x)| 2 dx < ∞ .<br />

Hierauf haben wir als Skalarprodukt das Integral<br />

〈 f | g 〉 := 1 T<br />

ˆ T<br />

0<br />

0<br />

f(x) g(x) dx.<br />

Die quadrat-summierbaren Folgen bilden den C–Vektorraum<br />

{<br />

l 2 = l 2 ∞∑<br />

}<br />

(Z, C) := ˆf : Z → C<br />

∣ | ˆf(k)| 2 < ∞ .<br />

k=−∞<br />

Hierauf haben wir als Skalarprodukt die Summe<br />

〈 ˆf<br />

∞∑<br />

| ĝ 〉 := ˆf(k) ĝ(k).<br />

k=−∞<br />

Beide Vektorräume scheinen zunächst gänzlich verschieden. . .<br />

Die Fourier–Entwicklung enthüllt jedoch: Sie gleichen sich!<br />

Jeder Funktion f ∈ L 2 ordnen wir ihre Fourier–Koeffizienten ˆf ∈ l 2 zu:<br />

F : L 2 → l 2 , f ↦→ ˆf mit ˆf(k) =<br />

1<br />

T<br />

ˆ T<br />

0<br />

e −ikωx f(x) dx<br />

Umgekehrt ordnen wir Koeffizienten ˆf ∈ l 2 die Funktion f ∈ L 2 zu:<br />

F −1 : l 2 → L 2 , ˆf ↦→ f mit f(x) = ∞ ∑<br />

k=−∞<br />

ˆf(k)e ikωx<br />

Diese Abbildungen sind C–linear und zueinander inverse Isometrien.<br />

Die (verallgemeinerte) Parseval–Gleichung besagt nämlich:<br />

‖f‖ = ‖ ˆf‖,<br />

〈 f | g 〉 = 〈 ˆf | ĝ 〉, also<br />

also<br />

1<br />

T<br />

1<br />

T<br />

ˆ T<br />

0<br />

ˆ T<br />

0<br />

|f(t)| 2 dt =<br />

f(t) g(t) dt =<br />

∞∑<br />

k=−∞<br />

∞∑<br />

k=−∞<br />

| ˆf(k)| 2 .<br />

ˆf(k) ĝ(k).<br />

Fourier–Analyse und Fourier–Synthese<br />

§R3.2, S.1355<br />

Erläuterung<br />

Die Fourier–Isometrie<br />

§R3.2, S.1356<br />

Erläuterung<br />

Man spricht von Fourier–Analyse und Fourier–Synthese.<br />

Wir können uns f zum Beispiel als akustisches Signal vorstellen.<br />

Die Fourier–Analyse f ↦→ ˆf zerlegt das Signal f in sein Spektrum ˆf.<br />

Die Fourier–Synthese bildet aus dem Spektrum die ursprüngliche<br />

Aufnahme. Dabei geht keine Information verloren!<br />

Wir können aus dem Spektrum jedoch auch gewisse Frequenzen<br />

ausfiltern (abschwächen oder verstärken). Beispiel: Sie erinnern sich<br />

vielleicht an die Fußball-Weltmeisterschaft 2010 und das Brummen<br />

der Vuvuzela. Ihre typische Frequenz liegt bei ca. 230Hz und kann<br />

ausgefiltert werden durch (digitale) Fourier–Analyse–Synthese.<br />

Die Fourier–Isometrie ist höchst bemerkenswert und praktisch: Aus dem Signal f gewinnt man<br />

das Spektrum ˆf und umgekehrt rekonstruiert man aus dem Spektrum ˆf das Signal f.<br />

Die Aussage F −1 ◦ F = id L 2 und F ◦ F −1 = id l 2 bedeutet, dass F und F −1 zueinander<br />

inverse Bijektionen sind. Sie sind zudem C–linear, also sogar Vektorraum-Isomorphismen.<br />

Die Parseval–Gleichung besagt, dass F und F −1 die Norm erhalten: Für Funktionen f ist<br />

dies das obige Integral, für Folgen ˆf die obige Reihe. Geometrisch bedeutet dies, dass die<br />

Länge erhalten bleibt. Hieraus folgt bereits, dass auch Winkel und somit das Skalarprodukt<br />

erhalten bleiben: Das ist die verallgemeinerte Parseval–Gleichung.<br />

Wir sagen daher kurz, dass F und F −1 zueinander inverse Isometrien sind.<br />

Eine Isometrie R 2 → R 2 können Sie sich leicht vorstellen: Sie erhält alle Längen und Winkel<br />

und ist somit eine Drehung oder Spiegelung. Gleiches gilt auch für Isometrien des R 3 oder<br />

allgemein des R n . Die Fourier–Analyse f ↦→ ˆf ist eine Isometrie der unendlich-dimensionalen<br />

Räume L 2 ([0, 2π], C) und l 2 (Z, C). Diese Räume scheinen zunächst sehr verschieden: Folgen<br />

sind noch recht übersichtlich, während es viel mehr Funktionen zu geben scheint.<br />

Die Fourier–Isometrie L 2 ∼ = l 2 zeigt jedoch, dass sich beide Räume gleichen!<br />

Die Kraft der Fourier–Isometrie beruht darauf, dass man Probleme transformieren und hernach<br />

oft leichter lösen kann. Dies wollen wir an einem Anwendungsbeispiel illustrieren.

Lösung des isoperimetrischen Problems<br />

§R3.3, S.1357<br />

Lösung des isoperimetrischen Problems<br />

§R3.3, S.1358<br />

Wieviel Fläche kann man mit einem Zaun der Länge L abstecken?<br />

a<br />

a<br />

a<br />

a<br />

Beispiele:<br />

Quadrat: Seitenlänge a = L/4, Fläche F = a 2 = L 2 /16. . . gut.<br />

Kreis: Radius r = L/2π, Fläche F = πr 2 = L 2 /4π. . . besser!<br />

Geht noch mehr? Wie sieht eine optimale Kurve γ : [0, L] → R 2 aus? Dies ist ein klassisches<br />

Optimierungsproblem. Die Mythologie schreibt es Dido von Karthago (8. Jh. v Chr.) zu.<br />

Mathematisch wurde es 1902 von Hurwitz gelöst, und seine Berechnung ist ein Juwel!<br />

Satz R3C (Hurwitz 1902)<br />

Sei γ : [0, L] → R 2 stetig, stückweise stetig diff’bar, γ(0) = γ(L).<br />

Für den umschlossenen Flächinhalt F gilt dann immer F ≤ L 2 /4π.<br />

Gleichheit gilt nur, wenn γ einen Kreis vom Umfang L beschreibt.<br />

r<br />

Wir können L = 2π annehmen. Sei γ = γ 1 + iγ 2 mit γ 1 , γ 2 : R → R.<br />

Wir parametrisieren γ nach Bogenlänge, also |γ ′ | = 1 (stückweise).<br />

Hurwitz genialer Trick: Wir entwickeln γ und γ ′ in ihre Fourier–Reihen<br />

γ(t) = ∑ c k e ikt , γ ′ (t) ∼ ∑ ik c k e ikt .<br />

Dank Parseval–Gleichung wissen wir<br />

∞∑<br />

k 2 |c k | 2 = 1<br />

2π<br />

k=−∞<br />

ˆ 2π<br />

0<br />

|γ ′ (t)| 2 dt = 1<br />

Die umschlossene Fläche berechnen wir mit dem Satz von Green (1)<br />

und der verallgemeinerten Parseval–Gleichung (2) wie folgt:<br />

F (1)<br />

= 1 ˆ 2π<br />

γ 1 γ 2 ′ − γ 2 γ 1 ′ dt = 1 ˆ 2π [<br />

]<br />

Im (γ 1 − iγ 2 )(γ 1 ′ + iγ ′<br />

2 0<br />

2<br />

2) dt<br />

0<br />

[ ˆ 1 2π<br />

] [<br />

= π Im γγ ′ (2)<br />

∑ ∞ ] ∞∑<br />

dt = π Im c k · ikc k = π k|c k | 2 .<br />

2π<br />

0<br />

k=−∞<br />

k=−∞<br />

Lösung des isoperimetrischen Problems<br />

§R3.3, S.1359<br />

Lösung des isoperimetrischen Problems<br />

§R3.3, S.1360<br />

Wir vergleichen nun die Fläche F mit der Kreisfläche π, hier<br />

|F | ≤ π<br />

∞∑<br />

k=−∞<br />

|k| · |c k | 2 und π = π<br />

∞∑<br />

k=−∞<br />

Die erste Reihe ist termweise kleiner-gleich der zweiten:<br />

|F | − π ≤ π<br />

∞∑<br />

k=−∞<br />

(|k| − k 2 ) |c k | 2<br />

} {{ }<br />

≤ 0.<br />

≤0<br />

k 2 · |c k | 2 .<br />

Also gilt |F | ≤ π: Die Kreisfläche kann nicht übertroffen werden!<br />

Gleichheit gilt nur, wenn c k = 0 für alle k /∈ {−1, 0, 1}, also<br />

γ(t) = c −1 e −it + c 0 + c 1 e it .<br />

Wir wissen |c 1 | 2 + |c −1 | 2 = 1. Aus F = π folgt zudem |c 1 | 2 − |c −1 | 2 = 1.<br />

Also gilt |c 1 | = 1 und c −1 = 0. Das heißt, γ(t) = c 0 + c 1 e it beschreibt<br />

einen Kreis mit Mittelpunkt c 0 und Radius 1. Nur Kreise sind optimal!<br />

Dieses schöne Ergebnis bildet einen würdigen Schlusspunkt zu diesem Kapitel. Die Rechnung<br />

grenzt an Zauberei. Was passiert hier? Wir wollen periodische Funktionen R → R 2<br />

untersuchen, und bei gegebenem Umfang L die größtmögliche Fläche F finden. Der Raum<br />

aller Funktionen ist jedoch unübersichtlich. Die Fourier–Isometrie übersetzt dies in ein<br />

Problem über Reihen. Dieses ist wesentlich übersichtlicher und kann dann leicht gelöst werden.<br />

Kurz: Die Fourier–Analyse übersetzt ein schwieriges Problem in ein leichtes.<br />

Man beachte, dass wir wirklich die Isometrie–Eigenschaft benutzt haben: Sowohl die<br />

Parseval–Gleichung als auch ihre verallgemeinerte Fassung spielen eine wesentliche Rolle: Die<br />

Übersetzung erhält alle wesentlichen Informationen!<br />

Aufgabe: (nach einer Klausuraufgabe vom Februar 2012)<br />

Kann man mit 12m Zaun eine Fläche von 12m 2 umschließen?<br />

Kann man mit 13m Zaun eine Fläche von 13m 2 umschließen?<br />

Lösung: Nach der isoperimetrischen Ungleichung kann man mit einem Weg der Länge L<br />

maximal den Flächeninhalt L 2 /4π umschließen, und die Kreise erreichen dieses Optimum.<br />

Es gilt 12 < 4π < 13. Mit 12m Zaun kann man also höchstens (12m) 2 /4π < 12m 2<br />

umschließen. Mit 13m Zaun hingegen erhält man bei Kreisform (13m) 2 /4π > 13m 2 .

Fazit: Fourier–Analyse<br />

S.1361<br />

Erläuterung<br />

Fazit: Differenzieren und Integrieren<br />

S.1362<br />

Erinnerung<br />

Die Funktion f : R → C sei T –periodisch und auf [0, T ] integrierbar.<br />

Wir zerlegen f in Harmonische zur Grundfrequenz ω = 2π/T :<br />

f(t) ∼<br />

∞∑<br />

k=−∞<br />

ˆf(k) e ikωt mit ˆf(k) =<br />

1<br />

T<br />

ˆ T<br />

t=0<br />

e −ikωt f(t) dt<br />

Diese Analyse zerlegt das Signal f in sein Spektrum ˆf : Z → C.<br />

Linearität: Aus f = αg + βh mit α, β ∈ C folgt ˆf = αĝ + βĥ.<br />

Konjugation: Aus f = g folgt ˆf(k) = ĝ(−k).<br />

Ist f = f reell, so folgt ˆf(−k) = ˆf(k).<br />

Ist f gerade bzw. ungerade, so gilt ˆf(−k) = ± ˆf(k).<br />

Zur Vereinfachung betrachten wir meist den Fall T = 2π und ω = 1.<br />

Fourier–Reihen können wir formal integrieren und ableiten:<br />

Ist f integrierbar und F (t) = ´ t<br />

0<br />

f(τ) dτ eine Integralfunktion, so gilt<br />

f(t) ∼<br />

∞∑<br />

k=−∞<br />

k≠0<br />

ˆf(k) e ikωt ⇐⇒ F (t) ∼ c 0 +<br />

∞∑<br />

k=−∞<br />

k≠0<br />

ˆf(k)<br />

ikω e ikωt<br />

Der Koeffizient c 0 spielt hierbei die Rolle der Integrationskonstanten.<br />

Man kann c 0 berechnen durch Integration oder Punktprobe F (0) = 0.<br />

Glattheit von f entspricht schnellem Abklingen von ˆf:<br />

Für jede integrierbare Funktion f gilt ˆf(k) → 0 für |k| → ∞.<br />

Ist f sogar n–mal stetig differenzierbar, so folgt k n ˆf(k) → 0.<br />

Umgekehrt: Gilt ˆf(k) ≤ c/|k| 1+α für alle k ≠ 0 und Konstanten c, α > 0,<br />

dann konvergiert ∑ ˆf(k)ek gleichmäßig gegen eine stetige Funktion f.<br />

Gilt sogar ˆf(k) ≤ c/|k| n+1+α , so ist f mindestens n–mal stetig diff’bar.<br />

Fazit: reelle Schreibweise<br />

S.1363<br />

Erläuterung<br />

Fazit: Dirichlet–Kriterium<br />

S.1364<br />

Erläuterung<br />

Für die reelle Schreibweise erinnern wir an das vorige Kapitel:<br />

f(t) ∼ a 0<br />

∞<br />

2 + ∑<br />

a k cos(kωt) + b k sin(kωt) =<br />

k=1<br />

∞∑<br />

ˆf(k)e ikωt .<br />

k=−∞<br />

Aufgrund der Euler–Formel e ikωt = cos(kωt) + i sin(kωt) gilt<br />

Zu f wie oben betrachten wir das n–te Fourier–Polynom<br />

f n (t) ∼<br />

n∑<br />

k=−n<br />

ˆf(k)e ikωt<br />

Wir sagen, die Fourier–Reihe von f konvergiert im Punkt x ∈ R,<br />

wenn die Zahlenfolge f n (x) ∈ C für n → ∞ konvergiert.<br />

a k = ˆf(k) + ˆf(−k), b k = i [ ˆf(k) − ˆf(−k)<br />

]<br />

,<br />

ˆf(k) = a k − ib k<br />

2<br />

a k + ib k<br />

, ˆf(−k) = .<br />

2<br />

Im Falle a 0 = 0 können wir dies formal integrieren zu<br />

F (t) ∼ const +<br />

∞∑<br />

k=1<br />

−b k<br />

kω cos(kωt) + a k<br />

kω sin(kωt).<br />

Angenommen, in x ∈ R existieren die einseitigen Grenzwerte f(x±).<br />

Wenn die Fourier–Reihe in x konvergiert, dann gegen den Mittelwert:<br />

f n (x) → 1 2<br />

[<br />

]<br />

f(x+) + f(x−)<br />

für n → ∞.<br />

Angenommen, es existieren die einseitigen Grenzwerte f(x±) und<br />

zudem die einseitigen Ableitungen f ′ (x±). Dann konvergiert die<br />

Fourier–Reihe von f im Punkt x, und zwar gegen obigen Mittelwert.<br />

Spezialfall: Ist f in x differenzierbar, so folgt f n (x) → f(x).

Fazit: Bestapproximation<br />

S.1365<br />

Erläuterung<br />

Fazit: Konvergenz im quadratischen Mittel<br />

S.1366<br />

Erläuterung<br />

Sei f : [0, T ] → C quadrat-integrierbar, das heißt ´ T<br />

0 |f(t)|2 dt < ∞.<br />

Sei f n (t) = ∑ n<br />

k=−n c ke ikωt eine Approximation mit beliebigen c k ∈ C.<br />

Der mittlere quadratische Fehler ‖f − f n ‖ wird genau dann minimal,<br />

wenn f n das Fourier–Polynom ist, also c k die Fourier–Koeffizienten.<br />

Hieraus folgt die Bessel–Ungleichung ‖f n ‖ 2 ≤ ‖f‖ 2 , ausgeschrieben<br />

n∑<br />

| ˆf(k)| 2 ≤ 1 T<br />

k=−n<br />

ˆ T<br />

0<br />

|f(t)| 2 dt.<br />

Für f(t) ∼ a 0<br />

2<br />

+ ∑ ∞<br />

k=1 a k cos(kωt) + b k sin(kωt) bedeutet das<br />

a 2 0<br />

n∑<br />

2 + a 2 k + b2 k ≤ 2 T<br />

k=1<br />

ˆ T<br />

0<br />

|f(t)| 2 dt.<br />

Sei f : [0, T ] → C integrierbar mit Spektrum ˆf : Z → C.<br />

Genau dann ist f quadrat-integrierbar, also ´ T<br />

0 |f(t)|2 dt < ∞,<br />

wenn die Koeffizienten quadrat–summierbar sind, also ∑ | ˆf(k)| 2 < ∞.<br />

In diesem Fall konvergieren die Fourier–Polynome f n im quadratischen<br />

Mittel gegen die Funktion f, es gilt also ‖f − f n ‖ → 0 für n → ∞.<br />

Die Bessel–Ungleichung wird dann zur Parseval–Gleichung:<br />

∞∑<br />

k=−∞<br />

| ˆf(k)| 2 = 1 T<br />

ˆ T<br />

0<br />

|f(t)| 2 dt.<br />

Für f(t) ∼ a 0<br />

2<br />

+ ∑ ∞<br />

k=1 a k cos(kωt) + b k sin(kωt) bedeutet das<br />

a 2 0<br />

n∑<br />

2 + a 2 k + b2 k = 2 T<br />

k=1<br />

ˆ T<br />

0<br />

|f(t)| 2 dt.<br />

Fazit: Fourier–Isometrie<br />

S.1367<br />

Erläuterung<br />

Fazit: Fourier–Isometrie<br />

S.1368<br />

Erläuterung<br />

Die Fourier–Isometrie ist diese Analyse / Synthese:<br />

L 2 ([0, T ], C) ∼ = l 2 (Z, C),<br />

Norm und Skalarprodukt bleiben dabei erhalten:<br />

Die Parseval–Gleichung besagt nämlich<br />

‖f‖ = ‖ ˆf‖,<br />

also<br />

1<br />

T<br />

ˆ T<br />

0<br />

|f(t)| 2 dt =<br />

f ↔ ˆf<br />

∞∑<br />

k=−∞<br />

| ˆf(k)| 2 .<br />

Besser noch, es gilt die verallgemeinerte Parseval–Gleichung<br />

Zusammenfassung: Aus dem Signal f gewinnt man das Spektrum ˆf<br />

und umgekehrt rekonstruiert man aus dem Spektrum ˆf das Signal f.<br />

Dieses Kapitel behandelt ausschließlich periodische Funktionen<br />

f : R → C, also f(t + T ) = f(t) für eine Periode T > 0 und alle t ∈ R.<br />

Im nächsten Kapitel übertragen wir die Ergebnisse soweit möglich auf<br />

nicht-periodische Funktionen mittels Fourier–Transformation.<br />

〈 f | g 〉 = 〈 ˆf | ĝ 〉, also<br />

1<br />

T<br />

ˆ T<br />

0<br />

f(t)g(t) dt =<br />

∞∑<br />

k=−∞<br />

ˆf(k)ĝ(k).