Notes de cours (pdf) - UFR Mathématiques et Informatique

Notes de cours (pdf) - UFR Mathématiques et Informatique

Notes de cours (pdf) - UFR Mathématiques et Informatique

- No tags were found...

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

<strong>UFR</strong> DE MATHÉMATIQUES ET INFORMATIQUELicence MIA, L3<strong>Notes</strong> <strong>de</strong> <strong>cours</strong>OptimisationGeorges Koepfler 2006-2010 - georges.koepfler@mi.paris<strong>de</strong>scartes.fr

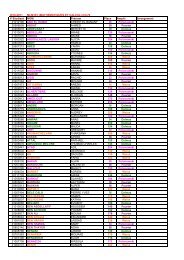

Table <strong>de</strong>s matières1 Introduction 12 Espace vectoriels normés 33 Espaces vectoriels normés <strong>de</strong> dimension finie 44 Espaces euclidiens. Espaces <strong>de</strong> Hilbert 55 Théorème <strong>de</strong> projection 75.1 Applications . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 85.2 Métho<strong>de</strong> <strong>de</strong>s moindres carrés . . . . . . . . . . . . . . . . . . . . . . . . . . 86 Adjoint d’un endomorphisme 107 Dérivée directionnelle, dérivées partielles, différentiabilité 128 Caractérisation <strong>de</strong>s points optimaux 169 Fonctions convexes 1710 Multiplicateurs <strong>de</strong> Lagrange 20Avertissement : ces notes sont un support <strong>et</strong> complément du <strong>cours</strong> magistral.Leur contenu n’est pas équivalent au <strong>cours</strong> enseigné, en particulier les examens<strong>et</strong> contrôles se réfèrent au <strong>cours</strong> enseigné uniquement.Bibliographie. Les références suivantes peuvent être utiles mais dépassent leniveau <strong>de</strong> ce <strong>cours</strong>.• H. Cartan, Cours <strong>de</strong> calcul différentiel, Hermann 1997.• J.E. Rombaldi, Analyse matricielle. Cours <strong>et</strong> exercices résolus, EDP Sciences1999.• P.G. Ciarl<strong>et</strong>, Introduction à l’analyse matricielle <strong>et</strong> à l’optimisation, Masson1990.

Georges KOEPFLER : Optimisation - L3 2009-2010 11 IntroductionDans ce <strong>cours</strong> on va introduire <strong>de</strong>s outils mathématiques pour résoudre un problèmed’optimisation dont la forme abstraite générale est la suivante :Soit E un ensemble, K ⊂ E <strong>et</strong> une application J : E −→ R, on veut résoudre leproblème{x ⋆ ∈ K(P) J(x ∗ ) = inf J(x)x∈KOn dit que (P) est un problème d’optimisation ou problème <strong>de</strong> minimisation <strong>de</strong> la fonctionJ sous la contrainte x ∈ K.Si K = E on a un problème sans contrainte. La fonction J est appelée fonction coût,fonction objectif, fonction économique.En remplaçant J par −J on transforme un problème <strong>de</strong> maximisation en problème <strong>de</strong>minimisation.Un point x ∗ est un minimum local <strong>de</strong> J sur K s’il existe un voisinage V <strong>de</strong> x ∗ tel queJ(x ∗ ) ≤ J(x) pour tout x ∈ K ∩ V.Un point x ∗ est un minimum local strict <strong>de</strong> J sur K s’il existe un voisinage V <strong>de</strong> x ∗ telque J(x ∗ ) < J(x) pour tout x ∈ K ∩ V, x ≠ x ∗ .Une suite (x n ) n∈N <strong>de</strong> points <strong>de</strong> K est une suite minimisante si lim J(x n) = inf J(x).n→+∞ x∈KUne telle suite existe toujours, par définition <strong>de</strong> inf, par contre on ne sait rien au suj<strong>et</strong> <strong>de</strong>sa convergence éventuelle.Pour résoudre le problème (P), il faut se poser les questions suivantes :• Est-ce que inf J(x) existe ? c.à.d. est-ce que J est bornée inférieurement?x∈K• Est-ce que l’infimum est atteint dans K ? c.à.d. est-ce qu’il existe x ⋆ ∈ K vérifiantJ(x ∗ ) = min J(x)?x∈K• Est-ce que x ⋆ est unique ? Sinon, quelle est la taille <strong>de</strong> l’ensemble <strong>de</strong>s solutions?• Est-ce que l’on peut caractériser x ⋆ ? c.à.d. peut-on trouver <strong>de</strong>s conditions nécessairespour caractériser un minimum :si x vérifie (P), alors x vérifie la propriété N(x)<strong>et</strong>/ou trouver <strong>de</strong>s conditions suffisantes pour être un point optimal :si x vérifie la propriété S(x), alors x vérifie (P).• Trouver un algorithme d’optimisation pour déterminer la, resp. les, solutions <strong>de</strong> (P).Pour répondre à ces questions on est en particulier amené à étudier- la structure <strong>de</strong> E : espace vectoriel, muni d’une norme, d’un produit scalaire, <strong>de</strong> dimensionfinie ou infinie, ...- les propriétés <strong>de</strong> K ⊂ E : fermé, borné, convexe, ...- les propriétés <strong>de</strong> J : E −→ R : continuité, différentiabilité, convexité, ...Dans les chapitres suivants on va donner <strong>de</strong>s éléments <strong>de</strong> réponse à ces questions.

Georges KOEPFLER : Optimisation - L3 2009-2010 32 Espace vectoriels normésSoit E un espace vectoriel sur R (ce sera le cas pour toute la suite <strong>de</strong> ce <strong>cours</strong>).Définition 2.1Une norme sur E est une application x ↦→ ‖x‖ <strong>de</strong> E dans R + telle queExemples :(i) ∀x ∈ E : ‖x‖ = 0 ⇔ x = O E(ii) ∀x ∈ E; ∀λ ∈ R : ‖λx‖ = |λ| ‖x‖(iii) ∀(x, y) ∈ E × E : ‖x + y‖ ≤ ‖x‖ + ‖y‖1. Soit E = R d , pour x = (x 1 , . . ., x d ) ∈ R d on définit les normes :‖x‖ 1 =(d∑d∑|x i | , ‖x‖ 2 =i=1i=1|x i | 2 ) 1/2, ‖x‖ ∞ = max1≤i≤d |x i| .On a les inégalités classiques suivantes :∀x ∈ R d : ‖x‖ ∞ ≤ ‖x‖ 2 ≤ ‖x‖ 1 <strong>et</strong> ‖x‖ 1 ≤ √ d‖x‖ 2 ≤ d‖x‖ ∞ .2. Soit E = C([a, b], R), l’espace vectoriel, <strong>de</strong> dimension infinie, <strong>de</strong>s fonctions réellescontinues sur l’intervalle [a, b]. Pour f ∈ E on définit les normes :‖f‖ 1 =∫ bOn a les inégalités :a(∫ b|f(t)| dt , ‖f‖ 2 =a1/2|f(t)| dt) 2 , ‖f‖ ∞ = max |f(t)| .[a,b]∀f ∈ C([a, b], R) : ‖f‖ 1 ≤ √ b − a ‖f‖ 2 ≤ (b − a) ‖f‖ ∞ .Dans ce cas on n’a pas les inégalités inverses : Soit n ≥ 2, posons, pour x ∈ [0, 1/n],f n (x) = −2n 2 x+2n <strong>et</strong> pour x ∈ [1/n, 1], f n (x) = 0. Alors ‖f n ‖ 1 = 1 <strong>et</strong> ‖f n ‖ ∞ = 2n,l’on ne peut avoir ‖f n ‖ ∞ ≤ c · ‖f n ‖ 1 .Exercice : Étudier la suite <strong>de</strong> fonctions (f n) <strong>de</strong> E, définie, pour n ≥ 3 par :⎧0 pour x ∈ [0, α ⎪⎨n ]t − α nf n (x) = pour x ∈ [α n , β n ] où α⎪⎩ β n − α n = 1/2 − 1/n <strong>et</strong> β n = 1/2 + 1/n.n1 pour x ∈ [β n , 1]La suite <strong>de</strong> fonctions converge simplement vers la fonction f ∉ E définie par⎧⎨ 0 pour x ∈ [0, 1/2[f(x) = 1/2 pour x = 1/2 .⎩1 pour x ∈]1/2, 1]On a ‖f n −f‖ 1 ≤ 1/n, ‖f n −f‖ 2 ≤ 1/ √ n <strong>et</strong> ‖f n −f‖ ∞ = 1/2. On a donc convergence<strong>de</strong> f n vers f pour ‖.‖ 1 <strong>et</strong> ‖.‖ 2 , mais pas convergence uniforme ‖.‖ ∞ .Les espaces (E, ‖.‖ 1 ) <strong>et</strong> (E, ‖.‖ 2 ) ne sont pas compl<strong>et</strong>s, tandis que (E, ‖.‖ ∞ ) estcompl<strong>et</strong>.2 ESPACE VECTORIELS NORMÉS

4 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris DescartesProposition 2.1Les applications E × E → E ; R × E → E ; E → R +(x, y) ↦→ x + y (λ, x) ↦→ λx x ↦→ ‖x‖sont continues.Proposition 2.2Soient (E, ‖.‖ E ) <strong>et</strong> (F, ‖.‖ F ) <strong>de</strong>s e.v.n., Φ : E → F une application linéaire, alorsΦ est continue ⇔ ∃c > 0, ∀x ∈ E : ‖Φ(x)‖ F ≤ c‖x‖ E .Proposition 2.3Soient (E, ‖.‖ E ) <strong>et</strong> (F, ‖.‖ F ) <strong>de</strong>s e.v.n. On note L(E, F) l’e.v. <strong>de</strong>s applications linéairescontinues <strong>de</strong> E dans F.Pour f ∈ L(E, F) on pose ‖f‖ = sup ‖f(x)‖ F .‖x‖ E ≤1Alors : (i) f ↦→ ‖f‖ est une norme sur L(E, F);(ii) ∀x ∈ E : ‖f(x)‖ F ≤ ‖f‖ ‖x‖ E ;‖f(x)‖ F(iii) ‖f‖ = sup ‖f(x)‖ F = sup ‖f(x)‖ F = sup‖x‖ E ≤1‖x‖ E =1x∈E,x≠O E‖x‖ EApplication : Si dim E = n <strong>et</strong> dim F = m alors f : E → F linéaire est représenté parune matrice A <strong>de</strong> m lignes <strong>et</strong> n colonnes, on peut alors définir une norme <strong>de</strong> matricesubordonnée aux normes vectorielles par‖Ax‖ F‖A‖ = sup ‖Ax‖ F = sup .‖x‖ E =1 x∈E,x≠O E‖x‖ EProposition 2.4Soit (E, ‖.‖ E ) un e.v.n. On note E ′ = L(E, R) l’e.v. <strong>de</strong>s formes linéaires continues sur E,alors :Une forme linéaire f ∈ E ′ si <strong>et</strong> seulement si ker f est fermé dans E.3 Espaces vectoriels normés <strong>de</strong> dimension finieProposition 3.1Soit (E, ‖.‖) un e.v. normé <strong>de</strong> dimension finie d, soit {e 1 , . . .,e d } une base <strong>de</strong> E.Alors l’application Φ : (R d , ‖.‖ ∞ ) → (E, ‖.‖) est une bijection continue.d∑α = (α 1 , . . .,α d ) ↦→ α i e iDe plus Φ −1 est aussi continue, Φ est donc un isomorphisme topologique <strong>de</strong> R d sur E.i=1Note : Grâce à l’isomorphisme Φ on obtient <strong>de</strong> nombreux corollaires qui facilitent lamanipulation <strong>de</strong>s e.v. <strong>de</strong> dimension finie.

Georges KOEPFLER : Optimisation - L3 2009-2010 5Corollaire 3.1Sur un e.v. E <strong>de</strong> dimension finie toutes les normes sont équivalentes :∃c 1 , c 2 ∈ R ∗ +, ∀x ∈ E : c 1 ‖x‖ ′ ≤ ‖x‖ ≤ c 2 ‖x‖ ′ .Corollaire 3.2Soit (E, ‖.‖) un e.v. normé <strong>de</strong> dimension finie, alors E est compl<strong>et</strong>.Corollaire 3.3Soient (E, ‖.‖ E ) <strong>et</strong> (F, ‖.‖ F ) <strong>de</strong>s e.v.n., on suppose que E est <strong>de</strong> dimension finie. Alorstoute application linéaire <strong>de</strong> E dans F est continue.Proposition 3.2Soit (E, ‖.‖) un e.v.n., F un sous-espace vectoriel fermé dans (E, ‖.‖) <strong>et</strong> W un sous-espacevectoriel <strong>de</strong> dimension finie. Alors W +F est un sous-espace vectoriel fermé dans (E, ‖.‖).Corollaire 3.4Soit W un sous-espace vectoriel <strong>de</strong> dimension finie d’un e.v.n. (E, ‖.‖), alors W est fermédans (E, ‖.‖).4 Espaces euclidiens. Espaces <strong>de</strong> HilbertSoit E un e.v. réel <strong>et</strong> φ : E × E → R une forme bilinéaire symétrique, i.e.(1 ) ∀(x, y) ∈ E 2 : φ(x, y) = φ(y, x);(2 ) ∀(x 1 , x 2 , y) ∈ E 3 , ∀(λ 1 , λ 2 ) ∈ R 2 : φ(λ 1 x 1 + λ 2 x 2 , y) = λ 1 φ(x 1 , y) + λ 2 φ(x 2 , y);(2’) ∀(x, y 1 , y 2 ) ∈ E 3 , ∀(µ 1 , µ 2 ) ∈ R 2 : φ(x, µ 1 y 1 + µ 2 y 2 ) = µ 1 φ(x, y 1 ) + µ 2 φ(x, y 2 ) .On dit que φ est positive ou semi-définie positive si : ∀x ∈ E : φ(x, x) ≥ 0.On dit que φ est non dégénérée si : ∀x ∈ E : φ(x, x) = 0 ⇔ x = O E .Si φ est positive <strong>et</strong> non dégénérée, on dit que φ est définie positive.Définition 4.1Une forme symétrique, bilinéaire, définie positive φ est un produit scalaire sur E.L’application x ↦→ φ(x, x) 1/2 définit alors une norme sur E.On note φ(x, y) =< x, y >= (x/y) <strong>et</strong> < x, x >= ‖x‖ 2 .Définition 4.2• Un e.v. E, muni d’un produit scalaire < ., . > est un espace préhilbertien.• Un espace préhilbertien (E, < ., . >) est un espace <strong>de</strong> Hilbert s’il est compl<strong>et</strong> pour lanorme associée à < ., . >.• Un e.v. E <strong>de</strong> dimension finie, muni d’un produit scalaire < ., . > est un espace euclidien.4 ESPACES EUCLIDIENS. ESPACES DE HILBERT

6 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris DescartesExemples1. Soit E = R d , pour x = (x 1 , . . ., x d ), x = (y 1 , . . .,y d ) ∈ R d on définit :< x, y >=d∑x i y i , < x, x >=i=1d∑x 2 i = ‖x‖2 2 .i=1(R d , < ., . >) est un espace euclidien.2. Soit E = C([a, b], R), pour f, g ∈ E on définit :< f, g >=∫ bf(t)g(t) dt , < f, f >=∫ baa(E, < ., . >) est un espace préhilbertien.f(t) 2 dt = ‖f‖ 2 2 .Proposition 4.1Soit φ une forme bilinéaire, symétrique, on a les égalités suivantes :• ∀x, y ∈ E : φ(x + y, x + y) = φ(x, x) + 2φ(x, y) + φ(y, y);• Égalité <strong>de</strong> polarisation :∀x, y ∈ E : φ(x + y, x + y) − φ(x − y, x − y) = 4φ(x, y);• Égalité du parallélogramme :∀x, y ∈ E : φ(x + y, x + y) + φ(x − y, x − y) = 2(φ(x, x) + φ(y, y)) .Si φ est <strong>de</strong> plus positive, on a :• Inégalité <strong>de</strong> Cauchy-Schwarz :∀x, y ∈ E : |φ(x, y)| ≤ φ(x, x) 1/2 φ(y, y) 1/2 ;• Inégalité <strong>de</strong> Minkowsky ou triangulaire :∀x, y ∈ E : φ(x + y, x + y) 1/2 ≤ φ(x, x) 1/2 + φ(y, y) 1/2 ;Soit (x, y) ∈ E, si φ(x, y) = 0 on dit que x <strong>et</strong> y sont orthogonaux pour φ.Proposition 4.2Soit < ., . > un produit scalaire sur E, alors• on a | < x, y > | =< x, x > 1/2 < y, y > 1/2 = ‖x‖ ‖y‖ si <strong>et</strong> seulement siil existe λ ∈ R tel que y = λx;• l’inégalité <strong>de</strong> Cauchy-Schwarz perm<strong>et</strong> <strong>de</strong> définir l’angle, ∢(x, y), entre <strong>de</strong>ux vecteursnon nuls x <strong>et</strong> y, tel que< x, y >= ‖x‖ ‖y‖ cos( )∢(x, y) .• ∀y ∈ E :< x, y >= 0 ⇔ x = O E , c.à.d. le vecteur nul, O E , est l’unique vecteur qui estorthogonal à tous les vecteurs <strong>de</strong> E.

Georges KOEPFLER : Optimisation - L3 2009-2010 75 Théorème <strong>de</strong> projectionDéfinition 5.1Soit E un e.v. réel <strong>et</strong> K ⊂ E, on dit que K est convexe siOn note encore [x, y] ⊂ K.∀(x, y) ∈ K 2 , ∀t ∈ [0, 1] : t x + (1 − t) y ∈ K .Théorème 5.1 (Projection sur un convexe fermé)Soit (E, < ., . >) un espace <strong>de</strong> Hilbert <strong>et</strong> K ⊂ E un sous-ensemble convexe, fermé <strong>et</strong> nonvi<strong>de</strong>.• Pour tout x ∈ E, il existe un unique x ∗ ∈ K tel que‖x − x ∗ ‖ = min ‖x − v‖ (1)v∈KOn note alors x ∗ = P K x la projection <strong>de</strong> x sur K, <strong>de</strong> plus (1) est équivalent à(2){x ∗ ∈ K< x − x ∗ , v − x ∗ > ≤ 0 ∀v ∈ K• L’application P K : E → K vérifie :∀(x, y) ∈ E 2 : ‖P K x − P K y‖ ≤ ‖x − y‖ ,c.à.d. la projection n’augmente pas les distances.• L’application P K : E → K est linéaire si <strong>et</strong> seulement si K est un sous-espace vectoriel,dans ce cas (1) est équivalent à :{ x(3)∗ ∈ K< x − x ∗ , v >= 0 ∀v ∈ Kc.à.d. le vecteur x − x ∗ = −→ x ∗ x est orthogonal à K.xvx ∗K5 THÉORÈME DE PROJECTION

8 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris Descartes5.1 ApplicationsExemple 1 : On veut déterminer α = min(a,b)∈R 2 ∫ 10(t 2 − at − b) 2 dt.On considère l’espace vectoriel <strong>de</strong>s fonctions polynomiales <strong>de</strong> <strong>de</strong>gré <strong>de</strong>uxE = {p : [0, 1] → R / p(t) = a 2 t 2 + a 1 t + a 0 , (a 0 , a 1 , a 2 ) ∈ R 3 }que l’on munit du produit scalaire < p, q >=∫ 10p(t)q(t) dt.(E, < ., . >) est un espace euclidien <strong>et</strong> K = {u : [0, 1] → R / u(t) = a 1 t + a 0 , (a, b) ∈ R 2 }est un sous-espace vectoriel <strong>de</strong> dimension finie 2, c’est donc un sous-ensemble fermé,convexe.Le problème initial s’écrit alors : chercher α = min ‖p −u∈K u‖2 2 pour p(t) = t 2 .D’après le théorème <strong>de</strong> la projection, il existe P K p = p ∗ ∈ K unique, vérifiant‖p − p ∗ ‖ 2 = min ‖p − v‖ 2, la fonction affine p ∗ sera la projection orthogonale <strong>de</strong> p(t) = t 2v∈Ksur le plan vectoriel K.On détermine facilement p ∗ en utilisant la caractérisation (3) :∀v ∈ K, 0 =< p − p ∗ , v >=∫ 10(t 2 − at − b)v(t) dt .On prenant pour v les fonctions t ↦→ 1 <strong>et</strong> t ↦→ t qui forment une base <strong>de</strong> K, l’on obtient :{1/2 a+ b = 1/3d’où a = 1 , b = −1/6 <strong>et</strong> α = ‖t 2 −P1/3 a+ 1/2 b = 1/4K (t 2 )‖ 2 = ‖t 2 −t+1/6‖ 2 = 1/180 .Exemple 2 : Pour x = (x 1 , x 2 ) ∈ R 2 , ‖x‖ ∞ > 1, trouver le rayon r du plus granddisque fermé B 2 (x, r) qui a un seul point <strong>de</strong> contact avec le carré [−1, +1] 2 . Donner lescoordonnées <strong>de</strong> ce point.On considère ce problème dans l’espace euclidien standard (R 2 , < ., . >),K = [−1, +1] 2 est un ensemble fermé <strong>et</strong> convexe.Si y = (y 1 , y 2 ) ∈ K , alors la distance <strong>de</strong> x à y est ‖x −y‖, le point cherché x ∗ vérifie doncr = ‖x − x ∗ ‖ = miny∈K‖x − y‖.⎧⎨Donc x ∗ = (x ∗ 1, x ∗ 2) = P K (x) existe <strong>et</strong> est unique, <strong>et</strong> x ∗ i =⎩Noter que P K n’est pas linéaire.−1 si x i ≤ −1x i si |x i | ≤ 11 si x i ≥ 1.5.2 Métho<strong>de</strong> <strong>de</strong>s moindres carrésRésolution <strong>de</strong> systèmes linéaires.Soit A une matrice <strong>de</strong> taille (m, n), b ∈ R m , on cherche à déterminer la solution x ∈ R n ,du système linéaire à m équations <strong>et</strong> n inconnues : Ax = b.Si m = n <strong>et</strong> A inversible il existe une solution unique x = A −1 b ;si m > n on a un problème surdéterminé <strong>et</strong>, en général, il n’existe aucune solution <strong>de</strong>l’équation Ax = b ;5.1 Applications

Georges KOEPFLER : Optimisation - L3 2009-2010 9si m < n on a un problème sous-déterminé <strong>et</strong> on peut avoir une infinité <strong>de</strong> solutionsvérifiant le système linéaire.On dit que x ∗ ∈ R n est solution du système Ax = b au sens <strong>de</strong>s moindres carrés si x ∗minimise ‖Ax − b‖ 2/R m .Ici E = R m <strong>et</strong> K = ImA s.e.v. <strong>de</strong> R m , donc fermé <strong>et</strong> convexe.Approximation.Dans le second exemple <strong>de</strong> la page 2, on a considéré le problème sans contraintes :⎛m∑min ⎝n∑⎞ 2 x∈R n ∣ y i − x j w j (t i )⎠ .∣i=1j=1C’est une minimisation au sens <strong>de</strong>s moindres carrés qui revient à minimiser minx∈R n ‖y − Ax‖ 2/R m ,où A est la matrice à m lignes <strong>et</strong> n colonnes, d’éléments A i,j = w j (t i ).Cas particulier : si m(t) = x 1 + x 2 t, on veut adapter une droite aux nuage <strong>de</strong> points(t i , y i ), on parle alors <strong>de</strong> régression linéaire.Une interprétation statistique <strong>de</strong> la métho<strong>de</strong> <strong>de</strong>s moindres carrés est donnée par l’exempleplus général suivant.Maximum <strong>de</strong> vraisemblance.Dans un dispositif expérimental on mesure aux instants t i les données y i (1 ≤ i ≤ m),or le phénomène étudié est modélisé grâce à une fonction φ qui dépend du temps t <strong>et</strong> <strong>de</strong>paramètres x ∈ R n .On note ǫ i = y i −φ(x, t i ), la différence entre le modèle <strong>et</strong> les observations <strong>et</strong> l’on supposeque ces erreurs sont indépendantes <strong>et</strong> i<strong>de</strong>ntiquement distribués (i.i.d.) <strong>de</strong> loi N(0, σ 2 ) <strong>et</strong><strong>de</strong> <strong>de</strong>nsité g σ (ǫ) = √ 12πσexp (− ǫ2 ).2σ 2La vraisemblance <strong>de</strong>s observations y j , j = 1,...,m, est donnée par()m∏ 1L(y; x, σ) = g σ (ǫ i ) = exp − 1 m∑ (y i − φ(x, t i )) 2.(2πσ 2 ) − m 2 2 σ 2i=1Pour obtenir le maximum <strong>de</strong> vraisemblance, à σ fixé, il faut déterminer1minx 2m∑(y j − φ(x, t i )) 2 ,c.-à-d. résoudre un problème <strong>de</strong>s moindres carrés non linéaire.i=1Ici K = {(φ(x, t 1 ), . . .,φ(x, t m )) / x ∈ R n } ⊂ R m dépend <strong>de</strong> façon non linéaire <strong>de</strong> x àtravers φ. On ne peut pas appliquer le théorème directement.i=15 THÉORÈME DE PROJECTION

10 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris Descartes6 Adjoint d’un endomorphismeLemme 6.1Soit (E, < ., . >) un espace euclidien, f <strong>et</strong> g <strong>de</strong>s applications <strong>de</strong> E dans E, on a :f = g ⇔ ∀(x, y) ∈ E 2 : < x, f(y) >=< x, g(y) > .Proposition 6.1Soit (E, < ., . >) un espace euclidien, u ∈ L(E) un endomorphisme <strong>de</strong> E.Il existe un élément u ∗ ∈ L(E) unique, vérifiant :∀(x, y) ∈ E 2 : < u(x), y >=< x, u ∗ (y) > .On appelle u ∗ l’endomorphisme adjoint <strong>de</strong> u.Proposition 6.2Soient u <strong>et</strong> v <strong>de</strong>s éléments <strong>de</strong> L(E), α, β <strong>de</strong>s réels, alors :(α u + β v) ∗ = α u ∗ + β v ∗ ; (u ∗ ) ∗ = u ; (u ◦ v) ∗ = v ∗ ◦ u ∗ ;ker u ∗ = (Im u) ⊥ ; Im u ∗ = (ker u) ⊥ .Définition 6.1Soit (E, < ., . >) un espace euclidien, u ∈ L(E) :• u est dit autoadjoint ou symétrique si <strong>et</strong> seulement si u ∗ = u ;• u est dit orthogonal si <strong>et</strong> seulement si u ◦ u ∗ = Id E , resp. u ∗ = u −1 ;• u est dit antisymétrique si <strong>et</strong> seulement si u ∗ = −u ;• u est dit normal si <strong>et</strong> seulement si u ◦ u ∗ = u ∗ ◦ u.Remarques :Un endomorphisme autoadjoint vérifie : ∀(x, y) ∈ E 2 : < u(x), y >=< x, u(y) >.Un endomorphisme orthogonal vérifie : ∀(x, y) ∈ E 2 : < u(x), u(y) >=< x, y >.Proposition 6.3 (Écriture matricielle)Soit (E, < ., . >) un espace euclidien <strong>et</strong> B = {e 1 , . . .,e n } une base <strong>de</strong> E.⎛ ⎞n∑x 1Au vecteur x = x i e i ∈ E on associe le vecteur <strong>de</strong> coordonnées X = ⎝ . ⎠ ∈ M(n, 1).i=1x nSoit φ une forme bilinéaire sur E 2 , on note Φ = (φ(e i , e j )) 1≤i,j≤n ∈ M(n, n), la matriceassociée à φ dans la base B, alors∀(x, y) ∈ E 2 : φ(x, y) = X t ΦY .En particulier, pour S = (< e i , e j >) 1≤i,j≤n on a : < x, y >= X t S Y .Soit u ∈ L(E), on note U = Mat B u <strong>et</strong> U ∗ = Mat B u ∗ , alors U ∗ = S −1 U t S .

Georges KOEPFLER : Optimisation - L3 2009-2010 11Cas particulier important :la base B est orthonormée, alors S = I n ,< x, y >= X t Y <strong>et</strong> U ∗ = U t .Si u est autoadjoint, la matrice U est symétrique U = U t .Si u est orthogonal, la matrice U vérifie U t = U −1 .Les propriétés <strong>de</strong> la proposition 6.2 se traduisent matriciellement <strong>de</strong> façon évi<strong>de</strong>nte :(U t ) t = U <strong>et</strong> (UV ) t = V t U t .Proposition 6.4 (Réduction d’une forme quadratique)Soit (E, < ., . >) un espace euclidien <strong>et</strong> B = {e 1 , . . .,e n } une base <strong>de</strong> E.Soit φ une forme bilinéaire symétrique sur E 2 <strong>et</strong> q la forme quadratique associée définie,pour tout x ∈ E, par q(x) = φ(x, x).La matrice <strong>de</strong> φ dans la base B, Φ ∈ M(n, n), est réelle <strong>et</strong> symétrique. Elle adm<strong>et</strong> nvaleurs propres réelles λ 1 ≤ . . . ≤ λ n <strong>et</strong> les vecteurs propres associés {v 1 , . . .,v n } formentune base orthonormée <strong>de</strong> E. La matrice P = (V 1 · · ·V n ), dont les colonnes sont composées<strong>de</strong>s coordonnées <strong>de</strong>s v i est orthogonale, P −1 = P t <strong>et</strong> P t ΦP = diag(λ 1 , . . .,λ n ).On a, pour tout x =n∑x i e i =i=1n∑n∑˜x i v i <strong>de</strong> E : q(x) = Φ ij x i x j =i=1i,j=1n∑λ i˜x 2 i ,i=1<strong>et</strong>λ 1 ‖x‖ 2 ≤ X t ΦX ≤ λ n ‖x‖ 2 .Si toutes les valeurs propres sont strictement positives, Φ, resp. q, est définie positive.Si toutes les valeurs propres sont strictement négatives, Φ, resp. q, est définie négative.Dans tous les autres cas, Φ, resp. q, change <strong>de</strong> signe ou s’annule.En particulier, si 0 est valeur propre, Φ, resp. q, est dégénérée.Exemple : Sur R 2 , la forme quadratiqueq(x) = x 1 x 2 = 1 2( ) 2 x1 + x 2√ − 1 ( ) 2 x1 − x 2√2 2 2change <strong>de</strong> signe <strong>et</strong>(min q(x) = −1/2, atteint en‖x‖ 2 ≤1max q(x) = +1/2, atteint en‖x‖ 2 ≤1+1/ √ 2, −1/ √ )2)(+1/ √ 2, +1/ √ 2<strong>et</strong><strong>et</strong>(−1/ √ 2, +1/ √ )2 ;(−1/ √ 2, −1/ √ )2 .6 ADJOINT D’UN ENDOMORPHISME

12 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris DescartesGraphe <strong>de</strong> q(x) = x 1x 2100500-50105-100-10-50510-10-507 Dérivée directionnelle, dérivées partielles, différentiabilitéDans toute la suite on se place dans R n , muni du produit scalaire standard <strong>et</strong> <strong>de</strong> la b.o.n.canonique {e 1 , . . .,e n } : < x, y >= x t y en i<strong>de</strong>ntifiant x <strong>et</strong> X.Définition 7.1Soit Ω un ouvert <strong>de</strong> R n <strong>et</strong> f : Ω → R m . Soit a ∈ Ω <strong>et</strong> v ∈ R n , la dérivée <strong>de</strong> f au point a,dans la direction v, est définie parD v f(a) = lim (f(a + h v) − f(a)) (h ∈ R) .hh→01Si v = e i , on obtient la dérivée partielle <strong>de</strong> f par rapport à la i e variable, notée, D i f(a) ∈ R m .Si m = 1, f : Ω → R, on note aussi D i f(a) = ∂f∂x i(a).Définition 7.2Soit Ω un ouvert <strong>de</strong> R n <strong>et</strong> f : Ω → R m . On dit que f est différentiable en a ∈ Ω s’il existeune application linéaire L ∈ L(R n , R m ) qui vérifie‖f(a + u) − f(a) − L(u)‖ = o(‖u‖) (u ∈ R n ) .On note L = df a la différentielle <strong>de</strong> f en a <strong>et</strong> Df(a) ∈ M(m, n) la matrice associée estappelée matrice jacobienne.

Georges KOEPFLER : Optimisation - L3 2009-2010 13Proposition 7.1Soit Ω un ouvert <strong>de</strong> R n <strong>et</strong> f : Ω → R m différentiable au point a ∈ Ω, alors pour toutv ∈ R n :D v f(a) = df a (v) = Df(a) v.Si on note f 1 ,..., f m , les fonctions coordonnées <strong>de</strong> f, alors la matrice jacobienne s’écrit⎛∂f 1 ∂f∂x 1(a) 1∂f∂x 2(a) . . . 1⎞∂x n(a)Df(a) =⎜⎝∂f 2∂x 1(a).∂f m∂x 1(a)∂f 2∂x 2(a) . . ..∂f m∂x 2(a) . . .∂f 2∂x n(a).∂f m∂x n(a).⎟⎠Si m = 1, f : Ω → R, on a : Df(a) = ( ∂f∂x 1(a) · · ·∂f∂x n(a)).Note : la réciproque est fausse, il existe <strong>de</strong>s fonctions pour lesquelles toutes les dérivéesdirectionnelles existent <strong>et</strong> qui ne sont pas différentiables.Proposition 7.2Soit Ω un ouvert <strong>de</strong> R n <strong>et</strong> f : Ω → R différentiable au point a ∈ Ω, alors pour toutv ∈ R n :n∑ ∂fD v f(a) = v i (a) = < ∇f(a), v > = ∇f(a) t v∂x i⎛où ∇f(a) = (Df(a)) t = ⎝i=1∂f∂x 1(a).∂f∂x n(a)⎞⎠ est le gradient <strong>de</strong> f au point a.Application : Soit a ∈ R n , f : R n → R différentiable en a, on a∀v ∈ R n , ‖v‖ 2 = 1 : |D v f(a)| ≤ ‖∇f(a)‖ 2<strong>et</strong>min D vf(a) = −‖∇f(a)‖ 2 <strong>et</strong> est atteint en v = −∇f(a)/‖∇f(a)‖ 2 ;‖v‖ 2 =1max D v f(a) = +‖∇f(a)‖ 2 <strong>et</strong> est atteint en v = +∇f(a)/‖∇f(a)‖ 2 .‖v‖ 2 =1Au point a, la direction <strong>de</strong> la plus forte croissance <strong>de</strong> f est donné par +∇f(a) <strong>et</strong> la direction<strong>de</strong> la plus forte <strong>de</strong>scente est donné par −∇f(a).D’où les algorithmes <strong>de</strong> minimisation dits <strong>de</strong> “<strong>de</strong>scente <strong>de</strong> gradient”.Dans la direction ±(∇f(a)) ⊥ , D v f(a) = 0, on reste à la même cote. On dit aussi que legradient est perpendiculaire aux lignes <strong>de</strong> niveau L f (α) = {x ∈ R n / f(x) = α}.Si ∇f(a) = O, a est un point critique <strong>et</strong> localement la fonction est plate.7 DÉRIVÉE DIRECTIONNELLE, DÉRIVÉES PARTIELLES, DIFFÉRENTIABILITÉ

14 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris Descartes•f(a)•R n+1 ∇f(a)•aR n vΠ(a; v, −−−→ af(a))Proposition 7.3Soit Ω un ouvert <strong>de</strong> R n , f : Ω → R m <strong>et</strong> a ∈ Ω. Si au point a toutes les dérivées partiellesD i f(a), 1 ≤ i ≤ n, existent <strong>et</strong> si les fonctions x ↦→ D i f(x) 1 ≤ i ≤ n, sont continues dansun voisinage <strong>de</strong> a, alors f est différentiable en a.On dit que f est continûment différentiable, f ∈ C 1 (Ω, R m ), si on a continuité <strong>de</strong>s d.p. entout point <strong>de</strong> l’ouvert Ω.Dans la suite, on va considérer <strong>de</strong>s fonctions suffisamment régulières, c.-à-d. <strong>de</strong> classe C 1ou C 2 , ainsi ne se posera plus la question <strong>de</strong> différentiabilité.Proposition 7.4Soient f : R n → R m , g : R m → R p <strong>de</strong>s fonctions différentiables. On pose h = g ◦ f, alorsh : R n → R p est différentiable <strong>et</strong>, pour tout a ∈ R n :dh a = dg f(a) ◦ df a<strong>et</strong>⎛D 1 h 1 (a)⎝.D 1 h p (a)⎞ ⎛⎞⎛⎞. . . D n h 1 (a) D 1 g 1 (f(a)) . . . D m g 1 (f(a)) D 1 f 1 (a) . . . D n f 1 (a).⎠ = ⎝..⎠⎝. .⎠ .. . . D n h p (a) D 1 g p (f(a)) . . . D m g p (f(a)) D 1 f m (a) . . . D n f m (a)Exemple : Si n = p = 1, h(a) = g(f 1 (a), . . .,f m (a)) ∈ R, a ∈ R <strong>et</strong>h ′ (a) =m∑D i g(f(a)) f i(a) ′ .i=1

Georges KOEPFLER : Optimisation - L3 2009-2010 15Proposition 7.5Soit Ω un ouvert <strong>de</strong> R n , f : Ω → R <strong>et</strong> a ∈ Ω <strong>et</strong> on suppose que f ∈ C 2 (Ω, R). Ladifférentielle d’ordre 2, d 2 f a est une forme bilinéaire symétrique, dont la matrice s’écrit⎛⎞D 11 f(a) D 12 f(a) . . . D 1n f(a)( )DH f (a) = ⎜ 21 f(a) D 22 f(a) . . . D 2n f(a)⎟ ∂ 2⎝. . .⎠ = f(a)∂x i ∂x jD n1 f(a) D n2 f(a) . . . D nn f(a)1≤,i,j≤nC’est la matrice hessienne <strong>de</strong> f en a, pour h, k ∈ R n : d 2 f a (h, k) = h t H f (a) k ..Note : grâce à régularité C 2 <strong>de</strong> f on a∂ 2 f∂x i ∂x j=∂2 f∂x j ∂x i, 1 ≤, i, j ≤ n.Proposition 7.6 (Formule <strong>de</strong> Taylor à l’ordre 2)Soit Ω un ouvert <strong>de</strong> R n , f : Ω → R <strong>et</strong> a ∈ Ω. On suppose que f ∈ C 2 (Ω, R), alorsf(a + h) = f(a) + df a (h) + 1 2 d2 f a (h, h) + o(‖h‖ 2 )= f(a) + (∇f(a)) t h + 1 2 ht H f (a) h + o(‖h‖ 2 ) (h ∈ R n ) .Cas particulier : f : R 2 → R, a = (a 1 , a 2 ) <strong>et</strong> h = (h 1 , h 2 ) :f(a 1 + h 1 , a 2 + h 2 ) = f(a 1 , a 2 ) + ∂f∂x 1f(a)h 1 + ∂f∂x 2f(a)h 2+ 1 ∂ 2 f2 ∂x2 (a)h2 1 + 1 ∂ 2 f1 2 ∂x2 (a)h2 2 +∂2 f(a)h 1 h 2 + o(h 2 12 ∂x 1 ∂x + h2 2 ) .2Exemple :On suppose que la fonction utilité u <strong>de</strong> l’exemple 3 <strong>de</strong> la page 2 est <strong>de</strong> classe C 2 sur (R + ) 3 .Pour <strong>de</strong>s raisons <strong>de</strong> modélisation, on impose les propriétés qualitatives suivantes :(1)∂u∂x > 0,∂u∂y > 0,∂u∂l > 0 ;(2)∂ 2 u∂x 2 < 0,∂ 2 u∂y 2 < 0,∂ 2 u∂l 2 < 0 ;(3)∂ 2 u∂x∂l > 0,∂ 2 u∂y∂l > 0 ;(4)∂ 2 u∂x∂yest soit > 0 , soit < 0 ou = 0Donner une interprétation <strong>de</strong> ces relations en termes <strong>de</strong> “satisfaction”, “consommation”,“biens” <strong>et</strong> “temps libre”.7 DÉRIVÉE DIRECTIONNELLE, DÉRIVÉES PARTIELLES, DIFFÉRENTIABILITÉ

16 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris Descartes8 Caractérisation <strong>de</strong>s points optimauxThéorème 8.1 (Conditions nécessaires)Soit Ω un ouvert <strong>de</strong> R n , f : Ω → R <strong>et</strong> a ∈ Ω.1. Si f ∈ C 1 (Ω, R) <strong>et</strong> si a est un minimum local <strong>de</strong> f, alors nécessairement ∇f(a) = 0.2. Si f ∈ C 2 (Ω, R) <strong>et</strong> si a est un minimum local <strong>de</strong> f, alors nécessairement H f (a) estpositive : ∀x ∈ R n : x t H f (a) x ≥ 0.Exemple : La fonction f définie sur R 2 par f(x, y) = x 4 +y 4 adm<strong>et</strong> un minimum globalen (0, 0) <strong>et</strong> H f (0, 0) est la matrice nulle.Théorème 8.2 (Conditions suffisantes)Soit Ω un ouvert <strong>de</strong> R n , f ∈ C 2 (Ω, R) <strong>et</strong> a ∈ Ω.Si ∇f(a) = 0 <strong>et</strong> H f (a) est définie positive, ∀x ∈ R n \ {0} : x t H f (a) x > 0,alors a est un minimum local strict <strong>de</strong> f .Pour <strong>de</strong>s maxima locaux, resp. maxima locaux stricts, on obtient le même type <strong>de</strong> caractérisation,la matrice hessienne sera négative, resp. définie négative.Remarques :1) Si au point critique a, i.e. ∇f(a) = 0, la matrice H f (a) adm<strong>et</strong> <strong>de</strong>s valeurs propresstrictement positives <strong>et</strong> strictement négatives, alors a est un point selle.( )0 1• pour la fonction définie sur R 2 par f 1 (x, y) = xy on a H f1 (0, 0) =1 0qui adm<strong>et</strong> comme valeurs propres ±1. En (0, 0), f 1 adm<strong>et</strong> un point selle, il n’y a pas<strong>de</strong> points extremums;• la fonction f 2 , définie pour tout (x, y) dans R 2 par f 2 (x, y) = cosxcosy,adm<strong>et</strong> une infinité <strong>de</strong> minima locaux, <strong>de</strong> maxima locaux <strong>et</strong> <strong>de</strong> points selle.2) Si au point critique a, la matrice hessienne adm<strong>et</strong> une valeur propre nulle,i.e. détH f (a) = 0, on ne peut pas conclure, il faut faire une étu<strong>de</strong> adaptée.• la fonction f 3 , définie pour tout (x, y) dans R 2 par f 3 (x, y) = x 3 + y 3 ,adm<strong>et</strong> (0, 0) comme unique point critique, on a H f3 (0, 0) = O. Comme f 3 (x, x) = 2x 3change <strong>de</strong> signe avec x, (0, 0) est un point selle, f 3 n’adm<strong>et</strong> aucun point extremum;• les fonctions définies sur R 2 par f 4 (x, y) = x 2 − 2xy + y 2 + x 4 + y 4 <strong>et</strong>f 5 (x, y) = x 2 − 2xy + y 2 − x 4 − y 4 ont la même matrice hessienne, positive, au pointcritique (0, 0) qui adm<strong>et</strong> comme valeurs propres 0 <strong>et</strong> 4.Comme f 4 (x, y) = (x − y) 2 + x 4 + y 4 , il y a un minimum (global) en (0, 0).Par ailleurs, comme f 5 (x, x) = −2x 4 <strong>et</strong> f 5 (x, −x) = 2x 2 (2−x 2 ), f 5 adm<strong>et</strong> un point selleen (0, 0).

ZGeorges KOEPFLER : Optimisation - L3 2009-2010 17250200150100501−6−8Z0−4−500−2−100−1−8−6−4−2Y02468024X68−150−200−25054321Y0−1−2−3−4−5−5 −4 −3 −2 −1 0 1 2 3 4 5XGraphe <strong>de</strong> f 2 (x, y) = cosxcosy Graphe <strong>de</strong> f 3 (x, y) = x 3 + y 3Les résultats précé<strong>de</strong>nts fournissent <strong>de</strong>s informations locales au suj<strong>et</strong> <strong>de</strong>s extremums. Pourobtenir <strong>de</strong>s informations globales, il faut imposer <strong>de</strong>s propriétés plus fortes à la fonctionà optimiser f <strong>et</strong> au domaine <strong>de</strong> définition Ω.9 Fonctions convexesDéfinition 9.1Soit C ⊂ R n un ensemble convexe non vi<strong>de</strong> <strong>et</strong> f : C → R.– On dit que f est une fonction convexe si pour tout (x, y) ∈ C 2 <strong>et</strong> pour tout t ∈]0, 1[f est concave si −f est convexe.f(t x + (1 − t) y) ≤ t f(x) + (1 − t) f(y) .– La fonction f est strictement convexe si pour tout (x, y) ∈ C 2 , x ≠ y, <strong>et</strong> pour toutt ∈]0, 1[f(t x + (1 − t) y) < t f(x) + (1 − t) f(y) .Note : une fonction est convexe, resp. strictement convexe, sur C ⊂ R n si <strong>et</strong> seulement sisa restriction à tout segment inclus dans C est convexe, resp. strictement convexe.Proposition 9.1 (Critères <strong>de</strong> convexité I)Soit Ω un ouvert convexe non vi<strong>de</strong> <strong>de</strong> R n <strong>et</strong> f ∈ C 1 (Ω, R) :(a) f est convexe sur Ω si <strong>et</strong> seulement si∀u ∈ Ω, ∀v ∈ R n tel que u + v ∈ Ω : D v f(u) = ∇f(u) t v ≤ f(u + v) − f(u) ;(b) f est strictement convexe sur Ω si <strong>et</strong> seulement si∀u ∈ Ω, ∀v ∈ R n \ {0} tel que u + v ∈ Ω : D v f(u) = ∇f(u) t v < f(u + v) − f(u) .9 FONCTIONS CONVEXES

18 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris DescartesCes inégalités expriment que le graphe <strong>de</strong> f est en chaque point au-<strong>de</strong>ssus du plan tangent.Pour n = 1, la fonction f est convexe, resp. strictement convexe, si <strong>et</strong> seulement si f ′ estcroissante, resp. strictement croissante.f(u + v)f(u) + ∇f(u) t vf(u)uu + vProposition 9.2 (Critères <strong>de</strong> convexité II)Soit Ω un ouvert convexe non vi<strong>de</strong> <strong>de</strong> R n <strong>et</strong> f ∈ C 2 (Ω, R) :(a) f est convexe sur Ω si <strong>et</strong> seulement si H f (x) est positive pour tout x ∈ Ω ;(b) si H f (x) est définie positive pour tout x ∈ Ω, alors f est strictement convexe sur Ω.Exemples :• la fonction f(x) = x 4 est strictement convexe sur R, sa dérivée f ′ (x) = 4x 3 est strictementcroissante sur R, mais f ′′ (0) = 0;• pour g(x) = 1/x 2 , on a g ′′ (x) = 1/x 4 > 0 sur l’ouvert, non convexe, R ∗ <strong>et</strong> g n’est pasune fonction convexe sur R ∗ .Les résultats suivants montrent comment la convexité perm<strong>et</strong> d’obtenir <strong>de</strong>s résultats globaux,resp. d’unicité, pour <strong>de</strong>s problèmes d’optimisation.Théorème 9.1Soit C un convexe non vi<strong>de</strong> <strong>de</strong> R n <strong>et</strong> f : C → R convexe, alors chaque minimum local <strong>de</strong>f est un minimum global sur C .Théorème 9.2Soit C un convexe non vi<strong>de</strong> <strong>de</strong> R n <strong>et</strong> f : C → R strictement convexe, Si f adm<strong>et</strong> unminimum dans C, alors ce minimum est global <strong>et</strong> unique dans C.

Georges KOEPFLER : Optimisation - L3 2009-2010 19Théorème 9.3Soit Ω un ouvert convexe non vi<strong>de</strong> <strong>de</strong> R n , f ∈ C 1 (Ω, R) <strong>et</strong> f : C → R convexe sur Ω, alors∇f(a) = 0 ⇔ a est un minimum global.Théorème 9.4Soit f ∈ C 2 (R n , R), on suppose qu’il existe ν > 0 tel que∀x ∈ R n , ∀u ∈ R n : u t H f (x) u ≥ ν ‖u‖ 2 2 .Alors f adm<strong>et</strong> un minimum global unique sur R nRemarque :Dans les hypothèses du théorème précé<strong>de</strong>nt, le réel strictement positif ν est un minorantuniforme en x, sur R n , <strong>de</strong> toutes les valeurs propres <strong>de</strong>s matrices hessiennes H f (x).Exemple fondamental :Soit A une matrice réelle, symétrique d’ordre n, b un vecteur <strong>de</strong> R n <strong>et</strong> c un réel, on définitla fonction quadratique f, sur R n , par :∀x ∈ R n : f(x) = 1 2 xt A x + b t x + c .On calcule ∇f(x) = Ax + b <strong>et</strong> H f (x) = A .Si A est définie positive, resp définie négatives, la fonction f adm<strong>et</strong> un minimum, resp.maximum, unique sur R n . L’extremum est atteint au point x, solution du système linéaireAx = b, c.-à-d., x = A −1 b.f(x 1 , x 2 ) = x 2 1 + 2x2 2L f (2) <strong>et</strong> L f (5)121086420−2.0−1.5−1.0−0.50.0x20.51.01.5012.0 2x 1−1−29 FONCTIONS CONVEXES

20 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris Descartes10 Multiplicateurs <strong>de</strong> LagrangeDans les sections précé<strong>de</strong>ntes, on a optimisé une fonction sur un ouvert Ω ⊂ R n , or dansbeaucoup d’applications les contraintes du problème imposent <strong>de</strong>s domaines fermés. Dansce cas les critères <strong>de</strong> caractérisation précé<strong>de</strong>nts ne s’appliquent pas.On va présenter dans c<strong>et</strong>te section <strong>de</strong>s résultats pour un type particulier <strong>de</strong> contraintes.Exemple : Étudiermin xy,x 2 +y 2 =1min xy <strong>et</strong> min xy .x 2 +y 2 ≤1x 2 +y 2

Georges KOEPFLER : Optimisation - L3 2009-2010 21Exemples :• Soit A = Ω ouvert <strong>de</strong> R n <strong>et</strong> a ∈ Ω un extremum local <strong>de</strong> f, alors ∇f(a) est orthogonalà toutes les tangentes aux chemins passant par a.Soit X(t) = a + t v, où v ∈ R n \ {0} quelconque. Alors X(0) = a <strong>et</strong> X ′ (t) = v, donc< ∇f(a), v >= D v f(a) = 0, pour tout v ≠ 0 <strong>et</strong> l’on r<strong>et</strong>rouve la condition nécessaire :∇f(a) = 0.Ici le l’espace tangent est le s.e.v. trivial R n , l’unique vecteur dans (R n ) ⊥ est 0.• Soit A = S 2 (0, 1) = {(x 1 , x 2 , x 3 ) ∈ R 3 / x 2 1 + x2 2 + x2 3 = 1} <strong>et</strong> f ∈ C1 (R n , R).L’ensemble A étant compact <strong>et</strong> f continue, on déduit que f atteint son minimum <strong>et</strong>maximum sur A.Si a est un extremum <strong>de</strong> f sur A, alors ∇f(a) est perpendiculaire à tout chemin <strong>de</strong> Apassant par a.Or a ∈ S 2 (0, 1) est un vecteur perpendiculaire à S 2 (0, 1), d’où ∇f(a) <strong>et</strong> a sont colinéaires :∇f(a) = λ a, pour λ ∈ R.On obtient ainsi 4 équations scalaires qui perm<strong>et</strong>tent qui sont nécessairement vérifiées parles extremums <strong>de</strong> f sur A.L’espace tangent à S 2 (0, 1) en a est le plan vectoriel Π a , engendré par les vecteurs perpendiculairesà a; le plan affine a + Π a est tangent à la sphère au point a.Dans les théorèmes suivants, l’ensemble A est défini <strong>de</strong> façon implicite comme étantl’ensemble <strong>de</strong>s points x annulant une fonction régulière g.Théorème 10.1 (Conditions nécessaires. 1 contrainte)Soit Ω un ouvert <strong>de</strong> R n , f <strong>et</strong> g <strong>de</strong>s fonctions continûment différentiables <strong>de</strong> Ω dans R. Onconsidère l’ensemble A = {x ∈ Ω/ g(x) = 0} .Soit a ∈ A tel que ∇g(a) ≠ 0, alors, si la restriction <strong>de</strong> f à A présente un extremum aupoint a, il existe un réel λ tel que :∇f(a) = λ∇g(a).Application : Ce théorème perm<strong>et</strong> <strong>de</strong> trouver tous les points candidats à être solution<strong>de</strong>s problèmes min f(x) ou max f(x).x∈A x∈AIls doivent nécessairement vérifier les n + 1 équations scalaires :(∇f(a)) i = λ (∇g(a)) i , 1 ≤ i ≤ n <strong>et</strong> g(x) = 0 .Ce sont les points critiques du Lagrangien :L(x, λ) = f(x) − λ g(x).Parmi les solutions (x 1 , . . .,x n , λ), on r<strong>et</strong>ient celles qui minimisent, resp. maximisent, fsur A.Exemple :La fonction définie pour tout x ∈ R 3 par g(x) = x 2 1 +x2 2 +x2 3 −1 perm<strong>et</strong> <strong>de</strong> définir S2 (0, 1)comme l’ensemble <strong>de</strong>s x annulant g.Soit a vérifiant g(a) = 0, on a (∇g(a)) i = 2 a i , 1 ≤ i ≤ 3.On r<strong>et</strong>rouve le résultat : ∇f(a) = ˜λ a, pour ˜λ = 2λ ∈ R , comme condition nécessairepour que a soit extremum <strong>de</strong> f sur S 2 (0, 1).10 MULTIPLICATEURS DE LAGRANGE

22 <strong>UFR</strong> <strong>de</strong> Mathématiques <strong>et</strong> <strong>Informatique</strong>, Université Paris DescartesThéorème 10.2 (Conditions nécessaires. k contraintes)Soit Ω un ouvert <strong>de</strong> R n <strong>et</strong> f, g 1 , . . ., g k <strong>de</strong>s fonctions continûment différentiables <strong>de</strong> Ω dansR. On considère l’ensemble A = {x ∈ Ω/ g 1 (x) = · · · = g k (x) = 0} .Soit a ∈ A tel que les vecteurs ∇g 1 (a), . . ., ∇g k (a) sont linéairement indépendants, enparticulier k ≤ n.Alors, si la restriction <strong>de</strong> f à A présente un extremum au point a, il existe k réels λ 1 , . . .,λ k tels que :∇f(a) = λ 1 ∇g 1 (a) + · · · + λ k ∇g k (a) .Application : Ce théorème perm<strong>et</strong> <strong>de</strong> trouver tous les points candidats à être solution<strong>de</strong> min f(x) ou max f(x).x∈A x∈AIls doivent nécessairement vérifier les n + k équations scalaires :(∇f(a)) i =k∑λ j (∇g j (a)) i , 1 ≤ i ≤ n <strong>et</strong> g j (x) = 0 , 1 ≤ j ≤ k .j=1Ce sont les points critiques du Lagrangien :où λ = (λ 1 , · · ·, λ k ).L(x, λ) = f(x) −k∑λ j g j (x)Parmi les solutions (x 1 , . . ., x n , λ 1 , . . ., λ k ), on ne r<strong>et</strong>ient que celles qui minimisent, resp.maximisent, f sur A.Sous <strong>de</strong>s hypothèses supplémentaires, le Lagrangien perm<strong>et</strong> <strong>de</strong> donner une condition suffisantecaractérisant un extremum <strong>de</strong> f sur A.Théorème 10.3 (Conditions suffisantes. k contraintes)Soit Ω un ouvert <strong>de</strong> R n <strong>et</strong> f, g 1 , . . .,g k <strong>de</strong>s fonctions <strong>de</strong> classe C 2 (Ω, R).On considère l’ensemble A = {x ∈ Ω/ g 1 (x) = · · · = g k (x) = 0} .Soit a ∈ A tel que les vecteurs ∇g 1 (a), . . ., ∇g k (a) sont linéairement indépendantsk∑<strong>et</strong> soit (a, λ) ∈ A × R k un point critique <strong>de</strong> L(x, λ) = f(x) − λ j g j (x),on définit la matrice symétrique <strong>de</strong> taille (n, n) :Q L (a, λ) = H f (a) −k∑λ j H gj (a) .<strong>et</strong> la forme quadratique q(h) = h t Q L (a, λ) h, pour h ∈ R n .Si, pour tout h vérifiant < ∇g j (a), h >= 0, 1 ≤ j ≤ k, on a• q(h) > 0, alors a est un minimum relatif strict <strong>de</strong> f sur A ;• q(h) < 0, alors a est un maximum relatif strict <strong>de</strong> f sur A ;• q(h) qui prend <strong>de</strong>s valeurs positives <strong>et</strong> négatives, alors a n’est pas un extremum <strong>de</strong> f ;• soit q(h) ≥ 0, soit q(h) ≤ 0, on ne peut pas conclure.Note : h ∈ R n vérifie < ∇g j (a), h >= 0, 1 ≤ j ≤ k, si <strong>et</strong> seulement si h ∈ Π a , l’espac<strong>et</strong>angent en a à A.j=1j=1j=1