밑바닥부터 시작하는 딥러닝 - 미리보기

사이토 고키 지음 | 개앞맵시(이복연) 옮김 | 24,000원 | 한빛미디어 | 2017.01.03 "직접 구현하고 움직여보며 익히는 가장 쉬운 딥러닝 입문서 " 이 책은 라이브러리나 프레임워크에 의존하지 않고, 딥러닝의 핵심을 ‘밑바닥부터’ 직접 만들어보며 즐겁게 배울 수 있는 본격 딥러닝 입문서입니다. 술술 읽힐 만큼 쉽게 설명하였고, 역전파처럼 어려운 내용은 ‘계산 그래프’ 기법으로 시각적으로 풀이했습니다. 무엇보다 작동하는 코드가 있어 직접 돌려보고 요리조리 수정해보면 어려운 이론도 명확하게 이해할 수 있습니다. 딥러닝에 새롭게 입문하려는 분과 기초를 다시금 정리하고 싶은 현업 연구자와 개발자에게 최고의 책이 될 것입니다.

사이토 고키 지음 | 개앞맵시(이복연) 옮김 | 24,000원 | 한빛미디어 | 2017.01.03

"직접 구현하고 움직여보며 익히는 가장 쉬운 딥러닝 입문서 "

이 책은 라이브러리나 프레임워크에 의존하지 않고, 딥러닝의 핵심을 ‘밑바닥부터’ 직접 만들어보며 즐겁게 배울 수 있는 본격 딥러닝 입문서입니다. 술술 읽힐 만큼 쉽게 설명하였고, 역전파처럼 어려운 내용은 ‘계산 그래프’ 기법으로 시각적으로 풀이했습니다. 무엇보다 작동하는 코드가 있어 직접 돌려보고 요리조리 수정해보면 어려운 이론도 명확하게 이해할 수 있습니다. 딥러닝에 새롭게 입문하려는 분과 기초를 다시금 정리하고 싶은 현업 연구자와 개발자에게 최고의 책이 될 것입니다.

Create successful ePaper yourself

Turn your PDF publications into a flip-book with our unique Google optimized e-Paper software.

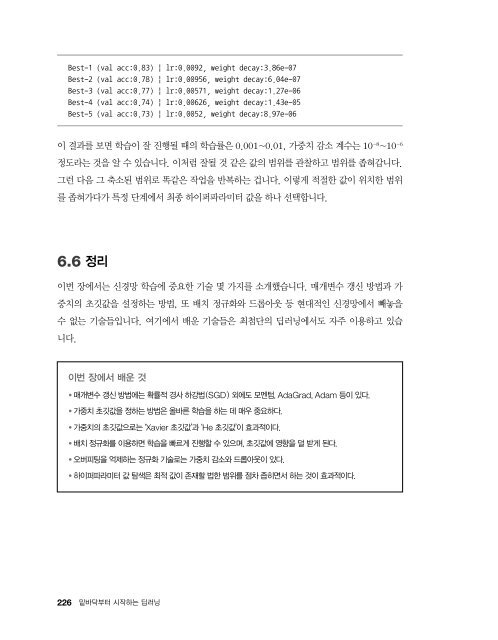

Best-1 (val acc:0.83) | lr:0.0092, weight decay:3.86e-07<br />

Best-2 (val acc:0.78) | lr:0.00956, weight decay:6.04e-07<br />

Best-3 (val acc:0.77) | lr:0.00571, weight decay:1.27e-06<br />

Best-4 (val acc:0.74) | lr:0.00626, weight decay:1.43e-05<br />

Best-5 (val acc:0.73) | lr:0.0052, weight decay:8.97e-06<br />

이 결과를 보면 학습이 잘 진행될 때의 학습률은 0.001~0.01, 가중치 감소 계수는 10 -8 ~10 -6<br />

정도라는 것을 알 수 있습니다. 이처럼 잘될 것 같은 값의 범위를 관찰하고 범위를 좁혀갑니다.<br />

그런 다음 그 축소된 범위로 똑같은 작업을 반복하는 겁니다. 이렇게 적절한 값이 위치한 범위<br />

를 좁혀가다가 특정 단계에서 최종 하이퍼파라미터 값을 하나 선택합니다.<br />

6.6 정리<br />

이번 장에서는 신경망 학습에 중요한 기술 몇 가지를 소개했습니다. 매개변수 갱신 방법과 가<br />

중치의 초깃값을 설정하는 방법, 또 배치 정규화와 드롭아웃 등 현대적인 신경망에서 빼놓을<br />

수 없는 기술들입니다. 여기에서 배운 기술들은 최첨단의 딥러닝에서도 자주 이용하고 있습<br />

니다.<br />

이번 장에서 배운 것<br />

●●매개변수 갱신 방법에는 확률적 경사 하강법(SGD) 외에도 모멘텀, AdaGrad, Adam 등이 있다.<br />

●●가중치 초깃값을 정하는 방법은 올바른 학습을 하는 데 매우 중요하다.<br />

●●가중치의 초깃값으로는 ‘Xavier 초깃값’과 ‘He 초깃값’이 효과적이다.<br />

●●배치 정규화를 이용하면 학습을 빠르게 진행할 수 있으며, 초깃값에 영향을 덜 받게 된다.<br />

●●오버피팅을 억제하는 정규화 기술로는 가중치 감소와 드롭아웃이 있다.<br />

●●하이퍼파라미터 값 탐색은 최적 값이 존재할 법한 범위를 점차 좁히면서 하는 것이 효과적이다.<br />

226 <strong>밑바닥부터</strong> 시작하는 딥러닝