kombiniertes data mining – klassifikation unter verwendung von ...

kombiniertes data mining – klassifikation unter verwendung von ...

kombiniertes data mining – klassifikation unter verwendung von ...

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

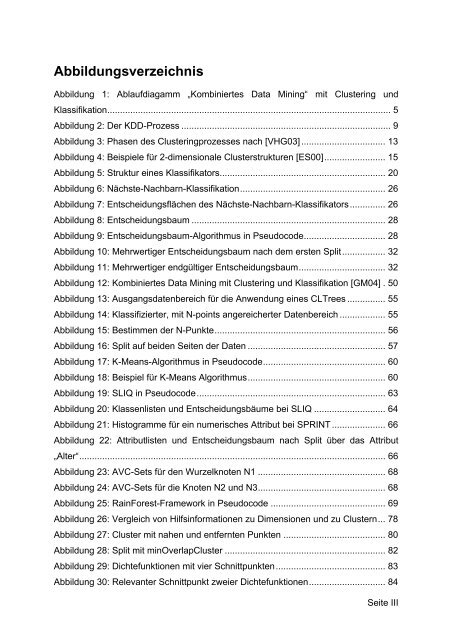

Abbildungsverzeichnis<br />

Abbildung 1: Ablaufdiagamm „Kombiniertes Data Mining“ mit Clustering und<br />

Klassifikation............................................................................................................... 5<br />

Abbildung 2: Der KDD-Prozess .................................................................................. 9<br />

Abbildung 3: Phasen des Clusteringprozesses nach [VHG03] ................................. 13<br />

Abbildung 4: Beispiele für 2-dimensionale Clusterstrukturen [ES00]........................ 15<br />

Abbildung 5: Struktur eines Klassifikators................................................................. 20<br />

Abbildung 6: Nächste-Nachbarn-Klassifikation......................................................... 26<br />

Abbildung 7: Entscheidungsflächen des Nächste-Nachbarn-Klassifikators.............. 26<br />

Abbildung 8: Entscheidungsbaum ............................................................................ 28<br />

Abbildung 9: Entscheidungsbaum-Algorithmus in Pseudocode................................ 28<br />

Abbildung 10: Mehrwertiger Entscheidungsbaum nach dem ersten Split................. 32<br />

Abbildung 11: Mehrwertiger endgültiger Entscheidungsbaum.................................. 32<br />

Abbildung 12: Kombiniertes Data Mining mit Clustering und Klassifikation [GM04] .50<br />

Abbildung 13: Ausgangsdatenbereich für die Anwendung eines CLTrees ............... 55<br />

Abbildung 14: Klassifizierter, mit N-points angereicherter Datenbereich .................. 55<br />

Abbildung 15: Bestimmen der N-Punkte................................................................... 56<br />

Abbildung 16: Split auf beiden Seiten der Daten ...................................................... 57<br />

Abbildung 17: K-Means-Algorithmus in Pseudocode................................................ 60<br />

Abbildung 18: Beispiel für K-Means Algorithmus...................................................... 60<br />

Abbildung 19: SLIQ in Pseudocode.......................................................................... 63<br />

Abbildung 20: Klassenlisten und Entscheidungsbäume bei SLIQ ............................ 64<br />

Abbildung 21: Histogramme für ein numerisches Attribut bei SPRINT ..................... 66<br />

Abbildung 22: Attributlisten und Entscheidungsbaum nach Split über das Attribut<br />

„Alter“........................................................................................................................ 66<br />

Abbildung 23: AVC-Sets für den Wurzelknoten N1 .................................................. 68<br />

Abbildung 24: AVC-Sets für die Knoten N2 und N3.................................................. 68<br />

Abbildung 25: RainForest-Framework in Pseudocode ............................................. 69<br />

Abbildung 26: Vergleich <strong>von</strong> Hilfsinformationen zu Dimensionen und zu Clustern... 78<br />

Abbildung 27: Cluster mit nahen und entfernten Punkten ........................................ 80<br />

Abbildung 28: Split mit minOverlapCluster ............................................................... 82<br />

Abbildung 29: Dichtefunktionen mit vier Schnittpunkten........................................... 83<br />

Abbildung 30: Relevanter Schnittpunkt zweier Dichtefunktionen.............................. 84<br />

Seite III