Künstliche Neuronale Netze

Künstliche Neuronale Netze

Künstliche Neuronale Netze

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

12.05.2009<br />

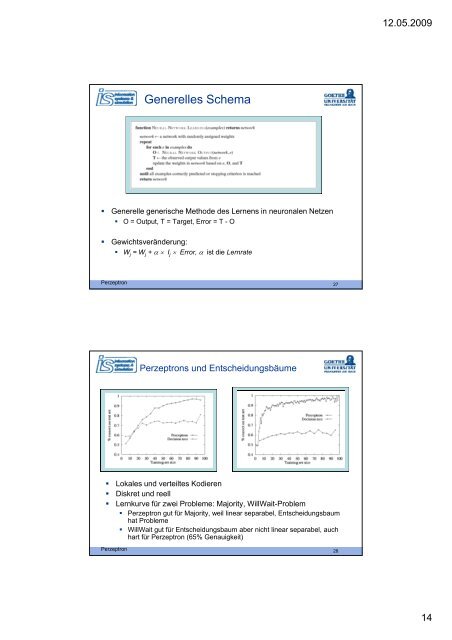

Generelles Schema<br />

• Generelle generische Methode des Lernens in neuronalen <strong>Netze</strong>n<br />

• O = Output, T = Target, Error = T - O<br />

• Gewichtsveränderung:<br />

• W j = W j + α × I j × Error, α ist die Lernrate<br />

Perzeptron<br />

27<br />

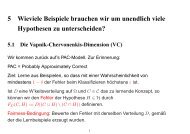

Perzeptrons und Entscheidungsbäume<br />

• Lokales und verteiltes Kodieren<br />

• Diskret und reell<br />

• Lernkurve für zwei Probleme: Majority, WillWait-Problem<br />

• Perzeptron gut für Majority, weil linear separabel, Entscheidungsbaum<br />

hat Probleme<br />

• WillWait gut für Entscheidungsbaum aber nicht linear separabel, auch<br />

hart für Perzeptron (65% Genauigkeit)<br />

Perzeptron<br />

28<br />

14