Kapitel VI Neuronale Netze

Kapitel VI Neuronale Netze

Kapitel VI Neuronale Netze

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

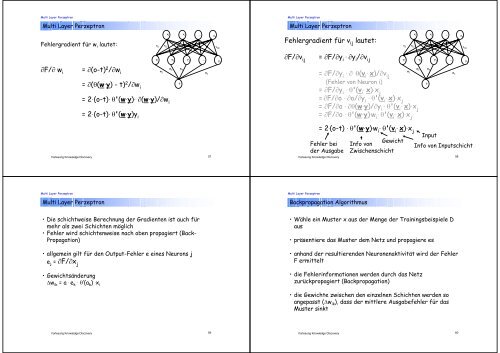

Multi Layer Perzeptron<br />

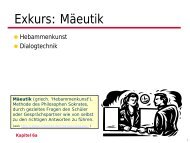

Multi Layer Perzeptron<br />

Multi Layer Perzeptron<br />

Multi Layer Perzeptron<br />

Fehlergradient für w i lautet:<br />

F/ w i<br />

= (o-t) 2 /w i<br />

= ((w . y) - t) 2 /w i<br />

= 2 . (o-t) . '(w . y) . (w . y)/w i<br />

x 1 x 2 ...<br />

v 11 v 12<br />

y 1 y 2 y 3 ...<br />

w 2 w 3<br />

w 1 w n<br />

o<br />

x m<br />

v nm<br />

y n<br />

Fehlergradient für v ij lautet:<br />

F/v ij<br />

= F/y i<br />

.<br />

y i<br />

/v ij<br />

= F/y i<br />

.<br />

(v i.<br />

x)/v ij<br />

(Fehler von Neuron i)<br />

= F/y i<br />

.<br />

'(v i.<br />

x) . x j<br />

= F/o . o/y i<br />

.<br />

'(v i.<br />

x) . x j<br />

= F/o . (w . y)/y i<br />

.<br />

'(v i.<br />

x) . x j<br />

= F/o . '(w . y) . w i.<br />

'(v i.<br />

x) . x j<br />

x 1 x 2 ...<br />

v 11 v 12<br />

y 1 y 2 y 3 ...<br />

w 2 w 3<br />

w 1 w n<br />

= 2 . (o-t) . '(w . y)y i<br />

58<br />

o<br />

x m<br />

v nm<br />

y n<br />

Vorlesung Knowledge Discovery<br />

57<br />

Vorlesung Knowledge Discovery<br />

= 2 . (o-t) . '(w . y) . w i.<br />

'(v i.<br />

x) . x j<br />

Fehler bei<br />

der Ausgabe<br />

Gewicht<br />

Info von<br />

Zwischenschicht<br />

Input<br />

Info von Inputschicht<br />

Multi Layer Perzeptron<br />

Multi Layer Perzeptron<br />

Multi Layer Perzeptron<br />

Backpropagation Algorithmus<br />

• Die schichtweise Berechnung der Gradienten ist auch für<br />

mehr als zwei Schichten möglich<br />

• Fehler wird schichtenweise nach oben propagiert (Back-<br />

Propagation)<br />

• allgemein gilt für den Output-Fehler e eines Neurons j<br />

e j = F/x j<br />

• Gewichtsänderung<br />

• Wähle ein Muster x aus der Menge der Trainingsbeispiele D<br />

aus<br />

• präsentiere das Muster dem Netz und propagiere es<br />

• anhand der resultierenden Neuronenaktivität wird der Fehler<br />

F ermittelt<br />

• die Fehlerinformationen werden durch das Netz<br />

zurückpropagiert (Backpropagation)<br />

w ik = a . e .<br />

k ‘(a k ) . x i<br />

• die Gewichte zwischen den einzelnen Schichten werden so<br />

angepasst (w ik ), dass der mittlere Ausgabefehler für das<br />

Muster sinkt<br />

60<br />

Vorlesung Knowledge Discovery<br />

59<br />

Vorlesung Knowledge Discovery