Multivariate Verteilungen

Multivariate Verteilungen

Multivariate Verteilungen

- Keine Tags gefunden...

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

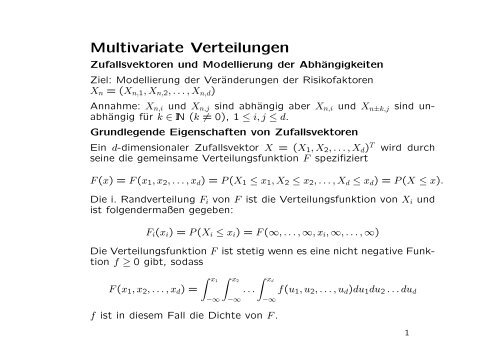

<strong>Multivariate</strong> <strong>Verteilungen</strong>Zufallsvektoren und Modellierung der AbhängigkeitenZiel: Modellierung der Veränderungen der RisikofaktorenX n = (X n,1 , X n,2 , . . . , X n,d )Annahme: X n,i und X n,j sind abhängig aber X n,i und X n±k,j sind unabhängigfür k ∈ IN (k ≠ 0), 1 ≤ i, j ≤ d.Grundlegende Eigenschaften von ZufallsvektorenEin d-dimensionaler Zufallsvektor X = (X 1 , X 2 , . . . , X d ) T wird durchseine die gemeinsame Verteilungsfunktion F spezifiziertF(x) = F(x 1 , x 2 , . . . , x d ) = P(X 1 ≤ x 1 , X 2 ≤ x 2 , . . . , X d ≤ x d ) = P(X ≤ x).Die i. Randverteilung F i von F ist die Verteilungsfunktion von X i undist folgendermaßen gegeben:F i (x i ) = P(X i ≤ x i ) = F(∞, . . . , ∞, x i , ∞, . . . , ∞)Die Verteilungsfunktion F ist stetig wenn es eine nicht negative Funktionf ≥ 0 gibt, sodassF(x 1 , x 2 , . . . , x d ) =∫ x1−∞∫ x2−∞. . .∫ xd−∞f ist in diesem Fall die Dichte von F.f(u 1 , u 2 , . . . , u d )du 1 du 2 . . . du d1

Die Komponenten von X sind unabhängig dann und nur dann wennF(x) = Π d i=1 F i(x i ) oder, wenn f existiert f(x) = Π d i=1 f i(x i )Ein Zufallsvektor ist eindeutig durch seine charakteristische Funktionφ X (t) spezifiziert:φ X (t) = E(exp{it T X}), t ∈ IR dBeispiel 1 Für die multivariate Normalverteilung mit Mittelwert µund Kovarianzmatrix Σ ist die Dichtefunktion f bzw. die charakteristischeFunktion φ X folgendermaßen gegeben (|Σ| = |Det(Σ)|):1f(x) √{−(2π) d |Σ| exp 1 }2 (x − µ)T Σ −1 (x − µ) , x ∈ IR dφ X (t) = exp{it T µ − 1 2 tT Σt}, t ∈ IR dWenn E(Xk 2 ) < ∞ für alle k, dann ist die Kovarianzmatrix einesZufallsvektors folgendermaßen gegeben:Cov(X) = E((X − E(X))(X − E(X)) T )Übung 1 Zeigen Sie das folgende Gleichungen gelten:E(BX + b) = BE(X) + b Cov(BX + b) = BCov(X)B T 2

AbhängigkeitsmaßeSeien X 1 und X 2 zwei Zufallsvariablen. Es gibt einige skalare Maßefür die Abhängigkeit zwischen X 1 und X 2 .Lineare KorrelationAnnahme: var(X 1 ), var(X 2 ) ∈ (0, ∞). Der Koeffizient derlinearen Korrelation ρ L (X 1 , X 2 ) ist folgendermaßen gegeben:ρ L (X 1 , X 2 ) = Cov(X 1, X 2 )√var(X1 )var(X 2 )X 1 und X 2 sind unabhängig ⇒ ρ L (X 1 , X 2 ) = 0ρ L (X 1 , X 2 ) = 0 impliziert nicht, dass X 1 und X 2 unabhängig sindBeispiel 3 Sei X 1 ∼ N(0,1) und X 2 = X 2 1 . Es gilt ρ L(X 1 , X 2 ) = 0aber X 1 und X 2 sind klarerweise abhängig.Weiters gilt:|ρ L (X 1 , X 2 )| = 1 ⇒ ∃α, β ∈ IR, β ≠ 0, sodass X 2 = α + βX 1und signum(β) = signum(ρ L (X 1 , X 2 ))Der lineare Korrelationskoeff. ist eine Invariante unter streng monotonsteigende lineare Transformationen, ist jedoch keine Invariante unterstreng monoton steigende nichtlineare Transformationen.4

Übung 2 Seien X 1 und X 2 zwei Zufallsvariablen. Seien α 1 , α 2 , β 1 , β 2 ∈IR, β 1 > 0 und β 2 > 0. Zeigen Sie, dass ρ L (α 1 + β 1 X 1 , α 2 + β 2 X 2 ) =ρ L (X 1 , X 2 ).Rang KorrelationDie Koeffizienten der Rang Korrelation (Spearmans rho und Kendallstau) sind Maße für die Übereinstimmung von bivariaten Zufallsvektoren.Seien (x 1 , x 2 ) und (˜x 1 ,˜x 2 ) zwei Punkte in IR 2 . Die zwei Punkteheißen übereinstimmend wenn (x 1 − ˜x 1 )(x 2 − ˜x 2 ) > 0 und nichtübereinstimmend wenn (x 1 − ˜x 1 )(x 2 − ˜x 2 ) < 0.Seien (X 1 , X 2 ) und ( ˜X 1 , ˜X 2 ) zwei unabhängige Zufallsvektoren mitgemeinsamer bivariate Verteilung.Die Kendall’s Tau ρ τ ist definiert alsρ τ (X 1 , X 2 ) = P ( (X 1 − ˜X 1 )(X 2 − ˜X 2 ) > 0 ) −P ( (X 1 − ˜X 1 )(X 2 − ˜X 2 ) < 0 )Sei ( ˆX 1 , ˆX 2 ) ein dritter von (X 1 , X 2 ) und ( ˜X 1 , ˜X 2 ) unahängiger Zufallsvektormit derselben Verteilung wie (X 1 , X 2 ) und ( ˜X 1 , ˜X 2 ).Die Spearman’s Rho ρ S ist definiert alsρ S (X 1 , X 2 ) = P ( (X 1 − ˜X 1 )(X 2 − ˆX 2 ) > 0 ) −P ( (X 1 − ˜X 1 )(X 2 − ˆX 2 ) < 0 )5

Einige Eigenschaften von ρ τ und ρ S :• ρ τ (X 1 , X 2 ) ∈ [−1,1] und ρ S (X 1 , X 2 ) ∈ [−1,1].• Wenn X 1 und X 2 unabhängig, dann ρ τ (X 1 , X 2 ) = ρ S (X 1 , X 2 ) = 0.Die Umkehrung gilt i.a. nicht.• Sei T:IR → IR eine streng monoton steigende Funktion.Dann gilt:ρ τ (T(X 1 ), T(X 2 )) = ρ τ (X 1 , X 2 )ρ S (T(X 1 ), T(X 2 )) = ρ S (X 1 , X 2 )6

Die multivariate NormalverteilungDefinition 2 Der Zufallsvektor (X 1 , X 2 , . . . , X d ) T hat eine multivariateNormalverteilung (oder eine multivariate Gauss’sche Verteilung)wenn X d = µ + AZ, wobei Z = (Z 1 , Z 2 , . . . , Z k ) T ein Vektor von i.i.d.normalverteilten ZV (Z i ∼ N(0,1), ∀i = 1,2, . . . , k), A ∈ IR d×k ist einekonstante Matrix und µ ∈ IR d ist ein konstanter Vektor.Für so einen Zufallsvektor X gilt: E(X) = µ, cov(X) = Σ = AA T(Σ positiv semidefinit). Notation: X ∼ N d (µ,Σ).Theorem 1 (<strong>Multivariate</strong> Normalverteilung: äquiv. Definitionen)1. X ∼ N d (µ,Σ) für einen Vektor µ ∈ IR d und eine positiv semidefiniteMatrix Σ ∈ IR d×d , dann und nur dann wenn ∀a ∈ IR d ,a = (a 1 , a 2 , . . . , a d ) T , die Zufallsvariable a T X normal verteilt ist.2. Ein Zufallsvektor X ∈ IR d ist multivariat normal verteilt dann undnur dann wenn seine charakteristische Funktion folgendermaßengegeben ist:φ X (t) = E(exp{it T X}) = exp{it T µ − 1 2 tT Σt}für einen Vektor µ ∈ IR d und eine positiv semidefinite MatrixΣ ∈ IR d×d .8

3. Ein Zufallsvektor X ∈ IR d mit E(X) = µ und cov(X) = Σ, wobeidie Determinante von Σ positiv ist (det(Σ) := |Σ| > 0), ist normalverteilt, d.h. X ∼ N d (µ,Σ), dann und nur dann wenn seineDichtefunktion folgendermaßen gegeben ist{1f X (x) = √(2π) d |Σ| exp − (x − }µ)T Σ −1 (x − µ).2Beweis: (siehe zB. Gut 1995)Theorem 2 (Eigenschaften der multivariaten Normalverteilung)Für X ∼ N d (µ,Σ) gilt:Lineare Kombinationen:Für B ∈ IR k×d und b ∈ IR k . Es gilt dann BX+b ∈ N k (Bµ+b, BΣB T ).Randverteilungen: (Setze X T = X (1)T , X (2)T) für X (1)T = (X 1 , X 2 , . . . , X k ) T undX (2)T = (X k+1 , X k+2 , . . . , X d ) T und analog(µ T = µ (1)T , µ (2)T) und Σ =Es gilt dann X (1) ∼ N k(µ (1) ,Σ (1,1) )( )Σ(1,1)Σ (1,2)Σ (2,1) Σ (2,2) .und X (2) ∼ N d−k(µ (2) ,Σ (2,2) ).9

Bedingte <strong>Verteilungen</strong>:Wenn Σ regulär, dann ist auch die bedingte VerteilungX (2)∣ ∣ X (1) = x (1) multivarial normal:X (2) |X (1) = x (1) ∼ N d−k(µ (2,1) ,Σ (22,1) )wobeiµ (2,1) = µ (2) + Σ (2,1) (Σ (1,1) ) −1 (x (1) − µ (1) )undΣ (22,1) = Σ (2,2) − Σ (2,1) (Σ (1,1) ) −1Σ (1,2) .Quadratische Formen:Wenn Σ regulär, dann gilt D 2 = (X − µ) T Σ −1 (X − µ) ∼ χ 2 d .Die Zufallsvariable D heißt Mahalanobis Distanz.Faltung:Seien X ∼ N d (µ,Σ) und Y ∼ N d (˜µ, ˜Σ) zwei unabhängige Zufallsvektoren.Es gilt dann X + Y ∼ N d (µ + ˜µ,Σ + ˜Σ).10

Normal (variance) mixtureDefinition 3 Ein Zufallsvektor X ∈ IR d hat eine multivariate “normalvariance mixture” Verteilung wenn X d = µ + WAZ wobei Z ∼ N k (0, I)hat eine multivariate standard Normalverteilung, W ≥ 0 ist eine von Zunabhängige positive Zufallsvariable, µ ∈ IR d ist ein konstanter Vektor,A ∈ IR d×k ist eine konstante Matrix, und I ist die einheitsmatrix.Unter der Bedingung W = w ist X normalverteilt: X ∼ N d (µ, w 2 Σ),wobei Σ = AA T .E(X) = µ und cov(X) = E(W 2 AZZ T A T ) = E(W 2 )Σ falls E(W 2 ) < ∞Beispiel 4 Die Inverse Gamma Verteilung hat folgende Dichtefunktion:f(x) = βαΓ(α) x−(α+1) exp(−β/x) x > 0, α > 0, β > 0Falls X ∼ IG(α, β) dann gilt:E(X) =βα − 1 für α > 1, var(X) = β 2(α − 1) 2 (α − 2) für α > 2Sei W 2 ∼ IG(α/2, α/2). Dann ist die Verteilung von X = µ + WAZeine multivariate t α Verteilung mit α Freiheitsgraden: X ∼ t d (α, µ,Σ).cov(X) = E(W 2 )Σ =αα − 2 Σ 11

Sphärische <strong>Verteilungen</strong>Definition 4 Ein Zufallsvektor X = (X 1 , X 2 , . . . , X d ) T hat einesphärische Verteilung wenn für jede orthogonale Matrix U ∈ IR d×ddie Gleichung UX d = X gilt.Theorem 3 Die folgenden Aussagen sind äquivalent.1. Der Zufallsvektor X ∈ IR d hat eine sphärische Verteilung.2. Es existiert eine Funktion ψ:IR → IR, sodass die charakteristischeFunktion von X folgendermaßen gegeben wird:φ X (t) = ψ(t T t) = ψ(t 2 1 + t2 2 + . . . + t2 d )3. Für jeden Vektor a ∈ IR d gilt a t X d = ||a||X 1 wobei||a|| 2 = a 2 1 + a2 2 + . . . + a2 d .4. X lässt sich als X d = RS repräsentieren, wobei der ZufallsvektorS ∈ IR d gleichmäßig verteilt auf der Einheitskugel S d−1 ,S d−1 = {x ∈ IR d : ||x|| = 1}, ist, und R ≥ 0 eine von S unabhängigeZV ist.Notation einer sphärischen Verteilung: X ∼ S d (ψ)12

Beispiel 5 Normalverteilungen sind sphärische <strong>Verteilungen</strong>.Sei X ∼ N(0, I). Dann X ∼ S d (ψ) mit ψ = exp(−x/2).Tatsächlich: φ X (t) = exp{it T 0 − 1 2 tT It} = exp{−t T t/2} = ψ(t T t).Aus der stochastischen Repräsentation X = RS folgt ||X|| 2 = d R 2 ∼ χ 2 d .Simulation einer sphärischen Verteilung:(i) Simuliere s aus einer gleichmäßig verteilten Zufallsvektor in S d−1(zB. in dem y aus einer multivariaten Standard NormalverteilungY ∼ N(0, I) simuliert und s = y/||Y || gesetzt wird).(ii) Simuliere r aus R ∼ χ 2 d .(iii) Setze x = rs.13

Beispiel 6 (<strong>Multivariate</strong> Normalverteilung)Sei X ∼ N(µ,Σ). Es existiert eine Matrix A ∈ IR d×k , sodass X d = µ+AZwobei Z ∈ N d (0, I) und AA T = Σ. Weiters gilt Z = RS wobei S eingleichmäßig verteilter Zufallsvektor in S k−1 ist und R 2 ∼ χ 2 k . Darausfolgt X d = µ+RAS und daher X ∼ E d (µ,Σ, ψ) mit ψ(x) = exp{−x/2}.Beispiel 7 (<strong>Multivariate</strong> normal variance mixture)Ein Zufallsvektor Z ∼ N(0, I) hat eine sphärische Verteilung mit einerstoch. Repräsentation Z d = V S. Falls X = µ + WAZ eine normalvariance mixture ist, dann gilt X d = µ + V WAS wobei V 2 ∼ χ 2 d . D.h.X hat eine elliptische Verteilung mit R = V W.16