Shannon: Informationstheorie - Dies ist unser Püffki, nur ...

Shannon: Informationstheorie - Dies ist unser Püffki, nur ...

Shannon: Informationstheorie - Dies ist unser Püffki, nur ...

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

Energie je Bit<br />

⎛Pn + P ⎞ s<br />

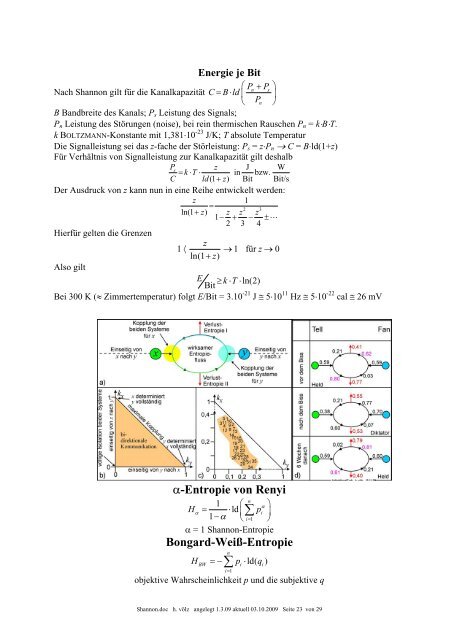

Nach <strong>Shannon</strong> gilt für die Kanalkapazität C= B⋅ld⎜ ⎟<br />

⎝ Pn<br />

⎠<br />

B Bandbreite des Kanals; Ps Le<strong>ist</strong>ung des Signals;<br />

Pn Le<strong>ist</strong>ung des Störungen (noise), bei rein thermischen Rauschen Pn = k⋅B⋅T.<br />

k BOLTZMANN-Konstante mit 1,381⋅10 -23 J/K; T absolute Temperatur<br />

Die Signalle<strong>ist</strong>ung sei das z-fache der Störle<strong>ist</strong>ung: Ps = z⋅Pn → C = B⋅ld(1+z)<br />

Für Verhältnis von Signalle<strong>ist</strong>ung zur Kanalkapazität gilt deshalb<br />

Ps z J W<br />

= k⋅T⋅ in bzw.<br />

C ld(1 + z)<br />

Bit Bit/s<br />

Der Ausdruck von z kann nun in eine Reihe entwickelt werden:<br />

z<br />

1<br />

2 3<br />

ln(1 z ) z z z<br />

1<br />

2 3 4<br />

=<br />

+<br />

− + − ±�<br />

Hierfür gelten die Grenzen<br />

1 〈<br />

1<br />

1+<br />

→ →<br />

z<br />

für z 0<br />

ln( z)<br />

Also gilt<br />

E ≥k⋅T⋅ ln(2)<br />

Bit<br />

Bei 300 K (≈ Zimmertemperatur) folgt E/Bit = 3.10 -21 J ≅ 5⋅10 11 Hz ≅ 5⋅10 -22 cal ≅ 26 mV<br />

α-Entropie von Renyi<br />

n 1<br />

H ld pi 1<br />

i 1<br />

α ⎛ ⎞<br />

α = ⋅<br />

α<br />

⎜∑ −<br />

⎟<br />

⎝ = ⎠<br />

α = 1 <strong>Shannon</strong>-Entropie<br />

Bongard-Weiß-Entropie<br />

n<br />

HBW =−∑ pi⋅ld( qi)<br />

i=<br />

1<br />

objektive Wahrscheinlichkeit p und die subjektive q<br />

<strong>Shannon</strong>.doc h. völz angelegt 1.3.09 aktuell 03.10.2009 Seite 23 von 29