Noter og Formler.pdf - sociologisk-notesblok

Noter og Formler.pdf - sociologisk-notesblok

Noter og Formler.pdf - sociologisk-notesblok

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

W.2 – Simpel lineær regression:<br />

Forudsagte værdier <strong>og</strong> residualer:<br />

Et residual:<br />

For residualerne (baseret på en OLS estimation med konstantled) gælder følgende sammenhænge meka-<br />

nisk:<br />

Egenskaber ved OLS:<br />

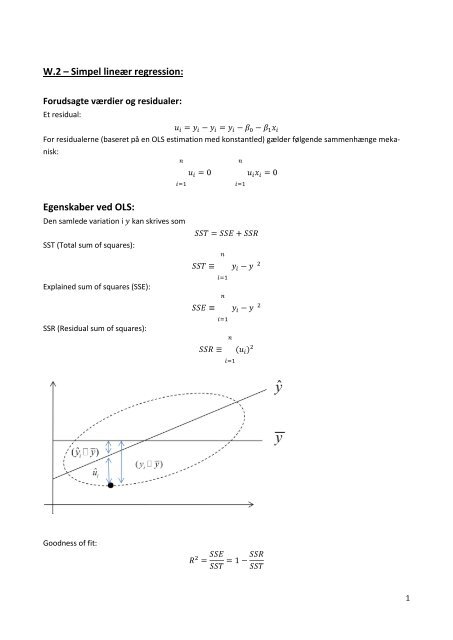

Den samlede variation i kan skrives som<br />

SST (Total sum of squares):<br />

Explained sum of squares (SSE):<br />

SSR (Residual sum of squares):<br />

Goodness of fit:<br />

1

Egenskaber ved R 2:<br />

-<br />

-<br />

ligger mellem 0 <strong>og</strong> 1<br />

falder aldrig hvis man tilføjer en ekstra variabel.<br />

- kan ikke bruges til at sammenligne modeller med forskellige afhængige variable<br />

Standardfejl for OLS estimatorerne<br />

Standardfejl:<br />

Den estimerede varians på fejlleddet, , kan substitueres i udtrykkene for variansen på OLS estimaterne.<br />

Kvadratroden heraf kaldes standardfejlen.<br />

Den estimerede standardafvigelse på OLS estimatet for hældningen fås som:<br />

Standardfejlen er et mål for variabiliteten af estimatoren set over forskellige realisationer af data.<br />

Estimatet kan skrives som:<br />

Lidt regneregler til når man regner med sumtegn:<br />

2

W.3 – Multipel lineær regression:<br />

Den multiple regressionsmodel på matrixform<br />

For et datasæt med n observationer:<br />

<strong>og</strong> er n x 1 (vektor)<br />

er n x (k+1) matrix<br />

Parameteren er (k+1) x 1 matrix (vektor)<br />

Regressionsmodellen skrevet som matrix:<br />

Regressionsmodellen kan <strong>og</strong>så skrives kompakt som:<br />

OLS estimatoren kan udregnes ved brug af moment metoden som i den simple regressionsmodel<br />

Hvis X’X er invertibel (X har fuld rang) kan OLS estimatoren udregnes:<br />

Ækvivalent til at udlede OLS estimatoren ved at minimere residualkvadratsummen:<br />

OLS Residualer:<br />

y1 <br />

<br />

y 2<br />

y ,<br />

<br />

X<br />

1 x1 1<br />

<br />

1 x 2 1<br />

<br />

<br />

x1 k <br />

<br />

x 2 k ,<br />

<br />

u 1 <br />

<br />

u 2<br />

u <br />

<br />

0 <br />

<br />

1<br />

<br />

<br />

y<br />

1 x x<br />

u<br />

<br />

<br />

<br />

n n1 n k n k <br />

y1 1 x1 1 x1 2 x1 k 0 u 1 <br />

<br />

y 2 <br />

<br />

<br />

1<br />

<br />

<br />

x 2 1 x 2 2<br />

<br />

x u<br />

2 k 1 2<br />

<br />

<br />

<br />

y<br />

<br />

1 x x x<br />

<br />

<br />

<br />

u<br />

<br />

N n1 n 2<br />

n k k n <br />

For OLS residualer fra den multiple regressionsmodel (med et konstantled) gælder følgende:<br />

- Gennemsnittet af residualerne er lig 0:<br />

- Kovariansen mellem residualer <strong>og</strong> de forklarende variable er lig 0:<br />

- Punktet er altid på OLS regressionslinien<br />

3

Regressionsmodel uden konstantled estimeret med OLS:<br />

I denne model gælder:<br />

- OLS residualerne har ikke gennemsnit lig 0<br />

- er re-defineret <strong>og</strong> kan blive negativ<br />

- Hvis populationsmodellen indeholder et konstantled, vil OLS estimaterne af være biased<br />

(ikke middelrette).<br />

- I praksis: Medtager altid et konstantled.<br />

Bias i ved udeladelse af (Omitted Variable Bias (OVB)):<br />

At udelade én variabel gør alle estimater biased.<br />

1. Når er biased, <strong>og</strong> er unbiased <strong>og</strong><br />

2. Når er både <strong>og</strong> unbiased <strong>og</strong><br />

Variansen af OLS estimatoren:<br />

+ -<br />

- +<br />

Til at fortolke variansen kan det være lettere at benytte følgende opskrivning af variansen<br />

hvor<br />

De tre komponenter i variansen<br />

Variansen af fejlleddet:<br />

- Jo større varians på fejlleddet jo større varians på alle estimatorerne<br />

Variationen i<br />

- Jo større variation i jo mindre varians på estimatoren for<br />

Variation<br />

- Jo tættere er på 0 jo mindre er variansen på estimatoren for<br />

- Mindst varians opnås ved hvilket svarer til at er ukorreleret med de øvrige forklarende<br />

variable<br />

- Jo tættere er på 1 jo større er variansen på estimatoren for βj<br />

- Hvis antagelsen MLR.3 er opfyldt er altid forskellig fra 1<br />

4

Multikollinearitet<br />

Multikollinearitet optræder, når er tæt på<br />

Følgerne af multikollinearitet:<br />

- Variansen på estimatoren βj vil være stor (se figur 3.1)<br />

Hvornår optræder multikollinearitet:<br />

- Når n<strong>og</strong>le af de forklarende variable er højt korrelerede<br />

- Når der er få observationer<br />

Variansen i misspecificerede modeller<br />

Antag følgende model opfylder Gauss-Markov antagelserne:<br />

Vi har to estimatorer af β1:<br />

- OLS estimatoren fra MLR:<br />

- OLS estimatoren fra SLR:<br />

Den betingede varians af er altid mindre end (eller lig med) variansen af<br />

Hvis <strong>og</strong> er ukorrelerede er variansen den samme <strong>og</strong> begge estimatorer middelrette<br />

Hvis er begge estimatorer middelrette <strong>og</strong> har mindst varians. Altså foretrækkes<br />

Hvis er middelret mens er generelt biased. Variansen af er mindst. Her foretrækkes .<br />

Estimatet på variansen af fejlleddet<br />

Ud fra OLS estimaterne kan residualerne beregnes:<br />

Estimatet beregnes til:<br />

5

MLR.1-6:<br />

MLR.1 (lineær i parametrene):<br />

- Den afhængige variabel y kan beskrives ved følgende model:<br />

MATRIXNOTATION:<br />

MLR.2 (tilfældig stikprøve):<br />

- Vi har en tilfældig stikprøve (yi,xi1, xi2,.., xik) i=1,..,n fra populationen (se definition i Appendix C.1)<br />

MATRIXNOTATION:<br />

MLR.3 (ingen perfekt multikollinaritet)<br />

- I stikprøven (<strong>og</strong> i populationen) kan ingen af de forklarende variable skrives som en lineær funktion<br />

af de øvrige.<br />

- De forklarende variable må godt være korreleret f.eks.:<br />

- Både x <strong>og</strong> x 2 kan være forklarende variable<br />

- Uddannelseslængde, køn <strong>og</strong> erfaring kan indgå i lønligning<br />

MATRIXNOTATION: -matricen har ranken<br />

MLR.4 (betinget middelværdi af fejlled):<br />

- Grunde til at MLR.4 måske ikke er opfyldt:<br />

- Forkert funktionel form (mere i kap. 9)<br />

- Udeladte variable (som er korreleret med en forklarende variabel)<br />

- Målefejl i de forklarende variable (mere i kap. 9)<br />

- Omvendt kausalitet (effekten går fra y til x) (kap. 15)<br />

MATRIXNOTATION:<br />

MLR.5 – Homoskedasticity:<br />

MATRIXNOTATION:<br />

Under antagelse af MLR.1-4 er OLS estimaterne middelrette (unbiased) <strong>og</strong> konsistente (W. 5.1, s.169).<br />

Overholdes MLR.4 ikke er estimaterne <strong>og</strong>så inkonsistente.<br />

Under antagelse af MLR.1-5 er OLS estimaterne BLUE<br />

MLR.6: u er uafhængig af <strong>og</strong> normalfordelt med middelværdi 0 <strong>og</strong> varians .<br />

MLR.1-6 kaldes samlet Classical Linear Model (CLM).<br />

MLR.6 er d<strong>og</strong> ikke relevant ved store n.<br />

6

W.4 – Inferens<br />

Under CLM antagelserne (MLR.1-6) gælder følgende:<br />

, hvor<br />

Estimatet ( ) er normalfordelt med gennemsnit <strong>og</strong> varians .<br />

kan standardiseres:<br />

indeholder den ukendte parameter <strong>og</strong> er derfor ikke umiddelbart operationel.<br />

Erstattes af kan man vise at der gælder følgende resultat:<br />

Teorem 4.2: Under CLM antagelserne gælder at<br />

Hypotesetest: Restriktion på en enkelt koefficient:<br />

t-test for :<br />

t-test for :<br />

To-sidet test benyttes som standard, hvis ikke andet er angivet.<br />

Klassisk teststrategi:<br />

- Vælg signifikansniveau: Sandsynlighed for at afvise nulhypotesen, givet at den er sand. Typisk væl-<br />

ges 5 %.<br />

- Vælg alternativhypotese: Bestemmer den kritiske region, givet signifikansniveauet.<br />

- Beregn teststatistik.<br />

- Afvis nulhypotesen hvis testet er i den kritiske region.<br />

- Afvis ellers ikke.<br />

- Alternativ: Beregn p-værdi: Marginale signifikansniveau som ville betyde at nulhypotesen netop<br />

P-værdi:<br />

ville blive afvist:<br />

7

Konfidensintervaller:<br />

Hypotesetest: Flere lineære restriktioner:<br />

Et fælles test af flere lineære restriktioner: F-testet:<br />

- Tæller altid større end eller lig nul: Restrikteret model kan ikke tilpasse data bedre end urestrikteret<br />

model.<br />

- Antal frihedsgrader i tæller: Antal restriktioner, q<br />

- Antal frihedsgrader i nævner: n- antal regressorer i urestrikteret model.<br />

- Helt generelt format for F-testet.<br />

F-testet kan <strong>og</strong>så skrives med :<br />

F = t 2 :<br />

For en restriktion <strong>og</strong> to-sidet alternativ: Ækvivalent med t-test:<br />

Men F-test af fælles hypotese på flere koefficienter kan godt give andet resultat end individuelle t-test.<br />

Samlet signifikans af regressionen:<br />

:<br />

hvilket giver den restrikterede model:<br />

Relationen mellem R 2 <strong>og</strong> F-testet for denne specielle hypotese:<br />

Lagrange Multiplikator testet:<br />

Generelt format:<br />

- Estimation af modellen under H0<br />

- Residualer fra restrikteret model,<br />

- Hjælperegression (“auxiliary regression”) af<br />

- På hvad: afhænger af den specifikke hypotese.<br />

Kræver ikke estimation af den generelle (dvs.urestrikterede model): Oftest den i praksis sværeste.<br />

LM testet kan anvendes når Gauss-Markov antagelserne (MLR.1-MLR.5) er opfyldt.<br />

8

LM-test (Lagrange multiplier statistic)<br />

LM-teststørrelsen vil almindeligvis (<strong>og</strong> uanset om der antages normalfordelte fejlled eller ej) være asympto-<br />

tisk fordelt som , hvor er antallet af restriktioner.<br />

Inferens i den multiple regressionsmodel: Opsamling:<br />

Resultater om OLS med endeligt antal observationer: Normalitetsantagelse eksakte t- <strong>og</strong> F-test.<br />

Asymptotiske resultater for OLS:<br />

- Konsistens under MLR.1-4.<br />

- Asymptotisk normalfordelt under MLR.1-5:<br />

- t- <strong>og</strong> F-test begrundes approximativt i endeligt datasæt uden at antage normalfordelte fejlled.<br />

- Andre typer af test: Lagrange multiplikator testet<br />

- Asymptotisk efficiens af OLS under MLR.1-5.<br />

9

W.5 – Asymptotisk<br />

Konsistens:<br />

Konsistens af OLS i store datasæt under MLR.1-4: Minimumskrav opfyldt.<br />

Inferens: Vi behøver mere end det. Antager nu:<br />

- MLR.5: Homoskedasticitet:<br />

- Men ikke MLR.6: Normalitet af ui<br />

Konsistens af en estimator defineres som:<br />

er estimator for baseret på<br />

er konsistent for hvis for ethvert gælder at,<br />

Estimatoren konvergerer i sandsynlighed mod den sande værdi:<br />

Egenskab for estimatoren når antallet af observationer øges mod uendeligt.<br />

Minimalkrav til en ”fornuftig” estimator.<br />

Middelret estimator er ikke nødvendigvis konsistent: Præcisionen bliver ikke nødvendigvis bedre når<br />

Men: Hvis variansen af en middelret estimator går mod nul i sandsynlighed når , så gælder at<br />

Under MLR.1-4 er OLS-estimatoren konsistent for .<br />

Hvis fejlleddet er korreleret med en eller flere regressorer vil OLS være inkonsistent:<br />

for<br />

eller ,<br />

Inkonsistensen (den ”asymptotiske bias”) i den simple lineære regressionsmodel er givet ved<br />

OLS standardfejlen: Asymptotisk:<br />

Efficiens:<br />

Efficiens drejer sig om at sammenligne variansen af forskellige middelrette estimatorer (definition (se ap-<br />

pendix C.2)).<br />

10

Oversigt over OLS estimatorens egenskaber:<br />

Antagelser Eksakt Asymptotisk<br />

MLR1-MLR4 Middelret (Teorem 3.1) Konsistent (Teorem 5.1)<br />

MLR1-MLR5 BLUE (Teorem 3.4)<br />

MLR1-MLR6 Normalfordelt (Teorem 4.1)<br />

Asymptotisk Normalfordelt (Teorem 5.2)<br />

Asymptotisk efficient (Teorem 5.3)<br />

11

W.6 – Flere emner<br />

Skalering:<br />

Skaleringen af variablerne er ofte arbitrær: Ex. Afstand målt meter vs. kilometer (1000 m) vs. amerikanske<br />

miles (1609 m) vs. svenske mil (10000 m).<br />

RHS-variabler:<br />

I princippet: Frit valg af skala for de enkelte<br />

Koef.estimat <strong>og</strong> std. fejl reskaleres. Alt andet uændret (inkl. t-værdierne).<br />

Ex:<br />

: afkast af en måneds ekstra uddannelse<br />

: afkast af et års ekstra erfaring<br />

Ønsker begge dele i pro anno termer: Definerer uddannelse i år: indsæt i model:<br />

Definer <strong>og</strong> indsæt:<br />

Hvis multipliceres med en konstant bliver ’s koefficient divideret med denne konstant, .<br />

LHS-variabler:<br />

Definer ,<br />

Koef.estimat <strong>og</strong> std. fejl reskaleres ligesom SSR, SST, SSE <strong>og</strong><br />

<strong>og</strong> t-værdierne uændrede.<br />

Funktionel form:<br />

MLR forudsætter, at modellen er lineær i parametrene, men ikke i variablerne.<br />

Funktionel form: Fortolkningsmæssige konsekvenser!<br />

Tre vigtige tilfælde:<br />

- L<strong>og</strong>-transformation<br />

- Kvadratiske led<br />

- Interaktionsled<br />

12

L<strong>og</strong>-transformation:<br />

Fordele ved l<strong>og</strong>.<br />

- Variansen på en størrelse kan afhænge af niveauet: Relativ varians er mere stabil ex. løn.<br />

- Strengt positive variable: ex. Løn.<br />

- Mindre betydning af ekstreme observationer (l<strong>og</strong> nedvægter store værdier mere end små værdier)<br />

NB. L<strong>og</strong> kan ikke bruges, når en variabel tager værdien 0<br />

Model Afhængig Forklarende Elasticitet y mht. x<br />

Level-level y X<br />

L<strong>og</strong>-level l<strong>og</strong>(y) X<br />

Level-l<strong>og</strong> y l<strong>og</strong>(x)<br />

L<strong>og</strong>-l<strong>og</strong> l<strong>og</strong>(y) L<strong>og</strong>(x)<br />

Kvadratiske led:<br />

Aftagende eller stigende marginaludbytte/-effekt<br />

Maksimum eller minmum af :<br />

Interaktionsled:<br />

Marginal effekt af at ændre værdien af en forklarende variabel, , afhænger af værdien af fx :<br />

Fx: Afkastet af uddannelse kan variere med erfaring.<br />

13

W.7 – Dummy variable<br />

Fortolkning af parameteren til dummyvariablen:<br />

- Koefficienten til dummyvariablen måler den forventede forskel mellem de to kategorier, alt andet<br />

lige<br />

- Inkludering af en dummyvariabel kan grafisk fortolkes som et skift i konstantleddet<br />

- ..men koefficienterne til de øvrige forklarende variabler er restrikteret til at være ens for de to<br />

grupper<br />

Vil man have den eksakte procentuelle forskel skal følgende formel anvendes<br />

Begge dummy-variable kan ikke inkluderes samtidigt (hvis der <strong>og</strong>så er et konstantled i modellen) -> Perfekt<br />

multikollinearitet (”dummyvariabelfælden”).<br />

Hvis den kvalitative egenskab har m kategorier (m>2) skal man lave m-1 dummy variable.<br />

Den kategori hvortil der ikke hører en dummy variabel kaldes reference kategorien.<br />

Hvis man inkluderer m dummy variabler <strong>og</strong> et konstantled vil der være perfekt multikollinearitet<br />

Parametrene til dummy variablerne angiver forskellen mellem den pågældende kategori <strong>og</strong> referencekate-<br />

gorien.<br />

Interaktionsled mellem dummyvariabler <strong>og</strong> kvantitative variabler kan fortolkes som forskellig marginal ef-<br />

fekt af den kvantitative variabel<br />

Chow-test:<br />

Test for om der er forskel mellem to grupper.<br />

Modellen kan formuleres ved brug af dummy (d2=0 for gruppe 1, d2=1 for gruppe 2):<br />

kan formuleres som:<br />

For antal grupper :<br />

For antal grupper :<br />

, hvor er antallet af grupper. Testet er F-fordelt <strong>og</strong><br />

forudsætter MLR.5 <strong>og</strong> derfor samme varians i hver gruppe<br />

Robust udgave af testet kræver at vi opstiller den samlede model med fuldt sæt af interaktionsled.<br />

14

Lineær sandsynlighedsmodel (Linear probability model (LPM)):<br />

For en kvalitativ egenskab med to kategorier laver man en dummyvariabel y med to mulige udfald: y=0 eller<br />

y=1<br />

Regressionsmodellen er uændret:<br />

Modellen kaldes den lineære sandsynlighedsmodel (linear probability model, LPM)<br />

Hvis antagelsen MLR.4 er opfyldt:<br />

er den betingede middelværdi af y:<br />

For binære variabler gælder generelt at:<br />

Altså har vi en model for responssandsynligheden<br />

Fortolkningen af parametrene i LPM:<br />

- y er en diskret variabel<br />

- Parameteren kan ikke fortolkes som den marginale ændring i givet en enheds ændring i<br />

Parameteren angiver ændringen i sandsynligheden for som følge af, at den forklarende variabel æn-<br />

dres med en enhed:<br />

LPM kan estimeres med OLS:<br />

Hvor skal fortolkes som den predikterede sandsynlighed for .<br />

Ulemper ved LPM:<br />

- Prediktionerne er ikke 0 eller 1, som er de tilladte værdier af den afhængige variabel<br />

- Predikterede sandsynligheder kan være negative eller overstige 1<br />

- Normalt ligger den predikterede sandsynlighed mellem 0 <strong>og</strong> 1, når man ser på værdier af de forkla-<br />

rende variable der ligger omkring gennemsnittet.<br />

- Gauss-Markov antagelserne:<br />

- MLR.1-4 kan godt være opfyldt for LPM<br />

- LPM opfylder ikke antagelsen MLR.5 (Homoskedasticitet)<br />

For en given værdi af x har u to mulige udfald (binær variabel):<br />

Variansen er derfor givet ved:<br />

hvis<br />

Som generelt vil afhænge af : er heteroskedastisk.<br />

Undtagelsen er tilfældet<br />

Egenskaber ved OLS estimatoren i LPM<br />

- OLS estimaterne er middelrette (givet MLR.1-4)<br />

hvis<br />

15

- Standardfejlene af estimaterne er ikke middelrette<br />

- F <strong>og</strong> t test ikke pålidelige<br />

Problemet med heteroskedasticitet kan løses ved at korrigere standardfejlene <strong>og</strong> beregne robuste stan-<br />

dardfejl: Sjældent n<strong>og</strong>et alvorligt problem.<br />

16

W.8 – Heteroskedasticitet<br />

MLR.5 er antagelsen om homoskedasticitet:<br />

Alternativ: Modellen lider af heteroskedasticitet af ukendt form:<br />

Vi tillader altså, at fejlleddet til hver enhed (individ, firma, land) har sin egen varians (meget generel form)<br />

Homoskedasticitet kan ses som det specialtilfælde, hvor for alle .<br />

Antagelserne MLR.1- MLR.4 sikrer at OLS middelret <strong>og</strong> konsistent, men vedrører ikke variansen på fejlled-<br />

det.<br />

Under MLR.1-5 er OLS efficient <strong>og</strong> dens varians er givet ved de simple udtryk fra kapitel 2.<br />

OLS estimatorens egenskaber ved heteroskedasticitet:<br />

+ OLS stadig middelret <strong>og</strong> konsistent (givet MLR.1-4)<br />

- Variansen af OLS estimaterne estimeres ikke middelret eller konsistent af de sædvanlige OLS-udtryk<br />

- Konfidensintervallet er ikke rigtigt konstrueret<br />

- t <strong>og</strong> F-test er ikke nødvendigvis t <strong>og</strong> F-fordelt, LM test er ikke nødvendigvis -fordelt (<strong>og</strong> derfor er<br />

disse test ikke pålidelige)<br />

- OLS er ikke længere den bedste lineære middelrette estimator (BLUE): Der findes andre lineære mid-<br />

delrette estimatorer med mindre varians<br />

- OLS er ikke længere asymptotisk efficient<br />

OLS-baserede test under heteroskedasticitet:<br />

- Heteroskedasticitet i fejlleddet betyder, at test der er baseret på OLS estimation kun er gyldige, hvis<br />

man korrigerer standardfejlene for heteroskedasticitet ved at bruge robuste standardfejl.<br />

Test i modeller med heteroskedasticitet:<br />

Enkelt restriktion:<br />

Heteroskedasticitets-robust t-test af hypotesen: :<br />

t-teststørrelse:<br />

hvor er heterosk. robust standardfejl på<br />

t-teststørrelsen er asymptotisk standard normalfordelt.<br />

17

Flere restriktioner (Wald test):<br />

Hypotese: :<br />

hvor er en (k+1)x1 vektor af parametre, er en q x(k+1) matrix <strong>og</strong> er en q x1 vektor<br />

Heterosk. robust F-test kan beregnes ud fra robust kovariansmatrix<br />

Heterosk. robust Wald test: Wald-teststørrelsen<br />

Wald testet er altså -fordelt.<br />

NB’er:<br />

- Antagelserne MLR.1- MLR.4, som sikrer at OLS middelret <strong>og</strong> konsistent, vedrører ikke variansen på<br />

fejlleddet.<br />

- Heteroskedasticitet betyder systematik i variansen på fejlleddet, ikke i middelværdien (givet at<br />

MLR.4 holder).<br />

Inferens uden MLR.5:<br />

Whites standardfejl som er robuste overfor heteroskedasticitet. Robust Wald-test.<br />

Weighted Least Squares (WLS):<br />

Estimatoren som korrigerer for heteroskedasticitet kaldes for Weigted Least squares (WLS).<br />

Navnet hentyder til at estimaterne opnås ved at minimere de vægtede kvadrerede residualer.<br />

Heteroskedasticitet af en kendt form (op til en multiplikativ faktor)<br />

antages at være en kendt funktion af de forklarende variable.<br />

for alle mulige værdier af x’erne (varianser er altid positive).<br />

er en ukendt parameter.<br />

Ved at bruge informationen om formen for heterosk. kan modellen transformeres til en ”ny” model, som<br />

ikke indeholder heteroskedasticitet: OLS på den vægtede regression er efficient: Weighted Least Squares<br />

(WLS)<br />

Generelt: Antag følgende multiple regressionsmodel (som opfylder antagelserne MLR.1- MLR.4)<br />

Givet at h er en kendt funktion kan dens værdi beregnes for hver enkelt observation:<br />

Hvis man transformerer modellen så fejlleddet bliver vil den betingede middelværdi stadig være<br />

nul (MLR.4 holder) <strong>og</strong> den betingede varians vil være konstant (MLR.5 opfyldt).<br />

OLS estimatoren i den transformerede model vil være BLUE<br />

F- <strong>og</strong> t-test er gyldige for den transformerede model<br />

er sjældent meningsfuld (ny venstresidesvariabel!)<br />

18

Lineær sandsynlighedsmodel (Linear probability model (LPM)):<br />

I den lineære sandsynlighedsmodel er der heteroskedasticitet:<br />

Det følger så hvordan h skal konstrueres nemlig som<br />

FGLS: Ukendt form af heteroskedasticitet (som skal estimeres):<br />

- I mange tilfælde er den eksakte form for heterosk. ukendt (dvs. h er ukendt), men h kan modelleres<br />

<strong>og</strong> efterfølgende estimeres<br />

- Ved at benytte I stedet for kan man igen transformere den oprindelige model.<br />

- I den transformerede model benyttes så OLS.<br />

- Denne procedure kaldes Feasible (”ladsiggørlig”) GLS (FGLS)<br />

- Den optimale vægt til hver observation kan estimeres ud fra data: FGLS.<br />

Hypotesetest med FGLS estimater:<br />

- FGLS er konsistent <strong>og</strong> asymptotisk mere efficient end OLS<br />

- F- <strong>og</strong> t-test er asymptotisk hhv. F- <strong>og</strong> t-fordelte.<br />

- Når man laver F-test med FGLS (<strong>og</strong> med WLS) er det vigtigt at den restrikterede <strong>og</strong> den urestrikte-<br />

rede model er estimeret med de samme vægte<br />

WLS/FGLS <strong>og</strong> OLS:<br />

- Sammenligning af WLS/FGLS <strong>og</strong> OLS<br />

- OLS <strong>og</strong> WLS estimater kan være (meget) forskellige<br />

- Hvis OLS <strong>og</strong> WLS er statistisk signifikant forskellige, bør man være varsom med at fortolke resulta-<br />

terne. Dette kan være tegn på misspecifikation af modellen (specielt at antagelse MLR.4 ikke er op-<br />

fyldt).<br />

19

W.9 – Data Specifikation<br />

Hvad nu, hvis man benytter en forkert funktionel form?<br />

- Generelt vil OLS estimaterne ikke være middelrette eller konsistente<br />

- Forkert funktionel form kan opfattes som udeladte variable<br />

W. 9.2 – Proxy variable<br />

Proxyvariabler erstatter udeladte variabler. Proxyens ”effekt” på y har sjældent selvstændig interesse.<br />

Man må argumentere for proxyvariablens gyldighed i hvert enkelt tilfælde.<br />

Det ønskes at estimere<br />

, hvor<br />

, hvor er et fejlled, der beskriver den del af som ikke beskriver. <strong>og</strong> højst sandsynligt ,<br />

da vi jo som regel forventer en positiv korrelation mellem <strong>og</strong> .<br />

Følgende antagelser skal gøre sig gældende:<br />

1: <strong>og</strong> skal være korrelerede.<br />

2: skal være U-korreleret med <strong>og</strong> <strong>og</strong> <strong>og</strong>så .<br />

3: skal være U-korreleret med <strong>og</strong> .<br />

Forsøg på at forklare antagelserne i ord:<br />

1) Proxyen/proxyerne skal forklare en del af variationen i den (uobserverede) variabel, som de(n) er pro-<br />

xy(er) for.<br />

2) Variationen, der ikke forklares i , altså , må ikke være korreleret med de andre variable i .<br />

W. 9.4 – Målefejl<br />

Begrebsmæssig forskel til proxy-variable<br />

- Målefejl: Uobserveret variabel har en præcis kvantitativ betydning: indkomst vs. rapporteret ind-<br />

komst.<br />

- Proxy: Uobserveret variabel har ikke en klar kvantitativ mening: Evner vs. IQ-test score<br />

To hovedtilfælde:<br />

- Målefejl i afhængig variabel<br />

- Målefejl i en eller flere forklarende variabler<br />

Målefejl i den afhængige variabel:<br />

Antag følgende model<br />

Modellen opfylder MLR.1-MLR.4<br />

Desværre observerer man ikke . I stedet observeres :<br />

hvor kan opfattes som en målefejl<br />

20

For at kunne estimere modellen skal erstattes med :<br />

Under antagelserne<br />

- Middelværdien af målefejlene er 0<br />

- Målefejlene er uafhængige af de forklarende variable<br />

vil den ”nye” model med y opfylde MLR.1-MLR.4, <strong>og</strong> derfor er OLS middelret <strong>og</strong> konsistent.<br />

Variansen i det nye fejlled:<br />

- Normalt antager man, at variansen af målefejlen er konstant. Så er antagelsen MLR.5 <strong>og</strong>så opfyldt<br />

for den ”nye” model.<br />

- Variansen er større med målefejl -> større varians af parameterestimaterne.<br />

Målefejl i de forklarende variabler:<br />

Antag følgende model:<br />

er uobserverbar. I stedet observeres som er givet ved:<br />

Antagelse om fejlleddet: ,<br />

Antagelserne om målefejlen:<br />

I dette tilfælde kan opfattes som en proxy for .<br />

OLS er der stadig middelret <strong>og</strong> konsistent.<br />

Dette (At målefejlen er ukorreleret med det observerede x) er ofte en urealistisk antagelse.<br />

Klassiske målefejl (CEV): Målefejlen er ukorreleret med den sande værdi af variablen.<br />

Antagelser:<br />

Disse antagelser er ofte mere naturlige.<br />

OLS er ikke længere middelret eller konsistent under CEV.<br />

Under CEV er der ligeledes attenuation bias:<br />

vil altid være tættere på end .<br />

Estimatet for vil være asymptotisk biased mod .<br />

Det kan ligeledes vises at<br />

21

Data problemer<br />

Indtil videre har vi antaget, at MLR.2 altid er opfyldt<br />

Vi har antaget, at data stammer fra en tilfældig stikprøve<br />

Der er mange grunde til, at denne antagelse ikke er opfyldt i praksis:<br />

- Manglende observationer: Tilfældigt eller ej?<br />

- Ikke-tilfældig dataudvælgelse: Ex<strong>og</strong>ent eller end<strong>og</strong>ent.<br />

Manglende observationer:<br />

- Manglende observationer vil reducere antallet af brugbare observationer i analysen<br />

- Det afgørende for, om manglende observationer giver alvorlige problemer, er hvorfor observatio-<br />

nerne mangler<br />

- Hvis observationerne mangler ”tilfældigt”, er det et mindre problem -> mindre præcise estimater<br />

Ikke-tilfældig dataudvælgelse:<br />

Der er forskellige måder hvorpå stikprøven kan være ikke-tilfældig (dvs. antagelse MLR.2 ikke er opfyldt):<br />

- Eks<strong>og</strong>en dataudvælgelse<br />

- End<strong>og</strong>en dataudvælgelse<br />

- Stratificeret dataudvælgelse<br />

Dataudvælgelse der er baseret på information, der er relateret til den afhængige variabel, giver ofte anled-<br />

ning til bias.<br />

Eks<strong>og</strong>en dataudvælgelse:<br />

- Dataudvælgelse baseret på værdien af en af de forklarende variabler<br />

- Denne type af dataudvælgelse vil (under forudsætninger af nok variation i de forklarende variabler)<br />

stadig give middelrette <strong>og</strong> konsistente OLS etimater<br />

- Generelt: Dataudvælgelse baseret på variabler, som er uafhængige af fejlleddet giver stadig, at OLS<br />

estimaterne er middelrette <strong>og</strong> konsistente<br />

End<strong>og</strong>en dataudvælgelse:<br />

- Dataudvælgelse baseret på den afhængige variabel (eller variabler, der er korrelerede dermed).<br />

- OLS estimator er ikke middelret <strong>og</strong> ikke konsistent.<br />

Stratificeret dataudvælgelse:<br />

- Populationen er delt i grupper (disjunkte grupper som udgør hele populationen)<br />

- N<strong>og</strong>le grupper er udvalgt mere hyppigt end andre, sammenlignet med deres andel af populationen<br />

- OLS er middelret <strong>og</strong> konsistent, hvis gruppeopdelingen er baseret på eks<strong>og</strong>ene variabler<br />

22

W.15 – IV<br />

Instrument variablen skal opfylde to betingelser:<br />

1.<br />

Instrumentvariablen skal være ukorreleret med de uobserverbare faktorer , hvilket i sidste ende altid<br />

afhænger af en teoretisk baseret antagelse.<br />

2.<br />

Instrumentvariablen skal være korreleret med den end<strong>og</strong>ene forklarende variabel. Testbar antagelse på<br />

grundlag af data på <strong>og</strong> : Signifikant regressionskoefficient i regression af på .<br />

Givet identificeres parameteren som<br />

IV estimatoren er konsistent <strong>og</strong> asymptotisk normalfordelt.<br />

IV estimatoren: Har gode asymptotiske egenskaber, dvs. vi ved at den virker i store datasæt. Men:<br />

- IV generelt ikke middelret<br />

- IV vil ofte have en relativt stor varians.<br />

Eksakt identifikation: Vi har netop instrumenter til rådighed, samme antal som der er end<strong>og</strong>ene regresso-<br />

rer:<br />

ex<strong>og</strong>ene variabler: (”instrumenter for sig selv”).<br />

Z rummer alle ex<strong>og</strong>ene variabler i modellen:<br />

- variabler, der er inkluderet i den strukturelle ligning<br />

- variabler, der er ekskluderet fra strukturel ligning<br />

IV-estimatet i det eksakt identificeret tilfælde:<br />

Den simple IV formel kan beregnes for det eksakt identificerede tilfælde (antal end<strong>og</strong>ene regressorer =<br />

antal instrumenter)<br />

Z <br />

[ X X ... X Z Z ... Z ]<br />

1 2 k l 1 2 l<br />

k l ex o g en e l in stru m en ter<br />

IV estimation kan gennemføres som OLS i to trin: 2SLS.<br />

Overidentifikation: Flere instrumenter end nødvendigt.<br />

Det er er fordel. Vi kan få mere præcise estimater, forudsat at instrumenterne er gyldige!<br />

IV-estimatet i det overidentificerede tilfælde(Flere instrumenter end end<strong>og</strong>ene regressorer) (2SLS):<br />

Test af overidentificerende restriktioner:<br />

Teststatistik: , hvor l er antallet af end<strong>og</strong>ene variable <strong>og</strong> g er antallet af instrumenter.<br />

Eksakt identifikation: (ingenting at teste!).<br />

23

W.13 – Gentagne tværsnit & Paneldata<br />

Gentagne tværsnit<br />

Tillade at koefficienterne til n<strong>og</strong>le af variablerne ændres over tid: Et specialtilfælde af strukturelle skift.<br />

Brug dummy variabler: Tidsdummier (fx årsdummier)<br />

To perioder: Dummyvariabel (sædvanligvis for periode 2) indeholder information om tidspunkt for<br />

observationen:<br />

, hvis individ i er i periode-2 samplet.<br />

, hvis individ i ikke er i periode-2 samplet.<br />

Ofte: Tillad at konstantleddet ændres<br />

Tillade at <strong>og</strong>så andre koefficienter ændres mellem perioder: Interaktionsled mellem variabler <strong>og</strong><br />

tidsdummyer.<br />

Eks.:<br />

Ækvivalent regressionstilgang (tavlegennemgang):<br />

: Fælles ændring over tid (uanset placering)<br />

: ”Præ-indgreb”-forskellen i huspriser<br />

: Forskel i huspriser på grund af forbrændingsanlægget<br />

Illustration af Diff-in-diff estimatoren:<br />

Kontrol<br />

Behandling<br />

Behandling – kontrol<br />

Før Efter Efter – før<br />

”Pooling” af data for forskellige tidsperioder: Større eller mindre grad af fleksibilitet ved brug af<br />

interaktionsled mellem forklarende variabler <strong>og</strong> tidsdummyer.<br />

Politikanalyse med gentagne tværsnit: Diff-in-diff metoden gør det muligt under visse forudsætninger at<br />

evaluere effekten af et politikindgreb.<br />

Ækvivalent regressionsmodel giver mulighed for at korrigere for andre kontrolvariabler.<br />

To-periode panel data (Kaldes <strong>og</strong>så longitudinale data):<br />

Følger de samme individer over to perioder<br />

”Unobserved effects model”: Fejlleddet opdeles i en tids-invariant <strong>og</strong> en ”idiosynkratisk” effekt<br />

Udeladt variabel bias (heter<strong>og</strong>enitetsbias)<br />

Første-differens estimation<br />

Politikanalyse med to-periode paneldata<br />

24

Sammensat fejlled :<br />

Uobserveret ”fixed effect” (uobserveret heter<strong>og</strong>enitet):<br />

- Tids-invariant<br />

- Specifik for hvert individ<br />

Idiosynkratisk fejl :<br />

- Varierer tilfældigt både over individer <strong>og</strong> tid: Det ”sædvanlige” fejlled<br />

Antagelser på modellen for T = 2:<br />

Tilfældig stikprøve (ingen korrelation mellem individ i <strong>og</strong> j).<br />

Sammensat fejlled :<br />

Betinget middelværdi, givet regressorerne <strong>og</strong> individ-specifik effekt:<br />

Implicerer at det ”idiosynkratiske” fejlled er ukorreleret<br />

- med de observerede regressorer<br />

- <strong>og</strong> med den uobserverede individ-specifikke effekt<br />

NB: Vi gør ingen antagelser om : ”Fixed effects” tilgang.<br />

Korreleret uobserveret heter<strong>og</strong>enitet<br />

Uobserveret individ-specifik effekt kan meget vel være korreleret med de observerede variabler:<br />

”Pooling” af observationer <strong>og</strong> estimation med OLS vil være en inkonsistent estimator når .<br />

Hvis data kun består af et enkelt tværsnit af <strong>og</strong> kan problemet ikke løses uden yderligere antagelser.<br />

Gentagne observationer af samme individer giver mulige løsninger.<br />

”Fixed effect” paneldata løsning: Estimér en model hvor:<br />

- Parameteren af interesse, , er identificeret <strong>og</strong>…<br />

- …”fixed effekten”, , ikke indgår.<br />

En metode der opfylder disse betingelser er første-differens (FD) estimation.<br />

Første-differens estimation<br />

Model:<br />

Periode 1:<br />

Periode 2:<br />

Første differenser:<br />

Den uobserverede, men tids-invariate ”fixed effect” bliver ”diff-renset” væk.<br />

For <strong>og</strong> imod brug af første -differens estimation<br />

For: Leddet indgår i som en del af fejlleddet. Hvis er korreleret med den forklarende variabel,<br />

, vil (idet <strong>og</strong> <strong>og</strong> er indbyrdes ukorrelerede). OLS på det sammensatte tværsnit<br />

vil i så fald ikke være konsistent. En første-differens OLS estimation baseret på model (1) vil<br />

derimod automatisk korrigere for enhver tidsinvariant faktor (observeret eller uobserveret), jf.<br />

opskrivningen. Her kræves ingen antagelse om for konsistens.<br />

25

Imod: er ikke identificeret i første-differens modellen. Hvis der ikke er variation i over tid (for<br />

mindst et amt), kan OLS estimatoren ikke beregnes på første-differenserne. Hvis for alle<br />

er der faktisk ingen amtspecifik effekt <strong>og</strong> (givet at SLR.1-5 holder for niveaumodellen) OLS på det<br />

sammensatte tværsnit vil være efficient. Hvis der er klassiske målefejl i bliver begge estimatorer<br />

inkonsistente. Målefejlsbiasen forstærkes af første-differens transformationen, så den asymptotiske<br />

bias er størst for første-differens OLS estimatoren.<br />

Opsamlende<br />

Paneldata gør det muligt at korrigere for uobserverede individ-specifikke effekter, som er konstante over<br />

tid: ”Fixed effects”<br />

”Fixed effects” metoder, fx førstedifferens estimation, kan give konsistente parameterestimater uden anta-<br />

gelser omkring korrelationen mellem den uobserverede individ-specifikke effekt <strong>og</strong> de observerede forkla-<br />

rende variabler i modellen.<br />

”Fixed effects” metoder identificerer kun koefficienter til variabler, som faktisk varierer over tid (for n<strong>og</strong>le<br />

af individerne).<br />

26

Overview over econometric methods in QM2 (does not cover everything in the syllabus)<br />

Econometric method<br />

Characteristics of<br />

Model<br />

Hypothesis test<br />

Specification test<br />

OLS<br />

Lin.reg.model<br />

(chap. 2,3,4,5)<br />

t-test<br />

F-test<br />

LM-test<br />

RESET<br />

test<br />

OLS<br />

Robust std. err.<br />

Heteroskedasticity<br />

(chap. 8)<br />

Robust t, Wald,<br />

LM test<br />

Breusch-Pagan<br />

White<br />

Graphical test<br />

WLS FGLS<br />

t test<br />

F test<br />

t test<br />

F test<br />

IV<br />

(2SLS)<br />

End<strong>og</strong>eneity<br />

(chap. 15)<br />

t test<br />

F test<br />

Test of ex<strong>og</strong>eneity<br />

Test of overident.<br />

Restrictions<br />

Paneldata<br />

methods<br />

More observations for<br />

the same individ. (chap.<br />

13)<br />

t test<br />

F test<br />

After transformation:<br />

Do OLS/FGLS<br />

27