Beispiel Lesart

Beispiel Lesart

Beispiel Lesart

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

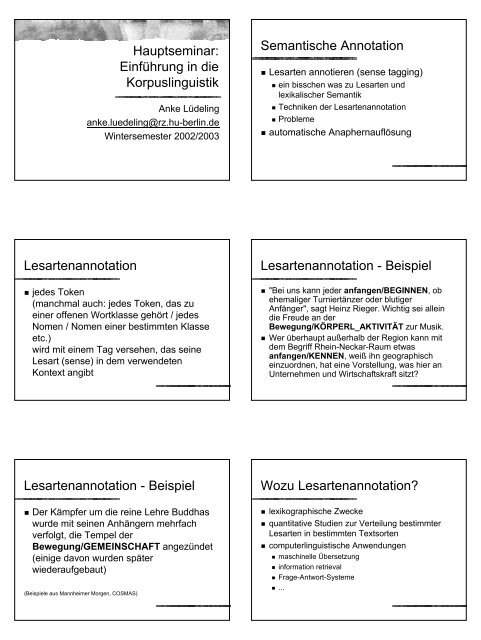

Hauptseminar:<br />

Einführung in die<br />

Korpuslinguistik<br />

Anke Lüdeling<br />

anke.luedeling@rz.hu-berlin.de<br />

Wintersemester 2002/2003<br />

Semantische Annotation<br />

• <strong>Lesart</strong>en annotieren (sense tagging)<br />

• ein bisschen was zu <strong>Lesart</strong>en und<br />

lexikalischer Semantik<br />

• Techniken der <strong>Lesart</strong>enannotation<br />

• Probleme<br />

• automatische Anaphernauflösung<br />

<strong>Lesart</strong>enannotation<br />

• jedes Token<br />

(manchmal auch: jedes Token, das zu<br />

einer offenen Wortklasse gehört / jedes<br />

Nomen / Nomen einer bestimmten Klasse<br />

etc.)<br />

wird mit einem Tag versehen, das seine<br />

<strong>Lesart</strong> (sense) in dem verwendeten<br />

Kontext angibt<br />

<strong>Lesart</strong>enannotation - <strong>Beispiel</strong><br />

• "Bei uns kann jeder anfangen/BEGINNEN, ob<br />

ehemaliger Turniertänzer oder blutiger<br />

Anfänger", sagt Heinz Rieger. Wichtig sei allein<br />

die Freude an der<br />

Bewegung/KÖRPERL_AKTIVITÄT zur Musik.<br />

• Wer überhaupt außerhalb der Region kann mit<br />

dem Begriff Rhein-Neckar-Raum etwas<br />

anfangen/KENNEN, weiß ihn geographisch<br />

einzuordnen, hat eine Vorstellung, was hier an<br />

Unternehmen und Wirtschaftskraft sitzt?<br />

<strong>Lesart</strong>enannotation - <strong>Beispiel</strong><br />

• Der Kämpfer um die reine Lehre Buddhas<br />

wurde mit seinen Anhängern mehrfach<br />

verfolgt, die Tempel der<br />

Bewegung/GEMEINSCHAFT angezündet<br />

(einige davon wurden später<br />

wiederaufgebaut)<br />

(<strong>Beispiel</strong>e aus Mannheimer Morgen, COSMAS)<br />

Wozu <strong>Lesart</strong>enannotation?<br />

• lexikographische Zwecke<br />

• quantitative Studien zur Verteilung bestimmter<br />

<strong>Lesart</strong>en in bestimmten Textsorten<br />

• computerlinguistische Anwendungen<br />

• maschinelle Übersetzung<br />

• information retrieval<br />

• Frage-Antwort-Systeme<br />

• ...

<strong>Lesart</strong>en (senses)<br />

• ! hier nur ganz grober Überblick –<br />

Genaueres in den Seminaren von<br />

Prof. Lang und Prof. Krifka !<br />

• Wieviele <strong>Lesart</strong>en hat ein Lemma?<br />

• (Wie hängen die <strong>Lesart</strong>en zusammen?)<br />

• Wie kann man die <strong>Lesart</strong>en (automatisch)<br />

unterscheiden?<br />

<strong>Lesart</strong>en<br />

• mehrere Wörter mit der gleichen<br />

Bedeutung<br />

• Synonymie<br />

Samstag, Sonnabend<br />

Substitutierbarkeit in einem Kontext/einer<br />

Menge von Kontexten<br />

abkratzen, sterben, heimgehen, ins Gras<br />

beissen, das zeitliche segnen, ...<br />

wahre Synonymie ist selten!<br />

<strong>Lesart</strong>en<br />

• ein Wort in mehreren Bedeutungen<br />

• Homonymie (Bank)<br />

• Homographie (Tenor)<br />

• Homophonie (Lerche, Lärche)<br />

• Polysemie ...<br />

<strong>Lesart</strong>en<br />

• Polysemie (verstehen, Fisch, blau)<br />

• systematische Polysemie<br />

• Fisch, Huhn, Schwein etc.<br />

– Tier und Lebensmittel<br />

• Oper, Theater, Schule etc.<br />

Gebäude und Institution und Gruppe von Menschen<br />

... (Bierwisch 1982)<br />

• Kontextabhängigkeit (teuer, klein, gut)<br />

• Vagheit<br />

Methoden zur Unterscheidung<br />

von <strong>Lesart</strong>en<br />

• Etymologie (?)<br />

• im Wörterbuch nachschauen (?)<br />

<strong>Beispiel</strong>: belegen, Kiefer<br />

• Schlüsselwörter im Kontext<br />

• syntaktisches Verhalten:<br />

Argumentstruktur, Modifikation, Definitheit, ...<br />

• Zeugma<br />

Dornröschen belegt ein Brötchen und einen<br />

Kurs in Korpuslinguistik<br />

<strong>Lesart</strong>en<br />

• Übergang zu Kollokationen, Idiomen, ...<br />

fließend<br />

wie ‚groß‘ muss ein Bedeutungseintrag<br />

sein?<br />

<br />

<br />

Wortartenannotation<br />

• sense tagging, word sense disambiguation<br />

• setzt voraus, dass wir jedem Lemma eine<br />

bestimmte Menge an <strong>Lesart</strong>en zuordnen können<br />

(tun wir jetzt mal so, als sei das problemlos möglich)<br />

• zwei Möglichkeiten<br />

• Disambiguierung aufgrund von<br />

Selektionsrestriktionen<br />

• ‚robuste Disambiguierung‘<br />

(maschinelle Lernverfahren)<br />

Wortartenannotation<br />

• man hat zwei Arten von Wissen zur<br />

Verfügung<br />

• linguistisches Wissen:<br />

morphologisches/morphosyntaktisches<br />

Wissen, Kontext<br />

• zusätzliches (extralinguistisches) Wissen:<br />

Wissen über Domäne, Textsorte etc.<br />

<strong>Beispiel</strong>: Kiefer<br />

• Lexikoneinträge<br />

• <br />

• <br />

‚vernetzte‘ Disambiguierung<br />

• Annahmen:<br />

• alle Wörter in einem Satz bis auf eins sind<br />

desambiguiert<br />

• man hat ein Lexikon mit sehr genauen<br />

Selektionsrestriktionen für selegierende<br />

Wörter<br />

• man hat eine zum Lexikon passende<br />

Taxonomie (oder anderes Kategoriensystem)<br />

für lexikalische Einträge<br />

‚vernetzte‘ Disambiguierung<br />

• die anderen Wörter helfen, die <strong>Lesart</strong> des<br />

letzten festzulegen<br />

• zusätzliche Lexikoneinträge für Verben<br />

• <br />

• <br />

• <br />

• ...<br />

• plus Taxonomie<br />

BAUM ISA PFLANZE ISA BELEBTES_OBJEKT<br />

...<br />

‚vernetzte‘ Desambiguierung<br />

• Thomas Zampach wurde am Kiefer<br />

operiert und Thorsten Kracht hatte einen<br />

Muskelfaserriss in der Wade<br />

• Kiefer lässt sich mit allen Werkzeugen<br />

leicht bearbeiten, sie lässt sich gut sägen,<br />

hobeln, fräsen und bohren, man kann sie<br />

messern, schälen und drechseln.

‚vernetzte‘ Desambiguierung<br />

robuste Disambiguierung<br />

• Problem:<br />

was ist mit weniger spezifischen Verben?<br />

mögen, kaufen, sehen, ...<br />

• Erstellung eines Lexikon und einer<br />

Konzepthierarchie (Taxonomie) aufwendig und<br />

schwierig – meist nur für eine Domäne/ein<br />

Szenario aufbereitet und schlecht übertragbar<br />

‣ WordNet/GermaNet<br />

• zugrundeliegende Idee: jede <strong>Lesart</strong> hat ein<br />

‚typisches‘ Verhalten (kommt in bestimmten<br />

morphosyntaktischen Formen vor, es gibt<br />

bestimmte andere Wörter im Kontext etc.)<br />

• solch ein ‚typisches‘ Verhalten kann durch eine<br />

Vektordarstellung approximiert werden<br />

• dann kann man jede <strong>Lesart</strong> an einem/einer<br />

Menge für sie ‚typischen‘ Vektor erkennen<br />

robuste Disambiguierung<br />

• man erzeugt für jedes zu taggende Wort<br />

einen Merkmalsvektor mit zB<br />

• Wortart<br />

• Lemma<br />

• Kontext (in einer festgelegten Größe), auch<br />

mit Wortart & Lemmainformation<br />

• (seltener) syntaktische Strukturbeschreibung<br />

(Teilparse)<br />

robuste Disambiguierung<br />

• wobei Kontext:<br />

collocation und co-occurrence<br />

• collocation: Information über Wörter, die an einer<br />

bestimmten Position relativ zum zu bestimmenden<br />

Wort stehen<br />

• syntagmatische Relationen: Wörter, die in einer<br />

bestimmten syntaktischen Relation zu dem zu<br />

bestimmenden Wort stehen<br />

• co-occurrence (bag of words): Wörter, die irgendwo<br />

innerhalb eines bestimmten Kontextfensters mit dem<br />

zu bestimmenden Wort vorkommen<br />

If one examines the words in a book, one at a time<br />

as through an opaque mask with a hole in it one<br />

word wide, then it is obviously impossible to<br />

determine, one at a time, the meaning of the<br />

words [...] But if one lengthens the slit in the<br />

opaque mask, until one can see not only the<br />

central word in question but also say N words on<br />

either side, then if N is large enough one can<br />

unambiguously decide the meaning of the central<br />

word. [...] The practical question is: „What<br />

minimum value of N will, at least in a tolerable<br />

fraction of cases, lead to the correct choice of<br />

meaning for the central word?“<br />

Weaver (1949), zitiert nach Ide & Veronis (1998)<br />

robuste Disambiguierung<br />

• collocation:<br />

Verkauf/NN von/PREP nordischen/ADJA<br />

Hölzern/NN, speziell/ADV Fichte/NN,<br />

Kiefer/NN und/KONJ Lärche/NN<br />

Welche Information?<br />

• ‘Kiefer‘ folgt auf ‚Fichte ,‘<br />

• ‚und Lärche‘ direkt nach ‚Kiefer‘<br />

• Wortartreihenfolge

obuste Disambiguierung<br />

robuste Disambiguierung<br />

• kann in gewissen Grenzen einfache<br />

Strukturbeschreibungen ersetzen<br />

• typische Modifikationen<br />

• typische Verbargumente<br />

• findet ‚typische‘ morphologische Varianten<br />

• keep:<br />

mit Gerundium: he kept eating<br />

mit Adjektiv: he kept calm<br />

mit NP: he kept a record<br />

• Wörter, die inem bestimmten<br />

syntagmatischen Zusammenhang mit dem<br />

zu bestimmenden Wort stehen<br />

• Voraussetzung: geparstes Korpus<br />

(wenigstens Chunks)<br />

robuste Disambiguierung<br />

• co-occurrence<br />

Holz, Fichte, Lärche etc. kommen oft in<br />

der Nähe von Kiefer2 vor<br />

• hier werden Kontextfenster einer<br />

vorgegebenen Größe ausgewertet<br />

nordischen Hölzern , speziell<br />

Kiefer<br />

, Fichte und Lärche<br />

robuste Disambiguierung<br />

• <strong>Beispiel</strong>: Kontextwörter zu<br />

• Kiefer1: Zahnarzt, Operation, Gesicht, Körper<br />

• Kiefer2: Lärche, Fichte, Wald, wachsen, Holz,<br />

billig, IKEA<br />

robuste Disambiguierung<br />

• woher weiß man, welche Informationen in<br />

den Vektor aufgenommen werden sollen?<br />

• manuelle Angabe<br />

robuste Disambiguierung<br />

• woher weiß man, welche Informationen in<br />

den Vektor aufgenommen werden sollen?<br />

• manuelle Angabe<br />

• Informationen aus Wörterbüchern

obuste Disambiguierung<br />

• Informationen aus Wörterbüchern/Thesauri<br />

• geht zurück auf Lesk (1986): Die Wörter, die in den<br />

Definitionen im Wörterbuch verwendet werden,<br />

werden auf die jeweiligen Kontexte abgebildet<br />

‣ man nimmt die <strong>Lesart</strong>, die die meisten<br />

Übereinstimmungen mit dem gegebenen Kontext hat<br />

‣ 50 – 70 % korrekt annotierte <strong>Lesart</strong>en<br />

‣ spätere Verfahren mit neuronalen Netzen auf OALD<br />

& CED erreichen über 90% korrekt annotierte<br />

<strong>Lesart</strong>en (Veronis & Ide 1990)<br />

robuste Disambiguierung<br />

• Problem: abhängig von der genauen<br />

Formulierung im verwendeten Wörterbuch<br />

• Wörterbücher sind oft inkonsistent<br />

• Wörterbücher enthalten keine/wenig<br />

Kontextinformation oder pragmatische<br />

Information<br />

• daher:<br />

robuste Disambiguierung<br />

• woher weiß man, welche Informationen in<br />

den Vektor aufgenommen werden sollen?<br />

• manuelle Angabe<br />

• Informationen aus Wörterbüchern<br />

• statistische Lernverfahren auf einem<br />

Trainingskorpus (manuell annotiert)<br />

robuste Disambiguierung<br />

• auf einem (handannotierten)<br />

Trainingskorpus werden mit dem Zielwort<br />

vorkommende Wörter gezählt<br />

• Gewichtung (stop words?)<br />

robuste Disambiguierung:<br />

Vektordarstellung<br />

robuste Disambiguierung<br />

• Vektorrepräsentation morphosyntaktische<br />

Eigenschaften:<br />

, zB 0 für masc, 1 für fem, 0<br />

für sing, 1 für plural<br />

• Vektorrepräsentation Kontext:<br />

<br />

• dann für jeden Kontext Zuordnung zu einer<br />

<strong>Lesart</strong><br />

z. B. - Kiefer2<br />

• wenn man die Vektoren hat, kann die <strong>Lesart</strong>en<br />

anhand ähnlicher Kontexte klassifizieren<br />

• woher kennt man die entsprechenden Kontexte?<br />

was heißt in diesem Zusammenhang ‚ähnlich‘?<br />

• das Ähnlichkeitsmaß ist mathematisch definiert<br />

• überwachtes Lernen: Kontexte werden aufgrund<br />

eines manuellen Trainingskorpus gelernt<br />

• unüberwachtes Lernen: Kontexte werden zu<br />

‚ähnlichen‘ Clustern zusammengefügt

obuste Disambiguierung<br />

• Schwierigkeiten<br />

• Bestimmung der <strong>Lesart</strong>en<br />

• Ermittlung der Merkmalsvektoren<br />

• ‚scaling up‘: Übertragung auf weitere<br />

Kontexte<br />

Entscheidungsbaumverfahren<br />

• manche Informationen sind aussagekräftiger als<br />

andere<br />

(wenn man das Genus von ‚Kiefer‘ eindeutig bestimmen kann,<br />

braucht man den Kontext nicht mehr)<br />

• daher kann man ein<br />

Entscheidungsbaumverfahren lernen:<br />

Entscheidungsbäume sind eine Folge von<br />

ja/nein Entscheidungen mit Konsequenzen<br />

(Genus eindeutig bestimmt? Wenn ja, dann Kiefer1 oder<br />

Kiefer2, sonst schau den Kontext an ...)<br />

Probleme<br />

• handannotiertes Korpus ist schwer zu<br />

bekommen/herzustellen<br />

• ‚sparse data problem‘: für einige <strong>Lesart</strong>en gibt<br />

es zu wenig Trainingsdaten<br />

(in einigen Texttypen/Genres kommen<br />

bestimmte <strong>Lesart</strong>en überhaupt nicht vor)<br />

• Qualität: bisher kommt man nicht an die 95%+<br />

heran, die zB beim Wortartentagging erreicht<br />

werden<br />

Existierende Systeme und<br />

Evaluation<br />

• SEMCOR Corpus: 200 000 Wörter des<br />

Brown Corpus mit WordNet <strong>Lesart</strong>en,<br />

handgetaggt<br />

• SENSEVAL Corpus<br />

• diverse kleinere Korpora<br />

Existierende Systeme und<br />

Evaluation<br />

• Evaluationskriterien<br />

• Menge der <strong>Lesart</strong>en (Differenzierung), Allgemeinheit,<br />

Übertragbarkeit auf andere Domänen<br />

• Was zählt als ‚korrekt‘?<br />

(bei hierarchischen Wörterbucheinträgen: nur<br />

unterste Ebene oder auch höhere Ebenen)<br />

• bei kombinierten Verfahren: wieviel muss manuell<br />

korrigiert werden?<br />

• bei rein automatischen Verfahren: Geschwindigkeit<br />

(bei bestimmten Aufgaben wie zB bei zeitgleicher<br />

maschineller Übersetzung wichtig)<br />

Existierende Systeme und<br />

Evaluation<br />

• SENSEVAL-Konferenzen: ein bestimmer<br />

Text wird nach vorgegebenen Kriterien mit<br />

<strong>Lesart</strong>en annotiert – Vergleich zwischen<br />

verschiedenen Systemen – Diskussion<br />

über Schwierigkeiten und Verfahren – ca.<br />

2-jährig<br />

(nächste: Sommer 2003,<br />

http://www.senseval.org/)

Standards<br />

• Was ist der Standard? Was ist eigentlich<br />

ein korrekt mit <strong>Lesart</strong>en annotiertes<br />

Korpus?<br />

• Soll man eigentlich automatisch <strong>Lesart</strong>en<br />

zuweisen? Können Menschan das nicht<br />

viel besser?<br />

• dazu: 2 Experimente und ein Vorschlag<br />

von Jean Veronis (2001)<br />

Véronis Ziele<br />

• herausfinden, wie gut Menschen eigentlich<br />

<strong>Lesart</strong>en disambiguieren können<br />

• Konsequenzen für maschinelles<br />

Disambiguieren diskutieren<br />

• einen rein strukturellen Vorschlag zur<br />

<strong>Lesart</strong>endisambiguierung unterbreiten<br />

Experiment 1<br />

Experiment 1<br />

• Material: je 200 Adjektive, Nomen und Verben, die<br />

jeweils ca. 60 Mal im JOC Korpus (französisch)<br />

vorkommen:<br />

• für jedes dieser Wörter alle Vorkommen mit Kontext<br />

ausgedruckt<br />

• 6 TeilnehmerInnen (Studierende ohne lexikographische<br />

Ausbildung)<br />

• Frage: hat dieses Wort in den folgenden Kontexten<br />

mehrere Bedeutungen ?<br />

(eine Option: weiss nicht)<br />

• keine Zeitbeschränkung<br />

• nur ca. 4 % weiss-nicht-Antworten (dh, die<br />

Versuchspersonen fanden die Aufgabe nicht schwierig)<br />

• 73 % der Wörter werden als eindeutig angesehen<br />

• Polysemie unterscheidet sich deutlich je nach Wortart N<br />

> V > Adj<br />

(i. Ggs. zu Petit Larousse V > N > A)<br />

• volle Übereinstimmung nur bei 4,5 % der polysemen<br />

Wörter<br />

Experiment 2<br />

Experiment 2<br />

• Material: die 60 ‚polysemsten‘ (20 pro Wortart)<br />

der Wörter aus Experiment 1 mit allen ihren<br />

Belegen<br />

• Aufgabe: <strong>Lesart</strong>enzuweisung nach Petit<br />

Larousse für alle Belege<br />

• man konnte mehr als eine <strong>Lesart</strong> pro Kontext<br />

zuweisen<br />

• zusätzliche <strong>Lesart</strong> als ‚?‘, werden alle als eine gezählt<br />

• TeilnehmerInnen: 6 (andere) Studierende ohne<br />

lexikographische Ausbildung<br />

• Ergebnisse:<br />

• Polysemie nach Wortart: V > N > A<br />

vielleicht zurückzuführen auf Wörterbuch<br />

• ganz wenig Übereinstimmung zwischen den<br />

Annotatoren (zT schlechter als Zufall)<br />

(Hypothese, dass das auf zu feine<br />

Wortartunterscheidung im PL zurückzuführen ist,<br />

muss verworfen werden, Übereinstimmung schon auf<br />

der höchsten Ebene nicht gegeben)

Zusammenfassung Ergebnisse<br />

• Experiment 1: keine Übereinstimmung bei<br />

der Einschätzung, ob ein gegebenes Wort<br />

in einem gegebenen Kontext polysem ist<br />

oder nicht<br />

• Experiment 2: keine Übereinstimmung bei<br />

<strong>Lesart</strong>enzuweisung nach Wörterbuch<br />

(Veronis meint, das läge nicht an dem<br />

verwendeten Wörterbuch)<br />

Lösungsvorschlag<br />

• Unterscheidung nur noch nach<br />

syntaktischen/strukturellen Kriterien<br />

• unterschiedliche Argumentstruktur<br />

• unterschiedliche Modifikationsmöglichkeiten<br />

• Ersetzung durch Hyporonyme/Hyponyme<br />

• ...<br />

• Idee: menschliche und automatische<br />

Annotation möglich und vergleichbar<br />

Lösungsvorschlag<br />

• Problem:<br />

• Wörterbücher enthalten solche Kriterien nicht<br />

(systematisch)<br />

• Würde das nicht auch wieder eine Menge<br />

Handarbeit voraussetzen (zB Klassifikation<br />

von ‚passenden‘ Adjektiven etc.)?<br />

• Würde das nicht eine Theorie für zu<br />

unterscheidende <strong>Lesart</strong>en voraussetzen?<br />

Zusammenfassung sense tagging<br />

• wichtig für alle möglichen<br />

computerlinguistischen und linguistischen<br />

Anwendungen<br />

• problematisch<br />

• Festlegung der <strong>Lesart</strong>en<br />

• (automatische) Zuweisung der <strong>Lesart</strong>en<br />

• viel Handarbeit/Ressourcen erforderlich<br />

Zusammenfassung<br />

Korpusaufbereitung<br />

• kurze Wiederholung zur Kurzklausur<br />

nächste Woche:<br />

• Woher bekommen LinguistInnen ihre Daten?<br />

• Welche linguistischen Fragestellungen,<br />

können durch Korpusdaten bearbeitet<br />

werden? Welche nicht?<br />

• Wie wird ein Korpus aufgebaut?<br />

Zusammenfassung<br />

Korpusaufbereitung<br />

• Wie wird ein Korpus vorverarbeitet? Welche<br />

Probleme gibt es jeweils? Welche<br />

Entscheidungen müssen getroffen werden?<br />

• Tokenisierung<br />

• pos-Tagging<br />

• Lemmatisierung<br />

• syntaktische Strukturzuweisung/Baumbanken<br />

• <strong>Lesart</strong>entagging

Literatur<br />

• Ide, Nancy & Véronis, Jean (1998) Introduction to the<br />

Special Issue on Word Sense Dismabiguation: The State<br />

of the Art. In: Computational Linguistics 24(1), 1- 40<br />

• Jurafsky, Daniel & Martin, James H. (2000) Speech and<br />

Language Processing. An Introduction to Natural<br />

Language Processing, Computational Linguistics, and<br />

Speech Recognition. Prentice Hall, New Jersey<br />

• Véronis, Jean (2001) Sense tagging: does it make<br />

sense? Paper presented at Corpus Linguistics 2001,<br />

Lancaster.<br />

http://www.up.univ-mrs.fr/~veronis/pdf/2001-lancastersense.pdf