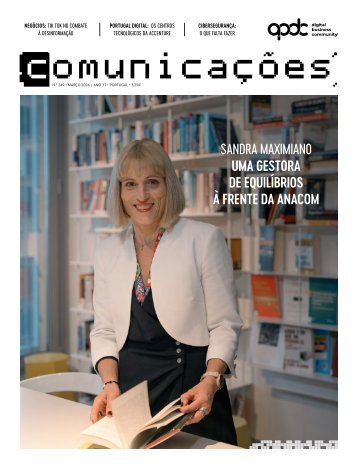

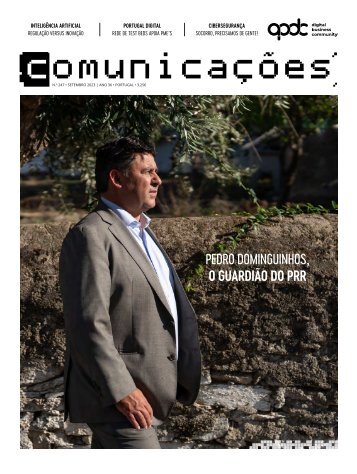

COMUNICAÇÕES 247 - PEDRO DOMINGUINHOS O GUARDIÃO DO PRR

- Text

- Tecnologia

- Testbeds

- Experimentação

- Território

- Inovação

- Talento

- Cibersegurança

- Artificial

- Prr

- Digital

- Digitalbusinesscommunity

- Apdc

em destaque e os modelos

em destaque e os modelos fundacionais”. Já a head of Government Affairs and Public Policy da Google Portugal, Helena Martins, avança que, na visão da tecnológica, a proposta inicial da CE “era muito razoável, indo ao encontro das necessidades da indústria e das questões colocadas pela sociedade”. Com as discussões no Conselho e no PE e “o boom mais recente em torno da IA generativa, o documento começou a ser mais baseado no medo do que na utilização da IA”. Resultado: a mais recente versão “está a gerar dúvidas na indústria. O nosso trabalho tem sido manter o diálogo na Europa e tentar trazer clareza para alguns dos conceitos. A indústria precisa de ter certeza jurídica de como se pode desenvolver uma IA que é inovadora, mas também responsável”. Helena Martins destaca ainda que a regulação da IA “é um tema que tem sido discutido a nível de indústria e com os governos há já alguns anos. Há algumas questões que não podem ser decididas por empresas e acreditamos que a regulação é muito importante. Existe um certo consenso de que a IA deve ser regulada a partir do seu uso e tem havido alguma discussão em torno de regulamentação por áreas de atividade. Em muitos países ainda é uma questão em aberto, mas a UE optou por uma regulação mais ampla, focada na utilização da tecnologia”. E qual a perspetiva de uma startup que desenvolve atividade nesta área? Paulo Dimas, vice-presidente para a inovação da portuguesa Unbabel, começa por admitir que “há sempre uma tensão entre inovação e regulação: quanto menos regulação, mais inovação. Mas tudo tem de ser equilibrado com os valores da sociedade. Os resultados que se alcançaram no AI Act são muito positivos, até porque endereçam uma grande questão, da IA generativa, que teve um grande avanço e está apenas no poder de alguns. Essa é uma outra questão, nada linear, que é: até onde deveremos ir em termos de regulação?”. Para o empreendedor, “é importante regular os uses cases, mas também haver regulação ao nível das plataformas, que são transversais”. REGRAS À PROVA DO FUTURO? Estes responsáveis falavam no âmbito da 10ª edição da Iniciativa Portuguesa do Fórum da Governação da Internet, numa sessão organizada pela APDC, sobre “Promote regulation of Artificial Intelligence”, onde o tema central foi o IA Act. Neste debate, ficou claro que uma das questões onde não há certezas é saber se esta regulação será “à prova de futuro”. Segundo Arlindo Oliveira, “se a evolução continuar a ser a das últimas décadas, vamos ter problemas com- Há dúvidas de que a regulação de Bruxelas para a IA seja à prova de futuro, uma vez que a tecnologia não pára de avançar 32

pletamente diferentes com questões muito distintas. O AI Act está focado na tecnologia e nas questões essenciais como são vistas agora, pelo que corre o risco de ficar rapidamente desadaptado da realidade. Temos de ter noção de que está longe de ser uma coisa perfeita. Mas também não tenho solução para isto”, admite o especialista em IA. “Olhando para os vários textos do AI Act, eles refletem exatamente a evolução da tecnologia. Teremos de ver se, de facto, esta regulação é ‘future proof’. É verdade que nos últimos meses, com o ChatGPT, o Bard e outras ferramentas, foi alcançado um nível de democratização do acesso a estes modelos, que já não eram novos. Estamos numa fase de experimentação e a regulação é importante. Mas as normas definidas têm de ser adaptáveis e flexíveis, para se continuar a inovar de forma responsável”, defende Helena Martins. “Se calhar não é totalmente à prova de futuro, mas existe muita flexibilidade, assim a versão final fique como está”, assegura Magda Cocco. Mais, garante que o documento “reconhece que ainda não se sabe bem como regular a IA. Nos próprios considerandos, diz-se que é essencial uma coordenação entre governos, empresas, academia e centros de pesquisa e que se trata de um processo contínuo. E prevê-se a possibilidade de revisões regulares”. Para já, e enquanto a regulação europeia não estiver em vigor, o que só acontecerá, numa perspetiva otimista, em 2025, o mercado terá de continuar a funcionar com as regras atuais. Para a responsável da VdA, “tendo em conta que as empresas estão a desenvolver produtos a uma velocidade enorme, é fundamental criar mecanismos de autorregulação”, num processo que considera ser “bidirecional”, juntando indústria, centros de I&D, reguladores e entidades públicas. Só esta interação essencial permitirá “perceber qual é a melhor forma de regular. Acho que é isso que já se está a fazer, porque a indústria está preocupada em ter uma IA responsável”. Além disso, já existe um vasto conjunto de legislação europeia, como o RGPD, o Data Act, o Digital Services Act ou o Digital Markets Act, que é aplicável a qualquer solução assente em IA. “Temos uma carga regulatória na CE que é de enorme exigência acompanhar. Agora imaginem uma startup ou uma PME olharem para esta confusão de regulação”, acrescenta. Paulo Dimas diz que este horizonte temporal de dois anos surge como “oportunidade de inovação. Podemos começar a trabalhar nos produtos da IA do futuro, que estarão já ao abrigo da nova regulação. Para a Unbabel, o timing de 2025 é ótimo, porque nos permite integrar já as regras nos nossos produtos. Há tempo para planear e de ir mais longe, no sentido da IA res- 33

- Page 1 and 2: INTELIGÊNCIA ARTIFICIAL REGULAÇÃ

- Page 3 and 4: edit orial Eduardo Fitas eduardo.fi

- Page 6 and 7: a abrir COMPETÊNCIAS DIGITAIS SÃO

- Page 8 and 9: a abrir 8 SOUND BITES :-b “Em vez

- Page 10 and 11: a abrir SOUND BITES :-b “Não há

- Page 12 and 13: 5 perguntas 12 NUNO SARAMAGO: Motiv

- Page 14 and 15: a conversa 14 “Acredito muito mai

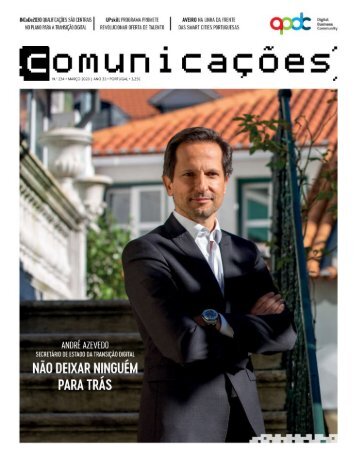

- Page 16 and 17: a conversa 16 “O desafio do PPR c

- Page 18 and 19: a conversa “Vivi o verão quente,

- Page 20 and 21: a conversa dificuldades significati

- Page 22 and 23: a conversa 22 da causa pública. Lo

- Page 24 and 25: a conversa “Se olharmos para rank

- Page 26 and 27: a conversa 26 vestimentos - para aq

- Page 28 and 29: em destaque 28

- Page 30 and 31: em destaque 30 A CE quer liderar um

- Page 34 and 35: em destaque 34 ponsável. Todas as

- Page 36 and 37: em destaque 36 Washington já avan

- Page 38 and 39: itech 38 GUILHERME DIAS: Banda sono

- Page 40 and 41: negocios 40

- Page 42 and 43: negocios 42 Dados revelados recente

- Page 44 and 45: eportagem 44

- Page 46 and 47: eportagem 46 MOBILIDADE E LOGÍSTIC

- Page 48 and 49: eportagem 48 cartar os restos de co

- Page 50 and 51: portugal digital 50

- Page 52 and 53: portugal digital A Rede Nacional de

- Page 54 and 55: portugal digital TEST BEDS EM DISCU

- Page 56 and 57: portugal digital técnico, tanto em

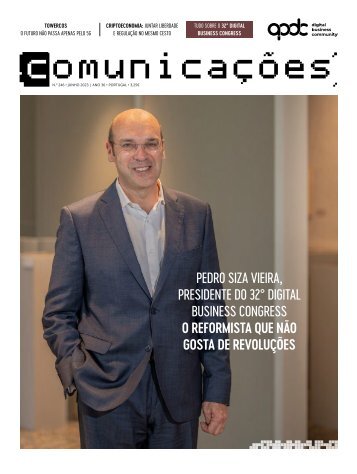

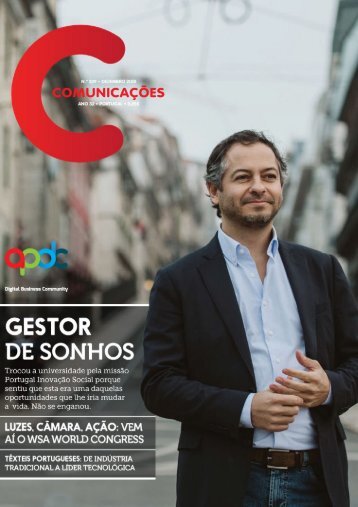

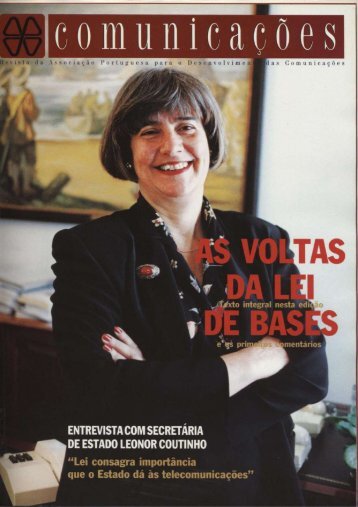

- Page 58 and 59: apdc news JANTAR RESERVADO - COM PE

- Page 60 and 61: apdc news JANTAR RESERVADO APDC COM

- Page 62 and 63: 62 “O impacto social positivo, as

- Page 64 and 65: ultimas PORTÁTEIS QUE IMPULSIONAM

- Page 66 and 67: ultimas SOLUÇÃO DE ZAPPING CONQUI

Inappropriate

Loading...

Mail this publication

Loading...

Embed

Loading...