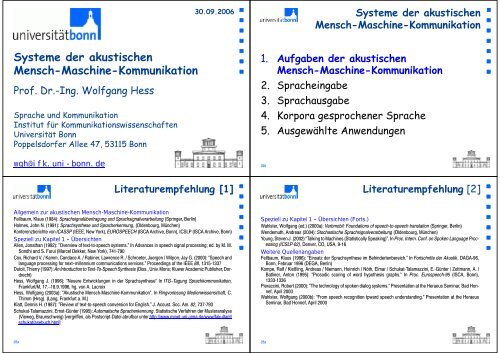

Systeme der akustischen Mensch-Maschine-Kommunikation

Systeme der akustischen Mensch-Maschine-Kommunikation

Systeme der akustischen Mensch-Maschine-Kommunikation

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

<strong>Systeme</strong> <strong>der</strong> <strong>akustischen</strong><br />

<strong>Mensch</strong>-<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Prof. Dr.-Ing. Wolfgang Hess<br />

Sprache und <strong>Kommunikation</strong><br />

Institut für <strong>Kommunikation</strong>swissenschaften<br />

Universität Bonn<br />

Poppelsdorfer Allee 47, 53115 Bonn<br />

wgh@ifk.uni-bonn.de<br />

Literaturempfehlung [1]<br />

Allgemein zur <strong>akustischen</strong> <strong>Mensch</strong>-<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Fellbaum, Klaus (1984): Sprachsignalübertragung und Sprachsignalverarbeitung (Springer, Berlin)<br />

Holmes, John N. (1991): Sprachsynthese und Spracherkennung, (Oldenbourg, München)<br />

Konferenzberichte von ICASSP (IEEE, New York), EUROSPEECH (ISCA Archive, Bonn), ICSLP (ISCA Archive, Bonn)<br />

Speziell zu Kapitel 1 -- Übersichten<br />

Allen, Jonathan (1992): ”Overview of text-to-speech systems.” In Advances in speech signal processing; ed. by M. M.<br />

Sondhi and S. Furui (Marcel Dekker, New York), 741-790<br />

Cox, Richard V. / Kamm, Candace A. / Rabiner, Lawrence R. / Schroeter, Juergen / Wilpon, Jay G. (2000): “Speech and<br />

language processing for next -millennium communications services.” Proceedings of the IEEE 88, 1315-1337<br />

Dutoit, Thierry (1997): An Introduction to Text-To-Speech Synthesis (Diss., Univ. Mons; Kluwer Academic Publisher, Dordrecht)<br />

Hess, Wolfgang J. (1996): ”Neuere Entwicklungen in <strong>der</strong> Sprachsynthese” In ITG–Tagung Sprachkommunikation,<br />

Frankfurt/M, 17.–18.9.1996, hg. von A. Lacroix<br />

Hess, Wolfgang (2003a): “Akustische <strong>Mensch</strong>-<strong>Maschine</strong>-<strong>Kommunikation</strong>”. In Ringvorlesung Medienwissenschaft, C.<br />

Thimm (Hrsg). (Lang, Frankfurt a. M.)<br />

Klatt, Dennis H. (1987): ”Review of text-to-speech conversion for English.” J. Acoust. Soc. Am. 82, 737-793<br />

Schukat-Talamazzini, Ernst-Günter (1995): Automatische Spracherkennung. Statistische Verfahren <strong>der</strong> Musteranalyse<br />

(Vieweg, Braunschweig) [vergriffen, als Postscript-Datei abrufbar unter http://www.minet.uni -jena.de/www/fakultaet/<br />

schukat/asebuch.html]<br />

05a<br />

30.09.2006 <strong>Systeme</strong> <strong>der</strong> <strong>akustischen</strong><br />

<strong>Mensch</strong>-<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

1. Aufgaben <strong>der</strong> <strong>akustischen</strong><br />

<strong>Mensch</strong>-<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

2. Spracheingabe<br />

3. Sprachausgabe<br />

4. Korpora gesprochener Sprache<br />

5. Ausgewählte Anwendungen<br />

04b<br />

Literaturempfehlung [2]<br />

Speziell zu Kapitel 1 -- Übersichten (Forts.)<br />

Wahlster, Wolfgang (ed.) (2000a): Verbmobil: Foundations of speech-to-speech translation (Springer, Berlin)<br />

Wendemuth, Andreas (2004): Stochastische Sprachsignalverarbeitung (Oldenbourg, München)<br />

Young, Steven J. (2002) “Talking to Machines (Statistically Speaking)”. In Proc. Intern. Conf. on Spoken Language Processing<br />

(ICSLP-02), Denver, CO, USA, 9-16<br />

Weitere Quellenangaben<br />

Fellbaum, Klaus (1996): “Einsatz <strong>der</strong> Sprachsynthese im Behin<strong>der</strong>tenbereich.“ In Fortschritte <strong>der</strong> Akustik, DAGA-96,<br />

Bonn, Februar 1996 (DEGA, Berlin)<br />

Kompe, Ralf / Kießling, Andreas / Niemann, Heinrich / Nöth, Elmar / Schukat-Talamazzini, E.-Günter / Zottmann, A. /<br />

Batliner, Anton (1995): “Prosodic scoring of word hypothesis graphs.” In Proc. Eurospeech-95 (ISCA, Bonn),<br />

1333-1336<br />

Pieraccini, Robert (2000): “The technology of spoken dialog systems.” Presentation at the Heraeus Seminar, Bad Honnef,<br />

April 2000<br />

Wahlster, Wolfgang (2000b): “From speech recognition tpward speech un<strong>der</strong>standing.” Presentation at the Heraeus<br />

Seminar, Bad Honnef, April 2000<br />

05a

Sprechererkennung/<br />

-verifikation<br />

Spracherkennung(Diktiermaschine)<br />

04b sam_1.1<br />

Spracheingabe<br />

Akustische <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Sprachverstehenssysteme<br />

Sprecherverifikation<br />

<strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<br />

Dialog<br />

Sprachausgabe<br />

Inhaltsgesteuerte<br />

Sprachsynthese<br />

Überblick<br />

TTS<br />

(Vorleseautomat)<br />

Sprechererkennung / -verifikation<br />

S Fragestellung: Ist die Person, die spricht, mit <strong>der</strong> angemeldeten/berechtigten<br />

Person identisch?<br />

S Hauptanwendungen: Zugangskontrolle, Autorisierung<br />

Sprechererkennung, Sprecheridentifizierung<br />

S Fragestellung: Wer spricht?<br />

S Anwendung: Unterstützung <strong>der</strong> Arbeit in <strong>der</strong> Forensik<br />

04b sam_1.3<br />

Sprechererkennung/<br />

-verifikation<br />

Spracherkennung(Diktiermaschine)<br />

04b sam_1.2<br />

Sprechererkennung/<br />

-verifikation<br />

Spracherkennung(Diktiermaschine)<br />

04b sam_1.4<br />

Sprechererkennung / -verifikation<br />

Spracheingabe<br />

Akustische <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Sprachverstehenssysteme<br />

Spracheingabe<br />

<strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<br />

Dialog<br />

Sprachausgabe<br />

Inhaltsgesteuerte<br />

Sprachsynthese<br />

Akustische <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Sprachverstehenssysteme<br />

<strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<br />

Dialog<br />

TTS<br />

(Vorleseautomat)<br />

Spracherkennung<br />

Sprachausgabe<br />

Inhaltsgesteuerte<br />

Sprachsynthese<br />

TTS<br />

(Vorleseautomat)

Regelbasierte versus<br />

stochastische/optimierende Ansätze<br />

Viele linguistische Ansätze sind regelbasiert (z. B. Grammatik<br />

einer natürlichen Sprache).<br />

S Regeln ergeben harte, üblicherweise lokale Entscheidungen.<br />

S In mehrstufigen <strong>Systeme</strong>n sind einmal getroffene fehlerhafte<br />

Entscheidungen nicht korrigierbar.<br />

In <strong>der</strong> Sprachtechnologie haben sich dagegen stochastische<br />

und optimierende Ansätze durchgesetzt.<br />

S Diese Verfahren erlauben die Integration <strong>der</strong> Ergebnisse<br />

aus verschiedener Stufen zu einer einzigen Entscheidung<br />

am Ende <strong>der</strong> Gesamtverarbeitung.<br />

04b sam_1.5<br />

“Grundformel” <strong>der</strong> Spracherkennung<br />

[SCHUKAT-TALAMAZZINI, 1995]<br />

Erkennung kontinuierlicher Sprache mit<br />

stochastischen Ansätzen: Maximierung <strong>der</strong><br />

Rückschlusswahrscheinlichkeit vom Sprachsignal X<br />

auf die gesprochene Wortfolge w.<br />

w * � arg max ( P(w|X) ) � arg max � �<br />

� P(X|w) �<br />

�<br />

P(w)<br />

P(X) � �<br />

�<br />

�<br />

A-Priori-Wahrscheinlichkeit, dass die Wortfolge<br />

w das Sprachsignal X generiert<br />

Akustisch-phonetische Modellierung<br />

(Satz von BAYES) Auftretenswahrscheinlichkeit <strong>der</strong> Wortfolge w<br />

Linguistisches Sprachmodell<br />

04b sam_1.7<br />

Rückschlusswahrscheinlichkeit (A-Posteriori-Wahrscheinlichkeit)<br />

vom Sprachsignal X auf die Wortfolge w<br />

Stochastische/optimierende Ansätze<br />

Stochastische Ansätze ermitteln und maximieren<br />

Wahrscheinlichkeiten (z. B. in <strong>der</strong> Spracherkennung:<br />

Rückschlusswahrscheinlichkeit von einem Sprachsignal auf<br />

die zugrunde liegende sprachliche Äußerung).<br />

Kostenbasierte optimierende Ansätze ermitteln und<br />

minimieren Kostenfunktionen (z. B. Suche nach einem<br />

optimalen Pfad durch ein Netzwerk).<br />

Beide Ansätze erlauben<br />

S “weiche” Entscheidungen<br />

S Weiterleitung von Alternativen<br />

S Integration von Ergebnissen suf verschiedenen Ebenen<br />

und ergeben somit maximale Flexibilität.<br />

04b sam_1.6<br />

Stochastischer Ansatz [1]<br />

S Die A-Priori-Wahrscheinlichkeit dafür, dass die Äußerung w<br />

das akustische Muster X produziert, wird durch ein Hidden-<br />

Markov-Modell (HMM) nachgebildet.<br />

S Das Hidden-Markov-Modell ist ein zweifacher stochastischer<br />

Prozess.<br />

S Durchlaufen wird ein Automat mit einer endlichen Zahl von Zuständen.<br />

Zu jedem Beobachtungszeitpunkt (typisch alle 10 ms)<br />

nimmt das Modell einen Zustand ein. Hierbei wird durch Übergangswahrscheinlichkeiten<br />

definiert, wie die Zustände aufeinan<strong>der</strong><br />

folgen können.<br />

S In jedem Zustand wird ein Symbol ausgegeben. Zustandsspezifische<br />

Ausgabewahrscheinlichkeiten bestimmen, welches Symbol<br />

mit welcher Wahrscheinlichkeit ausgegeben wird.<br />

04b sam_1.8

Stochastischer Ansatz [2]<br />

Der Beobachter sieht beim HMM von außen nur die Folge <strong>der</strong> ausgegebenen<br />

Symbole. Die Folge <strong>der</strong> Zustände bleibt ihm verborgen.<br />

04b sam_1.9<br />

HIDDEN<br />

Sprachmodell (Language Model)<br />

Die Auftretenswahrscheinlichkeit P(w) wird - meist auf<br />

Wortebene - durch das Sprachmodell (language model) nachgebildet.<br />

S P(w) ist kontextabhängig.<br />

S Das Sprachmodell bildet P(w) durch primitive stochastische<br />

Grammatiken (Bigramm, Trigramm) nach.<br />

S Es wird mit Hilfe sehr großer Textkorpora trainiert.<br />

04b sam_1.11<br />

Stochastischer Ansatz [3]<br />

S HMM’s können für die verschiedensten sprachlichen Einheiten<br />

aufgebaut werden - Wörter, Silben, Laute.<br />

S Bei Erkennung kontinuierlicher Sprache werden häufig kontextsensitive<br />

Lautmodelle eingesetzt.<br />

S HMM’s “verkleben” - HMM’s für Wortuntereinheiten können<br />

beispielsweise zu größeren HMM’s für ein ganzes Wort verkettet<br />

werden usw.<br />

S Vor dem Einsatz müssen HMM’s trainiert werden. Dies<br />

geschieht mit einer großen Menge von Trainingsdaten, die aus<br />

vorverarbeiteten Sprachaufzeichnungen stammen.<br />

“Gretchenfrage” an das HMM: Mit welcher Wahrscheinlichkeit<br />

hättest du das gegebene akustische Signal X generiert?<br />

04b sam_1.10<br />

Sprechererkennung/<br />

-verifikation<br />

Spracherkennung(Diktiermaschine)<br />

04b sam_1.12<br />

Spracheingabe<br />

Sprachverstehenssysteme<br />

Akustische <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Sprachverstehenssysteme<br />

<strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<br />

Dialog<br />

Sprachausgabe<br />

Inhaltsgesteuerte<br />

Sprachsynthese<br />

TTS<br />

(Vorleseautomat)

Sprachverstehen<br />

“Sprachverstehen” heißt, die <strong>Maschine</strong> zu einer (für den<br />

Benutzer) sinnvollen Reaktion zu veranlassen.<br />

Dies können je nach Anwendung sehr verschiedene Dinge sein,<br />

beispielsweise:<br />

S Ausführung von Tätigkeiten (Roboter, Smart Home)<br />

S Beschaffung von Information (Auskunftssysteme)<br />

S Herstellung von Verbindungen (Telefon etc.)<br />

S .....<br />

04b sam_1.13<br />

Spontansprache<br />

Spontansprache enthält eine Reihe von<br />

Phänomenen, die in an<strong>der</strong>en Sprechstilen so nicht<br />

enthalten sind, und die das System berücksichtigen muss.<br />

S Anaphern und Ellipsen<br />

-- Ist <strong>der</strong> neu? -- Nein, [...] mit Perwoll gewaschen.<br />

S Einfügen satzeinleiten<strong>der</strong> Wörter und Floskeln<br />

-- Ja, wann können wir uns morgen treffen?<br />

S Kongruenzfehler, Reparaturen<br />

-- Ichwolltemitden nächsten Zug nach Frankfurt.<br />

-- Treffen wir uns doch am Montag, -- äh -- nein, amDienstag.<br />

S Aussprachevarianten (regionaler Akzent; Reduktion)<br />

-- Was hammer denn heut’ ?<br />

S Häsitationen und gefüllte Pausen<br />

S Abschweifungen<br />

-- Eigentlich will ich ja gar nicht dorthin, aber -- äh -wann<br />

fährt <strong>der</strong> nächste Zug nach Frankfurt?<br />

04b sam_1.15<br />

Acoustic<br />

Language Models<br />

Word Lists<br />

Grammar<br />

Lexical Meaning<br />

Discourse Context<br />

Knowledge about<br />

Discourse Domain<br />

04b sam_1.14<br />

Three Levels of Language Processing<br />

Speech (Telephone) Input<br />

Speech<br />

Recognition<br />

Speech<br />

Analysis<br />

Speech<br />

Un<strong>der</strong>standing<br />

(WAHLSTER, 2000b)<br />

What did the caller<br />

say?<br />

[100 alternatives]<br />

What did the caller<br />

mean?<br />

[10 alternatives]<br />

What did the caller<br />

want?<br />

[Unambiguous<br />

Un<strong>der</strong>standing in the<br />

Dialog Context]<br />

Reduction of Uncertainty<br />

Spontansprache undProsodie<br />

Spontansprache stützt sich in hohem<br />

Maß auf den Einsatz prosodischer Mittel,<br />

wo immer das möglich ist.<br />

S Kontrastfokus und enger Fokus spielen eine große Rolle in<br />

spontansprachlichen Dialogen. Mit prosodischen Mitteln lassen<br />

sie sich beson<strong>der</strong>s ökonomisch realisieren.<br />

-- “Fahren Sie heute nach Frankfurt?” vs.<br />

-- “Wann fahren Sie nach Frankfurt? Heute?”<br />

S Die Länge einer zusammenhängenden spontansprachlichen<br />

Dialogäußerung (”Turn”) lässt sich nicht vorher festlegen, wenn<br />

<strong>der</strong> Benutzer die momentane Dialoginitiative hat. Sie kann von<br />

einem einzelnen Wort bis hin zu mehreren Sätzen reichen.<br />

04b sam_1.16

Untersuchung <strong>der</strong> Prosodie<br />

Eine Wortkette verlässt den Spracherkenner<br />

ohne Punkt und Komma.<br />

Ein Prosodie-Verarbeitungsmodul ist in <strong>der</strong> Lage, Satzzeichen<br />

hinzuzufügen. Darüber hinaus kann es Aussagen liefern zu<br />

S Satzmodus<br />

S Akzente und Kontrastbetonung<br />

S Strukturierung und Phrasierung einer Äußerung<br />

S Glie<strong>der</strong>ung einer Äußerung in Dialogakte<br />

Beispiel: Satzzeichen (aus Verbmobil; KOMPE et al., 1995)<br />

S Worthypothesengraph (ohne Prosodie)<br />

- ja zur not geht’s auch am samstag<br />

S Mit Prosodie (Alternative 1)<br />

- ja, zur Not geht’s auch am Samstag.<br />

S Mit Prosodie (Alternative 2)<br />

- ja, zur Not. Geht’s auch am Samstag?<br />

04b sam_1.17<br />

Mögliche Struktur eines Dialogsystems<br />

(FELLBAUM, 2000)<br />

<strong>Mensch</strong>-<strong>Maschine</strong>-Dialoge sind auf sehr verschiedene Arten möglich.<br />

Natürliche gesprochene Sprache ist nur eine davon.<br />

S Ständige “Konkurrenz” an<strong>der</strong>er Dialogmodi; je nach Situation<br />

Verwendung gesprochener Sprache im Vorteil o<strong>der</strong> im Nachteil<br />

S Neuere Entwicklung: multimodale Dialoge (akustisch und visuell)<br />

04b sam_1.19<br />

Sprechererkennung/<br />

-verifikation<br />

Spracherkennung(Diktiermaschine)<br />

04b sam_1.18<br />

04b sam_1.20<br />

Spracheingabe<br />

<strong>Mensch</strong>-<strong>Maschine</strong>-Dialog<br />

Akustische <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Sprachverstehenssysteme<br />

<strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<br />

Dialog<br />

Sprachausgabe<br />

Inhaltsgesteuerte<br />

Sprachsynthese<br />

TTS<br />

(Vorleseautomat)<br />

So arbeitet ein Dialogmanager-Modul<br />

(PIERACCINI, 2000)

Dialogstrategien [1]<br />

(PIERACCINI, 2000)<br />

Carry on the Conversation ...<br />

Whowouldyouliketospeakwith?<br />

<br />

Ididn’thearyou.Whowouldyouliketospeakwith?<br />

Uh, um -- I’d like to talk to Mark if he’s around.<br />

Sorry, I didn’t un<strong>der</strong>stand. Please say the name of the person<br />

you would like to speak with.<br />

Mark.<br />

We have more than one Mark. Which one do you want?<br />

Mark Levinson.<br />

Mark Levinson, correct?<br />

Yes.<br />

Okay. Please hold while I transfer...<br />

04b sam_1.21<br />

Timeout - keine Antwort<br />

S I didn’t hear you, please try again.<br />

Niedrige Konfidenz bei <strong>der</strong> Erkennung<br />

S I didn’t un<strong>der</strong>stand.<br />

Bestätigung<br />

S Did you say IBM?<br />

Dialogstrategien [3]<br />

(PIERACCINI, 2000)<br />

Der gleiche Fehler darf nicht mehrmals gemacht werden<br />

S Did you say Boston? -- Did you say Boston?<br />

Rückfallposition<br />

S I still can’t un<strong>der</strong>stand. Please spell that.<br />

Disambiguierung<br />

S Which Steve did you mean?<br />

04b sam_1.23<br />

Where would you like to fly?<br />

Boston.<br />

Was that “Austin?”<br />

No.<br />

My mistake. Please say it again.<br />

Boston.<br />

Was that “Austin?”<br />

ARRRRRRGHHHH!<br />

Dialogstrategien [2]<br />

(PIERACCINI, 2000)<br />

Ein Negativbeispiel<br />

Was macht das Dialogmanager-Modul hier falsch ...?<br />

04b sam_1.22<br />

Sprechererkennung/<br />

-verifikation<br />

Spracherkennung(Diktiermaschine)<br />

04b sam_1.24<br />

Spracheingabe<br />

Akustische <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Sprachverstehenssysteme<br />

<strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<br />

Dialog<br />

Sprachausgabe<br />

Sprachausgabe<br />

Inhaltsgesteuerte<br />

Sprachsynthese<br />

TTS<br />

(Vorleseautomat)

Verschiedene Typen von Synthesesystemen<br />

für die verschiedenen Anwendungen<br />

S Textgesteuerte Synthese (Text-to-Speech, TTS):<br />

Vorleseautomat für einen beliebigen, in Rechtschrift<br />

vorliegenden Text. Die <strong>Maschine</strong> “weiß” nicht, was sie sagt.<br />

S Inhaltsgesteuerte Synthese (Concept-to-Speech o<strong>der</strong><br />

Content-to-Speech, CTS): akustische Ausgabe von einer<br />

Datenbankabfrage o<strong>der</strong> aus einem Dialogsystem. Die<br />

Synthese erfolgt von einer semantischen Repräsentation<br />

mit Hilfe eines Generierungsmoduls. Die <strong>Maschine</strong> sollte<br />

genau “wissen”, was sie sagt.<br />

S Reproduktive Sprachsynthese (Sprachwie<strong>der</strong>gabe):<br />

akustische Ausgabe von vorgefertigten Versatzstücken<br />

(Mindestlänge: Phrase). Für streng begrenzte Domänen.<br />

04b sam_1.25<br />

Diskret<br />

Kontinuierlich<br />

04b sam_1.27<br />

TTS-System (Vorleseautomat)<br />

Symbolverarbeitung<br />

Umwandlung Rechtschrift in Lautschrift<br />

Bausteinauswahl<br />

Verkettung<br />

Signalsynthese<br />

Prosodiesteuerung<br />

Synthetisches Sprachsignal<br />

Text in Rechtschreibform<br />

Kette phonetischer Symbole<br />

mit Annotationen<br />

Akustisch/parametrische<br />

Darstellung<br />

Reproduktive Synthese<br />

(Sprachwie<strong>der</strong>gabe)<br />

S Wie<strong>der</strong>gabe vorgefertigter Versatzstücke aus einer<br />

Sprachdatensammlung ohne Manipulation<br />

S Verkettung von Versatzstücken in Sprachpausen<br />

S Natürliche Qualität bleibt (nahezu) erhalten<br />

S Heute bereits weite Anwendungsbereiche in Ansagediensten.<br />

S Eng begrenzte Domäne -wasnichtexplizitin<strong>der</strong>Datenbasis<br />

vorhanden ist, kann nicht wie<strong>der</strong>gegeben werden.<br />

04b sam_1.26<br />

Einsatz für Behin<strong>der</strong>te<br />

(FELLBAUM, 1996)<br />

Als Hilfsmittel für Behin<strong>der</strong>te haben Sprachsynthesesysteme<br />

bisher ihr größtes Einsatzgebiet gefunden:<br />

S Für Blinde: Vorleseautomat (Vorlesesystem), Textverarbeitungssystem<br />

mit Sprachausgabe, PC-Anwendungen,<br />

Warn- und Alarmsysteme.<br />

S Für Sprechbehin<strong>der</strong>te: Umsetzung von eingegebenem<br />

Text in Sprache, Übersetzung von unverständlicher in<br />

verständliche Sprache.<br />

S Für Taubstumme: Umsetzung von eingegebenem Text in<br />

Sprache.<br />

Sprachsynthesesysteme für Behin<strong>der</strong>te sind typische<br />

TTS-Einsatzgebiete.<br />

04b sam_1.28

Diskret<br />

Kontinuierlich<br />

04b sam_1.29<br />

CTS benötigt nicht alle TTS-Module ...<br />

... aber stets ein TTS-System im Hintergrund<br />

als Rückfallposition<br />

Symbolverarbeitung<br />

Umwandlung Rechtschrift in Lautschrift<br />

Bausteinauswahl<br />

Verkettung<br />

Signalsynthese<br />

Prosodiesteuerung<br />

Synthetisches Sprachsignal<br />

vom<br />

Generierungsmodul<br />

Kette phonetischer Symbole<br />

mit Annotationen<br />

Akustisch/parametrische<br />

Darstellung<br />

Paradigmen für die akustische Synthese<br />

(Regelbasierte) Parametrische Synthese<br />

S Synthese von einer parametrischen Repräsentation <strong>der</strong> <strong>akustischen</strong><br />

Daten (akustisches Front-End)<br />

S Parameter werden generiert von gespeicherten Tabellen (regelbasiert)<br />

o<strong>der</strong> von natürlichsprachlichen Äußerungen<br />

S Neuere Entwicklung: Generierung <strong>der</strong> Parameter von trainierbaren<br />

<strong>Systeme</strong>n (z. B. HMM)<br />

Verkettung vordefinierter Elemente und Bausteine<br />

S Synthese von natürlichen Sprachbausteinen, meist im Zeitbereich<br />

S Phonetisch/phonologisch motivierte Einheiten wie Diphone o<strong>der</strong> Halbsilben<br />

S Eine Instanz jedes Bausteins, entnommen aus einem Trägersatz, prosodisch neutral<br />

Synthese vom Korpus (Non-Uniform Unit Selection)<br />

S Keine vordefinierten Einheiten<br />

S Suche nach Folge optimaler Einheiten aus dem Korpus während <strong>der</strong> Synthese<br />

S Zahlreiche Instanzen jedes Elements;<br />

natürliche Prosodie wird bewahrt<br />

04b sam_1.31<br />

Einsatzgebiete für CTS<br />

Hauptanwendungen für CTS: Dialogsysteme (z. B. Verbmobil);<br />

Ansagedienste mit variablem Wortschatz; Auskunftssysteme<br />

(z.B. Zugauskunft); Navigationssysteme im Auto<br />

S alternativer/zusätzlicher Ausgabekanal bei Verfügbarkeit eines<br />

Bildschirms<br />

S alleinige Ausgabemöglichkeit bei Benutzung eines Telefons (ohne<br />

Displaytechnik mit größerer Kapazität)<br />

Alle diese Anwendungen haben eine begrenzte Domäne. Hierdurch<br />

gerät CTS in direkte Konkurrenz zur reproduktiven Sprachsynthese<br />

und ist dieser hinsichtlich Qualität hoffnungslos unterlegen.<br />

Korpusbasierte Synthese (Nonuniform Unit Selection) gestattet es<br />

TTS und CTS, sich <strong>der</strong> Technik <strong>der</strong> Sprachwie<strong>der</strong>gabe zu bedienen,<br />

um die Qualität zu verbessern.<br />

04b sam_1.30<br />

Sprechererkennung/<br />

-verifikation<br />

Spracherkennung(Diktiermaschine)<br />

04b sam_1.32<br />

Spracheingabe<br />

Abschließende Bemerkungen<br />

Akustische <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong><br />

Sprachverstehenssysteme<br />

<strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<br />

Dialog<br />

Sprachausgabe<br />

Inhaltsgesteuerte<br />

Sprachsynthese<br />

TTS<br />

(Vorleseautomat)

Bilanz und Ausblick<br />

S Für begrenzte Domänen und begrenzte Aufgaben sind<br />

leistungsfähige <strong>Systeme</strong> auf dem Markt.<br />

S Wo solche <strong>Systeme</strong> verfügbar sind, bringt ihr Einsatz Vorteile<br />

bezüglich Zugang, Zeitbedarf, Arbeitsqualität.<br />

S <strong>Systeme</strong> für größere Aufgaben sind noch sehr fragil.<br />

- Verständlichkeit <strong>der</strong> Sprachsynthese sinkt bei Lärm sehr schnell.<br />

- z.B. Verbmobil: 70% approximativ korrekte Übersetzungen.<br />

S Weiterentwicklung erfor<strong>der</strong>t interdisziplinäre Zusammenarbeit<br />

von Informatikern, Ingenieuren, (Computer-)Linguisten,<br />

Phonetikern, Psychologen.<br />

S Erweiterung <strong>der</strong> Aufgabe hinsichtlich multimodaler <strong>Mensch</strong>-<br />

<strong>Maschine</strong>-<strong>Kommunikation</strong> wird neue Anwendungen schaffen.<br />

04b sam_1.33