PDF-Ausgabe herunterladen (10.3 MB) - IEE

PDF-Ausgabe herunterladen (10.3 MB) - IEE

PDF-Ausgabe herunterladen (10.3 MB) - IEE

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

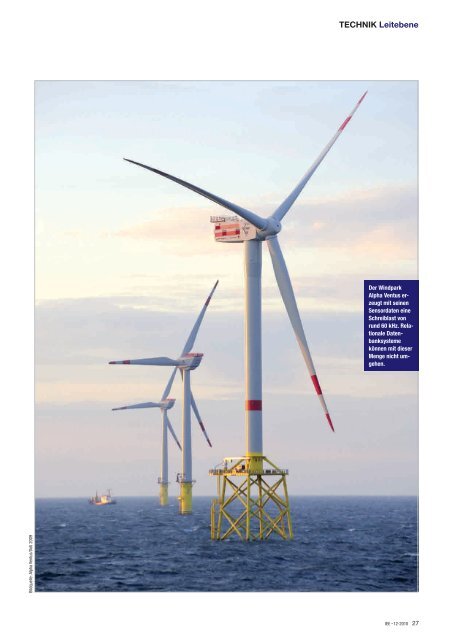

TECHNIK Leitebene<br />

Der Windpark<br />

Alpha Ventus erzeugt<br />

mit seinen<br />

Sensordaten eine<br />

Schreiblast von<br />

rund 60 kHz. Relationale<br />

Datenbanksysteme<br />

können mit dieser<br />

Menge nicht umgehen.<br />

Bildquelle: Alpha Ventus/Doti 2009<br />

<strong>IEE</strong> • 12-2010 27