Champs aléatoires de Markov couples et segmentation des images ...

Champs aléatoires de Markov couples et segmentation des images ...

Champs aléatoires de Markov couples et segmentation des images ...

- No tags were found...

Create successful ePaper yourself

Turn your PDF publications into a flip-book with our unique Google optimized e-Paper software.

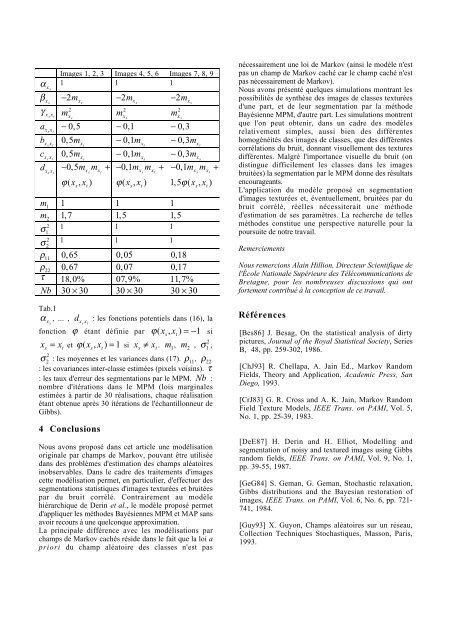

Images 1, 2, 3 Images 4, 5, 6 Images 7, 8, 9α xs1 1 1β xs−2m xs−2m xs−2m xsγ xs x t2m xs2m xs2m xsa xs x t− 0,5 − 0,1 − 0,3b xs x t0,5m xt− 0,1m xt− 0,3m xtc xs x t0,5m xs− 0,1m xs− 0,3m xsd xs x t−0,5m xsm xt+ −0,1m xsm xt+ −0,1m xsm xt+ϕ(x s, x t)ϕ(x s, x t)m 11 1 1m 21,7 1,5 1,52σ 11 1 11,5ϕ(x s, x t)2σ 21 1 1ρ 110,65 0,05 0,18ρ 220,67 0,07 0,17τ 18,0% 07,9% 11,7%Nb 30 × 30 30 × 30 30 × 30Tab.1α xs, ... , d xs x t: les fonctions potentiels dans (16), lafonction ϕ étant définie par ϕ(x s, x t) = −1 six s= x t<strong>et</strong> ϕ(x s, x t) = 1 si x s≠ x t. m 1, m 2, σ 1 2 ,σ 2 2 : les moyennes <strong>et</strong> les variances dans (17). ρ 11, ρ 22: les covariances inter-classe estimées (pixels voisins). τ: les taux d'erreur <strong>de</strong>s <strong>segmentation</strong>s par le MPM. Nb :nombre d'itérations dans le MPM (lois marginalesestimées à partir <strong>de</strong> 30 réalisations, chaque réalisationétant obtenue après 30 itérations <strong>de</strong> l'échantillonneur <strong>de</strong>Gibbs).4 ConclusionsNous avons proposé dans c<strong>et</strong> article une modélisationoriginale par champs <strong>de</strong> <strong>Markov</strong>, pouvant être utiliséedans <strong>de</strong>s problèmes d'estimation <strong>de</strong>s champs aléatoiresinobservables. Dans le cadre <strong>de</strong>s traitements d'<strong>images</strong>c<strong>et</strong>te modélisation perm<strong>et</strong>, en particulier, d'effectuer <strong>de</strong>s<strong>segmentation</strong>s statistiques d'<strong>images</strong> texturées <strong>et</strong> bruitéespar du bruit corrélé. Contrairement au modèlehiérarchique <strong>de</strong> Derin <strong>et</strong> al., le modèle proposé perm<strong>et</strong>d'appliquer les métho<strong>de</strong>s Bayésiennes MPM <strong>et</strong> MAP sansavoir recours à une quelconque approximation.La principale différence avec les modélisations parchamps <strong>de</strong> <strong>Markov</strong> cachés rési<strong>de</strong> dans le fait que la loi apriori du champ aléatoire <strong>de</strong>s classes n'est pasnécessairement une loi <strong>de</strong> <strong>Markov</strong> (ainsi le modèle n'estpas un champ <strong>de</strong> <strong>Markov</strong> caché car le champ caché n'estpas nécessairement <strong>de</strong> <strong>Markov</strong>).Nous avons présenté quelques simulations montrant lespossibilités <strong>de</strong> synthèse <strong>de</strong>s <strong>images</strong> <strong>de</strong> classes texturéesd'une part, <strong>et</strong> <strong>de</strong> leur <strong>segmentation</strong> par la métho<strong>de</strong>Bayésienne MPM, d'autre part. Les simulations montrentque l'on peut obtenir, dans un cadre <strong>de</strong>s modèlesrelativement simples, aussi bien <strong>de</strong>s différenteshomogénéités <strong>de</strong>s <strong>images</strong> <strong>de</strong> classes, que <strong>de</strong>s différentescorrélations du bruit, donnant visuellement <strong>de</strong>s texturesdifférentes. Malgré l'importance visuelle du bruit (ondistingue difficilement les classes dans les <strong>images</strong>bruitées) la <strong>segmentation</strong> par le MPM donne <strong>de</strong>s résultatsencourageants.L'application du modèle proposé en <strong>segmentation</strong>d'<strong>images</strong> texturées <strong>et</strong>, éventuellement, bruitées par dubruit corrélé, réelles nécessiterait une métho<strong>de</strong>d'estimation <strong>de</strong> ses paramètres. La recherche <strong>de</strong> tellesmétho<strong>de</strong>s constitue une perspective naturelle pour lapoursuite <strong>de</strong> notre travail.RemerciementsNous remercions Alain Hillion, Directeur Scientifique <strong>de</strong>l'École Nationale Supérieure <strong>de</strong>s Télécommunications <strong>de</strong>Br<strong>et</strong>agne, pour les nombreuses discussions qui ontfortement contribué à la conception <strong>de</strong> ce travail.Références[Bes86] J. Besag, On the statistical analysis of dirtypictures, Journal of the Royal Statistical Soci<strong>et</strong>y, SeriesB, 48, pp. 259-302, 1986.[ChJ93] R. Chellapa, A. Jain Ed., <strong>Markov</strong> RandomFields, Theory and Application, Aca<strong>de</strong>mic Press, SanDiego, 1993.[CrJ83] G. R. Cross and A. K. Jain, <strong>Markov</strong> RandomField Texture Mo<strong>de</strong>ls, IEEE Trans. on PAMI, Vol. 5,No. 1, pp. 25-39, 1983.[DeE87] H. Derin and H. Elliot, Mo<strong>de</strong>lling and<strong>segmentation</strong> of noisy and textured <strong>images</strong> using Gibbsrandom fields, IEEE Trans. on PAMI, Vol. 9, No. 1,pp. 39-55, 1987.[GeG84] S. Geman, G. Geman, Stochastic relaxation,Gibbs distributions and the Bayesian restoration of<strong>images</strong>, IEEE Trans. on PAMI, Vol. 6, No. 6, pp. 721-741, 1984.[Guy93] X. Guyon, <strong>Champs</strong> aléatoires sur un réseau,Collection Techniques Stochastiques, Masson, Paris,1993.