Vorlesung

Vorlesung

Vorlesung

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

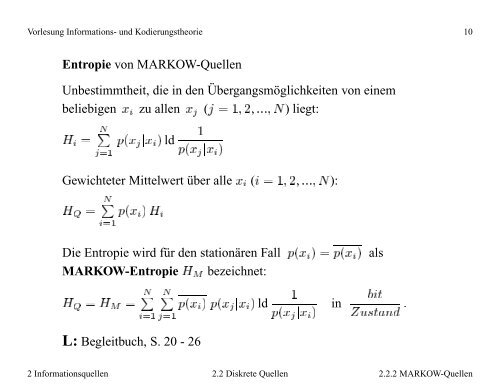

<strong>Vorlesung</strong> Informations- und Kodierungstheorie 10<br />

Entropie von MARKOW-Quellen<br />

ÀÆÈ<br />

Unbestimmtheit, die in den Übergangsmöglichkeiten von einem<br />

beliebigenÜzu<br />

½ Ô´Üܵ ½ allenÜ(½¾Æ) liegt:<br />

Ô´Üܵld<br />

ÀÉÆÈ<br />

Gewichteter<br />

½ ԴܵÀ<br />

Mittelwert über alleÜ(½¾Æ):<br />

ÀÉÀÅÆÈ<br />

Die Entropie wird für den stationären FallԴܵԴܵals<br />

MARKOW-EntropieÀÅbezeichnet:<br />

½½ ÆÈ Ô´Üܵ ½ Ø Ô´ÜµÔ´Üܵld in<br />

L: Begleitbuch, S. 20 - 26<br />

Ù×ØÒ<br />

2 Informationsquellen 2.2 Diskrete Quellen 2.2.2 MARKOW-Quellen