PDF, 3 MB - CENIA, ÄÂeská informaÄÂnàagentura životnÃÂho prostředÃÂ

PDF, 3 MB - CENIA, ÄÂeská informaÄÂnàagentura životnÃÂho prostředÃÂ

PDF, 3 MB - CENIA, ÄÂeská informaÄÂnàagentura životnÃÂho prostředÃÂ

- No tags were found...

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

1<br />

D = ln( ac)<br />

−(<br />

ln( Covc<br />

)) −<br />

2<br />

1<br />

T<br />

−1<br />

− ( ( X − Mc)<br />

( Covc<br />

)( X − Mc))<br />

2<br />

kde<br />

D = váhová vzdálenost (pravděpodobnost),<br />

c = daná třída (příznak),<br />

X = rozměrový vektor kandidátského pixelu,<br />

M c<br />

= střední vektor vzorku třídy (příznaku) c,<br />

a c<br />

= procentuální pravděpodobnost, kdy kandidátní<br />

pixel se stává součástí třídy c ,<br />

Cov c<br />

= kovarianční matice pixelů ve vzorku třídy c,<br />

|Cov c<br />

| = determinant Cov c<br />

,<br />

-1<br />

Cov c<br />

= inverzní matice Cov c<br />

,<br />

ln = přirozený logaritmus,<br />

T = transpoziční funkce.<br />

Pro zvýšení přesnosti Bayesova klasifikátoru bylo použito<br />

váhových faktorů pro jednotlivé třídy. Ty byly počítány<br />

jako váhové odchylky podle následujícího předpisu<br />

W<br />

ij<br />

=<br />

1<br />

2<br />

c−1<br />

⎡⎛<br />

⎢⎜<br />

⎢⎣<br />

⎝<br />

⎛<br />

⎜<br />

⎝<br />

∑ ∑<br />

i= 1 j=<br />

i+<br />

1<br />

c<br />

∑<br />

i=<br />

1<br />

c<br />

⎞<br />

fi⎟<br />

⎠<br />

2<br />

⎞<br />

fifjUij<br />

⎟<br />

⎠<br />

−<br />

c<br />

∑<br />

i=<br />

1<br />

f<br />

2<br />

i<br />

⎤<br />

⎥<br />

⎥⎦<br />

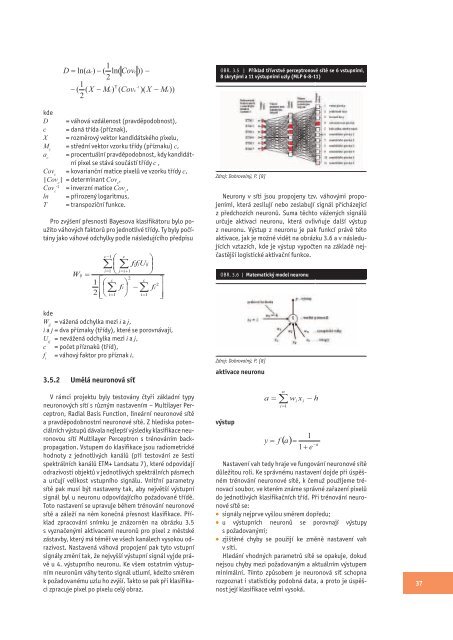

OBR. 3.5 | Příklad třívrstvé perceptronové sítě se 6 vstupními,<br />

8 skrytými a 11 výstupními uzly (MLP 6-8-11)<br />

Zdroj: Dobrovolný, P. [8]<br />

Neurony v síti jsou propojeny tzv. váhovými propojeními,<br />

která zesilují nebo zeslabují signál přicházející<br />

z předchozích neuronů. Suma těchto vážených signálů<br />

určuje aktivaci neuronu, která ovlivňuje další výstup<br />

z neuronu. Výstup z neuronu je pak funkcí právě této<br />

aktivace, jak je možné vidět na obrázku 3.6 a v následujících<br />

vztazích, kde je výstup vypočten na základě nejčastější<br />

logistické aktivační funkce.<br />

OBR. 3.6 | Matematický model neuronu<br />

kde<br />

W ij<br />

= vážená odchylka mezi i a j,<br />

i a j = dva příznaky (třídy), které se porovnávají,<br />

U ij<br />

= nevážená odchylka mezi i a j,<br />

c = počet příznaků (tříd),<br />

f i<br />

= váhový faktor pro příznak i.<br />

3.5.2 Umělá neuronová síť<br />

V rámci projektu byly testovány čtyři základní typy<br />

neuronových sítí s různým nastavením – Multilayer Perceptron,<br />

Radial Basis Function, lineární neuronové sítě<br />

a pravděpodobnostní neuronové sítě. Z hlediska potenciálních<br />

výstupů dávala nejlepší výsledky klasifikace neuronovou<br />

sítí Multilayer Perceptron s trénováním backpropagation.<br />

Vstupem do klasifikace jsou radiometrické<br />

hodnoty z jednotlivých kanálů (při testování ze šesti<br />

spektrálních kanálů ETM+ Landsatu 7), které odpovídají<br />

odrazivosti objektů v jednotlivých spektrálních pásmech<br />

a určují velikost vstupního signálu. Vnitřní parametry<br />

sítě pak musí být nastaveny tak, aby největší výstupní<br />

signál byl u neuronu odpovídajícího požadované třídě.<br />

Toto nastavení se upravuje během trénování neuronové<br />

sítě a záleží na něm konečná přesnost klasifikace. Příklad<br />

zpracování snímku je znázorněn na obrázku 3.5<br />

s vyznačenými aktivacemi neuronů pro pixel z městské<br />

zástavby, který má téměř ve všech kanálech vysokou odrazivost.<br />

Nastavená váhová propojení pak tyto vstupní<br />

signály změní tak, že nejvyšší výstupní signál vyjde právě<br />

u 4. výstupního neuronu. Ke všem ostatním výstupním<br />

neuronům váhy tento signál utlumí, kdežto směrem<br />

k požadovanému uzlu ho zvýší. Takto se pak při klasifikaci<br />

zpracuje pixel po pixelu celý obraz.<br />

Zdroj: Dobrovolný, P. [8]<br />

aktivace neuronu<br />

výstup<br />

a =<br />

y =<br />

n<br />

∑<br />

i=<br />

1<br />

f<br />

w x − h<br />

i<br />

() a =<br />

−a<br />

i<br />

1<br />

1+<br />

e<br />

Nastavení vah tedy hraje ve fungování neuronové sítě<br />

důležitou roli. Ke správnému nastavení dojde při úspěšném<br />

trénování neuronové sítě, k čemuž použijeme trénovací<br />

soubor, ve kterém známe správné zařazení pixelů<br />

do jednotlivých klasifikačních tříd. Při trénování neuronové<br />

sítě se:<br />

● signály nejprve vyšlou směrem dopředu;<br />

● u výstupních neuronů se porovnají výstupy<br />

s požadovanými;<br />

● zjištěné chyby se použijí ke změně nastavení vah<br />

v síti.<br />

Hledání vhodných parametrů sítě se opakuje, dokud<br />

nejsou chyby mezi požadovaným a aktuálním výstupem<br />

minimální. Tímto způsobem je neuronová síť schopna<br />

rozpoznat i statisticky podobná data, a proto je úspěšnost<br />

její klasifikace velmi vysoká.<br />

37