307 KB - Universität Bremen

307 KB - Universität Bremen

307 KB - Universität Bremen

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

Kanalcodierung I<br />

Dr.-Ing. Volker Kühn, Dr.-Ing. Dirk Wübben<br />

<strong>Universität</strong> <strong>Bremen</strong><br />

Fachbereich 1, ANT<br />

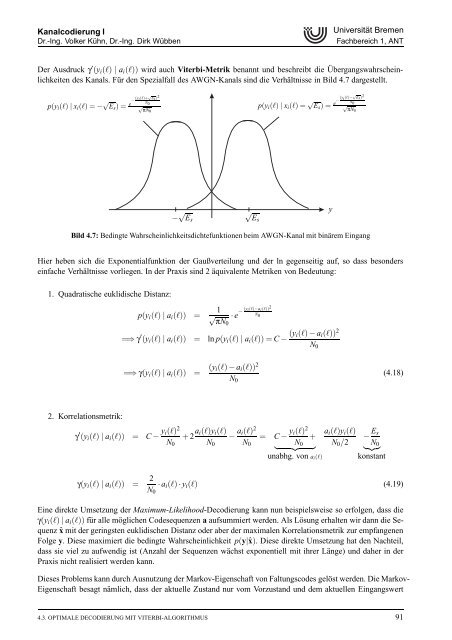

Der Ausdruck γ ′ (yi(ℓ) | ai(ℓ)) wird auch Viterbi-Metrik benannt und beschreibt die Übergangswahrscheinlichkeiten<br />

des Kanals. Für den Spezialfall des AWGN-Kanals sind die Verhältnisse in Bild 4.7 dargestellt.<br />

p(yi(ℓ)|xi(ℓ)=− √ Es)= e−(y i (ℓ)+√Es) 2<br />

N0 √<br />

πN0<br />

− √ Es<br />

√ Es<br />

p(yi(ℓ)|xi(ℓ)= √ Es)= e−(y i (ℓ)−√Es) 2<br />

N0 √<br />

πN0<br />

Bild 4.7: Bedingte Wahrscheinlichkeitsdichtefunktionen beim AWGN-Kanal mit binärem Eingang<br />

Hier heben sich die Exponentialfunktion der Gaußverteilung und der ln gegenseitig auf, so dass besonders<br />

einfache Verhältnisse vorliegen. In der Praxis sind 2 äquivalente Metriken von Bedeutung:<br />

1. Quadratische euklidische Distanz:<br />

2. Korrelationsmetrik:<br />

γ ′ (yi(ℓ)|ai(ℓ)) = C−<br />

γ(yi(ℓ)|ai(ℓ)) = 2<br />

p(yi(ℓ)|ai(ℓ)) =<br />

1<br />

√ · e<br />

πN0<br />

−(y i (ℓ)−ai (ℓ))2<br />

N0 =⇒ γ ′ (yi(ℓ)|ai(ℓ)) = ln p(yi(ℓ)|ai(ℓ))= C−<br />

=⇒ γ(yi(ℓ)|ai(ℓ)) =<br />

N0<br />

yi(ℓ) 2<br />

N0<br />

+ 2 ai(ℓ)yi(ℓ)<br />

N0<br />

(yi(ℓ)−ai(ℓ)) 2<br />

N0<br />

−<br />

ai(ℓ) 2<br />

N0<br />

= C−<br />

y<br />

(yi(ℓ)−ai(ℓ)) 2<br />

yi(ℓ) 2<br />

N0<br />

N0<br />

+<br />

<br />

unabhg. von ai(ℓ)<br />

ai(ℓ)yi(ℓ)<br />

N0/2<br />

− Es<br />

N0<br />

<br />

konstant<br />

(4.18)<br />

· ai(ℓ)·yi(ℓ) (4.19)<br />

Eine direkte Umsetzung der Maximum-Likelihood-Decodierung kann nun beispielsweise so erfolgen, dass die<br />

γ(yi(ℓ)|ai(ℓ)) für alle möglichen Codesequenzen a aufsummiert werden. Als Lösung erhalten wir dann die Sequenz<br />

ˆx mit der geringsten euklidischen Distanz oder aber der maximalen Korrelationsmetrik zur empfangenen<br />

Folge y. Diese maximiert die bedingte Wahrscheinlichkeit p(y|ˆx). Diese direkte Umsetzung hat den Nachteil,<br />

dass sie viel zu aufwendig ist (Anzahl der Sequenzen wächst exponentiell mit ihrer Länge) und daher in der<br />

Praxis nicht realisiert werden kann.<br />

Dieses Problems kann durch Ausnutzung der Markov-Eigenschaft von Faltungscodes gelöst werden. Die Markov-<br />

Eigenschaft besagt nämlich, dass der aktuelle Zustand nur vom Vorzustand und dem aktuellen Eingangswert<br />

4.3. OPTIMALE DECODIERUNG MIT VITERBI-ALGORITHMUS 91