Vertrauensmarketing

Vertrauensmarketing

Vertrauensmarketing

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

421<br />

TECHNIK<br />

1 | EINLEITUNG<br />

Dieser Beitrag zeigt eine Prototyplösung auf, mit der Videoaufnahmen<br />

aus Mini- oder Mikrodrohnen in Echtzeit oder offline<br />

in einen virtuellen Globus integriert werden können. Dabei<br />

wurde der Fokus speziell auf die Verwendung von kostengünstigen<br />

und rasch verfügbaren Mini- und Mikrodrohnensystemen<br />

gelegt. Gerade auf Plattformsystemen dieser Kategorie<br />

können wegen Gewichtslimitierungen und aus Kostengründen<br />

zur Fluglagebestimmung nur Sensorsysteme geringer Qualität<br />

verwendet werden. Diese Einschränkungen limitieren die Georegistrierungsgenauigkeit,<br />

mit welcher die Videodaten in die<br />

virtuelle Welt integriert werden können. Die Prototyp-Entwicklung<br />

erfolgte im Rahmen des KTI-Projekts »Virtual Monitoring«<br />

[1] am Institut Vermessung und Geoinformation der Fachhochschule<br />

Nordwestschweiz. Der in diesem Beitrag präsentierte<br />

Ansatz unterscheidet sich in mehrfacher Hinsicht von<br />

mini- und mikrodrohnenbasierten photogrammetrischen Anwendungen<br />

wie sie u. a. in [2] vorgestellt werden. So liegt der<br />

Fokus bei der hier vorgestellten Lösung im Speziellen bei der<br />

Echtzeit-Georegistrierung und -Geodatenintegration von Bilddaten<br />

in virtuelle Globen. Für die Echtzeit-Georegistrierung<br />

werden die standardmäßig verfügbaren Geosensoren auf den<br />

unbemannten Plattformen sowie die bestehende Geodatenbasis<br />

des virtuellen Globus verwendet. Vertiefende Informationen<br />

über die realisierte Lösung sind in der Veröffentlichung<br />

[3] zu finden.<br />

2 | VERWENDETE BASISTECHNOLOGIEN<br />

Heute existiert eine große Anzahl verschiedener unbemannter<br />

Flugsysteme für unterschiedliche Anwendungen und in unterschiedlichen<br />

Ausführungen auf dem Markt. Gerade Mini- und<br />

Mikrodrohnen werden zunehmend als kostengünstige und effiziente<br />

Aufnahmeplattformen für Geodaten eingesetzt. Die<br />

europäische Assoziation für unbemannte Flugsysteme (EU-<br />

ROUVS) klassiert diese Kleinstflugsysteme wie folgt:<br />

Kategorie Maximales<br />

Startgewicht<br />

Mikro<br />

Mini<br />

< 5 kg<br />

< 30 kg<br />

Diese Fluggeräte verfügen meist über einen integrierten Fluglagekontroller,<br />

der eine automatische Stabilisierung sowie eine<br />

ferngesteuerte Navigation erlaubt. Einige Plattformen verfügen<br />

zusätzlich über einen Autopiloten, der vollständig auto-<br />

3<br />

Maximale<br />

Flughöhe<br />

250 m<br />

150–300 m<br />

Flugdauer Datenlink-<br />

Reichweite<br />

1 h<br />

< 2 h<br />

Tabelle 1 | Klassifikation Mini- und Mikrodrohnensysteme<br />

< 10 km<br />

< 10 km<br />

nome Flüge ermöglicht. Die für die Fluglagedatenbestimmung<br />

notwendigen Sensordaten werden meist mittels MEMS- (Micro-Electro-Mechanical<br />

System) basiertem Inertialnavigationssystem<br />

(INS), Navigations-GPS-Empfänger, Magnetkompass<br />

und Barometer erfasst. Dabei werden die Fluglagedaten bestehend<br />

aus Position, Ausrichtung und Geschwindigkeit aus den<br />

einzelnen Sensoren vom Fluglagekontroller durch Sensordatenfusions-Algorithmen<br />

optimal geschätzt. Die Prototyplösung<br />

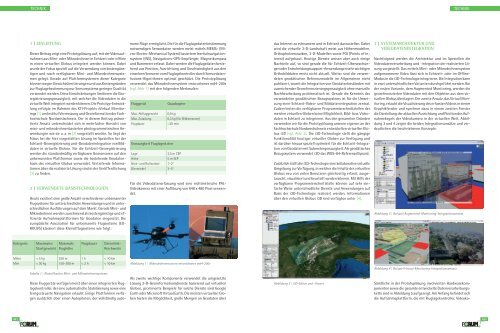

verwendet das Mikrodrohnensystem »microdrones md4-200«<br />

(vgl. Abb. 1) mit den folgenden Merkmalen:<br />

Fluggerät Quadcopter<br />

Max. Abfluggewicht<br />

Max. Zuladung<br />

Flugdauer<br />

Genauigkeit Fluglagedaten<br />

Lage<br />

Höhe<br />

Nick- und Rollwinkel<br />

Gierwinkel<br />

0,9 kg<br />

0,3 kg (für Bildsensoren)<br />

~20 min<br />

3,5 m CEP<br />

5 m SEP<br />

1–2°<br />

3–5°<br />

Für die Videodatenerfassung wird eine nichtmetrische PAL-<br />

Videokamera mit einer Auflösung von 640 x 480 Pixel verwendet.<br />

Abbildung 1 | Mikrodrohnensystem »microdrones md4-200«<br />

Als zweite wichtige Komponente verwendet die umgesetzte<br />

Lösung 3-D-Geoinformationsdienste basierend auf virtuellen<br />

Globen, prominente Beispiele für solche Dienste sind Google<br />

Earth oder Microsoft Virtual Earth. Die meisten virtuellen Globen<br />

bieten die Möglichkeit, große Mengen an Geodaten über<br />

das Internet zu »streamen« und in Echtzeit darzustellen. Dabei<br />

wird die virtuelle 3-D-Landschaft meist aus Höhenmodellen,<br />

Orthophotomosaiken, 3-D-Modellen sowie POI (Points of Interest)<br />

aufgebaut. Heutige Dienste weisen aber auch einige<br />

Nachteile auf, so sind gerade die für Echtzeit-Überwachungen<br />

oder Entscheidungssupport-Anwendungen sehr wichtigen<br />

Orthobilddaten meist nicht aktuell. Weiter sind die verwendeten<br />

geodätischen Referenzmodelle im Allgemeinen nicht<br />

publiziert, womit die Integration von Geodatenbeständen mit<br />

ausreichender Georeferenzierungsgenauigkeit ohne manuelle<br />

Nachbearbeitung problematisch ist. Gerade die Kenntnis des<br />

verwendeten geodätischen Bezugssystems ist für die Umsetzung<br />

einer Echtzeit-Video- und Bilddatenintegration zentral.<br />

Zudem bieten die verfügbaren Programmierschnittstellen der<br />

meisten virtuellen Globen keine Möglichkeit, Bild- bzw. Videodaten<br />

in Echtzeit zu integrieren. Aus den genannten Gründen<br />

verwenden wir für die Prototyplösung unseren eigenen an der<br />

Fachhochschule Nordwestschweiz entwickelten virtuellen Globus<br />

i3D (vgl. Abb. 2). Die i3D-Technologie stellt die gängige<br />

Funktionalität heutiger virtueller Globen zur Verfügung und<br />

ist darüber hinaus speziell optimiert für die Echtzeit-Integration<br />

von Geodaten mit Submetergenauigkeit. Als geodätisches<br />

Bezugssystem verwendet i3D das WGS-84-Referenzellipsoid.<br />

Zusätzlich stellt die i3D-Technologie eine kollaborative virtuelle<br />

Umgebung zur Verfügung, in welcher die Inhalte des virtuellen<br />

Globus neu von vielen Benutzern gleichzeitig erfasst, ausgetauscht,<br />

visualisiert und beurteilt werden können. Mit Hilfe der<br />

verfügbaren Programmierschnittstelle können auf sehr einfache<br />

Weise unterschiedliche Dienste und Anwendungen auf<br />

Basis der i3D-Technologie realisiert werden. Informationen<br />

über den virtuellen Globus i3D sind verfügbar unter [4].<br />

Abbildung 2 | i3D-Editor und -Viewer<br />

3 | SYSTEMARCHITEKTUR UND<br />

VIDEODATENINTEGRATION<br />

TECHNIK<br />

Nachfolgend werden die Architektur und im Speziellen die<br />

Videodatenverarbeitung und -integration der realisierten Lösung<br />

vorgestellt. Das mittels Mini- oder Mikrodrohnensystem<br />

aufgenommene Video lässt sich in Echtzeit- oder im Offline-<br />

Modus in die i3D-Technologie integrieren. Die Integration kann<br />

in zwei unterschiedlichen Varianten durchgeführt werden. Bei<br />

der ersten Variante, dem Augmented Monitoring, werden die<br />

georeferenzierten Videodaten mit den Objekten aus dem virtuellen<br />

Globus überlagert. Der zweite Ansatz, das Virtual Monitoring,<br />

erlaubt die Visualisierung des erfassten Videos in einem<br />

Graphikfenster und synchron dazu in einem zweiten Fenster<br />

die Darstellung der aktuellen Ausrichtung und Position des Aufnahmekegels<br />

der Videokamera in der virtuellen Welt. Abbildung<br />

3 und 4 zeigen die beiden Integrationsansätze und verdeutlichen<br />

die beschriebenen Konzepte.<br />

Abbildung 3 | Beispiel Augmented-Monitoring-Integrationsansatz<br />

Abbildung 4 | Beispiel Virtual-Monitoring-Integrationsansatz<br />

Sämtliche in der Prototyplösung involvierten Hardwarekomponenten<br />

sowie die gesamte entwickelte Datenverarbeitungskette<br />

sind in Abbildung 5 aufgezeigt. Am Anfang befindet sich<br />

die Aufnahmeplattform, die mit Fluglagekontroller, Videoka-<br />

3<br />

422