antriebstechnik 10/2023

antriebstechnik 10/2023

antriebstechnik 10/2023

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

FORSCHUNG UND ENTWICKLUNG<br />

mm<br />

JJ(Θ, xx) = 1 ∑(yŷ − yy)2.<br />

mm<br />

ii=1<br />

Für dieses mehrdimensionale nichtlineare Optimierungsproblem<br />

wird der Backpropagation Algorithmus verwendet. Die Gewichte<br />

Θ werden sukzessive entsprechend ihres Einflusses auf<br />

das Fehlermaß J (Θ, x) verändert. Um Divergenzen des Algorithmus<br />

vorzubeugen ist die Lernrate h eingeführt zur Abmilderung<br />

des Gradienten:<br />

Θ ≔ Θ − ηη ∂∂∂∂<br />

∂∂Θ .<br />

Bevor die Trainingsdaten dem Netzwerk zum Training bereitgestellt<br />

werden, erfolgt eine Normalisierung dieser mit deren Mittelwert<br />

und Standardabweichung für die jeweiligen Eingangsgrößen<br />

und die Ausgangsgröße.<br />

DATENGRUNDLAGE<br />

Die Nachgiebigkeiten d (Einflusszahlen) für die Regressionsanalyse<br />

stammen aus den in BECAL integrierten Berechnungsverfahren<br />

. Für die Bereitstellung der Trainingsdaten werden diese<br />

Methoden mit den folgenden Restriktionen angewandt. Betrachtet<br />

werden nur konvexe Kontaktpartner (r 1,2<br />

> 0 mm), sowie die<br />

Materialpaarung Stahl-Stahl, mit E 1,2<br />

= 2<strong>10</strong> GPa und v 1,2<br />

= 0,3.<br />

Durch die Betrachtung nur einer Materialpaarung ändern sich<br />

der E-Modul und die Querkontaktionszahl nicht und werden somit<br />

als Eingangsgrößen für die Regressionsgröße nicht berücksichtigt.<br />

Somit erfolgt die Regression mit neun Eingangs- und einer<br />

Ausgangsgröße.<br />

Die Bestimmung der Einflusszahlen anhand der verbleibenden<br />

neun freien Parameter ist bereits sehr schnell, so dass eine<br />

Großzahl an Daten für die Regressionsanalyse erzeugt werden<br />

kann und keine Augmentation der Daten notwendig ist. Zunächst<br />

erfolgt in einer Voruntersuchung die Festlegung eines<br />

charakteristischen Parameterraums für die Eingangsgrößen.<br />

Diese Werte stammen dabei aus einem typischen Bereich an<br />

Geometrievariationen für geradverzahnte Stirnräder, welche<br />

sich bis zu einem Raddurchmesser von 1.000 mm ergeben können.<br />

Daraus resultieren die in Tabelle 01 gelisteten Grenzen der<br />

Parameter. Nun können innerhalb dieser Schranken eine zufällige<br />

Normalverteilung von Werten für diese Eingangsgrößen erzeugt<br />

werden und anhand dieser Kombinationen die Einflusszahlen<br />

berechnet werden. Die Motivation dabei ist, durch die<br />

zufällige Verteilung von Datenpunkten über den gesamten Parameterraum<br />

ein möglichst robustes Modell zu erzeugen, wobei<br />

an dieser Stelle vorhandene geometrische Verhältnismäßigkeiten<br />

beim Abwälzen der Verzahnung vernachlässigt werden. Die<br />

hierdurch entstandenen Trainingsdaten bilden den Datensatz<br />

RAND.<br />

In einem zweiten Schritt wurden die oben genannten geometrischen<br />

Verhältnismäßigkeiten der Parameter untereinander verwendet.<br />

Dabei werden die geometrischen Parameter (r 1,2<br />

, a 1,2<br />

, w 1,2<br />

und t 1,2<br />

) anhand von gradverzahnten Stirnrädern (α n<br />

= 20°) bestimmt.<br />

Dies erfolgt, indem die Geometrie mit variierendem Modul<br />

und Zähnezahl, auf verschiedenen Punkten in der Eingriffsstrecke<br />

berechnet wird. Der Modul wird an dieser Stelle mit variiert,<br />

da dieser wesentlich die Krümmungsradien beeinflusst [7].<br />

Modul, Zähnezahl und Lasthorizonte finden sich in Tabelle 02.<br />

Zusätzlich wird eine Gleichverteilung der Linienlast zwischen<br />

den angrenzenden Lasthorizonten aus Tabelle 02 vorgenommen.<br />

Geometrie und Last können nun zufällig zusammengesetzt werden,<br />

um aus den resultierenden Werten die lokalen Kontaktnach-<br />

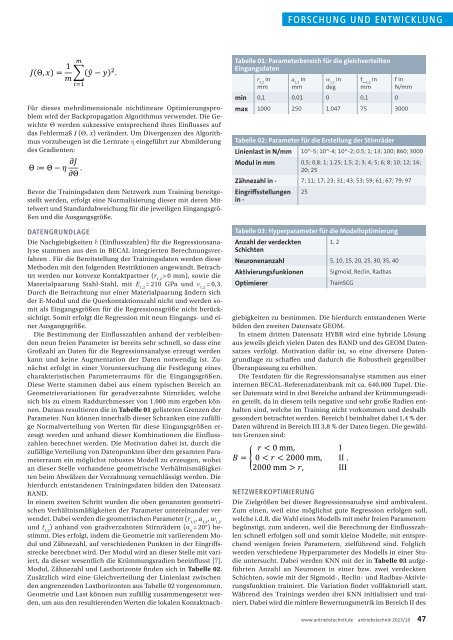

Tabelle 01: Parameterbereich für die gleichverteilten<br />

Eingangsdaten<br />

r 1,2<br />

in<br />

mm<br />

Tabelle 02: Parameter für die Erstellung der Stirnräder<br />

Linienlast in N/mm <strong>10</strong>^-5; <strong>10</strong>^-4; <strong>10</strong>^-2; 0.5; 1; 13; <strong>10</strong>0; 860; 3000<br />

Modul in mm 0,5; 0,8; 1; 1.25; 1.5; 2; 3; 4; 5; 6; 8; <strong>10</strong>; 12; 16;<br />

20; 25<br />

Zähnezahl in - 7; 11; 17; 23; 31; 43; 53; 59; 61; 67; 79; 97<br />

Eingriffsstellungen<br />

in -<br />

25<br />

Tabelle 03: Hyperparameter für die Modelloptimierung<br />

Anzahl der verdeckten<br />

Schichten<br />

1, 2<br />

Neuronenanzahl 5, <strong>10</strong>, 15, 20, 25, 30, 35, 40<br />

Aktivierungsfunkionen<br />

Optimierer<br />

a 1,2<br />

in<br />

mm<br />

w 1,2<br />

in<br />

deg<br />

Sigmoid, Reclin, Radbas<br />

TrainSCG<br />

t_ 1,2<br />

in<br />

mm<br />

min 0,1 0,01 0 0,1 0<br />

f in<br />

N/mm<br />

max <strong>10</strong>00 250 1.047 75 3000<br />

giebigkeiten zu bestimmen. Die hierdurch entstandenen Werte<br />

bilden den zweiten Datensatz GEOM.<br />

In einem dritten Datensatz HYBR wird eine hybride Lösung<br />

aus jeweils gleich vielen Daten des RAND und des GEOM Datensatzes<br />

verfolgt. Motivation dafür ist, so eine diversere Datengrundlage<br />

zu schaffen und dadurch die Robustheit gegenüber<br />

Überanpassung zu erhöhen.<br />

Die Testdaten für die Regressionsanalyse stammen aus einer<br />

internen BECAL-Referenzdatenbank mit ca. 640.000 Tupel. Dieser<br />

Datensatz wird in drei Bereiche anhand der Krümmungsradien<br />

geteilt, da in diesem teils negative und sehr große Radien enthalten<br />

sind, welche im Training nicht vorkommen und deshalb<br />

gesondert betrachtet werden. Bereich I beinhaltet dabei 1,4 % der<br />

Daten während in Bereich III 3,8 % der Daten liegen. Die gewählten<br />

Grenzen sind:<br />

rr < 0 mm,<br />

I<br />

BB = { 0 < rr < 2000 mm, II .<br />

2000 mm > rr, III<br />

NETZWERKOPTIMIERUNG<br />

Die Zielgrößen bei dieser Regressionsanalyse sind ambivalent.<br />

Zum einen, weil eine möglichst gute Regression erfolgen soll,<br />

welche i.d.R. die Wahl eines Modells mit mehr freien Parametern<br />

begünstigt, zum anderen, weil die Berechnung der Einflusszahlen<br />

schnell erfolgen soll und somit kleine Modelle, mit entsprechend<br />

wenigen freien Parametern, zielführend sind. Folglich<br />

werden verschiedene Hyperparameter des Modells in einer Studie<br />

untersucht. Dabei werden KNN mit der in Tabelle 03 aufgeführten<br />

Anzahl an Neuronen in einer bzw. zwei verdeckten<br />

Schichten, sowie mit der Sigmoid-, Reclin- und Radbas-Aktivierungsfunktion<br />

trainiert. Die Variation findet vollfaktoriell statt.<br />

Während des Trainings werden drei KNN initialisiert und trainiert.<br />

Dabei wird die mittlere Bewertungsmetrik im Bereich II des<br />

www.<strong>antriebstechnik</strong>.de <strong>antriebstechnik</strong> <strong>2023</strong>/<strong>10</strong> 47