Einsichten - Ludwig-Maximilians-Universität München

Einsichten - Ludwig-Maximilians-Universität München

Einsichten - Ludwig-Maximilians-Universität München

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

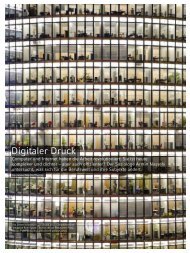

Die digitale Gesellschaft: Text und Terabyte<br />

nungsquoten von 95 bis 99,5 Prozent erreichen,<br />

mehr schaffen die Systeme nicht. Bei<br />

gut gedruckten, gut erhaltenen Texten in<br />

lateinischer Schrift können die Informatiker<br />

Das diakritische<br />

Zeichen, ein<br />

Fliegendreck<br />

die Fehlerraten bei Standardtexten ohne<br />

allzu viele seltene Wörter und bei optimaler<br />

Scan-Qualität auf weniger als 0,5 Prozent<br />

drücken. „Je klarer einzelne Schriftzeichen<br />

und Buchstaben voneinander getrennt sind,<br />

umso leichter kann der Computer die Zeichen<br />

automatisch scannen“, sagt Schütze.<br />

„Am leichtesten ist das lateinische Alphabet<br />

zu erfassen, schwer ist die Fraktur-Schrift,<br />

am schwierigsten die für Urdu, das in Pakistan<br />

gesprochen wird, verwendete Nastaliq-<br />

Schrift und viele indischen Schriften.“<br />

Doch selbst bei optimalen Bedingungen<br />

und lateinischer Schrift: Ein Restfehler wird<br />

wohl immer bleiben, man kann ihn nur<br />

minimieren. Um sämtliche Fehler zu eliminieren,<br />

müssen die OCR-Daten manuell von<br />

Altphilologen korrigiert werden. „Nachkorrigierte<br />

OCR-Texte sind im Übrigen besser<br />

als nur von Menschen erfasste Texte, denn<br />

auch Menschen machen Fehler“, betont<br />

Schütze. „Die Text-Erfassung bleibt jedenfalls<br />

ein überaus interessantes Forschungsfeld,<br />

auf dem sich aktuell viel tut.“<br />

Eine Fehlerrate des Computersystems von<br />

0,5 Prozent auf Buchstabenebene bedeutet<br />

immer noch, dass auf jeder digital erfassten<br />

Seite bis zu zehn Fehler wären. Also arbeiten<br />

die Forscher in <strong>München</strong> nun daran,<br />

Sprachmodelle für die jeweiligen speziellen<br />

Anwendungen zu entwickeln, die OCR-Verfahren<br />

immer dann ergänzen, wenn das System<br />

unsicher ist, etwa weil ein Wort selten<br />

ist oder es eine Wortendung nicht erkennt.<br />

Mithilfe neuronaler Netze lernen die Systeme,<br />

immer besser zu entscheiden. Im<br />

Lateinischen etwa machen die vielen möglichen<br />

Wortendungen Probleme. Schütze<br />

und sein Team wollen deshalb ein formales<br />

komputationelles Modell der lateinischen<br />

Morphologie erstellen, das eine beliebige<br />

Wortform sowohl erzeugen als auch grammatisch<br />

analysieren kann. „Hier sind wir in<br />

<strong>München</strong> Pioniere“, sagt Schütze. „Wir wollen<br />

das Tool der Welt zur Verfügung stellen,<br />

auch Greg Crane würde davon profitieren.“<br />

Bei jeder Sprache und jedem Schrifttyp gibt<br />

es solche speziellen Herausforderungen für<br />

die Informatiker. Die Leipziger Forscher<br />

etwa haben bei Altgriechisch Probleme mit<br />

den vielen sogenannten diakritischen Zeichen,<br />

die wichtig für die Betonung der<br />

Worte sind. „Die sind sehr klein und lassen<br />

sich deshalb oft nicht von Fliegendreck auf<br />

den Schriften unterscheiden“, sagt Schütze.<br />

Trotz aller Hindernisse finden die Computerverfahren<br />

zunehmend Akzeptanz unter Geisteswissenschaftlern,<br />

die Zahl der interdisziplinären<br />

Projekte wächst stetig. So gibt es<br />

ein Vorhaben am CIS gemeinsam mit Philosophen,<br />

um den Nachlass <strong>Ludwig</strong> Wittgensteins<br />

besser zugänglich zu machen und die<br />

Werke, auf die der Philosoph Bezug nimmt,<br />

in einer digitalen Bibliothek zu erfassen.<br />

Archäologen haben Interesse, Auswertungstools<br />

für ihre Datenbanken zu entwickeln.<br />

Mit den neuen Techniken werden sich nützliche<br />

Werkzeuge bereitstellen lassen, die<br />

Geisteswissenschaftler müssen nur damit zu<br />

arbeiten lernen. Idealerweise stellen die<br />

Informatiker ein leicht zu bedienendes professionelles<br />

Software-Produkt zur Verfügung.<br />

„Das aber ist in den Digital Humanities<br />

ein großes Problem, wir brauchen mehr<br />

professionelle Software-Entwickler, die gut<br />

bedienbare Schnittstellen für die Philologen<br />

entwerfen“, sagt Schütze. „Ohne solche<br />

Bedienoberflächen sinkt die Bereitschaft<br />

rapide, die neue Software zu nutzen.“<br />

Ein Altphilologe kann dann verschiedene<br />

Texte am Bildschirm nach bestimmten Fragestellungen<br />

durchsuchen oder eine bestimmte<br />

These prüfen und muss nicht mehr<br />

Tage in der Bibliothek verbringen, um die<br />

Texte nebeneinander zu sehen. Er kann<br />

bequem nach Personen suchen, nach historischen<br />

Begegnungen, nach unbewiesenen<br />

Vermutungen. Digitale Bibliotheken<br />

lassen auch eine größere Flexibilität zu als<br />

etwa traditionelle Zettelarchive wie der<br />

Thesaurus Linguae Latinae. Immer mehr<br />

Texte werden elektronisch verfügbar sein,<br />

auch kommentierende Literatur und Kommentare<br />

lassen sich verlinken.<br />

Auch die Informatiker profitieren, denn mit<br />

ihrem Fachwissen helfen die Altphilologen,<br />

die Fehlerrate der Verfahren immer weiter<br />

zu verringern. Schütze hofft insgesamt auf<br />

Effekte, wie es sie auch nach Beginn des<br />

Internetzeitalters gab: „Anfangs war im<br />

World Wide Web auch nichts zu lesen und<br />

zu sehen, was es vorher nicht bereits<br />

irgendwo gegeben hätte. Das Wesentliche<br />

der Revolution war, dass man plötzlich alle<br />

Informationen sofort finden konnte. Menschen<br />

sehen die Dinge, die vorher nicht<br />

offensichtlich sind, oft erst dann, wenn alle<br />

Puzzleteile auf dem Tisch liegen.“•<br />

Prof. Dr. Hinrich Schütze<br />

ist seit Anfang 2013 Lehrstuhlinhaber für Computerlinguistik<br />

und Leiter des Centrums für Informations- und<br />

Sprachverarbeitung (CIS) an der LMU. Schütze, Jahrgang<br />

1964, studierte an den <strong>Universität</strong>en Braunschweig und<br />

Stuttgart. 1995 promovierte er an der Stanford University,<br />

USA, und arbeitete anschließend am Xerox Palo Alto<br />

Research Center sowie bei Suchmaschinen- und Textmining-Firmen<br />

im Silicon Valley. 2004 wurde er Professor für<br />

Computerlinguistik an der <strong>Universität</strong> Stuttgart.<br />

Nummer 2 / 2013 <strong>Einsichten</strong> – Das Forschungsmagazin<br />

51