Einsichten - Ludwig-Maximilians-Universität München

Einsichten - Ludwig-Maximilians-Universität München

Einsichten - Ludwig-Maximilians-Universität München

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

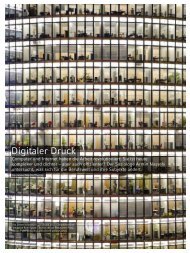

Die digitale Gesellschaft: Schürfen im digitalen Claim<br />

Am Anfang war die Scannerkasse.<br />

Mir ihr beginnt die Geschichte einer<br />

neuen Ära. Es ist das Zeitalter<br />

von Big Data, auch wenn damals, Ende<br />

der 1970er-Jahre, niemand die Entwicklung<br />

vorausgesagt hätte. Die neue Scanner-<br />

und Strichcode-Technik begann sich<br />

damals erst langsam durchzusetzen. Die<br />

Konsequenzen allerdings waren bemerkenswert,<br />

denn von diesem Zeitpunkt an<br />

konnten die Kassen erstmals den Inhalt<br />

von Warenkörben automatisch erfassen.<br />

Anonym natürlich, doch prinzipiell war damit<br />

sichtbar und auswertbar, welche Waren<br />

ein Kunde einkaufte. Der maschinell<br />

lesbare Strichcode, der 1973 in den USA<br />

und 1977 in Europa erstmals verwendet<br />

wurde, verknüpfte die Welt der Waren mit<br />

der digitalen Welt der Datenbanken, die Eigenschaften<br />

wie Preis oder Artikelbezeichnung<br />

enthielt. „Daraus ist das Gebiet des<br />

Data Mining entstanden“, sagt der Münchner<br />

Informatiker Hans-Peter Kriegel.<br />

Das Datensammeln hat also eine lange Tradition<br />

in den USA. „Bei den ersten Auswertungen<br />

damals fiel zum Beispiel auf, dass<br />

Kunden oft, wenn sie Windelpakete kauften,<br />

auch Bierkästen mitnahmen“, erzählt Kriegel,<br />

Inhaber des Lehrstuhls für Datenbanksysteme<br />

an der LMU. „Offenbar waren da<br />

die jungen Väter zum Großeinkauf unterwegs.“<br />

Die großen Supermarktketten reagierten<br />

darauf, sie begannen, Bierkästen in<br />

der Nähe von Windelregalen zu platzieren.<br />

Heute sendet fast jede Supermarktfiliale<br />

wöchentlich Daten an die Marktforschung.<br />

Damit sind wir mittendrin im Zeitalter von<br />

Big Data, wie Experten die Auswertung<br />

immer größerer Datenpakete nennen. Die<br />

stetig anschwellende Datenflut, die von<br />

automatischen Systemen erzeugt wird, ist<br />

mit normalen Daten-Management-Tools<br />

nicht mehr zu beherrschen. Das jährlich<br />

erzeugte Datenvolumen geht mittlerweile in<br />

die Zettabytes, das sind Billiarden Megabytes,<br />

eine Zahl mit 21 Nullen. „Seit einiger<br />

Zeit verdoppelt sich die jährliche Datenproduktion<br />

in weniger als zwei Jahren“, sagt<br />

Kriegel. „Das liegt an den automatisch aufnehmenden<br />

Geräten wie Scannerkassen<br />

oder Sensoren, an Erdbeobachtungssatelliten<br />

oder Gensequenzierungsautomaten.“<br />

Der Anstieg des Datenvolumens wird sich<br />

eher noch erhöhen, denn Daten werden<br />

zunehmend maschinell erzeugt und sind so<br />

auch leichter auswertbar. Praktisch alle<br />

Bereiche des Lebens sind davon betroffen.<br />

Protokolle von Telekommunikationsverbindungen<br />

oder Web-Zugriffen fallen genauso<br />

an wie Daten von Finanztransaktionen, Energieverbräuchen<br />

oder Patientenakten. Dazu<br />

kommen Aufnahmen von Überwachungskameras<br />

und Mikrofonen und die automatisch<br />

generierten und weitergeleiteten<br />

Werte von Sensoren und RFID-Funkchips.<br />

Eine dramatisch zunehmende Zahl von Sensoren<br />

etwa in Automobilen oder Industrieprozessen<br />

nehmen Messwerte im Dauerbetrieb<br />

auf und übertragen sie permanent per<br />

Funk. Die Geräte messen und kommunizieren<br />

den Standort, senden Bewegungsparameter,<br />

Vibration, Temperatur, Luftfeuchtigkeit,<br />

sogar chemische Veränderungen in der<br />

Umgebung. „Wir wissen nicht, was noch an<br />

Zettabytes,<br />

eine Zahl<br />

mit 21 Nullen<br />

Geräten kommen wird“, sagt Kriegel. „Das<br />

Internet ist natürlich ebenfalls eine Triebfeder.“<br />

Jede Suchanfrage bei Google, jeder<br />

Eintrag auf Facebook enthält möglicherweise<br />

verwertbare Informationen. Firmen<br />

und Geheimdienste haben längst die neue<br />

Währung „Daten“ erkannt, die digitale Revolution<br />

weckt Begehrlichkeiten allerorten.<br />

Daten sind aber nicht mehr nur in größerer<br />

Zahl verfügbar, Computer lernen, sie auch<br />

immer besser zu verstehen und auszuwerten.<br />

Noch bildet das Gros einen Datenfriedhof<br />

aus Wörtern, Bildern, Videos und endlosen<br />

Zahlenströmen – unstrukturierte<br />

Datensätze. Hier versuchen die Informatiker<br />

Strukturen zu erkennen. „Data Mining<br />

umfasst das Clustern von Daten, das Erkennen<br />

von Trends, aber auch von Ausreißern“,<br />

sagt Kriegel. „Dafür entwickeln wir Verfahren.<br />

Wir entwerfen Indexstrukturen, die die<br />

Datensuche unterstützen, und dazu passende<br />

Suchalgorithmen.“ Auch die Vorreiter<br />

der künstlichen Intelligenz erhoffen sich,<br />

dass Maschinen Sprache immer besser verstehen,<br />

Zusammenhänge erkennen und<br />

selbst lernen. Systeme wie Apples Siri sind<br />

dafür ein Indiz, ebenso die ständig perfekter<br />

funktionierende Suche etwa über Google<br />

Search nach Begriffen im Datenmeer.<br />

Mit den neuen Algorithmen und Verknüpfungsmöglichkeiten<br />

ergeben sich immer<br />

mehr Einsatzgebiete. Eine McKinsey-Studie<br />

hat vor zwei Jahren der Branche ein gewaltiges<br />

wirtschaftliches Potenzial bescheinigt,<br />

es geht um mögliche Einsparungen im<br />

mehrstelligen Milliardenbereich im Gesundheitssektor,<br />

in der öffentlichen Verwaltung<br />

oder im Mobilfunkbereich. Internetfirmen,<br />

die stetig an Einfluss gewinnen, wie Google<br />

oder Facebook analysieren, kontrollieren<br />

und werten etwa vom Silicon Valley aus die<br />

Daten des weltweiten Netzes aus. Unternehmen<br />

wollen früh neue Trends erkennen, um<br />

neue Produkte anzubieten. Forscher wie der<br />

Harvard-Wissenschaftler Gary King sagen:<br />

„Es wird keinen Bereich geben, der davon<br />

nicht berührt wird.“ Auch Kriegel bestätigt<br />

das, „die McKinsey-Studie war ein Katalysator.“<br />

In Europa starteten große Programme,<br />

und auch Unternehmen stiegen<br />

ein. McKinsey sagt schon einen Mangel an<br />

Fachkräften voraus. Um dem steigenden<br />

Bedarf zu entsprechen, „planen auch wir<br />

einen englischsprachigen Masterstudiengang<br />

zu Data Science. Für Europa ist dieser<br />

Studiengang neu“, berichtet Kriegel.<br />

Informatikern wie Hans-Peter Kriegel ist klar,<br />

dass sich die Daten und neue technische<br />

Entwicklungen für sehr verschiedene Zwecke<br />

nutzen lassen. Für Unternehmen bietet<br />

Nummer 2 / 2013 <strong>Einsichten</strong> – Das Forschungsmagazin<br />

53