2 - SAM - ETH Zürich

2 - SAM - ETH Zürich

2 - SAM - ETH Zürich

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

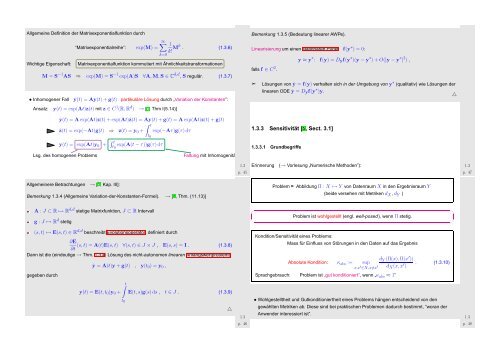

Allgemeine Definition der Matrixexponentialfunktion durch<br />

Wichtige Eigenschaft:<br />

∞∑ 1<br />

“Matrixexponentialreihe”: exp(M) =<br />

k! Mk . (1.3.6)<br />

k=0<br />

Matrixexponentialfunktion kommutiert mit Ähnlichkeitstransformationen<br />

M = S −1 AS ⇒ exp(M) = S −1 exp(A)S ∀A,M,S ∈ C d,d , S regulär. (1.3.7)<br />

• Inhomogener Fall<br />

Ansatz:<br />

ẏ(t) = Ay(t) + g(t) partikuläre Lösung durch ”<br />

Variation der Konstanten”:<br />

y(t) = exp(At)z(t) mit z ∈ C 1 (R, R d ) → [1, Thm I(5.14)]<br />

ẏ(t) = A exp(At)z(t) + exp(At)ż(t) = Ay(t) + g(t) = A exp(At)z(t) + g(t)<br />

∫ t<br />

ż(t) = exp(−At)g(t) ⇒ z(t) = y 0 + exp(−Aτ)g(τ) dτ<br />

t 0<br />

y(t) = exp(At)y 0 + ∫ t<br />

t0<br />

exp(A(t − τ))g(τ) dτ<br />

Lsg. des homogenen Problems<br />

Faltung mit Inhomogenität<br />

Bemerkung 1.3.5 (Bedeutung linearer AWPe).<br />

Linearisierung um einen stationären Punkt f(y ∗ ) = 0:<br />

y ≈ y ∗ : f(y) = D y f(y ∗ )(y − y ∗ ) + O(|y − y ∗ | 2 ) ,<br />

falls f ∈ C 2 .<br />

➣ Lösungen von ẏ = f(y) verhalten sich in der Umgebung von y ∗ (qualitativ) wie Lösungen der<br />

linearen ODE ẏ = D y f(y ∗ )y.<br />

△<br />

1.3.3 Sensitivität [5, Sect. 3.1]<br />

1.3.3.1 Grundbegriffe<br />

1.3<br />

p. 45<br />

Erinnerung<br />

(→ Vorlesung ”<br />

Numerische Methoden”):<br />

1.3<br />

p. 47<br />

Allgemeinere Betrachtungen<br />

→ [1, Kap. III]:<br />

Bemerkung 1.3.4 (Allgemeine Variation-der-Konstanten-Formel). → [1, Thm. (11.13)]<br />

Problem = Abbildung Π : X ↦→ Y von Datenraum X in den Ergebnisraum Y<br />

(beide versehen mit Metriken d X , d Y )<br />

A : J ⊂ R ↦→ R d,d stetige Matrixfunktion, J ⊂ R Intervall<br />

g : J ↦→ R d stetig<br />

✗<br />

✖<br />

Problem ist wohlgestellt (engl. well-posed), wenn Π stetig.<br />

✔<br />

✕<br />

(s, t) ↦→ E(s, t) ∈ R d,d beschreibt Evolutionsoperator, definiert durch<br />

∂E<br />

(s, t) = A(t)E(s, t) ∀(s, t) ∈ J × J , E(s, s) = I . (1.3.8)<br />

∂t<br />

Dann ist die (eindeutige → Thm. 1.3.4) Lösung des nicht-autonomen linearen Anfangswertproblems<br />

gegeben durch<br />

ẏ = A(t)y + g(t) , y(t 0 ) = y 0 ,<br />

Kondition/Sensitivität eines Problems:<br />

Mass für Einfluss von Störungen in den Daten auf das Ergebnis<br />

d<br />

Absolute Kondition: κ abs := sup Y (Π(x), Π(x ′ ))<br />

x,x ′ ∈X,x≠x ′ d X (x,x ′ . (1.3.10)<br />

)<br />

Sprachgebrauch: Problem ist ”<br />

gut konditioniert”, wenn ”<br />

κ abs ≈ 1”<br />

∫t<br />

y(t) = E(t, t 0 )y 0 +<br />

t 0<br />

E(t, s)g(s) ds , t ∈ J . (1.3.9)<br />

△<br />

1.3<br />

p. 46<br />

• Wohlgestelltheit und Gutkonditioniertheit eines Problems hängen entscheidend von den<br />

gewählten Metriken ab. Diese sind bei praktischen Problemen dadurch bestimmt, “woran der<br />

Anwender interessiert ist”.<br />

1.3<br />

p. 48