2 - SAM - ETH Zürich

2 - SAM - ETH Zürich

2 - SAM - ETH Zürich

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

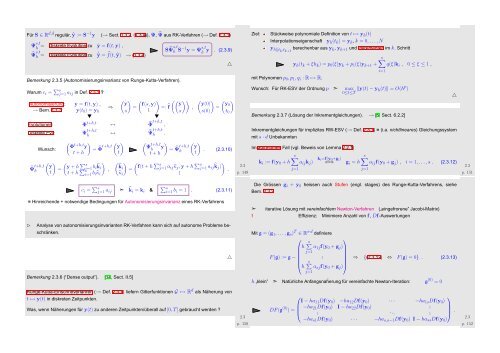

Für S ∈ R d,d regulär, ŷ := S −1 y (→ Sect. 1.3.2, (1.3.4)), Ψ, ̂Ψ aus RK-Verfahren (→ Def. 2.3.1)<br />

Ψ s,t<br />

h = Diskrete Evolution zu ẏ = f(t,y) ,<br />

̂Ψ s,t<br />

ŜΨ s,t<br />

h S −1 y = Ψ s,t<br />

h<br />

h = Diskrete Evolution zu ˙ŷ = ̂f(t,ŷ) y . (2.3.9)<br />

→ (1.3.4)<br />

Bemerkung 2.3.5 (Autonomisierungsinvarianz von Runge-Kutta-Verfahren).<br />

Warum c i = ∑ s<br />

j=1 a ij in Def. 2.3.1 ?<br />

Autonomisierung:<br />

→ Bem. 1.1.3<br />

ẏ = f(t,y) ,<br />

y(t 0 ) = y 0<br />

▼<br />

⇒<br />

( y ˙<br />

=<br />

s)<br />

(<br />

f(s,y)<br />

1<br />

▼<br />

)<br />

=: ̂f<br />

Evolutionen: Φ t+h,t ↔ ̂Φt+h,t ,<br />

Diskrete Evl.: Ψ t+h,t<br />

h ↔ ̂Ψt+h,t h .<br />

Wunsch:<br />

(<br />

Φ t+h,t )<br />

y<br />

) ( )<br />

=<br />

t + h<br />

y<br />

t+h,t Ψ h y<br />

t t + h<br />

( (<br />

̂Ψ t+h,t<br />

∑ y<br />

h = y + h si=1<br />

)<br />

b îki<br />

t)<br />

t + h ∑ s ,<br />

i=1 b îκ i<br />

(( y<br />

,<br />

s))<br />

=<br />

△<br />

( ) ( ) y(0) y0<br />

= .<br />

s(0) t 0<br />

(<br />

t+h,t y ̂Ψ h . (2.3.10)<br />

t)<br />

) ( ∑ (̂ki f(t + h sj=1<br />

a<br />

=<br />

iĵκ j ,y + h ∑ )<br />

s<br />

j=1 a iĵkj )<br />

.<br />

̂κ i 1<br />

2.3<br />

p. 149<br />

Ziel:<br />

Stückweise polynomiale Definition von t ↦→ y h (t)<br />

Interpolationseigenschaft y h (t k ) = y k , k = 0, ...,N<br />

y h|[tk ,t berechenbar aus k+1<br />

y k , y k+1 und Inkrementen im k. Schritt<br />

mit Polynomen p 0 ,p 1 , q i : R ↦→ R.<br />

y h (t k + ξh k ) = p 0 (ξ)y k + p 1 (ξ)y k+1 +<br />

Wunsch: Für RK-ESV der Ordnung p ➣<br />

s∑<br />

q(ξ)k i , 0 ≤ ξ ≤ 1 ,<br />

i=1<br />

max ‖y(t) − y h(t)‖ = O(h p )<br />

0≤t≤T<br />

Bemerkung 2.3.7 (Lösung der Inkrementgleichungen). → [5, Sect. 6.2.2]<br />

Inkrementgleichungen für implizites RW-ESV (→ Def. 2.3.1) = (i.a. nichtlineares) Gleichungssystem<br />

mit s · d Unbekannten<br />

Im autonomen Fall (vgl. Beweis von Lemma 2.2.1)<br />

k i := f(y 0 + h<br />

s∑<br />

a ij k j )<br />

j=1<br />

k i =f(y 0 +g i )<br />

⇐⇒<br />

g i = h<br />

s∑<br />

a ij f(y 0 + g j ) , i = 1, ...,s . (2.3.12)<br />

j=1<br />

△<br />

2.3<br />

p. 151<br />

c i = ∑ s<br />

j=1 a ij ➣ ̂k i = k i &<br />

∑ si=1<br />

b i = 1 . (2.3.11)<br />

Die Grössen g i + y 0 heissen auch Stufen (engl. stages) des Runge-Kutta-Verfahrens, siehe<br />

Bem. 2.3.2<br />

= Hinreichende + notwendige Bedingungen für Autonomisierungsinvarianz eines RK-Verfahrens<br />

✄<br />

Analyse von autonomisierungsinvarianten RK-Verfahren kann sich auf autonome Probleme beschränken.<br />

Bemerkung 2.3.6 (“Dense output”).<br />

[14, Sect. II.5]<br />

Runge-Kutta-Einschrittverfahren (→ Def. 2.3.1) liefern Gitterfunktionen G ↦→ R d als Näherung von<br />

t ↦→ y(t) in diskreten Zeitpunkten.<br />

Was, wenn Näherungen für y(t) zu anderen Zeitpunkten/überall auf [0,T] gebraucht werden ?<br />

△<br />

2.3<br />

p. 150<br />

➣ iterative Lösung mit vereinfachtem Newton-Verfahren ( ”<br />

eingefrorene” Jacobi-Matrix)<br />

! Effizienz: Minimiere Anzahl von f, Df-Auswertungen<br />

Mit g = (g 1 , ...,g s ) T ∈ R s·d definiere<br />

⎛<br />

h s ⎞<br />

∑<br />

a 1j f(y 0 + g j )<br />

j=1<br />

F(g) := g −<br />

.<br />

⎜<br />

⎝ ∑<br />

h s ⎟<br />

a sj f(y 0 + g j )<br />

⎠<br />

j=1<br />

⇒ {(2.3.12) ⇔ F(g) = 0} . (2.3.13)<br />

h ”<br />

klein” ➣ Natürliche Anfangsnaḧerung für vereinfachte Newton-Iteration: g (0) = 0<br />

⎛<br />

⎞<br />

I − ha 11 Df(y 0 ) −ha 12 Df(y 0 ) · · · −ha 1s Df(y 0 )<br />

DF(g (0) ) = ⎜ −ha 21 Df(y 0 ) I − ha 22 Df(y 0 ) .<br />

⎟<br />

⎝ . . .. . ⎠ . 2.3<br />

−ha s1 Df(y 0 ) · · · −ha s,s−1 Df(y 0 ) I − ha ss Df(y 0 )<br />

p. 152