Virtual Reality - Staatliche Hochschule für Gestaltung Karlsruhe

Virtual Reality - Staatliche Hochschule für Gestaltung Karlsruhe

Virtual Reality - Staatliche Hochschule für Gestaltung Karlsruhe

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

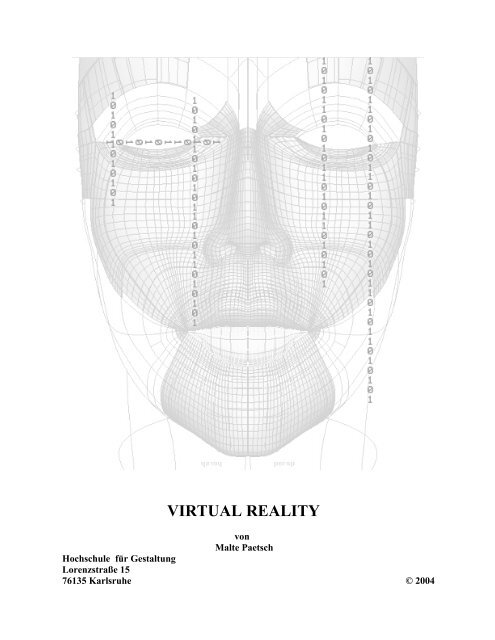

VIRTUAL REALITY<br />

von<br />

Malte Paetsch<br />

<strong>Hochschule</strong> <strong>für</strong> <strong>Gestaltung</strong><br />

Lorenzstraße 15<br />

76135 <strong>Karlsruhe</strong> © 2004

1. Definition der Virtuellen Realität<br />

2. Projektionen-Kommunikation<br />

2a. Beispiel: Habitat<br />

Inhaltverzeichniß<br />

3. Projektion-Wissenschaft<br />

3a. Beispiel: Numerische Berechnungsverfahren<br />

4. Projektion-Unterhaltung<br />

5. Kommunikation mit der virtuellen Realität / Techniken des Daten- in/outputs<br />

6. Der Wunsch der Schöpfung / der Geist in der Maschine<br />

7. Grundgedanken der VR / Gefahren / Droge der Zukunft<br />

a. Bioadapter:<br />

b. Cyberpunk:<br />

8. Pioniere der <strong>Virtual</strong> <strong>Reality</strong>:<br />

a. Jaron Lanier<br />

b. Ivan Sutherland<br />

c. Scott S. Fischer:<br />

9. Verschiedene Arten von VR Systemen:<br />

a. Desktop VR Systeme<br />

b. Video Mapping<br />

c. Immersive Systeme<br />

d. Telepräsenz<br />

e. Mixed <strong>Reality</strong><br />

f. Fish Tank VR<br />

10. Drei Stufen von <strong>Virtual</strong> <strong>Reality</strong> (VR) können unterschieden werden<br />

a. Passiven Ebene<br />

b. Aktiven Ebene<br />

c. Interaktiven Ebene<br />

10a. Zusatz<br />

a. Spaceball<br />

b. 3-D-Maus<br />

c. Datenhandschuh<br />

11. Zu den wichtigsten Ausgabe- oder Darstellungsgeräten von VR Systemen zählen<br />

a. 3-D-Ton- und Musikausgabe:<br />

b. Stereodarstellung:<br />

c. Head Mounted Display:<br />

d. Verarbeitung haptischer Informationen:

12. Werkzeuge zur Visualisierung<br />

12a. 1.Stereoskopische Helme:<br />

a. die Shutterbrille:<br />

b. Sichtgeräte der NASA<br />

c. UNC-Monitor:<br />

d. Eyephone von VPL:<br />

e. CAE-faseroptisches System:<br />

f. Die Cave Automatic <strong>Virtual</strong> Environment (CAVE)<br />

2. Monukolare Systeme:<br />

a. Das Privat Eye<br />

3. Freie Monitore:<br />

a. Sutherlands Damoklesschwert<br />

b. BOOM (Binukolar Omni Orientation Monitor) :<br />

13. Wichtige Punkte zur Verstärkung der Immersion<br />

a. Das Gesichtsfeld:<br />

b. Die Bildwechselrate:<br />

c. Blickortung:<br />

14. Räumliche Ortung / Tracking<br />

a. Mechanische Ortung<br />

b. Magnetische Ortung<br />

c. Ultraschall-Ortung<br />

d. Optische Ortung<br />

e. Ortung durch Bildauszug<br />

15. Haptische Systeme<br />

1. Die Mechanorezeptoren<br />

2. Die Propriozeptoren<br />

15a. Kraftrückkoplungsgeräte:<br />

a. Der ARM<br />

b. Das TeleTact - Rückkoplungssystem<br />

c. Der Portable Dextrous Master<br />

d. Das Tini Alloy Rückkopplungsystem<br />

16. Akustische Richtungsbestimmung / virtueller Sound<br />

a. Interauraler Zeitunterschied<br />

b. Interaurale Lautstärke<br />

c Schallschatten<br />

d. Echoortung

17. 3D -Ton / Virtueller Klang<br />

1. System<br />

2.System<br />

18. Werkzeuge zur Eingabe<br />

a. Tastaturen<br />

b. 2-D-Maus<br />

c. 2-D-/6-D- Maus<br />

d. Der Spaceball<br />

e. Datenhandschuh<br />

f. Der DataGlove<br />

g. Der PowerGlove<br />

h. Körpereingabe<br />

19. Künstler /künstlerische Anwendungen der VR: Pioniere der VR-Kunst<br />

a. Nicole Stenger<br />

b. Matt Mullican<br />

19b. Home of the brain (1991/92)<br />

19c. Perceptual Arena (1993)<br />

19d. Dancing with the <strong>Virtual</strong> Dervish <strong>Virtual</strong> Bodies (1994)<br />

20. Künstlerische CAVE Anwendungen<br />

a. Crayoland (1995)<br />

b. Inside out (1999)<br />

c. PAAPAB (2000)<br />

d. Citycluster (2002)<br />

e. Auqaricon (2001)<br />

21. Anmerkung<br />

22. Anhang<br />

23. Quellen

<strong>Virtual</strong> <strong>Reality</strong><br />

Referat von Malte Paetsch<br />

1. Definition der Virtuellen Realität<br />

Vor knapp 200 Jahren definierte der Philosoph Friedrich Bouterwek die Realität als lebendige<br />

Kraft. Weil eine Kraft aber immer eine Gegenkraft braucht, um mit ihr in ein gegenseitiges<br />

Verhältnis treten zu können, und die Realität sich nicht selbst entgegensetzen kann, definiert<br />

Bouterwek diese Gegenkraft als <strong>Virtual</strong>ität. Bei dieser Denkweise, der miteinander ringenden<br />

Kräfte, kam Bouterwek zu der Erkenntnis, daß die Wirklichkeit nicht als statische Gegebenheit<br />

zu betrachten sein sollte.<br />

Mit der modernen Physik des frühen 20. Jahrhunderts, also mit der Relativitäts- und Quantentheorie<br />

und der nichtlinearen Dynamik, beschreibt man die <strong>Virtual</strong>ität als einen vorübergehenden<br />

Zustand. Man könnte sagen, als einen fünften Aggregatzustand.<br />

Ein physikalisches System (die <strong>Virtual</strong>ität) wird nun mit physikalischen Mitteln (einer alles berechnenden<br />

Maschine) geschaffen. <strong>Virtual</strong>ität ist also kein übergreifendes Verhältnis, wie bei<br />

Bouterwek, sondern ein aus berechneten Bausteinen bestehendes System, daß von der Wirklichkeit<br />

getrennt gehalten werden sollte.<br />

Der Begriff "Virtuelle Realität" verbindet aber diese getrennt zu haltenden Aspekte wieder.<br />

Daraus läßt sich schließen, daß in der virtuellen Realität die Wirklichkeit in den Zustand der<br />

<strong>Virtual</strong>ität übergeht. Für einen Gegenstand ist diese Denkweise noch gut nachvollziehbar.<br />

Seine Form, Farbe und materielle Eigenschaften werden in die <strong>Virtual</strong>ität übertragen und dort<br />

ebenso abgebildet. Versucht man aber sein eigenes Ich / Denkmuster in die <strong>Virtual</strong>ität zu<br />

spiegeln, ergibt sich die Vorstellung von geklonter Intelligenz, die nun in der virtuellen Realität<br />

weiter lebt.<br />

Dirk Vaihinger :<br />

"<strong>Virtual</strong>ität ist die Objektwelt, die verspricht Wirklichkeit zu sein, ohne es zu müssen." 1<br />

Von der technischen Seite her betrachtet ist VR eine Mensch-Maschine-Schnittstelle, also ein<br />

Interface ähnlich einer Mouse oder Tastatur. Sie ermöglicht dem Benutzer den optimalsten Informationsaustausch<br />

und die bestmöglichsten Steuerung der Maschine. Ziel der Nutzung von VR als<br />

Interface ist die Verbesserung der Wirksamkeit und Wirkungskraft des Benutzers.<br />

Man kann aber nicht einfach nur von einer Schnittstelle zwischen Mensch und Maschine<br />

sprechen, denn der Benutzer ist aktiver Teil der generierten Welt. Für ihn ist VR eine dreidimensionale<br />

Simulation, in die er alles gewünschte hinein projizieren kann und dadurch einen<br />

größeren Handlungsfreiraum und Möglichkeiten als in der realen Welt erhält.Man kann die virtuelle<br />

Realität in drei Arten gliedern. In der passiven VR erhält der Benutzer nur Einsicht<br />

(und "Einfühl") und kann in keiner Weise agieren. Bei der aktiven VR kann der Beobachter sich<br />

frei nach den Gegebenheiten der jeweiligen künstlichen Welt bewegen und umschauen.<br />

Er hat die Möglichkeit, Gegenstände genauer zu betrachten oder sich um sie herum zu bewegen.<br />

Diese Gegenstände verschieben oder mit anderen Benutzern der künstlichen Welt zu kommunizieren<br />

ist in der interaktiven VR möglich. Hier sind quasi alle Freiheiten der "wahren" Realität<br />

vorhanden und, je nach Beschaffenheit der virtuellen Welt, auch darüber hinaus.<br />

1 Holger Krapp, Künstliche Paradiese-Virtuelle Realitäten, Seite 23, München 1997

Die virtuelle Realität ist nicht materiell existent, das heißt man kann sie nur mit entsprechenden<br />

Hilfsmitteln sehen, anfassen oder betreten. Die Qualität, mit der sie die künstlichen Welt darstellen,<br />

läßt sich anhand der Immersion und Interaktion messen und beschreiben. Unter<br />

Immersion versteht man den Grad der Wahrnehmung des Benutzer, der die künstliche Umwelt<br />

erlebt. Das heißt: Wie echt sind die Sinneseindrücke ?<br />

Ein Bild das nur mit eine Farbtiefe von 256 Farben dargestellt wird, hat eine deutlich niedrigere<br />

Immersion, als das Selbige mit 16 Millionen Farben. Die Interaktion umschreibt die Möglichkeiten<br />

des Benutzers auf die künstliche Umgebung, möglichst in Echtzeit<br />

("What you see - is what you get"/Das Prinzip der der direkten Manipulation), einzuwirken.<br />

Zum Beispiel bei einem Film im Fernsehen kann man nichts wesentliches beeinflussen. Bei<br />

einem Film der von einem Videorekorder abgespielt wird, läßt sich die Wiedergabegeschwindigkeit<br />

einstellen und man kann zumindest vorspulen!<br />

Für die künstlichen Welt bedeutet das -- je höher die Immersion und je höher die Interaktivität -desto<br />

näher befindet sie sich an der Virtuellen Realität. Immersion und Interaktion sind nicht<br />

unabhängig voneinander. So erhöht eine natürliche Steuerung (Interaktion) die psychische<br />

Eingebundenheit (Immersion). Wenn man also in einem Immersion-Interaktivität-Diagramm auf<br />

den Punkt der höchstmöglichen Immersion und Interaktivität schaut, kann man dort die Virtuelle<br />

Realität (und Realität!) einzeichnen.<br />

Howard Rheingold:<br />

"Stellen wir uns ein Bildsystem vor, das uns völlig umschließt und dreidimensionale Bilder erzeugt,<br />

mit scheinbar vorhandenen Objekten, die wir anfassen und manipulieren sowie mit Händen<br />

und Fingern spüren. können. Stellen wir uns weiter vor, wir würden in diese künstliche Welt<br />

eintauchen und sie aktiv durchstreifen, statt sie nur von einem festem Standpunkt aus auf einer<br />

flachen Leinwand, einem Fernsehschirm oder Computerdisplay anzustarren. Denken wir uns,<br />

wir wären zugleich die Schöpfer und die Konsumenten unserer künstlichen Erfahrungen. Wir<br />

selbst können die Welt, die wir sehen, hören und fühlen, mittels einer Geste oder eines Wortes<br />

umgestalten..." 2<br />

2 (Quelle: H.Rheingold, Virtuelle Welten. Reisen im Cyberspace. Reinbeck bei Hamburg 1995, S.15)

Man kann also sagen: Die <strong>Virtual</strong>ität umschreibt den Zustand, in dem sich ein Objekt oder eine<br />

Person befindet. Die Virtuelle Realität ist der "Ort". Verbindet man einen virtuellen "Ort" mit<br />

vielen Anderen, entsteht ein Netzwerk aus virtuellen "Orten". Zwischen diesen verknüpften<br />

Welten können nun Informationen ausgetauscht werden. Es entsteht eine riesige Kommunikationsplattform,<br />

die man als “Cyberspace“ bezeichnet. Der Cyberspace ist also ein Netzwerk aus<br />

virtuellen Realitäten, in dem sich die Benutzer treffen und Daten austauschen können.<br />

2. Projektionen-Kommunikation<br />

Grundlage <strong>für</strong> eine Kommunikation ist das Vorhandensein einer Verbindung zwischen den<br />

Kommunikationspartnern. Für die <strong>Virtual</strong>ität bedeutet das Cyberspace. In den Cyberspace wird<br />

eine Kommunikationsplattform hineinprojiziert, die je nach technischen Gegebenheiten völlig<br />

unterschiedliche Funktionalitäten besitzen kann. Weit verbreitet sind zum Beispiel Chaträume,<br />

die ausschlieslich auf Textkommunikation beruhen. Hier ist das Interface zwischem<br />

dem Benutzer und dem Cyberspace ein Computer, der die Eingabe und Ausgabe von geschriebener<br />

Sprache ermöglicht und mit anderen Computern vernetzt ist. In diese Chaträume wird nun<br />

jeder einzelne Teilnehmer ebenfalls projiziert, um <strong>für</strong> die anderen Benutzer sichtbar zu sein. Das<br />

heißt, man benötigt vorerst eine Oberfläche oder Umgebung, in der sich die Kommunikationspartner<br />

treffen können. Da diese Umgebung kein wirklich vorhandener Raum ist, muß sie erst in<br />

der <strong>Virtual</strong>ität geschaffen werden.<br />

Der Benutzer wird in der <strong>Virtual</strong>ität durch einen Avatar, eine Art Icon, vertreten.<br />

Unter einem Avatar versteht man einen Repräsentanten dieser Person. Einen Avatar benötigt man<br />

um sich in einer virtuellen Welt bewegen und interagieren zu können. Die meisten Avatare werden<br />

durch ein einfaches Bild (meistens wird nur der Kopf der Person gewählt) und eine Beschreibung<br />

der Person (Charakteristiken, Hobbies, usw.) dargestellt. In manchen virtuellen Welten wird<br />

der Avatar durch eine komplexe dreidimensionale Person repräsentiert. Hierzu wird allerdings ein<br />

leistungsfähiger Rechner und ein schneller Netzzugang benötigt.<br />

2a. Habitat<br />

Habitat wurde 1984 <strong>für</strong> den C64 entwickelt, und kam aufgrund seiner reduzierten Grafik mit der<br />

sensationellen Bandbreite von 300 Baud aus. Es gilt als das erste grafische Echtzeit-Kommunikationssystem.<br />

Habitats Welten sehen aus wie Zeichentrickfilme oder Jump&Run-Videospiele.<br />

Belebt werden diese Welten von animierten Figuren, die von ihren Benutzern vor gemalten Hintergründen<br />

gesteuert werden. Die Steuerung erfolgt per Kommando-Eingabe<br />

über die Tastatur, sehr ähnlich den ersten grafischen Adventure Games, aber eben Online, also<br />

vernetzt mit der Absicht, in diesem System zu kommunizieren. Die Benutzer bilden sich ab, sie<br />

hinterlassen Spuren, sie erkennen sich und andere wieder, und instinktiv werden Begriffe wie<br />

Besitz und Verantwortung projiziert.<br />

Habitat (wie auch die LambdaMOO) haben eigene Gesetze, Benimmregeln, Ordnungshüter und<br />

eine Art basisdemokratisches Rechtssystem. Gleichzeitig haben die Entwickler von Habitat auch<br />

den nötigen Humor bewiesen, den man benötigt, wenn man keine digitale Schrebergartensiedlung<br />

produzieren möchte. Das beliebteste Sammlerstück in Habitat ist der Kopf eines anderen<br />

Benutzers. 3<br />

3 Ole Lütjens, „Habitat->WorldsAway+Club Caribe“, in: Rendezvous im Drahtrahmengarten,<br />

http://www.scara.com/~ole/projects/Habitat.html, 04.11.2004

World Chat ist ein Online-Dienst, der von Worlds Inc. mit Unterstützung von IBM, Steven Spielberg<br />

und Visa den Internetbenutzern zur Verfügung gestellt wird. Das Konzept hinter der Applikation<br />

basiert auf einer Raumstation. Die Benutzer müssen sich, bevor sie sich verbinden können,<br />

einen zweidimensionalen Avatar auswählen. Sie geben sich einen Namen, der auf den Köpfen<br />

ihrer Avatare zu sehen ist.Navigiert wird mit der Tastatur und die Kommunikation findet durch<br />

Eintippen des Textes statt. Durch Anklicken eines anderen Benutzers sind auch private Unterhaltungen<br />

möglich. Man kann das Szenario als visualisiertes Multi-User-Dungeon bezeichnen; der<br />

Unterschied zu MUDs ist jedoch, das es keine Hintergrundgeschichte in dieser Welt gibt. Es ist<br />

eigentlich nichts weiter als ein optischer Chatraum.<br />

Alphaworld basiert auf dem Idee von World Chat, jedoch steckt hier ein Konzept dahinter.<br />

Das Ziel bei Alphaworld ist es, "Cyberground" zu errichten. Die Benutzer haben die Aufgabe,<br />

sich ihr eigenes Besitztum aufzubauen.<br />

Alphaworld basiert auf VRML+, einer Weiterentwicklung von VRML. 4<br />

Activeworlds, http://www.activeworlds.com/<br />

The Palace.com, http://thepalace.com<br />

3. Projektion-Wissenschaft<br />

In vielen Gebieten der Wissenschaft, Design und Industrie kommt die <strong>Virtual</strong>ität zum Einsatz.<br />

So lassen sich Autoprototypen, Anatomie des Menschen, Möbel und Architektur, Geographie<br />

und Wetter, Lehrmittel, Landkarten sowie komplexe physikalische oder chemische Prozesse in<br />

die <strong>Virtual</strong>ität projizieren. Die so vorhanden Informationen lassen sich aus beliebigen Perspektiven<br />

betrachten oder bearbeiten. Man kann Daten überlagen und vergleichen und und so Statistiken<br />

erstellen, zum Beispiel die Veränderung des Klimas im Verlauf von 100 Jahren. Es ist durch<br />

den Einsatz der Telepräsenz möglich, chirurgische Eingriffe aus großer Entfernung durchzuführen.<br />

Der Arzt überträgt die Bewegung seiner Hände in die <strong>Virtual</strong>ität, dort wird sie zum Ort des<br />

Patienten weitergeleitet und von einem Roboterarm ausgeführt. Die Bewegung des<br />

Armes wird sozusagen über den Cyberspace auf den künstlichen Arm projiziert.<br />

Eine ähnliche Übertragungsweise könnte/kann auch das Militär nutzen, z.B. indem ein Pilot in<br />

einem Simulator sitz und ein virtuelles Flugzeug steuert. Dessen Flugdaten werden auf ein reales<br />

Flugzeug übertragen und der Pilot geht <strong>für</strong> sich keinerlei Risiko ein. Nützlich wäre ein derartige<br />

Steuerung auch bei Forschungsarbeiten (z.B. Flug durch eine Gewitterwolke).<br />

In der Designindustrie wird bereits die dreidimensionale Darstellungsweise genutzt. Hier wird<br />

zum Beispiel ein Auto am Computer entworfen und in eine 3-D-Umgebung projeziert. Nun kann<br />

der Entwickler oder Betrachter in die 3-D-Umgebung eintreten und das Objekt genau studieren<br />

und verändern. Diese Produktionsweise ist sehr Kosten sparend und die Entwickler können<br />

etwaige Design- oder Sicherheitsmängel frühzeitig entdecken.<br />

4 „Home of the 3D Chat, <strong>Virtual</strong> <strong>Reality</strong> Building Platform“, in: activeworlds, http://www.activeworlds.com/,<br />

05.11.0 4

3a. Beispiel:<br />

Numerische Berechnungsverfahren zur Vorhersage des Crashverhaltens einer Fahrzeugkarosserie<br />

haben im Laufe der letzten Jahre sowohl in ihrer Komplexität als auch in der Prognosesicherheit<br />

ihrer Ergebnisse zugenommen. Im Fall der Crashberechnung lassen sich die traditionellen Methoden<br />

des Postprozessing durch den Einsatz von Techniken der virtuellen Realität signifikant<br />

verbessern. In einem "Virtuellen Crash Labor" besteht die hauptsächliche Zielsetzung darin, die<br />

Kommunikation innerhalb des Entwicklungsteames zu vereinfachen sowie ein schnelleres Problemverständnis<br />

zu ermöglichen.<br />

Der Einsatz von sogenannten Finite Elemente-Berechnungsmethoden in der Fahrzeugentwicklung<br />

soll möglichst frühzeitige Aussagen zum Crashverhalten und den Gesamtfahrzeugeigenschaften<br />

im Bereich der passiven Sicherheit ermöglichen und zugleich die Aufwände <strong>für</strong> reale Versuchsträger<br />

minimieren. Zur Ermittlung und Optimierung des Crashverhaltens und der Gesamtfahrzeugeigenschaften<br />

im Bereich der passiven Sicherheit kommt bei der BMW AG u.a. das FEM<br />

Paket PAM-CRASH zum Einsatz. Die großen numerischen Ergebnisse führen zu FE-Modellen,<br />

die im allgemeinen aus bis zu 400.000 Elementen bestehen. Der Crashvorgang selbst wird unterteilt<br />

in bis zu 60 Zeitschritte.<br />

Um diese riesigen Datenmengen optimal zu nutzen bedarf es ebenfalls eines VR-Systemes.<br />

Auf Basis der Geometriedaten sowie der berechneten physikalischen Größen wie Spannungen,<br />

Verschiebungen, Beschleunigungen und Kräfte wird eine Echtzeitanimation des Fahrzeugverhaltens<br />

im Zusammenspiel mit Insassen, Airbag, Rückhaltesystemen und anderen Komponenten<br />

<strong>für</strong> unterschiedliche Lastfälle wie etwa Frontal- oder Seitenaufprall projiziert. Der Benutzer kann<br />

sich in diese virtuelle Umgebung hineinbegeben, eine beliebige Betrachterposition innerhalb oder<br />

außerhalb des Fahrzeugs einnehmen, die Animation direkt kontrollieren und mit beliebigen Fahrzeugkomponenten<br />

interagieren. Das <strong>Virtual</strong> Crashtesting Environment ist eine <strong>für</strong> den Anwender<br />

immersive Umgebung. Als Interaktionsgeräte können ein Fakespace BOOM 3C und ein<br />

CyberGlove verwendet werden, alternativ stehen eine Großbildprojektion und eine 3-D Maus zur<br />

Verfügung. Der zeitliche Ablauf des Crashvorgangs und der Karosserieverformung läßt sich in<br />

Echtzeit kontrollieren. Beliebige Fahrzeugkomponenten können selektiert werden, um sie einer<br />

Detailuntersuchung zu unterziehen. Objekte, die sich gegenseitig verdecken, können<br />

entfernt oder transparent gemacht werden. Des weiteren steht dem Anwender ein virtuelles<br />

Werkzeug in Form einer Schnittebene zur Verfügung. Diese Schnittebene ist beliebig positionierbar<br />

und ermöglicht dynamische Schnitte durch beliebige Fahrzeugkomponenten.<br />

4. Projektion-Unterhaltung<br />

Die virtuelle Realität beginnt nicht, wie oft angenommen, erst mit einem Cyberhelm, einem<br />

Cyberhandschuh mit haptischer Ausgabe oder gleich einem ganzen Datasuit. Sie beginnt<br />

vielmehr schon bei jedem Spiel, welches wir am Computer oder auf einer Konsole spielen. Diese<br />

vermitteln uns genau wie der Cyberspace, nur auf eine andere Art und Weise, eine andere Welt.<br />

Diese können wir oftmals mit Hilfe eines Helden betreten, um dann gegen ausserirdische Wesen<br />

oder dämonische Monster anzutreten, welche mittlerweilse über eigene primitive Intelligenzen<br />

(KI) verfügen. Und dies alles, um die Welt vor schlimmeren zu retten. Die heutige Spiele - und<br />

Konsolenwelt hält uns auch die Möglichkeit offen, unsere eigenen Welten zu bauen, um uns dann<br />

später liebevoll um deren Bewohner zu kümmern oder ihr Dasein zu beenden. All dies sind<br />

Projektionen fiktiver, virtueller Realitäten. In wie weit wir uns selbst in diese Szenerie zu

projizieren vermögen, hängt von dem jeweiligen Benutzer ab. Im allgemeinen kann man jedoch<br />

sagen, daß ein gutes Spiel mit einem hohen Realitätsgrad, jeweils bezogen auf die in ihm<br />

dargestellte Szenerie, auch eine nicht zu verachtene Immersion auf den Spieler ausübt. Die<br />

Immersion der virtuellen Realität hängt eben auch davon ab, in wie weit sich der Benutzer auf die<br />

ihm vorgeführte Projektion einlässt, in welchen Maß er bereit ist, sein "Ich" in diese Welt hinein<br />

zu projizieren. Somit wird die Projektion zu einem Kreislauf. Erst das Verschmelzen beider<br />

Projektonsebenen ergeben die virtuelle Realität.<br />

Aber warum versucht der Mensch sich in eine andere Realität zu projizieren?<br />

Auf diese Frage gibt es eine Menge Antworten. Eine davon wäre der Gedanke der Realitätsflucht.<br />

Stellen wir uns einen üblichen Arbeitstag vor: Acht Stunden harte körperliche Arbeit, meist mit<br />

einem unausstehlichen Vorgesetzten, aufgebauter Frust und Wut. Was wäre also besse als ein<br />

paar Stunden Krieg zu spielen. Zum Held zu avancieren, der die Welt vor dem Untergang rettet.<br />

Oder das innere Gefühl, etwas erschaffen zu müssen. Warum nicht seine eigene kleine Welt, in<br />

der man gottgleich über dessen Bewohner richten kann. Spiele und Simulationen stellen eine<br />

Pforte zu einer anderen Welt dar, in der man ungestraft töten, Gott spielen oder sein<br />

Lieblingswagen, den man sich im wirklichen Leben niemals leisten könnte, zu Schrott fahren<br />

dürfte. Und dies so oft man möchte.<br />

Man könnte sagen, dass die Unterhaltungsindustrie in diesem Fall uns ein Stück Kindheit zurück<br />

gegeben hat. Mit ihrer Hilfe ist es endlich möglich, all die Dinge zu tun, von denen man schon<br />

immer geträumt hat, bevor die harte Realität uns unserer Träume berauben und weismachen<br />

wollte, dass all die Dinge, an die man als Kind glaubte, unmöglich seien.<br />

Und genau aus diesem inneren Verlangen nach der virtuellen Entspannung erlebt diese Branche<br />

auch einen beachtlichen Aufschwung.<br />

5. Kommunikation mit der virtuellen Realität / Techniken des Daten- in/outputs :<br />

Da die Unterhaltungsindustrie eine Massenproduktmaschinerie darstellt, versucht sie ihre<br />

"virtuellen Welten" auch <strong>für</strong> jederman zugänglich zu machen. Dabei benutzt sie eine optische<br />

Ausgabe, über die fast alle Haushalte verfügen, den Fernseher. Als Eingabemittel werden<br />

sogenannte Gamepads bzw. Joysticks benutzt, welche von Konsole zu Konsole verschieden sind.<br />

Ähnlich verhält es sich auch bei den Computern. Dort ist die Software zumeist auf PC-User<br />

zugeschnitten, da ein herkömmlicher PC wesentlich günstiger ist als ein gleichwertiges Produkt<br />

von Apple. Auch hier gibt es eine Vielfalt von Eingabegeräten, die denen der Konsolen aber stark<br />

ähneln, wenn nicht teilweise sogar baugleich sind.<br />

Seit ein paar Jahren beschäftigt sich die Unterhaltungsindustrie damit, dem Spieler Kräfte mit<br />

Hilfe von sogenannten Rumblepacks, welche zusätzlich an die Gamepads angeschlossen werden<br />

können, oder Force Feedback - Joysticks zu suggerieren. Somit wird jede Maschinengewehrsalve,<br />

deren Rückschlag man hautnah zu spüren bekommt, oder die holprige Straße, über die man in<br />

seinem Porsche mit 180 Kmh hinwegschießt, wesentlich realistischer.<br />

Es ist auch vorstellbar, daß in naher Zukunft die Nerven- und Sinneszellen des Benutzers direkt<br />

mit elektrischen Impulsen stimuliert werden. Der dadurch erreichbare Immersionsgrad wäre<br />

extrem hoch und dem der wirklichen Realität gleich zu setzen. Mit dieser Technik könnte man<br />

perfekte Illusionen, Gefühle, Rauschzustände projizieren. Der Benutzer wäre vollkommen in die<br />

Virtuelle Realität integriert. Sogar Zeitreisen und Identitätsänderungen wären denkbar.

6. Der Wunsch der Schöpfung / der Geist in der Maschine :<br />

Seit dem es Menschen gibt, werden sie durch den Wunsch des Erschaffens beflügelt. Dieser mag,<br />

je nach Religion und Lebensraum, durch unterschiedliche Gründe und Absichten hervorgerufen<br />

werden, er hat jedoch schon manches Mal Unvorstellbares hervorgebracht. Der Mensch versucht,<br />

über sich hinaus zu wachsen. Man könnte beim Anblick dieses Bestrebens von einem göttlichen<br />

Instinkt sprechen. Er bewirkt den Wunsch nach dem Erschaffen oder der bedingungslosen<br />

Vernichtung. Es ist dem menschlichen Sein inne, die Welt nach seinen Vorstellungen zu<br />

verändern, welches widerum durch "heilige Schriften"gerechtfertigt wird. Damit war es nur eine<br />

Frage der Zeit, wann der Mensch beginnen würde, seine eigene Welt nach seinen Vorstellungen<br />

von Grund auf neu zu erschaffen. Der Schlüssel hierzu scheint die Virtuelle Realität zu sein.<br />

Dabei wird die totale Projiktion des "Ichs", geistig wie körperlich, angestrebt. Durch optisch,<br />

haptische und audiovisuelle Projektionsmethoden versucht er sich in die eigene, selbstkreierte<br />

Realität zu transferieren. Und dies gelingt, bedingt durch den raschen Fortschritt der Technik,<br />

erstaunlich gut. So könnten Zukunftsvisionen, wie sie in dem Film " Der Rasenmähermann "<br />

bereits angedacht wurden, bald schon Realität sein. In " Der Rasenmähermann " transferierte sich<br />

Jobe, einer der Hauptakteure des Films, mittels spezieller Geräte seinen Geist in die Maschine.<br />

Dort wurde er zu Cyberjobe, einem Wesen, welches aus binärischen Zahlen bestand. Cyberjobe<br />

war in dieser Welt Gott, da er sie mit einem bloßen Gedanken nach seinen Vorstellungen<br />

verändern konnte. Dies mag vielleicht heutzutage noch nicht realisierbar sein, aber dennoch gibt<br />

es medizinische Arbeiten auf dem Gebiet der VR, die einigen Grundgedanken dieses Filmes<br />

schon sehr nahe kommen.<br />

So gibt es bereits Schnittstellen, welche Gehirnströme messen und diese als Steuereinheit <strong>für</strong><br />

Rechner verwenden. Dies wird möglich durch die Tatsache, dass unser Gehirn eigentlich nur ein<br />

großer "Superrechner" ist, welcher mit Synapsen und Botenstoffen arbeitet. Dies geschieht<br />

ebenfalls auf einem elektromagnetischem Wege. Dementsprechend verändern sich auch unsere<br />

Hirnströme, wenn wir an bestimmte Dinge denken. Diese Veränderung kann man sich als<br />

Eingabedaten zunutze machen, um Rechner zu steuern.<br />

Viele Anhänger der virtuellen Realität träumen bereits von Datenbuchsen, welche in das<br />

Rückenmark implantiert werde könnten. Über diese, so die Idee, könnte man dann in direkten<br />

Kontakt mit dem Rechner treten und seine Gedanken direkt in die Maschine projizieren, um sie<br />

dort Wirklichkeit werden zu lassen. Dies wäre eine Weiterentwicklung des "Tagträumens", da der<br />

Rechner anhand der gelieferten Daten wiederum Synapsen stimulieren könnte, und somit die<br />

Gedanken mit dem Gefühl der körperlichen Empfindung unterstreichen könnte.Weiterhin<br />

könnten Informationen, welche wir als "Wissen" bezeichnen, einfach in unser Gehirn<br />

hochgeladen werden. Bis dahin ist es allerdings noch ein weiter Weg der Erforschung des<br />

neuralen Netzes unseres Gehirns. Ebenso wären Rechner mit enormer Rechenleistung von nöten,<br />

welche vielleicht mit dem Erscheinen des ersten "Atomcomputers" in greifbarer Nähe kämen.<br />

7. Grundgedanken der VR / Gefahren / Droge der Zukunft :<br />

Die VR ist der Schlüssel zu einer neuen Dimension. In ihr ist alles möglich, alles machbar. Der<br />

eigene Geist ist die Grenze. Andere Grenzen gibt es nicht. Jede Art der körperlichen Grenzen<br />

werden hier spielend überwunden.<br />

Der Mensch gelangt durch den Cyberspace, durch die perfekte selbstgeschaffene Simulation, und<br />

somit auch die perfekte Projektion, auf eine neue, höhere Ebene des eigen Ichs. Die Welt nach<br />

seinen Wünschen zu formen zu erbauen, um dann in ihr zu leben, sie zu erleben, dass hat einen<br />

göttlichen Beigeschmack.VR ist eine hochkomplexe Art der Bewusstseinserweiterung. So ist es

auch nicht weiter verwunderlich,<br />

dass viele Pioniere dieser Technik Patrone und Anhänger der Drogenkultur der 60ger Jahre<br />

waren und sogar Begründer der sogenannten Tripp Festivals waren. Dennoch wird es nach Aussagen<br />

einiger Kritker niemals den "perfekten Cyberspace" geben, da die "wirkliche Realität" so<br />

komplex und unberechenbar sei, daß sie aus eben aus diesen und aus chaostheoretischen Gründen<br />

niemals in dem Maße von einer Maschine berechnet werden könne. Im Gegenzug dazu<br />

könnte man sagen, dass der Mensch auch nur eine bestimmte Grenze an Auffassungsgabe besitzt<br />

und somit bestimmte Dinge, wie z.B. die Schmetterlingstheorie nicht berechnet werden bräuchte.<br />

Es handelt sich hier außerdem um eine völlig neue Welt, mit anderen physikalischen Gesetzen,<br />

Umgebungen und Lebewesen.<br />

Da in naher Zukunft die Rechnerleistung im privaten Haushalt weiter steigen wird und moderne<br />

Grafikkarten eine verblüffend reale Umgebung schaffen können wird der Unterschied zwischen<br />

virtueller und realer Welt immer fließender. Dadurch wird der Trip in den Cyberspace mehr als<br />

nur eine Betrachtung einer anderen Welt. Der Benutzer hat das Gefühl mit ihr zu verschmelzen<br />

und es besteht die Gefahr sich in ihr zu verlieren. Dadurch geht die eigene Identität verloren oder<br />

der Benutzer weiß nicht mehr was real und was virtuell ist. Er leidet unter Realitätsverlust.<br />

Weiterhin kann er in der virtuellen Welt sich hinter einer Maske verstecken und sich eine<br />

"Wunsch"-Identität aufbauen, aus der er einfach nicht mehr aussteigen möchte. Oder das Gefühl<br />

in der Virtuellen Welt ist so überwältigend (der Benutzer nimmt die Identität eines Vogels, Dämons,<br />

Gebäudes etc. an), daß er psychisch abhängig wird. Die virtuelle Realität könnte sich zu<br />

einer unkontrollierbaren Droge entwickeln, zumal es vielleicht möglich sein wird herkömmliche<br />

Rauschzustände durch neurale Stimulation, hervorzurufen und zwischen diesen Rauschzuständen<br />

nach Belieben zu wechseln.In einer Virtuellen Realität, die eine identische Kopie der Realität<br />

wäre, könnte man davon ausgehen, daß auch alle realen Probleme in die <strong>Virtual</strong>ität projiziert<br />

würden.<br />

7a. Bioadapter:<br />

Oswald Wiener beschreibt in seinem Text "Bioadapter" seine Vision der perfekten Symbiose von<br />

Mensch und Maschine. Der sogenannte Bioadapter stellt hierbei die perfekte Schnittstelle dar, mit<br />

welcher der Mensch in den wiederum vom Bioadapter geschaffenen virtuellen Raum eintauchen<br />

kann.<br />

Um diese totale Immersion zu erfahren, muss der Nutzer des Bioadpters allerdings in eine<br />

vollkommende Symbiose mit der Maschine eingehen, wodurch er ohne die Maschine nicht mehr<br />

lebensfähig ist. Oswald Wieners Vision des Bioadapters sowie dessen unterschiedlichen<br />

Adaptionsstufen sind im Anhang aufgeführt.<br />

7b. Cyberpunk:<br />

Der Cyberpunk ist eine Literatur- und Kulturform, die in der erste Hälfte der achtziger Jahre<br />

entstand. William Gibson gilt mit seinen Kurzgeschichten "Johnny Mnemonic" und "Burning<br />

Chrome" sowie mit seinem Buch "Neuromancer" als Begründer dieser Gattung. Auch der Film<br />

"Blade Runner" hat geholfen, die Regeln <strong>für</strong> den Cyberpunk festzulegen. Meist ist die Handlung<br />

der Geschichten in der Mitte des einundzwanzigsten Jahrhundert angelegt. Diese nahe Zukunft<br />

wird eher düster und chaotisch gezeichnet. Die Umwelt ist stark geschädigt, die alten<br />

Gesellschaftsstrukturen sind zerstört und die meisten Menschen leben in Sprawls. Das sind<br />

riesige, geschlossen besiedelte Ballungsräume, die sich über hunderte von Kilometern ausbreiten<br />

können. Die Macht der Staaten ist völlig ausgehöhlt und liegt nun in der Hand einiger<br />

gigantischer Firmen. In der Regel gilt Firmenrecht vor Staatenrecht. Die Instanzen des Staates

sind nur noch Erfüllungsgehilfen der Unternehmen, die aber auch eigene Armeen unterhalten, um<br />

ihre Interessen so durchsetzen.<br />

Die Hauptrolle in den Geschichten spielen Cyberspace-Cowboys. Ihre Heimat ist die Matrix. Das<br />

ist eine virtuelle Welt, in der Daten als geometrische Formen zu erkennen sind. Mit der Hilfe von<br />

implantierten Chips wird bei den Hackern die Illusion erzeugt, sich direkt in ihr zu bewegen.<br />

Hat man keine Zugangsberechtigung, sieht man nur die Formen. Die Daten sind aber durch<br />

Sicherheitsprogramme geschützt, die EIS (Elektronisches Invasionsabwehr-System) genannt<br />

werden. Die Hacker kämpfen sich mit Hilfe ihrer Computer und darauf gespeicherter Programme<br />

durch dieses EIS, um an die gewünschten Informationen zu gelangen. Oft riskieren sie dabei ihr<br />

Leben, da die Programme durchaus nicht nur in der Matrix ihre Wirkung entfalten. Es gibt drei<br />

verschiedene Arten von EIS, die nach dem Umfang ihrer Wirkung und Gefährlichkeit <strong>für</strong> den<br />

potentiellen Eindringling unterteilt sind. Das weiße EIS ist eher harmlos, es kann weder dem<br />

Hacker noch seiner Ausrüstung schaden. Das Graue hingegen ist schon gefährlicher. Kann man es<br />

nicht überwinden, wird zumindest die Technik stark beschädigt sein. Scheitert man hingegen am<br />

schwarzen EIS, ist das eigene Leben auf jeden Fall in Gefahr. Die Idee der Matrix basiert sicher<br />

auf den Computernetzwerken, die es schon in den achtziger Jahren in großer Zahl gab. Auch das<br />

EIS scheint wie eine gedanklich logische Weiterentwicklung der heutigen Sicherheitsprogramme.<br />

Seitdem Computer vernetzt wurden, gab es immer Probleme, sie vor Eingriffen von Außen zu<br />

schützen. 5<br />

8. Pioniere der <strong>Virtual</strong> <strong>Reality</strong>:<br />

8a. Jaron Lanier<br />

Jaron Lanier wurde 1960 geboren. Lanier ist vermutlich bestens bekannt <strong>für</strong> seine Arbeit auf dem<br />

Gebiet der virtuellen Realität. Er prägte die Bezeichnung "<strong>Virtual</strong> <strong>Reality</strong>".In den frühen achtziger<br />

Jahren war er an der Entwicklung des ersten Cyberhandschuhs <strong>für</strong> die Kommunikation in<br />

der virtuellen Welt beteiligt und war der erste, der dir Interaktion mit virtuellen Gegenständen<br />

untersuchte.In den späten 80er leitete er die Gruppe, die die ersten Implementierungen der<br />

virtuellen Welten <strong>für</strong> mehrere Personen, basierend auf Cyberbrillen, entwickelte. Er war ebenfalls<br />

an der Entwicklung der ersten Anwendungen der virtuellen Realität in den Bereichen der<br />

chirurgischen Simulation, des Prototyping der Innenausstattung von Fahrzeugen und in anderen<br />

Gebieten beteiligt.Seine 1983 gegründete Firma VPL Research war die erste Firma, die Produkte<br />

<strong>für</strong> die virtuelle Realität einführte.VPL stellte die ersten kommerziellen Cyberhandschuhe (1984),<br />

Cyberbrillen (1987) und vernetzten virtuellen Systeme vor (1989). 6<br />

8b. Ivan Sutherland<br />

Ivan Sutherland, geboren am 16.Mai 1938, Hastings, Nebraska (USA), ist ein Pionier der<br />

Computergrafik. Sein Programm Sketchpad (TX2), das er im Rahmen seiner Doktorarbeit 1963<br />

am MIT entwickelte, gilt als eine der ersten interaktiven Grafikanwendungen. Er entwickelte<br />

zudem auch das erste Head Mounted Display und den Cohen-Sutherland-Algorithmus. Ivan<br />

Sutherland erhielt 1988 den Turingpreis. Wichtige Stationen seiner Karriere waren das Programm<br />

Sketchpad (1963), welches auf einem TX-2 Computer lief und der von ihm 1996<br />

entwickelte erste HMD (Head Mounted Display) namens Damoklesschwert. 7<br />

5Volker Krüßel, „Hacker im Cyberpunk“, http://www.erzwiss.unihamburg.de/comenius/Material/04/Kruessel/Cyberpunk.htm,<br />

Jahr 2000,<br />

6Jaron Lanier, „What remains to be done with <strong>Virtual</strong> <strong>Reality</strong>“, http://hci.stanford.edu/cs547/abstracts/03-04/040213lanier.html,<br />

2.2004<br />

7ABOWD Team, „Biography of a Luminary“,<br />

http://www.cc.gatech.edu/classes/cs6751_97_fall/projects/abowd_team/ivan/ivan.html, 4.1997

8c. Scott S. Fischer:<br />

Scott S. Fischer ist ein Medienkünstler und Interaktionsdesigner, dessen Arbeit sich hauptsächlich<br />

auf immersive Umwelten und Technologien der Echttzeit fokussiert. S.Fischer ist<br />

Präsident von Telepresence Research,Inc., eine Produktionsfirma, welche sich auf die Kunst<br />

und das Design eben dieser Schwerpunkte fokussiert hat.<br />

Wichtige Stationen:<br />

VIEW:<br />

Von 1985 bis 1990 war S. Fischer Direktor und nebenbei auch Gründer des <strong>Virtual</strong> Environment<br />

Workstation Projekts (VIEW), welches von der NASA finanziert wurde. Ziel dieses Projektes<br />

war der Bau eines multisensorischen virtuellen Raumes, welcher in "Space Station teleoperation",<br />

"telepresence" und "automation activities" seine Anwendung finden sollte.<br />

Das Design und die Technik des "goggle and glove" Systems, welches aus "VIEW" hervorging,<br />

war wegweisend und inspirierend <strong>für</strong> viele weitere VR-Systeme, welche HMDs, Datagloves<br />

und 3-D-Sound beeinhalten.<br />

<strong>Virtual</strong> Explorer:<br />

Von1997 bis 1999 war S. Fischer Leiter und Gründer des “<strong>Virtual</strong> Explorer“-Projektes.<br />

"the <strong>Virtual</strong> Explorer" versucht, eine interaktive virtuelle Umgebung zu schaffen.<br />

Eine immersive Wissenschaft, die Erfahrungen lehrt, die unmöglich mit Lehrbüchern<br />

zu vermitteln wären. Das jetzige System stellt alle wichtigen Themen auf Basis der<br />

grundlegenden Immunologie dar. Studenten navigieren durch den Blutkreislauf, das<br />

Lymphensystem, das erkrankte Gewebe eines Patienten und erleben aus der Ich-Perspektive die<br />

jewiligen zugeteilten Aufgaben und Funktionen des Immunsystems. Dies dient zum besseren<br />

Vertsändnisses dieses komplexen Systems.<br />

"The <strong>Virtual</strong> Explorer" simuliert den “viewscreen“ eines “nanobots“, der in einen menschlichen<br />

Körper eingespritzt worden ist. Es schließt ausführliche, biologisch genaue Modelle von Zellen<br />

und Eiweißen vom Immunsystem und dem Blutkreislauf mitein, die in Echtzeit während der<br />

Simulation gerendert werden. 8<br />

9. Verschiedene Arten von VR Systemen:<br />

9a. Desktop VR Systeme<br />

Die Verwendung eines konventionellen Computermonitors zur Darstellung virtueller Welten<br />

nennt man Desktop VR- oder 'Window on World Systeme' (WoW). Diese am häufigsten<br />

verwendete Darstellungsform <strong>für</strong> VR wurde bereits 1965 von I. Sutherland definiert.<br />

9b. Video Mapping<br />

Die auch unter 'Artificial <strong>Reality</strong>' bekannte Variation des WoW-Systems verbindet die<br />

Aufzeichnung des Video Mapping Benutzers mittels Video mit einer 2-D-Computergrafik.<br />

Der Benutzer dieses Systems kann so am Bildschirm seine Interaktion mit der virtuellen Welt<br />

sehen.<br />

8 Autor unbekannt, „Scott Fischer Biography“, http://www.itofisher.com/PEOPLE/sfisher/, Jahr unbekannt

9c. Immersive Systeme<br />

Die 'state of the art' VR-Systeme verschieben den Sichtpunkt (Viewpoint) des Benutzers komplett<br />

in das Innere einer virtuellen Welt.<br />

Diese VR-Systeme sind häufig mit einem Visualisierungshelm (Head Mounted Display)<br />

ausgerüstet. Eine Variation von immersiven Systemen stellt der 'Cave' dar. Ein Cave ist ein<br />

Raum, an dessen Wänden virtuelle Bilder projiziert werden. Innerhalb dieses Raumes<br />

hat man das Gefühl sich in der realen Welt zu befinden.<br />

9d. Telepräsenz<br />

Telepräsenz ist eine weitere Variation der Visualisierung von computergenerierten Welten.<br />

Diese Technologie verknüpft einen Sensor der realen Welt mit den Sinnen eines menschlichen<br />

Operators. Beispielsweise können Kampfpiloten ferngesteuerte Flugzeuge benutzen, um sehr<br />

gefährliche Situationen zu meistern oder Chirurgen benützen sehr kleine, mit Video ausgerüstete<br />

Instrumente, um Operationen durchzuführen.<br />

9e. Mixed <strong>Reality</strong><br />

Wenn Telepräsenz und <strong>Virtual</strong> <strong>Reality</strong> Systeme zusammen genutzt werden, spricht man von<br />

Mixed <strong>Reality</strong>. Ein Beispiel da<strong>für</strong> ist, dass einem Kampfpiloten die computergenerierten<br />

Landschaften und Daten direkt in seinen Helm oder auf das Cockpit-Display projiziert werden.<br />

9f. Fish Tank VR<br />

Fish Tank VR kombiniert die stereoskopische Darstellung durch LCD-Shutter-Brillen mit einem<br />

mechanischen Positionstracker. Man spricht hier auch von einem “Stereo-WoW-System“.<br />

10(a-c). Drei Stufen von <strong>Virtual</strong> <strong>Reality</strong> (VR) können unterschieden werden:<br />

In einer passiven Ebene kann der Benutzer sehen, hören und evtl. fühlen, was um ihn herum<br />

passiert. Die künstliche Welt bewegt sich und läßt den Benutzer glauben, er bewege sich in ihr,<br />

sie ist aber nicht steuerbar. In der aktiven Ebene kann der Benutzer den Raum um sich herum<br />

erkunden. Er sieht z.B. nicht nur einen Tisch im Raum stehen, sondern kann auch um ihn<br />

herumgehen.<br />

In der interaktiven Ebene ist der Raum um den Benutzer interaktiv veränderbar. Der Tisch kann<br />

also an eine andere Stelle verschoben werden. Für all diese Szenarien benötigt es leistungsstarke<br />

Hard- und Softwarekomponenten die im folgenden beschrieben werden.<br />

Die Hardwarekomponenten zur Bildgenerierung stehen im Mittelpunkt eines jeden VR-Systems.<br />

Die Darstellung virtueller Szenen muß eine möglichst verzögerungsfreie und realitätsnahe<br />

Darstellung der virtuellen Welt ermöglichen. Um dies zu erreichen sind dedizierte<br />

Grafiksubsysteme erforderlich. Die hohen Bildwiederholraten werden durch Grafikalgorithmen<br />

wie Transformation, Projektion, 'Clipping', etc. erreicht, die direkt auf der Hardware<br />

implementiert sind. Zur VR Hardware zählen zudem die speziellen Ein- und Ausgabegeräte, um<br />

diese virtuellen Welten besonders realitätsnah begehbar zu machen. Zu den wichtigsten<br />

Eingabegeräten zählen:

10a/a. Spaceball<br />

Dieses 3D Eingabegerät erlaubt das Navigieren des Begehens der virtuellen Welt (Walk-<br />

Throughs) in sechs Freiheitsgraden.<br />

10a/b. 3-D-Maus<br />

Die 3-D-Maus ist wie der Spaceballs zur Navigation von Walk-Throughs in sechs Freiheitsgraden<br />

geeignet, besitzt aber zusätzlich ein Positionstracker.<br />

10a/c. Datenhandschuh<br />

Mit dem Datenhandschuh sind Zeige- und Haptik-Funktionen auf Objekte in der virtuellen Welt<br />

möglich. Damit in einem 3D Raum etwas korrekt gefasst werden kann, wird ein Positionstracker<br />

verwendet.<br />

11. Zu den wichtigsten Ausgabe- oder Darstellungsgeräten von VR Systemen zählen:<br />

11a. 3-D-Ton- und Musikausgabe:<br />

Zur Unterstützung der Interaktion mit virtuellen Umgebungen ist der Einsatz von akustischen<br />

Signalen unabdingbar. Diese können in Form von Sprache, Musik, Ton oder Geräuschen<br />

präsentiert werden. Mittels audiogestützter Interaktion mit der virtuellen Welt wird eine<br />

verbesserte Wahrnehmung von visuell dargestellten Informationen erzielt.<br />

11b. Stereodarstellung:<br />

Ausgabegeräte wie Stereo Display/Brille unterstützen eine Auflösung von bis zu 1280x1024<br />

Bildpunkten und sind mit einer Infrarotsteuerung <strong>für</strong> die Stereobrille ausgerüstet.<br />

11c. Head Mounted Display:<br />

Das Head Mounted Display ist ein Monitorhelm, der die Bilder von hochauflösenden<br />

Kathodenstrahl-Röhren (CRT) oder Flüssig-Kristall Anzeigen (LCD) direkt vor die Augen<br />

projiziert. Dieser Visualisierungshelm, der oft mit einem Positionstracker ausgerüstet ist, erlaubt<br />

das komplette Eintauchen (Immersion) in virtuelle Welten.<br />

11d. Verarbeitung haptischer Informationen:<br />

Die Systeme zur Verarbeitung von haptischen (Kraft- und taktile Rückkopplung) Informationen<br />

sind bis heute meist nur als Forschungsprototypen verfügbar.<br />

12. Werkzeuge zur Visualisierung<br />

(optische Geräte / Hardware)<br />

Optische Geräte im Bereich der virtuellen Realität machen sich die Netzhautdisparität unserer<br />

Augen zu nutzte. Aus den von unseren Augen in 2-D aufgenommenen Informationen generiert<br />

unser Gehirn ein dreidimensionales Abbild unserer Umgebung. Diese Fähigkeit zum räumlichen<br />

Sehen nennt man auch Stereopsis. Der Beginn der virtuellen Realität war somit auch der Beginn<br />

der ersten beweglichen Stereogramme.

Bei diesen optischen Geräten unterscheidet man unter drei grundsätzlichen Methoden:<br />

1. Stereoskopische Helme<br />

2. Monukolare Helme<br />

3. Freie Monitore<br />

12a. 1. Stereoskopische Helme:<br />

a. die Shutterbrille:<br />

Die Shutterbrille, auch LCD-Brille genannt, ist im engeren Sinne kein Helm, war und ist aber<br />

denoch ein gutes Beispiel <strong>für</strong> die Benutzung beweglicher Stereogramme. Die erste dieser Brillen<br />

wurde von Lenni Lipton erfunden und nannte sich “Crystal Eyes“. Sie funktioniert wie folgt:<br />

Die Darstellung der Daten erfolgt wie gewohnt über einen Monitor. Die Gläser der Brille sind<br />

durch kleine LCD (Liquid Cristal Display)-Glasfenster ersetzt worden, welche die Sicht <strong>für</strong> nicht<br />

genutzte Bilder <strong>für</strong> das jeweilige Auge blockieren können. Dabei wird auf dem Monitor jeweils<br />

ein Bild <strong>für</strong> das linke, dann <strong>für</strong> das rechte Auge dargestellt. Parallel dazu wird jeweils das<br />

ungenutzte Auge durch das LCD abgedunkelt, die Sicht wird blockiert. Die Synchronisation mit<br />

dem Computer erfolgt über ein Kabel bzw. über eine Infrarotschnittstelle.<br />

Wie genau funktioniert aber so ein LCD?<br />

Ein LCD besteht aus zwei kleinen Glasscheiben zwischen denen sich unzählige Zellen (Pixel)<br />

befinden, welche mit einer FLüssigkristalsubstanz gefüllt sind. Durch kleine Stromstöße können<br />

diese in ihrer räumlichen Ausrichtung manipuliert werden und Licht kann durch das Pixel fallen.<br />

Das gleiche Prinzip wird auch bei LCD-Displays verwand. Diese haben zusätzlich aber noch<br />

Farbfilter zwischen den Glasscheiben liegen, um alle RGB-Werte darstellen zu können.Weiterhin<br />

wird das durchfallende Licht durch einen phosphorisierenden Hintergrund ersetzt.<br />

Der Vorteil solcher Displays liegt zum einen im Kostenpunkt, denn sie sind erheblich günstiger<br />

als Kathodenstrahlröhren (bekannt aus Fernsehern), zum anderen in ihrer einfachen Handhabung<br />

bzw. Einsatzmöglichkeit. Weiterhin brauchen LCDs erheblich weniger Energie als eine<br />

Kathodenstrahlröhre. Diese produziert ihr eigenes Licht, indem durch eine Vakuumröhre ein<br />

Elektrodenstrahl geschossen wird, welcher dann, nachdem er mehrmals durch Magneten<br />

abgelenkt wurde, Leuchtpunkte auf einem mit Phosphor beschichteten Schirm (Mattscheibe)<br />

sichtbar macht.<br />

Die Elektronen legen etwa eine Strecke von 650 Metern in der Sekunde zurück und erzeugen<br />

damit eine wesentlich höhere Auflösung als ein LCD-Display.<br />

Shutterbrille

. Sichtgeräte der NASA:<br />

1984 bauten Wissenschaftler der NASA unter Leitung von Scott Fischer einen VR-Helm aus<br />

zwei kleinen LCD-Fernsehern oder besser gesagt, aus deren LCD-Displays und deren<br />

phosphorisierenden Rückbeleuchtung.<br />

Diese produzierten eine Auflösung von immerhin 76.800 Pixel, was allerdings entscheidend zu<br />

wenig <strong>für</strong> eine scharfe Darstellung ist. Eine weitere Verschlechterung der Bildqualität brachte die<br />

Montage der LCDs nahe der Augen mit sich, denn je geringer der Abstand zwischen den Augen<br />

und den Bildschirmen ist, desto sichtbarer werden die einzelnen Pixel und damit verschlechtert<br />

sich logischerweise auch die Schärfe bzw. die Detailtreue des Bildes. Man stellte fest, dass ein<br />

geeigneter Abstand von ca. 50 cm vonnöten ist, damit die einzelnen Pixel zu einem scharfen Bild<br />

zusammenfließen.<br />

c. UNC-Monitor:<br />

UNC steht <strong>für</strong> die Universität von North Carolina. Dort entwickelte man 1989 einen ganz<br />

besonderen Helm in Zusammenarbeit mit der amerikanischen Luftwaffe. Das Grundgerüst zu<br />

diesem Helm lieferte ein ordinärer Fahrradhelm, welcher mit zwei LCDs, fluoreszierenden<br />

Hintergründen und Speziallinsen ausgestattet wurde. Das besondere an diesem Helm war die<br />

Tatsache, dass die LCDs schräg angebracht wurden. Dies geschah, damit der Benutzer genug<br />

Platz <strong>für</strong> seine Nase hatte.<br />

Die dadurch erzeugt Verzerrung wurde mit Hilfe einer Speziallinse wieder korrigiert.<br />

Einige Jahre später wurde das System weiterentwickelt.Die LCDs wurden nun waagerecht in<br />

Höhe der Augenbrauen angebracht (man kann sich das wie hochgeklappte Sonnengläser<br />

vorstellen).<br />

Das Bild wurde nun mit Vergrößerungsgläsern abwärts auf halbversilberte Spiegel projiziert,<br />

welche in einem 45-Gradwinkel zu den Augen des Benutzers angebracht wurden. Somit konnte<br />

der Betrachter zum einen das computererzeugte Bild als auch die reale Umgebung wahrnehmen.<br />

Dies nennt man auch das Sutherlandsche Prinzip, auf das ic nachher noch näher eingehen werde.

d. Eyephone von VPL:<br />

VPL, gegründet von Jaron Lanier , bekannt als ein Pionier der virtuellen Realität, war die erste<br />

Firma, welche stereoskopische Helme zur kommerziellen Nutzung herausbrachte.<br />

Das Eyephone überzeugte durch seine farbigen Displays, welche immerhin eine Auflösung von<br />

320 x 240 Pixel schaften. Ebenfalls neu, obwohl eigentlich sehr simpel, war das Aussehen des<br />

Eyephones. Es glich mehr einer Taucherbrille als einem Datenhelm. Diese Form wurde gewählt,<br />

damit diffuses Licht nicht in den Helm dringen konnte.Kurze Zeit später erschien die Visette von<br />

W-Industries, welche noch heute in VR- Cafés eingesetzt wird.<br />

Eyephone<br />

e. CAE-faseroptisches System:<br />

Die Firma CAE brachten den ersten Datenhelm heraus, welcher nicht mit LCD-Displays, sondern<br />

mit Kathodenstrahlröhrren arbeitete. Die Bilder, welche die Röhren erzeugten, wurden mit Hilfe<br />

von Glasfaserbündeln zum Helm transportiert, durchliefen dort ein spezielles Linsensystem und<br />

wurden letztlich auf halbversilberte Spiegel projiziert. Somit konnte der Betrachter genau wie bei

dem UNC-Helm zum einen das Computerbild, zum anderen die "wirkliche Umgebung"<br />

wahrnehen.<br />

Neu bei diesem System war zum einem die Verwendung von Glasfaserbündeln als auch die<br />

Benutzung von Eyetracking. Eine Infrarotkamera innerhalb des Helmes trackte die Bewegung der<br />

Augen. Anhand dieser Daten wurden nur die Objekte bzw. Bilder, welche mit dem Auge direkt<br />

fokussiert wurden, scharf dargestellt. Dadurch erreichte man eine erheblich Rechenauslastung der<br />

Computer.<br />

CAE System<br />

f. Die Cave Automatic <strong>Virtual</strong> Environment (CAVE)<br />

Ein Cave Automated <strong>Virtual</strong> Environment (CAVE) ist ein Raum zur Projektion einer<br />

dreidimensionalen Illusionswelt der virtuellen Realität. Das NCSA definiert CAVE als "an<br />

immersive virtual reality facility designed for the exploration of and interaction with spatially<br />

engaging environments". Die Bezeichnung "Cave" rekurriert bewußt auf das Höhlengleichnis in<br />

Platons Republik, das sich mit dem Verhältnis von Wahrnehmung und Erkenntnis sowie Realität<br />

und Illusion beschäftigt.<br />

Der Prototyp eines Geräts zur Echtzeit-Visualisierung in Kunst und Wissenschaft <strong>für</strong> mehrere<br />

Menschen in einem Raum wurde von dem Kunstprofessor Daniel Sandin und den<br />

Computerwissenschaftlern Tom DeFanti und Carolina Cruz-Neira an der University of Illinois in<br />

Chicago entwickelt und 1992 auf der SIGGRAPH vorgestellt. Im Ars Eletronica Center in<br />

Linz ist eine solche CAVE seit September 1996 installiert und der Öffentlichkeit zugänglich.<br />

Neuere vergleichbare VR-Systeme sind “ImmersaDesk“ und der “IWall“.<br />

Der CAVE erlaubt die Echtzeitvisualisierung von interaktiven, hochkomplexen Grafikdaten in<br />

einem begehbaren Raum. Die Grafikdarstellung erfolgt durch Rückwandprojektion auf vier<br />

Projektionswände mit je 2,5m x 2m Größe. Zentraler Bestandteil des Systems ist ein SGI Origin<br />

3800 Superrechner, der es erlaubt, Grafikdaten in Echtzeit unter der interaktiven Kontrolle des<br />

Benutzers zu verarbeiten und auf den Leinwänden darzustellen. Dadurch entsteht <strong>für</strong> den<br />

Benutzer der Eindruck, sich in einer virtuellen Welt zu bewegen.<br />

Die Cave Automatic <strong>Virtual</strong> Environment (CAVE) ist 1991 von der EVL entwickelt worden.<br />

Der VR-Raum bringt den Anwendern eine Reihe von Vorteilen gegenüber bisherige<br />

Displaytechniken.<br />

Simultan erhält eine Gruppe von Betrachtern die Möglichkeit zum kompletten Eintauchen in<br />

virtuelle Realitäten, die mit hoher Auflösungsqualität dargeboten werden. Zudem erhalten die<br />

Akteure die Freiheit ohne belastende Displaygeräte zu agieren.<br />

Die 4-Seiten-CAVE besteht aus 3 Seitenwänden und einer Bodenfläche.<br />

Ein LCD-Projektor <strong>für</strong> jeden Screen projiziert ein Stereobild des virtuellen Geschehens durch<br />

Rückprojektion auf die Seitenwände (Höhe zwischen 2,40 m und 3,00 m) und durch

Aufprojektion auf den Boden (Grundfläche des Raumes 3 x 3 m). Alle Wände sind simultan<br />

aktiv.<br />

Gewöhnlich führt einer der CAVE-Besucher die Bilddarstellung. Der Guide trägt eine getrackte,<br />

von Positionssensoren vermessene Stereobrille (Shutter-Glasses). Ein Grafiksupercomputer von<br />

Silicon Graphics generiert in Echtzeit die virtuellen Bildwelten entsprechend der Blickrichtung.<br />

Die restlichen, mit sensorlosen Stereobrillen ausgestatteten Betrachter verfolgen das Geschehen<br />

unbehindert und mit hoher Auflösungsqualität (1250 x 512 Pixel bei 120 Hz (stereo)). 9<br />

CAVE<br />

2. Monukolare Systeme:<br />

2a. Das Privat Eye :<br />

Das wohl bekannteste monukolulare System ist das "Private Eye" von Reflection Technologies.<br />

Monukolar bedeutet "einäugig", das heißt, daß die Daten auf nur ein Auge des Betrachters<br />

projiziert werden, man also keine stereoskopischen Bilder benutzt.<br />

Das Private Eye ist nur 3,0x3,3x8,9 cm groß und wird mit Hilfe eines Stirnbandes am Kopf<br />

befestigt. Es projeziert einen etwa 30 cm großen Bildschirm auf die Netzhaut. Dies geschieht auf<br />

folgendem Wege:<br />

Das Privat Eye verfügt über 280 kleine Leuchtdioden, welchen gegenüber ein Spiegel angebracht<br />

ist. Dieser dreht sich sehr schnell hin und her. Bei jeder Drehung flackert jede Diode über 720<br />

mal auf. Dadurch werden 280 waagerechte und 720 senkrechte Pixelspalten simuliert.<br />

Auch beim Privat Eye setzte man auf eine virtuelle Überlagerung. Das heisst, dass sowohl die<br />

virtuelle Realität als auch die wirkliche Außenwelt wahrgenommen wird.<br />

9 Dave Pape, „The CAVE <strong>Virtual</strong> <strong>Reality</strong> System “, http://www.evl.uic.edu/pape/vrml/CAVE/ , July 2001

Private Eye<br />

3. Freie Monitore:<br />

3a. Sutherlands Damoklesschwert :<br />

Das Damoklesschwert, welches Ivan Sutherland als Harvardstudent 1968 erfunden und erbaut<br />

hatte, gilt als erster virtueller Helm. Somit kann Sutherland genau wie Jaron Lanier (VPL) zu<br />

den Pionieren der virtuellen Realität gezählt werden. Hierbei handelt es sich um einen Kasten,<br />

an dem sich rechts und links jeweils eine Kathodenstrahlröhre befindet, welche ein<br />

stereoskopisches Bild über ein System von Glaslinsen auf die Netzhaut des Betrachters<br />

projiziert.Dabei kann der Betrachter weiterhin seine Umgebung wahrnehmen, wir haben also<br />

eine virtuelle Überlagerung. Die räumliche Ortung geschah durch eine Aufhängung an einem<br />

Metallarm, welcher an der Decke befestigt war. Daher erhielt das Gerät auch seinen Namen.<br />

Anmerkung: Über Damokles, einem Günstling des Dionysios von Syrakus, war ein Schwert an<br />

einem Pferdehaar aufgehängt. Der Begriff “Damoklesschert“ steht normalerweise <strong>für</strong> drohende<br />

Gefahr! Es ist daher anzunehmen, daß Sutherland den Namen als Spaß verwandte.<br />

Sutherlands Damoklesschwert

3b. BOOM (Binukolar Omni Orientation Monitor) :<br />

Dieser Helm hatte außer den LEEP-Linsen, auf die ich noch später zu sprechen komme, keine<br />

Gemeinsamkeit mit den herkömmlichen Monitoren.<br />

Die Projektion geschah über zwei kleine Kathodenstrahlröhren, welche eine Auflösung von<br />

1280 x 500 Pixel besaßen. Diese befanden sich in einem kleinen Kasten, welcher an einem<br />

Schwenkarm, der widerum aus zwei Teilen bestand, befestigt war. Man schaut in diesen Kasten<br />

und kann sich frei im Raum bewegen, da er an beiden Seiten Griffe zur Bewegung bereit hält.<br />

Kurz nach Veröffentlichung des BOOM s griff VPL dieses System auf, indem sie <strong>für</strong> ihre<br />

Eyephone Serie eine Schnittstelle entwarfen, die man zum einem als freien Monitor, zum anderen<br />

aber auch als HMD (Head Mounted Display) benutzen kann.<br />

BOOM<br />

13. Wichtige Punkte zur Verstärkung der Immersion<br />

Um eine realistische Darstellung einer virtuellen Realität zu erzeugen, müssen gewisse Punkte<br />

genauestens beachtet werden. Dabei sind drei Hauptpunkte besonders wichtig:<br />

a. das Gesichtsfeld<br />

b. die Bildwechselrate<br />

c. Blickortung<br />

13a. Das Gesichtsfeld:<br />

Der durchschnittliche Mensch hat ein Gesichtsfeld von etwa 270 Grad. Innerhalb dieses<br />

Gesichtsfeldes ist allerdings nicht alles scharf, aber auch die unscharfen Informationen sind<br />

genauso wichtig <strong>für</strong> das dreidimensionale Sehen. Genau aus diesem Grund benutzen die meisten<br />

der eben vorgestellten optischen Geräte Speziallinsen der Firma LEEP-Systems.<br />

Diese Linsen haben das Prinzip der Fischaugenlinse aufgegriffen und weiterentwickelt.<br />

Es handelt sich hier um einen Weitwinkellinsensatz, genannt LEEP, welcher eine 6,5-fache<br />

Vergrösserung erzeugt und das Bild in etwa 120 Grad über das waagerechte sowie senkrechte

Gesichtsfeld des Betrachters ausbreitet. Das entspricht in etwa einem 90 Grad großem<br />

binukolarem Gesichtsfeld.Weil sich diese Technik so gut bewährt hat, sind LEEP-Linsen heute<br />

standard bei allen gehobeneren VR-Systemen.<br />

Überboten werden diese Linsen nur noch von der Entwicklung von ARVIS-Electronics, welche<br />

durch das Zusammenspiel von speziell verzerrten LCD-Monitoren und Präzisionskontaktlinsen<br />

ein noch größeres Sehspektrum abdecken konnten.<br />

LEEP-Linsen<br />

13b. Die Bildwechselrate:<br />

Im wirklichen Leben, also in der "wirklichen Realität", ist Blicken und Sehen eins. Das heißt,<br />

dass der Zeitraum zwischen diesen beiden Vorgängen so minimal ist, daß er von uns nicht<br />

registriert wird. Man spricht hier auch von Echtzeit.<br />

Der Begriff Bildwechselrate bezieht sich auf die Anzahl der Bilder die von einem Computer<br />

innerhalb einer gewissen Zeit dargestellt werden können. Dabei liegt die angenehmste<br />

Empfindung, laut der Wissenschaft, bei ca. 40-50 Bildern in der Sekunde.<br />

13c. Blickortung:<br />

Dieser Begriff bedeutet, die unabhängige Bewegung der Augen im Bezug zum Kopf zu<br />

verfolgen. Ein Beispiel da<strong>für</strong> ist das Eyetracking des CAE-Systems. Durch diese Technik könnte<br />

man erheblich Rechenleistung sparen, da nur der Fixpunkt scharf gerendert werden müsste. Dies<br />

entspräche außerdem einer realeren Darstellungsweise.

14. Räumliche Ortung / Tracking<br />

Unter Trackingsystemen versteht man die möglichen Techniken, um die Position einer Person<br />

bzw. der Hand dieser Person im virtuellen Raum zu ermitteln.<br />

Das wohl faszinierenste an diesen optischen Systemen (HMDs) ist die Tatsache, daß sie alles<br />

Wissen über Raumortung, Bilderzeugung und Darstellungstechnik in einem Gerät vereinen. Aber<br />

wie funktioniert räumliche Ortung?<br />

Auch hier gibt es verschiedene Arten von Ortungsmechanismen:<br />

a. Mechanische Ortung<br />

b. Magnetische Ortung<br />

c. Ultraschall-Ortung<br />

d. Optische Ortung<br />

e. Ortung durch Bildauszug<br />

14a. Mechanische Ortung :<br />

Ivan Sutherland benutzte die Art von Ortung bereits bei seinem Damoklesschwert. Dabei steht<br />

ein VR-Helm über einen Metallarm mit einem an der Decke befindlichen Dekoder in direkter<br />

Verbindung. Bewegt der Benutzer nun den Kopf, so wird dies erfaßt und daraufhin vom<br />

Computer das betrachtete Bild anhand der gelieferten Koordinaten korrigiert.<br />

Die feste Montage schränkt den Benutzer allerdings in seinem Bewegungsfreiraum erheblich ein.<br />

14b. Magnetische Ortung<br />

Die magnetische Ortung macht sich die Eigenart zunutze, daß elektrischer Strom in Verbindung<br />

mit einer Drahtspule ein magnetisches Feld entlang einer Achse produziert. Umgekehrt entsteht<br />

proportional ein elektrischer Strom zu einer Feldstärke, wenn man die Drahtspule einem<br />

Magnetfeld nähert. Dies, verbunden mit einem ausgeklügeltem System von Empfangs- und<br />

Sendemechanismen, erzeugt eine dreidimensionale Ortung im Raum.<br />

Das erste bekannte System in dieser Art wurde von der Firma Pholemus Navigation Sciences<br />

erfunden, und somit nennt sich dieses System seitdem “Pholemus-Magnetortung“.<br />

Die großen Nachteile waren damals, das eine erhebliche Latenz vorhanden war. Dass bedeutet,<br />

dass eine gewisse Zeitverzögerung zwischen dem eingehenden Signal und dessen Verarbeitung<br />

auftritt. Weiterhin arbeiteten diese Systeme mit Wechselstrom, welcher Fluktuationen und<br />

Störungen der Magnetfelder und diese widerum Störungen der LCD-Displays mit sich brachte.<br />

Heutzutage gehören diese Probleme, bedingt durch schnellere Rechner und das Umstellen des<br />

Systemes auf Gleichstrom, der Vergangenheit an.

Pholemus-Magnetortung<br />

14c. Ultraschallortung<br />

Dieses System wurde ebenfalls von Ivan Sutherland erfunden. Das System arbeitet wie folgt :<br />

Ein kleiner Apparat am Helm sendet eine schnelle Abfolge von unhörbaren Knacktönen, welche<br />

von vier an der Decke befestigten Mikrofonen empfangen werden. Durch den jeweiligen<br />

Zeitunterschied des Eingehens des Knackens an den verschiedenen Mikrophonen lässt sich über<br />

mathematische Formeln die Position im Raum berechnen. Allerdings ist dieses System sehr leicht<br />

zu stören (Hindernisse, Nebengeräusche).<br />

14d. Optische Ortung<br />

Die optische Ortung funktioniert von der Grundprinzip her wie das Motiontracking. An einer<br />

Person werden Leuchtpunkte angebracht, die dann von Kameras erfaßt werden und von einer<br />

speziellen Software verarbeitet werden. Daraus ergibt sich die (fast) genaue Postion des<br />

Benutzers.<br />

Auch die Umkehrung des Systems ist möglich. Da<strong>für</strong> werden lichtempfindliche Kameras am<br />

Helm des Benutzers intalliert, welche dann computergesteuerte Infrarot-Leuchtdioden an der<br />

Decke des Raumes filmen. Diese Daten werden ebenfalls durch den Computer ausgewertet und<br />

können dann zur räumlichen Ortung der Person dienen.

Optisches Ortungsgerät auf dem Helm<br />

14e. Ortung durch Bildauszug<br />

Die optische Ortung durch Bildauszug ist eigentlich nur eine Weiterentwicklung des<br />

Motiontrackings. Der Computer erfaßt mittels Spezialkameras die agierende Person und<br />

berechnet anhand gespeicherter Bewegungsmuster die Bewegung des Benutzers. Dieses System<br />

ist zwar entschieden rechenaufwendiger, hat aber den großen Vorteil, daß der Agierende nicht<br />

unbequeme Datenanzüge, bestückt mit Leuchtdioden oder farbigen Tischtzennisbällen, anziehen<br />

muß, sondern sich in seiner normalen Bekleidung durch die virtuelle Realität bewegen kann.<br />

15. Haptische Systeme<br />

Kraft ist eine wichtige Erfahrung in der Realität um uns in unserer Umwelt zu orientieren. Seien<br />

es Kräfte, die auf uns wirken oder die wir selber ausüben, ohne sie wäre die Realität nicht mehr<br />

so real. Damit ist Kraft ein wichtiger Bereich der VR-Forschung. Unter haptischen Systemen<br />

versteht man die Simulation von Druck (Kraft) und Oberflächenbeschaffenheit von simulierten<br />

Gegenständen.Die haptische Ausgabe macht sich die Eigenart unserer Haut zu nutze. Sie ist das<br />

erste und wichtigste Verbindungsglied zur Außenwelt.<br />

Sie besteht aus zwei <strong>für</strong> die haptische Ausgabe äußerst wichtigen Systemen.<br />

1. Die Mechanorezeptoren:<br />

Diese Rezeptoren liefern Informationen über die Verformung der Hautoberfläche. Dabei<br />

erkennen sie die Form, die Struktur und die Temperatur eines Gegenstandes. Ebenso wird die<br />

Dehnung der Haut registriert. Wir besitzen hunderttausende solcher Rezeptoren.<br />

2. Die Propriozeptoren:<br />

Diese Rezeptoren bestehen aus komplexen Muskelgruppen, welche Information über Größe,<br />

Gewicht und Form eines Gegenstandes liefern. Diese Informationen nennt man auch<br />

Propriozeption, was soviel wie tiefsensible Wahrnehmung bedeutet. Beide Rezeptoarten arbeiten<br />

eng zusammen und bestimmen unsere taktile Wahrnehmung und unser Hautempfinden.

15a. Kraftrückkoplungsgeräte:<br />

Diese Geräte verursachen, wie ihr Name schon sagt, eine Kraftrückkoplung auf unseren Körper,<br />

um Rezeptorsignale auszulösen. Die ersten Versuche dieser Art sahen wie folgt aus:<br />

Eins der ersten haptischen Geräte war ein Handschuh, in dessen Fingerkuppen sich<br />

piezoelektronische Kristalle befanden. Diese fangen schon bei niedrigen Spannungen an, zu<br />

vibrieren. Durch spezielle Software wurden diese Kristalle im richtigen Moment in<br />

Schwingungen gesetzt und vermittelten somit dem Benutzer ein grobes Gefühl von Widerstand.<br />

15a/a. Der ARM<br />

Ein anderes Beispiel ist der ARM (Argonne Remote Manipulator). Den ARM kennt man als<br />

Kontrolleinheit <strong>für</strong> Roboterarme, welche radioakives Material bewegen.<br />

Der Arm wird an der Decke montiert. Er gibt Rückkopplungssignale an die Hand, das<br />

Handgelenk, den Ellenbogen und die Schultern.<br />

Ein ähnliches Modell ist der “Per Force“ Handcontroller. Er ist im Grunde genommen eine<br />

Weiterentwicklung des ARM und ist im Gegensatz zu seinem "Vorbild" multipel einsetzbar.<br />

15a/b. Das TeleTact - Rückkoplungssystem<br />

Dieses System wurde an dem Forschungszentrum <strong>für</strong> fortgeschrittene Robotik in Großbritannien<br />

erdacht und erbaut. Es handelt sich hierbei um die Übermittlung von taktilen Reizen mittels<br />

Luftpolster, welche in den Handschuh eingearbeitet sind. Dieses System besteht aus zwei<br />

Kunststoffhandschuhen. Handschuh Nr.1 ist der sogenannte Datenaufnahmehandschuh,<br />

Handschuh Nr.2 der eigentliche TeleTact-Handschuh.

Der Datenaufnahmehandschuh besitzt zwanzig kraftempfindliche Widerstände an der Hand und<br />

dem Fingeransatz. Man greift mit diesem Handschuh einen Gegenstand. Der Handschuh, oder<br />

vielmehr die eben genannten Wiedersrtände, registrieren das Kraftmuster und senden es weiter an<br />

den Rechner, welcher diese dann speichert. Ist dies getan, kann man mit dem eigentlichen Tele-<br />

Tact Handschuh, welcher, genau wie Handschuh Nr.1, über Luftpolster verfügt, z.B. einen<br />

simulierten Ball im Cyberspace anfassen und auch spüren, sofern man die vorher gespeicherten<br />

Daten, wie z.B. von einem "wirklichen Ball" dem Cyberspace-Ball zugewiesen hat.<br />

Dabei ist dieses System erstaunlich präzise und vermittelt ein verblüffendes Endresultat.<br />

15a/c. Der Portable Dextrous Master<br />

Der Portable Dextrus Master ist ein Zusatzgerät <strong>für</strong> den Dataglove. Er simuliert Kraftrückkopplung<br />

durch kolbenartiger Zylinder, welche auf der Handinnenseite montiert sind und mit<br />

Druckluft gespeist werden. Der Portable Dextrus Master kann in Echtzeit über spezielle Software<br />

Daten simulieren, welche z.B. von einer Roboterhand, die mit Drucksensoren bestückt ist,<br />

stammen könnten.

15a/d. Das Tini Alloy Rückkopplungsystem<br />

Die Grundidee dieses Systems basiert auf der Simulation von Tastreizen, welche mittels einer<br />

sogenannten Memory-Legierung simuliert werden.<br />

Eine Memory-Legierung (wie z.B. Nickel - Titan) nimmt im kalten oder erwärmten Zustand<br />

unterschiedliche Formen an. Sobald sich die Temperatur wieder auf einen Mittelwert<br />

eingependelt hat, errinnert sich diese Legierung an die Ausgangsform und kehrt in sie zurück.<br />

Diese Eigenschaft wird genutzt, um mit Hilfe von kleinen Stromstößen, welche zur Erwärmung<br />

dienen, Taktoren im Bereich der Fingerspitzen zu bewegen.<br />

Wie wichtig ist eine haptische Ausgabe?<br />

Haptische Systeme spielen eine sehr große Rolle <strong>für</strong> die virtuelle Welt, da einige Einsatzbereiche,<br />

wie zum Beispiel die Steuerung von Roboterarmen mit Greifhänden oder die virtuelle<br />

Fernsteuerung von Fahr-und Flugzeugen, ohne sie sinnlos wären. Hinzu kommt, daß die<br />

Gesamtprojektion wesentlich stärker ist als wenn man auf deine haptische Ausgabe verzichten<br />

würde. Sie unterstützt auch die Orientierung im virtuellen Raum. Die haptische Ausgabe<br />

unterliegt aber auch dem Anspruch, glaubhaft zu sein. Und dies ist gar nicht so einfach. Es gibt<br />

schließlich eine große Pallette an unterschiedlichen Gefühlen, hervorgerufen durch weitere<br />

Rezeptorgruppen, die mehr Daten liefern als heiß, kalt, Schmerz oder Druck. Und auch die<br />

Refreshrate der Daten muß, genau wie bei den optischen Systemen, am besten der Realität<br />

entsprechen, sollte eine Echtzeitausgabe sein.<br />

16. Akustische Richtungsbestimmung / virtueller Sound<br />

Die akustische Richtungsbestimmung ist genauso wichtig <strong>für</strong> eine glaubhafte Projektion der<br />

virtuellen Realität wie die optische oder die haptische. Denn oft helfen auch Töne, um Objekte zu<br />

lokalisieren bzw. sie zu deuten.<br />

Der Mensch neigt dazu, sich ein 3-D-"Audio-Bild" im Kopf zu machen.<br />

Wichtig hier<strong>für</strong> sind vier Faktoren:<br />

a. Zeitunterschied<br />

b. Lautstärke<br />

c. Schallschatten<br />

d. Echoortung

16a. Interauraler Zeitunterschied :<br />

Interaural bedeutet soviel wie “zwischen den Ohren“. Das heißt, daß der Schall das eine Ohr<br />

früher erreicht als das andere. Somit können wir bestimmen, ob die Schallquelle links, rechts,<br />

linksoben, etc. liegt. Manchmal, aber eher selten, kommt es vor, dass der Schall direkt von vorne<br />

oder direkt von hinten kommt. Dann erreicht der Schall die Ohren gleichzeitig, und wir erkennen<br />

dies als vorne oder hinten.<br />

16b. Interaurale Lautstärke:<br />

Die Intensität des Schalls nimmt mit der Entfernung ab. Dass bedeutet, dass unsere Ohren ihn<br />

unterschiedlich laut wahrnehmen. Tiefe Töne werden meist in einem Raum überall gleichmäßig<br />

laut wahrgenommen. Dies ist damit zu erklären, daß tiefe Töne ein sehr niedriges<br />

Frequenzspektrum besitzen, und somit <strong>für</strong> unser Gehör schwer zu orten sind. Eine einhundert Hz<br />

Welle schwingt mit einer Länge von über drei Metern, und ist damit größer als der Kopf. Sie<br />

erreicht die Ohren also mit der gleichen Intensität.<br />

16c. Schallschatten:<br />

Im Gegensatz zu den tiefen Tönen haben hohe Töne ein hohes Frequenzspektrum. Die Welle<br />

schwingt sehr kurz und ist, je nach Hz-Zahl, wesentlich komprimierter. Daher kann man ihr auch<br />

leichter den Weg zum Gehör durch Gegenstände versperren. Hinzu kommt, daß bei einer<br />

Verdeckung der hohen Töne die tiefen Töne wesentlich stärker wahrgenommen werden.<br />

Bei solch einer Verdeckung von hohen Frequenzen spricht man vom Schallschatten.<br />

16d. Echoortung:<br />

Die Echoortung gibt Aufschluß über die Größe eines Raumes bzw. ob wir z.B. nahe einer Wand<br />

stehen oder nicht. Sie kann allerdings auch die Ortung stark behindern. Ein Beispiel da<strong>für</strong> wäre<br />

ein Helikopter, welcher über einem Wohnviertel kreist. Das Echo seines Motorengeräuschs und<br />

dem des Rotors würden aus allen Häuserschluchten wiederhallen. Die Echos kämmen also von<br />

mehreren Seiten, und eine Lokalisierung des Helikopters anhand der Echoortung wäre unmöglich.<br />

17. 3D -Ton / Virtueller Klang :<br />

Der virtuelle Klang muß all diese Punkte berücksichtigen und umsetzen können. Er muß in<br />

Echtzeit auf den Positionswechsel des Benutzers reagieren und sich diesem anpassen.<br />

Um einen Klang innerhalb eines Raumes realistisch wiedergeben zu können muß man all die<br />

kleinen Echos der Schallwellen berücksichtigt werden. Da<strong>für</strong> gibt es zwei Systeme:<br />

1. System :<br />

Dem Benutzer werden kleine Mikrofone an den Ohren angebracht, welche die empfangenen<br />

Daten dann an einen Rechner weitergeben. Dieser wiederum paßt den Ton an das jeweilige<br />

Hörmuster an. Dies nennt man auch kopfbezogene Umwandlungsfunktion. Durch kopfbezogene<br />

Umwandlungsfunktionen, Modulation bzw. Modifizierung durch mathematische Gleichungen in<br />

Echtzeit, kann dem Benutzer ein "realer" Klang in einem Raum vermittelt werden. Die Ortung<br />

des Kopfes im Raum geschieht durch einen Pholemus-Magnetsensor.

2.System :<br />