Multimodale Segmentierung und Klassifikation zerebraler Läsionen ...

Multimodale Segmentierung und Klassifikation zerebraler Läsionen ...

Multimodale Segmentierung und Klassifikation zerebraler Läsionen ...

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

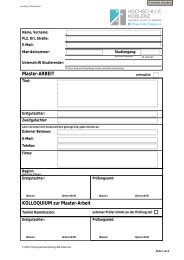

Methoden 9<br />

Ausgangspunkt:<br />

viele Objekte, viele Daten → unübersichtlich<br />

Variablen der Ausgangsmatrix: V1 V2 V3 V4 V5 V6 V7 V8 V9 V10<br />

Ziel<br />

wenige unabhängige Variablen → übersichtlich<br />

V 1V 3V 9<br />

<br />

Komponente1<br />

V 2V 4V 5V 10<br />

<br />

Komponente2<br />

V 6V 7V 8<br />

<br />

Komponente3<br />

Jedes Objekt wird beschrieben → Datenreduktion<br />

Abbildung 5: PCA Prinzip [10].<br />

erwartungstreue Aussagen aus multivariaten Analysemethoden, wie die Hauptkomponentenanaly-<br />

se oder Diskriminanzanalyse, ziehen zu können. Einen solchen robusten Schätzer liefert die die<br />

Minimum Covariance Determinant(MCD) Methode [13].<br />

3.3.2 Methode<br />

Der Ansatz von MCD ist es, h aus n Beobachtungen zu finden, deren Kovarianzmatrix die<br />

kleinste Determinate besitzt. Im dreidimensionalen bestimmt die Determinante das Volumen<br />

eines Parallelepipeds <strong>und</strong> die Kovarianzmatrix beschreibt ein Ellipsoid. Daher kann man für die<br />

dreidimensionalen Daten der Arbeit sagen, dass das kleinste Volumen eines Ellipsoids gesucht<br />

wird. Die Methode sollte auch noch bei möglichst vielen Ausreißern funktionieren. In diesem<br />

Fall gilt für h:<br />

n<br />

2<br />

≤ h < n,<br />

so dass, wenn bis zu 50% der Daten Ausreißer sind, ein erwartungstreues Ergebnis gef<strong>und</strong>en<br />

werden kann. Darüber hinaus ermöglicht die Methode große Datenmengen schnell zu berechnen.<br />

Basis des Algorithmus ist Satz 1.<br />

Satz 1 (Basisschritt) Man betrachtet einen Datensatz Xn = (x1, ..., xn) von p-variaten Beobachtungen.<br />

Dabei ist H1 ⊂ (1, ..., n) mit |H1| = h. Man bestimmt T1 = 1 <br />

h i∈H1 xi <strong>und</strong><br />

S1 = 1 <br />

h i∈H1 (xi − T1) (xi − T1) ′ . Falls det(S1) = 0, können die relativen Distanzen bestimmt<br />

werden:<br />

9