Untitled - WWW Ircam

Untitled - WWW Ircam

Untitled - WWW Ircam

- No tags were found...

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

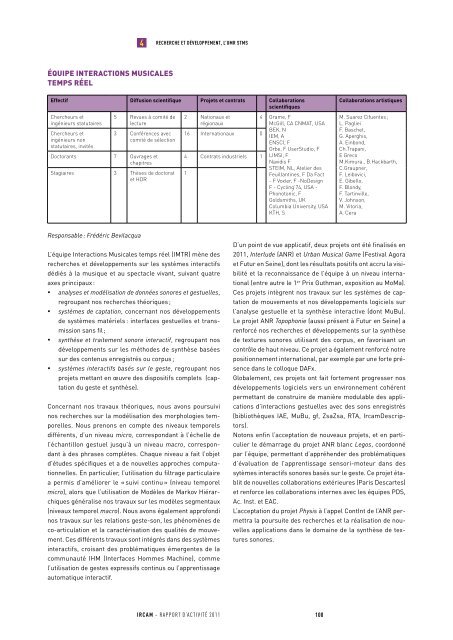

4 RECHERCHE ET DÉVELOPPEMENT, L’UMR STMS<br />

ÉQUIPE INTERACTIONS MUSICALES<br />

TEMPS RÉEL<br />

Effectif Diffusion scientifique Projets et contrats Collaborations<br />

scientifiques<br />

Collaborations artistiques<br />

Chercheurs et<br />

ingénieurs statutaires<br />

Chercheurs et<br />

ingénieurs non<br />

statutaires, invités<br />

5 Revues à comité de<br />

lecture<br />

3 Conférences avec<br />

comité de sélection<br />

Doctorants 7 Ouvrages et<br />

chapitres<br />

Stagiaires 3 Thèses de doctorat<br />

et HDR<br />

2 Nationaux et<br />

régionaux<br />

16 Internationaux 0<br />

4 Contrats industriels 1<br />

1<br />

4 Grame, F<br />

McGill, CA CNMAT, USA<br />

BEK, N<br />

IEM, A<br />

ENSCI, F<br />

Orbe, F UserStudio, F<br />

LIMSI, F<br />

Navidis F<br />

STEIM, NL, Atelier des<br />

Feuillantines, F Da Fact<br />

- F Voxler, F -NoDesign<br />

F - Cycling’74, USA -<br />

Phonotonic, F<br />

Goldsmiths, UK<br />

Columbia University, USA<br />

KTH, S<br />

M. Suarez Cifuentes ;<br />

L. Pagliei<br />

F. Baschet,<br />

G. Aperghis,<br />

A. Einbond,<br />

Ch.Trapani,<br />

E Greco<br />

M.Kimura., B.Hackbarth,<br />

C.Graupner,<br />

F. Leibovici,<br />

E. Gibello,<br />

F. Blondy,<br />

F. Tartinville,<br />

V. Johnson,<br />

M. Vitoria,<br />

A. Cera<br />

Responsable : Frédéric Bevilacqua<br />

L’équipe Interactions Musicales temps réel (IMTR) mène des<br />

recherches et développements sur les systèmes interactifs<br />

dédiés à la musique et au spectacle vivant, suivant quatre<br />

axes principaux :<br />

• analyses et modélisation de données sonores et gestuelles,<br />

regroupant nos recherches théoriques ;<br />

• systèmes de captation, concernant nos développements<br />

de systèmes matériels : interfaces gestuelles et transmission<br />

sans fil ;<br />

• synthèse et traitement sonore interactif, regroupant nos<br />

développements sur les méthodes de synthèse basées<br />

sur des contenus enregistrés ou corpus ;<br />

• systèmes interactifs basés sur le geste, regroupant nos<br />

projets mettant en œuvre des dispositifs complets (captation<br />

du geste et synthèse).<br />

Concernant nos travaux théoriques, nous avons poursuivi<br />

nos recherches sur la modélisation des morphologies temporelles.<br />

Nous prenons en compte des niveaux temporels<br />

différents, d’un niveau micro, correspondant à l’échelle de<br />

l’échantillon gestuel jusqu’à un niveau macro, correspondant<br />

à des phrases complètes. Chaque niveau a fait l’objet<br />

d’études spécifiques et a de nouvelles approches computationnelles.<br />

En particulier, l’utilisation du filtrage particulaire<br />

a permis d’améliorer le « suivi continu » (niveau temporel<br />

micro), alors que l’utilisation de Modèles de Markov Hiérarchiques<br />

généralise nos travaux sur les modèles segmentaux<br />

(niveaux temporel macro). Nous avons également approfondi<br />

nos travaux sur les relations geste-son, les phénomènes de<br />

co-articulation et la caractérisation des qualités de mouvement.<br />

Ces différents travaux sont intégrés dans des systèmes<br />

interactifs, croisant des problématiques émergentes de la<br />

communauté IHM (Interfaces Hommes Machine), comme<br />

l’utilisation de gestes expressifs continus ou l’apprentissage<br />

automatique interactif.<br />

D’un point de vue applicatif, deux projets ont été finalisés en<br />

2011, Interlude (ANR) et Urban Musical Game (Festival Agora<br />

et Futur en Seine), dont les résultats positifs ont accru la visibilité<br />

et la reconnaissance de l’équipe à un niveau international<br />

(entre autre le 1 er Prix Guthman, exposition au MoMa).<br />

Ces projets intègrent nos travaux sur les systèmes de captation<br />

de mouvements et nos développements logiciels sur<br />

l’analyse gestuelle et la synthèse interactive (dont MuBu).<br />

Le projet ANR Topophonie (aussi présent à Futur en Seine) a<br />

renforcé nos recherches et développements sur la synthèse<br />

de textures sonores utilisant des corpus, en favorisant un<br />

contrôle de haut niveau. Ce projet a également renforcé notre<br />

positionnement international, par exemple par une forte présence<br />

dans le colloque DAFx.<br />

Globalement, ces projets ont fait fortement progresser nos<br />

développements logiciels vers un environnement cohérent<br />

permettant de construire de manière modulable des applications<br />

d’interactions gestuelles avec des sons enregistrés<br />

(bibliothèques IAE, MuBu, gf, ZsaZsa, RTA, <strong>Ircam</strong>Descriptors).<br />

Notons enfin l’acceptation de nouveaux projets, et en particulier<br />

le démarrage du projet ANR blanc Legos, coordonné<br />

par l’équipe, permettant d’appréhender des problématiques<br />

d’évaluation de l’apprentissage sensori-moteur dans des<br />

sytèmes interactifs sonores basés sur le geste. Ce projet établit<br />

de nouvelles collaborations extérieures (Paris Descartes)<br />

et renforce les collaborations internes avec les équipes PDS,<br />

Ac. Inst. et EAC.<br />

L’acceptation du projet Physis à l’appel ContInt de l’ANR permettra<br />

la poursuite des recherches et la réalisation de nouvelles<br />

applications dans le domaine de la synthèse de textures<br />

sonores.<br />

IRCAM – RAPPORT D’ACTIVITÉ 2011<br />

100