ÐеÑÑник ÐТУ Ð¥ÐÐ_55 2010_ÐÑигинал_Ð¼Ð°ÐºÐµÑ - ÐаÑково-ÑÐµÑ Ð½ÑÑна ...

ÐеÑÑник ÐТУ Ð¥ÐÐ_55 2010_ÐÑигинал_Ð¼Ð°ÐºÐµÑ - ÐаÑково-ÑÐµÑ Ð½ÑÑна ...

ÐеÑÑник ÐТУ Ð¥ÐÐ_55 2010_ÐÑигинал_Ð¼Ð°ÐºÐµÑ - ÐаÑково-ÑÐµÑ Ð½ÑÑна ...

- No tags were found...

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

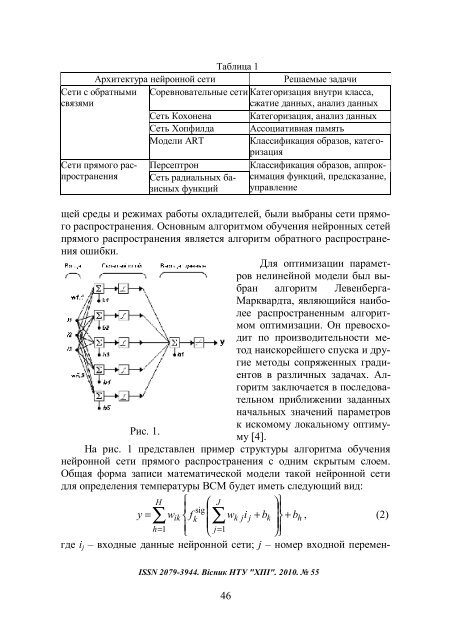

Таблица 1Архитектура нейронной сетиРешаемые задачиСети с обратными Соревновательные сети Категоризация внутри класса,связямисжатие данных, анализ данныхСеть Кохонена Категоризация, анализ данныхСеть Хопфилда Ассоциативная памятьМодели ART Классификация образов, категоризацияСети прямого распространенияПерсептронСеть радиальных базисныхфункцийКлассификация образов, аппроксимацияфункций, предсказание,управлениещей среды и режимах работы охладителей, были выбраны сети прямогораспространения. Основным алгоритмом обучения нейронных сетейпрямого распространения является алгоритм обратного распространенияошибки.Для оптимизации параметровнелинейной модели был выбраналгоритм Левенберга-Марквардта, являющийся наиболеераспространенным алгоритмомоптимизации. Он превосходитпо производительности методнаискорейшего спуска и другиеметоды сопряженных градиентовв различных задачах. Алгоритмзаключается в последовательномприближении заданныхначальных значений параметровРис. 1.к искомому локальному оптимуму[4].На рис. 1 представлен пример структуры алгоритма обучениянейронной сети прямого распространения с одним скрытым слоем.Общая форма записи математической модели такой нейронной сетидля определения температуры ВСМ будет иметь следующий вид:H ⎧ ⎛ J ⎞⎫⎪ sig⎪y⎟= ∑ w⎜ik ⎨ fk∑ ⎬ + ,= 1 ⎪⎜wkjij + bk⎟bh(2)h ⎩ ⎝ j=1 ⎠⎪⎭где i j – входные данные нейронной сети; j – номер входной перемен-ISSN 2079-3944. Вісник НТУ "ХПІ". <strong>2010</strong>. № <strong>55</strong>46