Create successful ePaper yourself

Turn your PDF publications into a flip-book with our unique Google optimized e-Paper software.

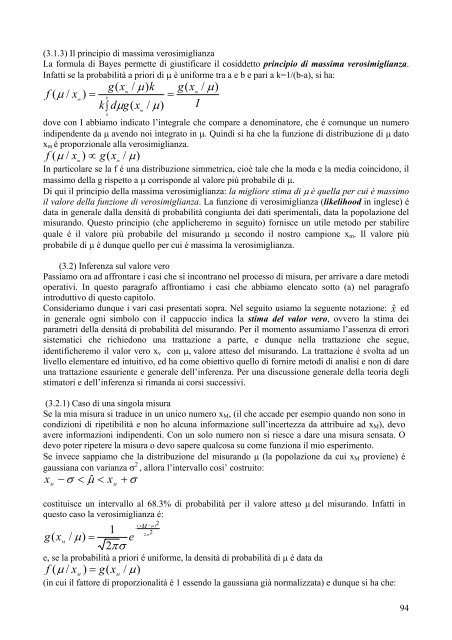

(3.1.3) Il principio di massima verosimiglianza<br />

La formula di Bayes permette di giustificare il cosiddetto principio di massima verosimiglianza.<br />

Infatti se la probabilità a priori di μ è uniforme tra a e b e pari a k=1/(b-a), si ha:<br />

g(<br />

x / μ)<br />

k<br />

m<br />

f ( μ / x ) =<br />

m<br />

b<br />

=<br />

k ∫ dμg(<br />

x / μ)<br />

a<br />

m<br />

g(<br />

x / μ)<br />

m<br />

I<br />

dove con I abbiamo indicato l’integrale che compare a denominatore, che é comunque un numero<br />

indipendente da μ avendo noi integrato in μ. Quindi si ha che la funzione di distribuzione di μ dato<br />

x m é proporzionale alla verosimiglianza.<br />

f ( μ / x ) ∝ g(<br />

x / μ)<br />

m<br />

m<br />

In particolare se la f é una distribuzione simmetrica, cioè tale che la moda e la media coincidono, il<br />

massimo della g rispetto a μ corrisponde al valore più probabile di μ.<br />

Di qui il principio della massima verosimiglianza: la migliore stima di μ è quella per cui é massimo<br />

il valore della funzione di verosimiglianza. La funzione di verosimiglianza (likelihood in inglese) é<br />

data in generale dalla densità di probabilità congiunta dei dati sperimentali, data la popolazione del<br />

misurando. Questo principio (che applicheremo in seguito) fornisce un utile metodo per stabilire<br />

quale é il valore più probabile del misurando μ secondo il nostro campione x m . Il valore più<br />

probabile di μ è dunque quello per cui é massima la verosimiglianza.<br />

(3.2) Inferenza sul valore vero<br />

Passiamo ora ad affrontare i casi che si incontrano nel processo di misura, per arrivare a dare metodi<br />

operativi. In questo paragrafo affrontiamo i casi che abbiamo elencato sotto (a) nel paragrafo<br />

introduttivo di questo capitolo.<br />

Consideriamo dunque i vari casi presentati sopra. Nel seguito usiamo la seguente notazione: xˆ ed<br />

in generale ogni simbolo con il cappuccio indica la stima del valor vero, ovvero la stima dei<br />

parametri della densità di probabilità del misurando. Per il momento assumiamo l’assenza di errori<br />

sistematici che richiedono una trattazione a parte, e dunque nella trattazione che segue,<br />

identificheremo il valor vero x v con μ, valore atteso del misurando. La trattazione é svolta ad un<br />

livello elementare ed intuitivo, ed ha come obiettivo quello di fornire metodi di analisi e non di dare<br />

una trattazione esauriente e generale dell’inferenza. Per una discussione generale della teoria degli<br />

stimatori e dell’inferenza si rimanda ai corsi successivi.<br />

(3.2.1) Caso di una singola misura<br />

Se la mia misura si traduce in un unico numero x M , (il che accade per esempio quando non sono in<br />

condizioni di ripetibilità e non ho alcuna informazione sull’incertezza da attribuire ad x M ), devo<br />

avere informazioni indipendenti. Con un solo numero non si riesce a dare una misura sensata. O<br />

devo poter ripetere la misura o devo sapere qualcosa su come funziona il mio esperimento.<br />

Se invece sappiamo che la distribuzione del misurando μ (la popolazione da cui x M proviene) é<br />

gaussiana con varianza σ 2 , allora l’intervallo cosi’ costruito:<br />

x − σ < ˆ μ < x + σ<br />

M<br />

M<br />

costituisce un intervallo al 68.3% di probabilità per il valore atteso μ del misurando. Infatti in<br />

questo caso la verosimiglianza é:<br />

g<br />

1<br />

2πσ<br />

xM −μ<br />

)<br />

2<br />

2<br />

(<br />

−<br />

2σ<br />

( x M<br />

/ ) = e<br />

μ<br />

e, se la probabilità a priori é uniforme, la densità di probabilità di μ è data da<br />

f ( μ / x ) = g(<br />

x / μ)<br />

M<br />

M<br />

(in cui il fattore di proporzionalità é 1 essendo la gaussiana già normalizzata) e dunque si ha che:<br />

94