Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

6 Einleitung<br />

In der folgenden Gleichung (14) wird nicht nach jedem x angepasst, sondern es werden<br />

zunächst alle zum Datensatz gehörenden Gradienten bei festem Parametersatz<br />

gemittelt,<br />

wr(t+1) = wr(t) + ε 〈∇wrE(W(t),x)〉 X . (14)<br />

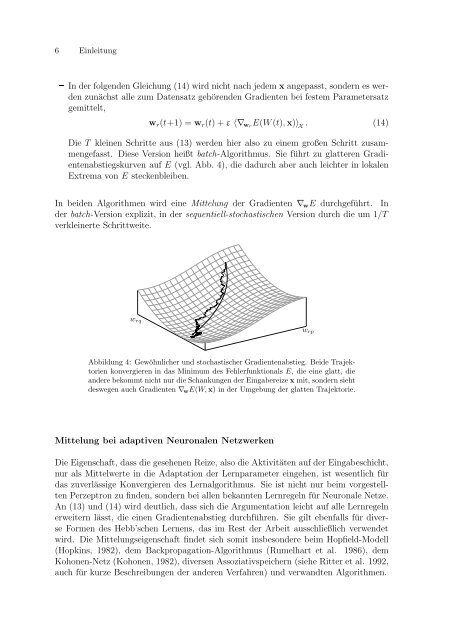

Die T kleinen Schritte aus (13) werden hier also zu einem großen Schritt zusammengefasst.<br />

Diese Version heißt batch-Algorithmus. Sie führt zu glatteren Gradientenabstiegskurven<br />

auf E (vgl. Abb. 4), die dadurch aber auch leichter in lokalen<br />

Extrema <strong>von</strong> E steckenbleiben.<br />

In beiden Algorithmen wird eine Mittelung der Gradienten ∇wE durchgeführt. In<br />

der batch-Version explizit, in der sequentiell-stochastischen Version durch die um 1/T<br />

verkleinerte Schrittweite.<br />

wrq<br />

Abbildung 4: Gewöhnlicher und stochastischer Gradientenabstieg. Beide Trajektorien<br />

konvergieren in das Minimum des Fehlerfunktionals E, die eine glatt, die<br />

andere bekommt nicht nur die Schankungen der Eingabereize x mit, sondern sieht<br />

deswegen auch Gradienten ∇wE(W,x) in der Umgebung der glatten Trajektorie.<br />

Mittelung bei adaptiven Neuronalen Netzwerken<br />

Die Eigenschaft, dass die gesehenen Reize, also die Aktivitäten auf der Eingabeschicht,<br />

nur als Mittelwerte in die Adaptation der Lernparameter eingehen, ist wesentlich für<br />

das zuverlässige Konvergieren des Lernalgorithmus. Sie ist nicht nur beim vorgestellten<br />

Perzeptron zu finden, sondern bei allen bekannten Lernregeln für Neuronale Netze.<br />

An (13) und (14) wird deutlich, dass sich die Argumentation leicht auf alle Lernregeln<br />

erweitern lässt, die einen Gradientenabstieg durchführen. Sie gilt ebenfalls für diverse<br />

Formen des Hebb’schen Lernens, das im Rest der Arbeit ausschließlich verwendet<br />

wird. Die Mittelungseigenschaft findet sich somit insbesondere beim Hopfield-Modell<br />

(Hopkins, 1982), dem Backpropagation-Algorithmus (Rumelhart et al. 1986), dem<br />

Kohonen-Netz (Kohonen, 1982), diversen Assoziativspeichern (siehe Ritter et al. 1992,<br />

auch für kurze Beschreibungen der anderen Verfahren) und verwandten Algorithmen.<br />

wrp