Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

αǫA<br />

a b c<br />

−1 0 1 x/σS<br />

Ein System mit mehr als einer Zeitskala<br />

4.2 Das Verhalten des ANTS 91<br />

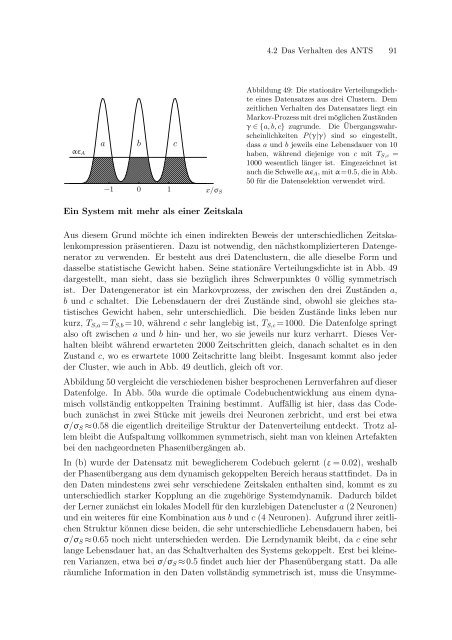

Abbildung 49: Die stationäre Verteilungsdichte<br />

eines Datensatzes aus drei Clustern. Dem<br />

zeitlichen Verhalten des Datensatzes liegt ein<br />

Markov-Prozess mit drei möglichen Zuständen<br />

γ ∈ {a, b, c} zugrunde. Die Übergangswahrscheinlichkeiten<br />

P(γ|γ) sind so eingestellt,<br />

dass a und b jeweils eine Lebensdauer <strong>von</strong> 10<br />

haben, während diejenige <strong>von</strong> c mit TS,c =<br />

1000 wesentlich länger ist. Eingezeichnet ist<br />

auch die Schwelle αǫA, mit α=0.5, die in Abb.<br />

50 für die Datenselektion verwendet wird.<br />

Aus diesem Grund möchte ich einen indirekten Beweis der unterschiedlichen Zeitskalenkompression<br />

präsentieren. Dazu ist notwendig, den nächstkomplizierteren Datengenerator<br />

zu verwenden. Er besteht aus drei Datenclustern, die alle dieselbe Form und<br />

dasselbe statistische Gewicht haben. Seine stationäre Verteilungsdichte ist in Abb. 49<br />

dargestellt, man sieht, dass sie bezüglich ihres Schwerpunktes 0 völlig symmetrisch<br />

ist. Der Datengenerator ist ein Markovprozess, der zwischen den drei Zuständen a,<br />

b und c schaltet. Die Lebensdauern der drei Zustände sind, obwohl sie gleiches statistisches<br />

Gewicht haben, sehr unterschiedlich. Die beiden Zustände links leben nur<br />

kurz, TS,a=TS,b=10, während c sehr langlebig ist, TS,c=1000. Die Datenfolge springt<br />

also oft zwischen a und b hin- und her, wo sie jeweils nur kurz verharrt. Dieses Verhalten<br />

bleibt während erwarteten 2000 Zeitschritten gleich, danach schaltet es in den<br />

Zustand c, wo es erwartete 1000 Zeitschritte lang bleibt. Insgesamt kommt also jeder<br />

der Cluster, wie auch in Abb. 49 deutlich, gleich oft vor.<br />

Abbildung 50 vergleicht die verschiedenen bisher besprochenen Lernverfahren auf dieser<br />

Datenfolge. In Abb. 50a wurde die optimale Codebuchentwicklung aus einem dynamisch<br />

vollständig entkoppelten Training bestimmt. Auffällig ist hier, dass das Codebuch<br />

zunächst in zwei Stücke mit jeweils drei Neuronen zerbricht, und erst bei etwa<br />

σ/σS ≈0.58 die eigentlich dreiteilige Struktur der Datenverteilung entdeckt. Trotz allem<br />

bleibt die Aufspaltung vollkommen symmetrisch, sieht man <strong>von</strong> kleinen Artefakten<br />

bei den nachgeordneten Phasenübergängen ab.<br />

In (b) wurde der Datensatz mit beweglicherem Codebuch gelernt (ε = 0.02), weshalb<br />

der Phasenübergang aus dem dynamisch gekoppelten Bereich heraus stattfindet. Da in<br />

den Daten mindestens zwei sehr verschiedene Zeitskalen enthalten sind, kommt es zu<br />

unterschiedlich starker Kopplung an die zugehörige Systemdynamik. Dadurch bildet<br />

der Lerner zunächst ein lokales Modell für den kurzlebigen Datencluster a (2 Neuronen)<br />

und ein weiteres für eine Kombination aus b und c (4 Neuronen). Aufgrund ihrer zeitlichen<br />

Struktur können diese beiden, die sehr unterschiedliche Lebensdauern haben, bei<br />

σ/σS ≈0.65 noch nicht unterschieden werden. Die Lerndynamik bleibt, da c eine sehr<br />

lange Lebensdauer hat, an das Schaltverhalten des Systems gekoppelt. Erst bei kleineren<br />

Varianzen, etwa bei σ/σS ≈0.5 findet auch hier der Phasenübergang statt. Da alle<br />

räumliche Information in den Daten vollständig symmetrisch ist, muss die Unsymme-