Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

44 2. On-line Lernen mit univar<br />

0 t ′ −→ t<br />

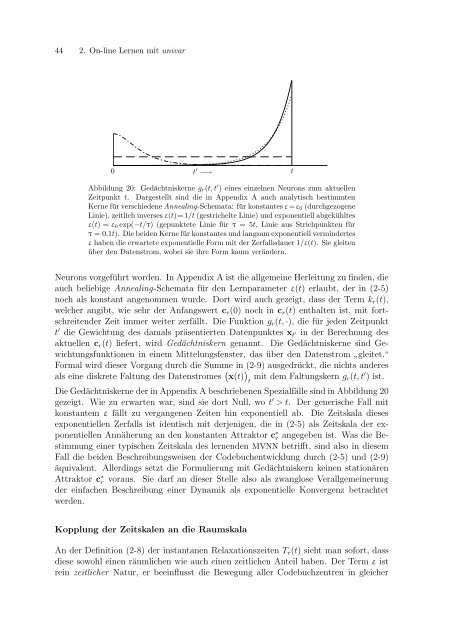

Abbildung 20: Gedächtniskerne gr(t, t ′ ) eines einzelnen Neurons zum aktuellen<br />

Zeitpunkt t. Dargestellt sind die in Appendix A auch analytisch bestimmten<br />

Kerne für verschiedene Annealing-Schemata: für konstantes ε=ε0 (durchgezogene<br />

Linie), zeitlich inverses ε(t)=1/t (gestrichelte Linie) und exponentiell abgekühltes<br />

ε(t) = ε0 exp(−t/τ) (gepunktete Linie für τ = 5t, Linie aus Strichpunkten für<br />

τ = 0.1t). Die beiden Kerne für konstantes und langsam exponentiell vermindertes<br />

ε haben die erwartete exponentielle Form mit der Zerfallsdauer 1/ε(t). Sie gleiten<br />

über den Datenstrom, wobei sie ihre Form kaum verändern.<br />

Neurons vorgeführt worden. In Appendix A ist die allgemeine Herleitung zu finden, die<br />

auch beliebige Annealing-Schemata für den Lernparameter ε(t) erlaubt, der in (2-5)<br />

noch als konstant angenommen wurde. Dort wird auch gezeigt, dass der Term kr(t),<br />

welcher angibt, wie sehr der Anfangswert cr(0) noch in cr(t) enthalten ist, mit fort-<br />

schreitender Zeit immer weiter zerfällt. Die Funktion gr(t, ·), die für jeden Zeitpunkt<br />

t ′ die Gewichtung des damals präsentierten Datenpunktes xt ′ in der Berechnung des<br />

aktuellen cr(t) liefert, wird Gedächtniskern genannt. Die Gedächtniskerne sind Gewichtungsfunktionen<br />

in einem Mittelungsfenster, das über den Datenstrom gleitet.“<br />

”<br />

Formal wird dieser Vorgang durch die Summe in (2-9) ausgedrückt, die nichts anderes<br />

als eine diskrete Faltung des Datenstromes � x(t) �<br />

t mit dem Faltungskern gr(t, t ′ ) ist.<br />

Die Gedächtniskerne der in Appendix A beschriebenen Spezialfälle sind in Abbildung 20<br />

gezeigt. Wie zu erwarten war, sind sie dort Null, wo t ′ > t. Der generische Fall mit<br />

konstantem ε fällt zu vergangenen Zeiten hin exponentiell ab. Die Zeitskala dieses<br />

exponentiellen Zerfalls ist identisch mit derjenigen, die in (2-5) als Zeitskala der ex-<br />

angegeben ist. Was die Be-<br />

ponentiellen Annäherung an den konstanten Attraktor c∗ r<br />

stimmung einer typischen Zeitskala des lernenden MVNN betrifft, sind also in diesem<br />

Fall die beiden Beschreibungsweisen der Codebuchentwicklung durch (2-5) und (2-9)<br />

äquivalent. Allerdings setzt die Formulierung mit Gedächtniskern keinen stationären<br />

Attraktor c∗ r voraus. Sie darf an dieser Stelle also als zwanglose Verallgemeinerung<br />

der einfachen Beschreibung einer Dynamik als exponentielle Konvergenz betrachtet<br />

werden.<br />

Kopplung der Zeitskalen an die Raumskala<br />

An der Definition (2-8) der instantanen Relaxationszeiten Tr(t) sieht man sofort, dass<br />

diese sowohl einen räumlichen wie auch einen zeitlichen Anteil haben. Der Term ε ist<br />

rein zeitlicher Natur, er beeinflusst die Bewegung aller Codebuchzentren in gleicher