Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Diplomarbeit von Michael Schindler

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

4.2 Das Verhalten des ANTS 89<br />

die gerade so eingestellt ist, dass der Anteil α = 0.3 gelernt wird. Man sieht hier,<br />

dass der Lernprozess zu denjenigen Zeitpunkten gestoppt wird, an denen die Aktivität<br />

A(x) = A(±1) gerade den Schwellwert ǫA erreicht (Pfeil). Dadurch ergibt sich eine<br />

ähnliche Verkürzung der Lebensdauern im System wie sie in Abb. 7 angedacht worden<br />

war. Die gelernten Datenpunkte sind schwarz bei (±1) eingezeichnet.<br />

In Teil (c) <strong>von</strong> Abb. 47 wird die Schwelle nach der Update-Regel (4-7) so variiert, dass<br />

sich insgesamt wieder ein Anteil α = 0.3 einstellt. Während des schnellen Lernprozesses<br />

am Anfang jeder Lebensdauer sinkt die Schwelle ǫA deshalb ständig, bis der<br />

Lerner sie zum erstenmal überschreitet und ” anstößt“ (Pfeil). Danach wird sie immer<br />

wieder leicht nach oben korrigiert, der Lerner kann demnach immer wieder ein paar<br />

Datenpunkte lernen, jedoch nicht alle. Die Schwelle wird hier abwechselnd unter- und<br />

überschritten (in Abb. 47c grau eingezeichnete Datenpunkte).<br />

Sowohl in Abb. 47b als auch in 47c ist das Parameterpaar (σ/σS, τS)=(0.8, 5.0) auf der<br />

aufgespaltenen Seite des Phasenüberganges. Dies wird nicht nur aus Abb. 46 deutlich,<br />

sondern ist auch direkt an den Codebuchentwicklungen abzulesen. Die sechs Codebuchzentren<br />

entfernen sich in jeder Datenperiode weiter <strong>von</strong> einander, im Gegensatz<br />

zu Abb. 47a, wo dieselben Lernparameter (σ, ε) verwendet wurden, aber keine Aufspaltung<br />

stattfindet.<br />

4.2.4 Dynamikentkopplung durch unterschiedliche Zeitskalenkompression<br />

Mit den oben beschriebenen Situationen, in denen zwei Datencluster mit gleichen statistischen<br />

Gewichten verwendet wurden, konnten zwei Eigenschaften des ANTS verdeutlicht<br />

werden. In Abb. 46 ist die Entkopplung <strong>von</strong> Lern- und Systemdynamik zu<br />

sehen, in Abb. 47 die Tatsache, dass Phasenübergänge früher auftreten und deshalb<br />

wieder hierarchisch geordnet sein können.<br />

Sie zeigen noch nicht deutlich genug die Fähigkeit des ANTS, auf unterschiedliche Zeit-<br />

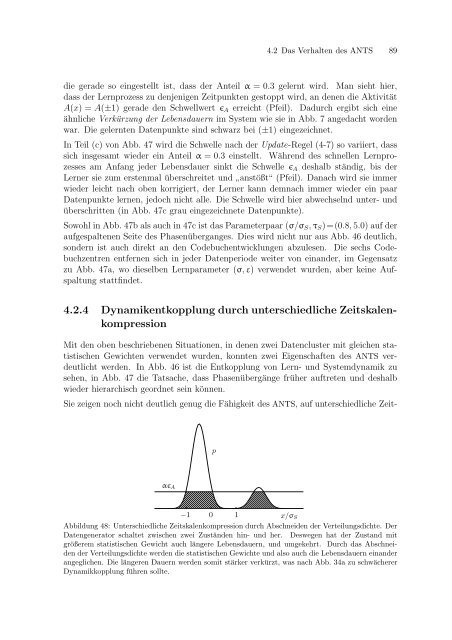

αǫA<br />

p<br />

−1 0 1 x/σS<br />

Abbildung 48: Unterschiedliche Zeitskalenkompression durch Abschneiden der Verteilungsdichte. Der<br />

Datengenerator schaltet zwischen zwei Zuständen hin- und her. Deswegen hat der Zustand mit<br />

größerem statistischen Gewicht auch längere Lebensdauern, und umgekehrt. Durch das Abschneiden<br />

der Verteilungsdichte werden die statistischen Gewichte und also auch die Lebensdauern einander<br />

angeglichen. Die längeren Dauern werden somit stärker verkürzt, was nach Abb. 34a zu schwächerer<br />

Dynamikkopplung führen sollte.