Appunti di Teoria dell'Informazione e Codici - Università di Palermo

Appunti di Teoria dell'Informazione e Codici - Università di Palermo

Appunti di Teoria dell'Informazione e Codici - Università di Palermo

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

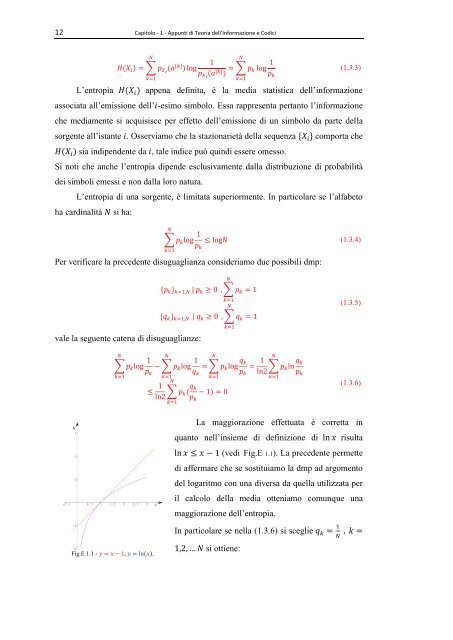

12 Capitolo - 1 - <strong>Appunti</strong> <strong>di</strong> <strong>Teoria</strong> dell’Informazione e Co<strong>di</strong>ci<br />

( ) ∑ ( )<br />

( )<br />

∑ (1.3.3)<br />

L’entropia ( ) appena definita, è la me<strong>di</strong>a statistica dell’informazione<br />

associata all’emissione dell’ -esimo simbolo. Essa rappresenta pertanto l’informazione<br />

che me<strong>di</strong>amente si acquisisce per effetto dell’emissione <strong>di</strong> un simbolo da parte della<br />

sorgente all’istante . Osserviamo che la stazionarietà della sequenza comporta che<br />

( ) sia in<strong>di</strong>pendente da , tale in<strong>di</strong>ce può quin<strong>di</strong> essere omesso.<br />

Si noti che anche l’entropia <strong>di</strong>pende esclusivamente dalla <strong>di</strong>stribuzione <strong>di</strong> probabilità<br />

dei simboli emessi e non dalla loro natura.<br />

L’entropia <strong>di</strong> una sorgente, è limitata superiormente. In particolare se l’alfabeto<br />

ha car<strong>di</strong>nalità si ha:<br />

∑ (1.3.4)<br />

Per verificare la precedente <strong>di</strong>suguaglianza consideriamo due possibili dmp:<br />

∑<br />

∑<br />

(1.3.5)<br />

vale la seguente catena <strong>di</strong> <strong>di</strong>suguaglianze:<br />

∑ ∑ ∑ ∑<br />

∑ ( )<br />

(1.3.6)<br />

La maggiorazione effettuata è corretta in<br />

quanto nell’insieme <strong>di</strong> definizione <strong>di</strong> risulta<br />

(ve<strong>di</strong> Fig.E 1.1). La precedente permette<br />

<strong>di</strong> affermare che se sostituiamo la dmp ad argomento<br />

del logaritmo con una <strong>di</strong>versa da quella utilizzata per<br />

il calcolo della me<strong>di</strong>a otteniamo comunque una<br />

maggiorazione dell’entropia.<br />

In particolare se nella (1.3.6) si sceglie<br />

Fig.E 1.1 - y x , y (x).<br />

si ottiene: