Mélanges de GLMs et nombre de composantes : application ... - Scor

Mélanges de GLMs et nombre de composantes : application ... - Scor

Mélanges de GLMs et nombre de composantes : application ... - Scor

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

3.2. Cas pratique d’utilisation <strong>de</strong> mélange <strong>de</strong> Logit<br />

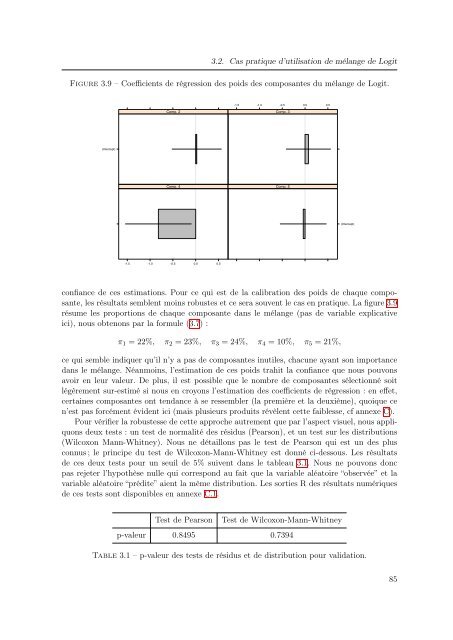

Figure 3.9 – Coefficients <strong>de</strong> régression <strong>de</strong>s poids <strong>de</strong>s <strong>composantes</strong> du mélange <strong>de</strong> Logit.<br />

-1.5 -1.0 -0.5 0.0 0.5<br />

Comp. 2<br />

Comp. 3<br />

(Intercept)<br />

Comp. 4<br />

Comp. 5<br />

(Intercept)<br />

-1.5 -1.0 -0.5 0.0 0.5<br />

confiance <strong>de</strong> ces estimations. Pour ce qui est <strong>de</strong> la calibration <strong>de</strong>s poids <strong>de</strong> chaque composante,<br />

les résultats semblent moins robustes <strong>et</strong> ce sera souvent le cas en pratique. La figure 3.9<br />

résume les proportions <strong>de</strong> chaque composante dans le mélange (pas <strong>de</strong> variable explicative<br />

ici), nous obtenons par la formule (3.7) :<br />

π 1 = 22%, π 2 = 23%, π 3 = 24%, π 4 = 10%, π 5 = 21%,<br />

ce qui semble indiquer qu’il n’y a pas <strong>de</strong> <strong>composantes</strong> inutiles, chacune ayant son importance<br />

dans le mélange. Néanmoins, l’estimation <strong>de</strong> ces poids trahit la confiance que nous pouvons<br />

avoir en leur valeur. De plus, il est possible que le <strong>nombre</strong> <strong>de</strong> <strong>composantes</strong> sélectionné soit<br />

légèrement sur-estimé si nous en croyons l’estimation <strong>de</strong>s coefficients <strong>de</strong> régression : en eff<strong>et</strong>,<br />

certaines <strong>composantes</strong> ont tendance à se ressembler (la première <strong>et</strong> la <strong>de</strong>uxième), quoique ce<br />

n’est pas forcément évi<strong>de</strong>nt ici (mais plusieurs produits révèlent c<strong>et</strong>te faiblesse, cf annexe C).<br />

Pour vérifier la robustesse <strong>de</strong> c<strong>et</strong>te approche autrement que par l’aspect visuel, nous appliquons<br />

<strong>de</strong>ux tests : un test <strong>de</strong> normalité <strong>de</strong>s résidus (Pearson), <strong>et</strong> un test sur les distributions<br />

(Wilcoxon Mann-Whitney). Nous ne détaillons pas le test <strong>de</strong> Pearson qui est un <strong>de</strong>s plus<br />

connus ; le principe du test <strong>de</strong> Wilcoxon-Mann-Whitney est donné ci-<strong>de</strong>ssous. Les résultats<br />

<strong>de</strong> ces <strong>de</strong>ux tests pour un seuil <strong>de</strong> 5% suivent dans le tableau 3.1. Nous ne pouvons donc<br />

pas rej<strong>et</strong>er l’hypothèse nulle qui correspond au fait que la variable aléatoire “observée” <strong>et</strong> la<br />

variable aléatoire “prédite” aient la même distribution. Les sorties R <strong>de</strong>s résultats numériques<br />

<strong>de</strong> ces tests sont disponibles en annexe C.1.<br />

Test <strong>de</strong> Pearson Test <strong>de</strong> Wilcoxon-Mann-Whitney<br />

p-valeur 0.8495 0.7394<br />

Table 3.1 – p-valeur <strong>de</strong>s tests <strong>de</strong> résidus <strong>et</strong> <strong>de</strong> distribution pour validation.<br />

85