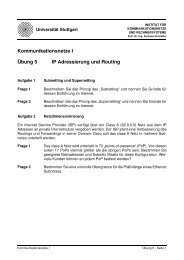

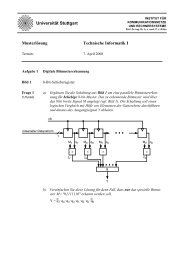

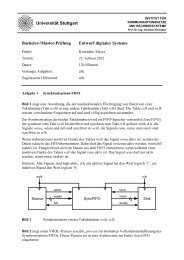

Institut für Kommunikationsnetze und Rechnersysteme - Universität ...

Institut für Kommunikationsnetze und Rechnersysteme - Universität ...

Institut für Kommunikationsnetze und Rechnersysteme - Universität ...

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

– 30 –<br />

Kommt ausschließlich diese Strategie zum Einsatz, ist keine Differenzierung möglich. Allerdings<br />

wird FIFO auch in Systemen mit Differenzierung in Kombination mit anderen Verfahren<br />

verwendet, <strong>und</strong> zwar zur Festlegung der Abarbeitungsreihenfolge <strong>für</strong> Pakete der gleichen<br />

Dienstgüteklasse, d. h. innerhalb einer logischen Warteschlange. Weitere Bedienstrategien<br />

ohne Differenzierung, die aber in der Praxis kaum eine Rolle spielen, sind LIFO (last in first<br />

out) <strong>und</strong> die zufällige Auswahl eines wartenden Pakets (random service).<br />

Die arbeitserhaltenden Scheduling-Verfahren, die zur Dienstgütedifferenzierung in Vermittlungsknoten<br />

eingesetzt werden, lassen sich – teilweise in Anlehnung an [119, 279] – weitgehend<br />

einer der nachfolgend beschriebenen Gruppen zuordnen. Ein alternatives Modell zur<br />

Charakterisierung <strong>und</strong> Klassifizierung von Scheduling-Mechanismen ist in [260] beschrieben.<br />

Statische Prioritäten<br />

Bei dieser sehr einfachen Strategie ist jeder logischen Warteschlange <strong>und</strong> somit jeder Dienstgüteklasse<br />

eine feste Verzögerungspriorität zugeordnet. Dies bedeutet, dass Pakete aus einer<br />

Klasse mit niedriger Priorität nur dann bedient werden, wenn sich in keiner der Warteschlangen<br />

mit höherer Priorität noch Pakete befinden. Somit erfahren Pakete der höchsten Priorität<br />

keinerlei Verzögerung durch niederpriore Pakete – abgesehen von einer Restbedienzeit, die<br />

aufgr<strong>und</strong> der nicht unterbrechbaren Bedienung (non-preemptive service) unvermeidbar ist.<br />

Verfahren zur fairen Aufteilung der Linkbandbreite<br />

Vorbild der Fair Queueing-Verfahren (FQ) ist ein Modell, das in [217] als Generalized Processor<br />

Sharing (GPS) 2 vorgestellt wurde <strong>und</strong> eine Erweiterung des aus der Modellierung von<br />

<strong>Rechnersysteme</strong>n bekannten Processor Sharing (PS) [155] darstellt. Gr<strong>und</strong>gedanke des auf<br />

einem Flüssigkeitsflussansatz (fluid flow model) beruhenden PS-Modells ist eine gleichmäßige<br />

Aufteilung der Rechenkapazität unter den aktiven Prozessen. Bei GPS treten an die Stelle der<br />

aktiven Prozesse diejenigen Warteschlangen, die nicht leer sind (backlogged queues). Im<br />

Gegensatz zu PS wird hier eine Gewichtung einzelner Warteschlangen vorgenommen, indem<br />

Gewichtungsparameter vergeben werden. Für die Rate R i<br />

() t , mit der die Warteschlange i<br />

zum Zeitpunkt t bedient wird, gilt dann [119]:<br />

φ i<br />

R i () t<br />

=<br />

⎧<br />

⎪<br />

⎪<br />

⎨<br />

⎪<br />

⎪<br />

⎩<br />

φ<br />

-------------------- i<br />

⋅ C i∈<br />

B()<br />

t<br />

φ j<br />

∑<br />

j∈<br />

B()<br />

t<br />

0 sonst<br />

(3.2)<br />

wobei Bt () die Menge der zum Zeitpunkt t nicht leeren Warteschlangen <strong>und</strong> C die Linkrate<br />

bezeichnen.<br />

2 Eine andere häufig hier<strong>für</strong> verwendete Bezeichnung ist FFQ (fluid flow fair queueing).