Thesis - RWTH Aachen University

Thesis - RWTH Aachen University

Thesis - RWTH Aachen University

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

30 2.3 Verfahren zur Koordination reaktiver Verhalten<br />

Die meisten dieser Ansätze wurden jedoch ausschließlich auf mobile Plattform zur Navigation getestet.<br />

Nur wenige, wie [Con89], [MA99], [PAKC00], [SvS00] und [Ste94], wurden auch auf mobilen<br />

Manipulatoren angewendet; sie implementieren dennoch nur die sequentielle Anwendung von Verhalten<br />

auf dem Manipulator.<br />

2.3.1 Das Arbitration-Prinzip<br />

Auf dem Arbitration-Prinzip aufbauende Mechanismen wählen ein einzelnes Verhalten aus und geben<br />

diesem die komplette Kontrolle über die Aktuatoren (Abbildung 2.18). Im nächsten Zeitschritt<br />

findet dann eine erneute Auswahl statt. Sei βj das ausgewählte Verhalten, dann gilt für Matrix G und<br />

Koordinierungsfunktion C:<br />

⎛<br />

⎞<br />

0 . . . 0 . . . 0<br />

⎜ .<br />

⎜ . .. .<br />

. .. ⎟<br />

. ⎟<br />

⎜<br />

⎟<br />

Garb = ⎜ 0 . . . gj . . . 0 ⎟<br />

⎜<br />

⎝<br />

..<br />

⎟<br />

. . . . ⎠<br />

0 . . . 0 . . . 0<br />

�ρ = Carb(Garb · � R) = Garb · � R<br />

Bezüglich des Kriteriums zur Verhaltensauswahl, also der Aufstellung der Matrix G wird zwischen<br />

Priority-based, State-based und Winner-takes-all basierten Mechanismen unterschieden. Beim Priority-based<br />

Verfahren erfolgt die Auswahl anhand eines fest einprogrammierten Prioritätsschemas<br />

[Bro86], [Con89], [Ste94], [GFZ00], [ANH95]. Systeme, die nach dem State-based Prinzip arbeiten,<br />

besitzen einen endlichen Zustandsautomaten, der das jeweils aktive Verhalten in seinen Zuständen<br />

kodiert [KB94], [FZ02], [Tan03], [KAHW00], [SIJ + 00], [PAKC00], [KD95]. Beim Winner-takes-all<br />

Mechanismus enthält der Verhaltensselektor ein so genanntes Aktivierungsnetzwerk, das anhand von<br />

Vorbedingungen ein Verhalten auswählt [Mae90], [FMB + 97], [AC96], [AUH99], [FPCR99].<br />

Die Systeme, die auf dem Arbitration-Prinzip basieren, zeigen ein robustes Verhalten, das die gestellten<br />

Aufgaben mit einer hohen Erfolgsrate lösen kann. Dennoch kann der Ansatz das System oft in<br />

lokale Minima führen, wenn die ausgeführte Aktion eines Verhaltens vom nächsten Verhalten aufgehoben<br />

wird und im nächsten Zeitschritt erneut aktiviert wird (Deadlock-Situation). Weiterhin können<br />

diese Verfahren zwei Fertigkeiten, die unterschiedliche Freiheitsgrade ansteuern, wie z.B. ein Hindernisvermeidungsverhalten<br />

für den Greifer und eins für die Segmente, nicht gleichzeitig anwenden,<br />

auch wenn beide in einer kritischen Situation notwendig sind. Sie haben zusätzlich den Nachteil, dass<br />

eine schnelle Ausführung der Fertigkeiten und ein schnelles Umschalten zwischen den Verhalten erforderlich<br />

sind, damit der Koordinationsmechanismus erfolgreich sein kann. Existieren im System<br />

rechenintensive Verhalten, wie z.B. die Hindernisvermeidung für einen Roboterarm, dann ist die Erfolgswahrscheinlichkeit<br />

bei Arbitration-Mechanismen gering.<br />

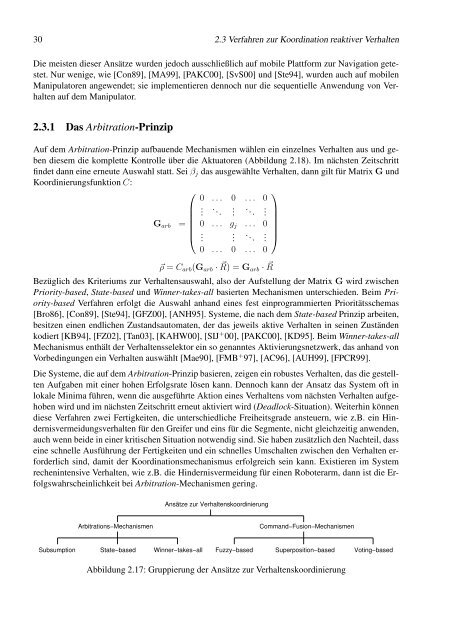

Subsumption<br />

Arbitrations−Mechanismen<br />

State−based Winner−takes−all<br />

Ansätze zur Verhaltenskoordinierung<br />

Command−Fusion−Mechanismen<br />

Fuzzy−based Superposition−based Voting−based<br />

Abbildung 2.17: Gruppierung der Ansätze zur Verhaltenskoordinierung