Thesis - RWTH Aachen University

Thesis - RWTH Aachen University

Thesis - RWTH Aachen University

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

2.5 Virtuelle Realität und Robotik 41<br />

Start<br />

(a)<br />

Ziel<br />

(−)<br />

FO2<br />

FO1<br />

O1<br />

(−)<br />

F O2<br />

F Ziel<br />

F<br />

O3<br />

FZiel FO1<br />

F<br />

O3<br />

F O2<br />

FO3 F<br />

O2<br />

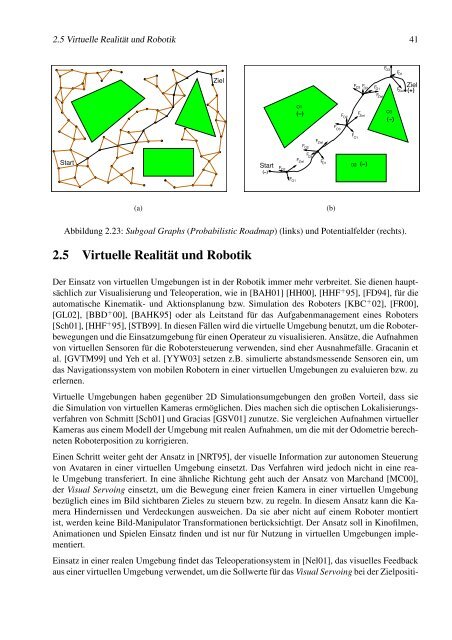

Abbildung 2.23: Subgoal Graphs (Probabilistic Roadmap) (links) und Potentialfelder (rechts).<br />

2.5 Virtuelle Realität und Robotik<br />

Der Einsatz von virtuellen Umgebungen ist in der Robotik immer mehr verbreitet. Sie dienen hauptsächlich<br />

zur Visualisierung und Teleoperation, wie in [BAH01] [HH00], [HHF + 95], [FD94], für die<br />

automatische Kinematik- und Aktionsplanung bzw. Simulation des Roboters [KBC + 02], [FR00],<br />

[GL02], [BBD + 00], [BAHK95] oder als Leitstand für das Aufgabenmanagement eines Roboters<br />

[Sch01], [HHF + 95], [STB99]. In diesen Fällen wird die virtuelle Umgebung benutzt, um die Roboterbewegungen<br />

und die Einsatzumgebung für einen Operateur zu visualisieren. Ansätze, die Aufnahmen<br />

von virtuellen Sensoren für die Robotersteuerung verwenden, sind eher Ausnahmefälle. Gracanin et<br />

al. [GVTM99] und Yeh et al. [YYW03] setzen z.B. simulierte abstandsmessende Sensoren ein, um<br />

das Navigationssystem von mobilen Robotern in einer virtuellen Umgebungen zu evaluieren bzw. zu<br />

erlernen.<br />

Virtuelle Umgebungen haben gegenüber 2D Simulationsumgebungen den großen Vorteil, dass sie<br />

die Simulation von virtuellen Kameras ermöglichen. Dies machen sich die optischen Lokalisierungsverfahren<br />

von Schmitt [Sch01] und Gracias [GSV01] zunutze. Sie vergleichen Aufnahmen virtueller<br />

Kameras aus einem Modell der Umgebung mit realen Aufnahmen, um die mit der Odometrie berechneten<br />

Roboterposition zu korrigieren.<br />

Einen Schritt weiter geht der Ansatz in [NRT95], der visuelle Information zur autonomen Steuerung<br />

von Avataren in einer virtuellen Umgebung einsetzt. Das Verfahren wird jedoch nicht in eine reale<br />

Umgebung transferiert. In eine ähnliche Richtung geht auch der Ansatz von Marchand [MC00],<br />

der Visual Servoing einsetzt, um die Bewegung einer freien Kamera in einer virtuellen Umgebung<br />

bezüglich eines im Bild sichtbaren Zieles zu steuern bzw. zu regeln. In diesem Ansatz kann die Kamera<br />

Hindernissen und Verdeckungen ausweichen. Da sie aber nicht auf einem Roboter montiert<br />

ist, werden keine Bild-Manipulator Transformationen berücksichtigt. Der Ansatz soll in Kinofilmen,<br />

Animationen und Spielen Einsatz finden und ist nur für Nutzung in virtuellen Umgebungen implementiert.<br />

Einsatz in einer realen Umgebung findet das Teleoperationsystem in [Nel01], das visuelles Feedback<br />

aus einer virtuellen Umgebung verwendet, um die Sollwerte für das Visual Servoing bei der Zielpositi-<br />

Start<br />

(b)<br />

F<br />

O1<br />

O2<br />

F<br />

Ziel<br />

(−)<br />

F O1<br />

FZiel<br />

F O3<br />

O3<br />

(−)<br />

FO1<br />

F Ziel<br />

Ziel<br />

(+)