Thesis - RWTH Aachen University

Thesis - RWTH Aachen University

Thesis - RWTH Aachen University

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

3.2 Abgleich der Daten virtueller und realer Kameras 53<br />

Objekt<br />

Tisch<br />

Segment 3<br />

Greiferkamera<br />

Greifer<br />

Segment<br />

1<br />

Manipulator<br />

(a)<br />

Segment 2<br />

Rad 1<br />

Bordkamera<br />

mobile Plattform<br />

Rad 2<br />

Griff<br />

Umgebung<br />

Objekt Tisch mobile Plattform<br />

Basis Rad 1 Bordkamera Manipulator<br />

Greifer<br />

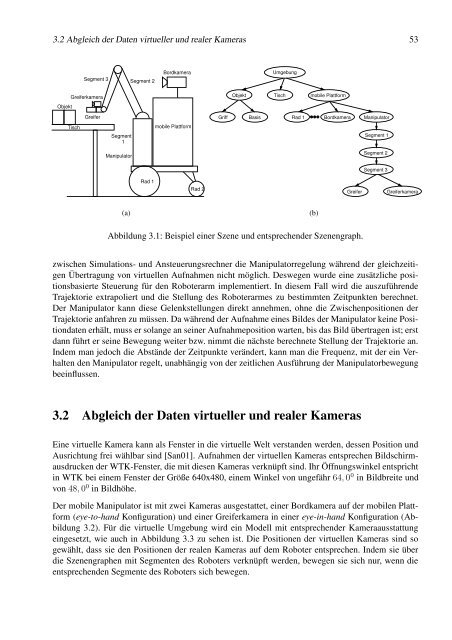

Abbildung 3.1: Beispiel einer Szene und entsprechender Szenengraph.<br />

(b)<br />

Segment 1<br />

Segment 2<br />

Segment 3<br />

Greiferkamera<br />

zwischen Simulations- und Ansteuerungsrechner die Manipulatorregelung während der gleichzeitigen<br />

Übertragung von virtuellen Aufnahmen nicht möglich. Deswegen wurde eine zusätzliche positionsbasierte<br />

Steuerung für den Roboterarm implementiert. In diesem Fall wird die auszuführende<br />

Trajektorie extrapoliert und die Stellung des Roboterarmes zu bestimmten Zeitpunkten berechnet.<br />

Der Manipulator kann diese Gelenkstellungen direkt annehmen, ohne die Zwischenpositionen der<br />

Trajektorie anfahren zu müssen. Da während der Aufnahme eines Bildes der Manipulator keine Positiondaten<br />

erhält, muss er solange an seiner Aufnahmeposition warten, bis das Bild übertragen ist; erst<br />

dann führt er seine Bewegung weiter bzw. nimmt die nächste berechnete Stellung der Trajektorie an.<br />

Indem man jedoch die Abstände der Zeitpunkte verändert, kann man die Frequenz, mit der ein Verhalten<br />

den Manipulator regelt, unabhängig von der zeitlichen Ausführung der Manipulatorbewegung<br />

beeinflussen.<br />

3.2 Abgleich der Daten virtueller und realer Kameras<br />

Eine virtuelle Kamera kann als Fenster in die virtuelle Welt verstanden werden, dessen Position und<br />

Ausrichtung frei wählbar sind [San01]. Aufnahmen der virtuellen Kameras entsprechen Bildschirmausdrucken<br />

der WTK-Fenster, die mit diesen Kameras verknüpft sind. Ihr Öffnungswinkel entspricht<br />

in WTK bei einem Fenster der Größe 640x480, einem Winkel von ungefähr 64, 0 0 in Bildbreite und<br />

von 48, 0 0 in Bildhöhe.<br />

Der mobile Manipulator ist mit zwei Kameras ausgestattet, einer Bordkamera auf der mobilen Plattform<br />

(eye-to-hand Konfiguration) und einer Greiferkamera in einer eye-in-hand Konfiguration (Abbildung<br />

3.2). Für die virtuelle Umgebung wird ein Modell mit entsprechender Kameraausstattung<br />

eingesetzt, wie auch in Abbildung 3.3 zu sehen ist. Die Positionen der virtuellen Kameras sind so<br />

gewählt, dass sie den Positionen der realen Kameras auf dem Roboter entsprechen. Indem sie über<br />

die Szenengraphen mit Segmenten des Roboters verknüpft werden, bewegen sie sich nur, wenn die<br />

entsprechenden Segmente des Roboters sich bewegen.